1.9万行Claude Code代码引发百人联名“封杀”,Node.js核心成员请愿:项目里应禁止AI辅助开发

1.9万行Claude Code代码引发百人联名“封杀”,Node.js核心成员请愿:项目里应禁止AI辅助开发在 AI 写代码这件事上,争议从来没有真正停过。但这一次,战火烧到了最核心的基础设施之一——Node.js。

在 AI 写代码这件事上,争议从来没有真正停过。但这一次,战火烧到了最核心的基础设施之一——Node.js。

代码没有消失,但它不再是少数人特权。在「创造平权」的AI时代,真正稀缺的不再是编程能力,而是你是否有一个值得让机器为你燃烧几百美元算力的好想法。

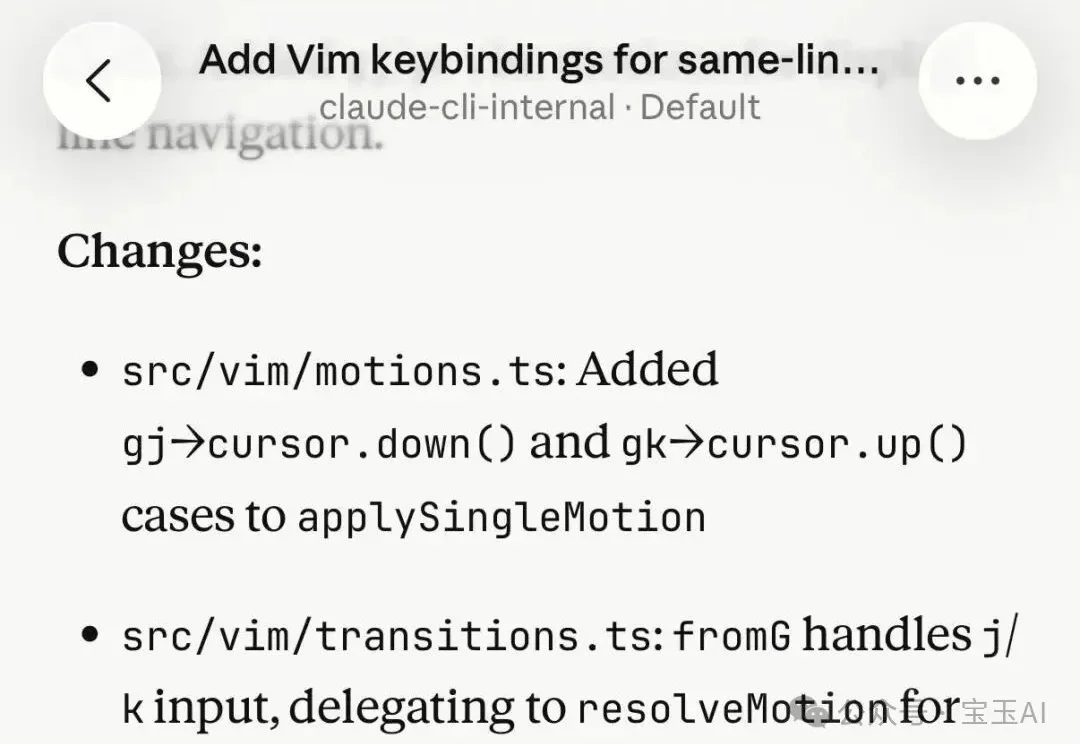

你日常用 Claude Code,用了多少功能?手机上写代码?语音编程?让 Claude 每 5 分钟自动帮你处理代码审查?

想象一下这个场景:你在地铁上刷着 Slack,看到一个需要修复的 bug。你点一个 emoji 表情,等到了办公室,代码已经写好、测试通过,Pull Request 等着你审查。这不是科幻小说,这是 Stripe 工程师每天的真实工作状态。

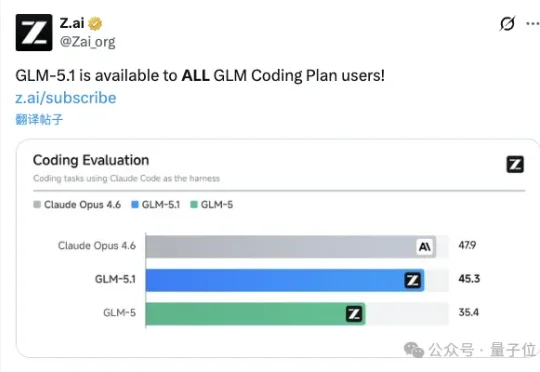

智谱GLM-5.1,突然上线!别的没再多说,只是默默甩出Coding Evaluation评测结果——在编程能力上相比上一代GLM-5直接飙升近10分。甚至嘛,距全球最强编程模型Claude Opus 4.6,也就只有2.6分之差??

国产大模型阵营再添硬核选手,智谱开放平台GLM5.1正式上线,推理、代码、智能体能力拉满,还为新用户准备了2000万Tokens免费体验包,覆盖多模型使用额度,有效期3个月。不管是日常编程开发、智能体搭建,还是多模态内容创作,这个免费额度都能轻松拿捏,新手也能零门槛上手,这波福利可别错过。

硅心科技(aiXcoder)发布了一款专为「代码变更应用」场景设计的高性能、轻量级模型 aiX-apply-4B。基准测试结果显示,在 20 多种主流编程语言及 Markdown 等多类型文件格式的测试中,aiX-apply-4B 的平均准确率达到 93.8%,超越 Qwen3-4B 基座模型 62.6% 的准确度

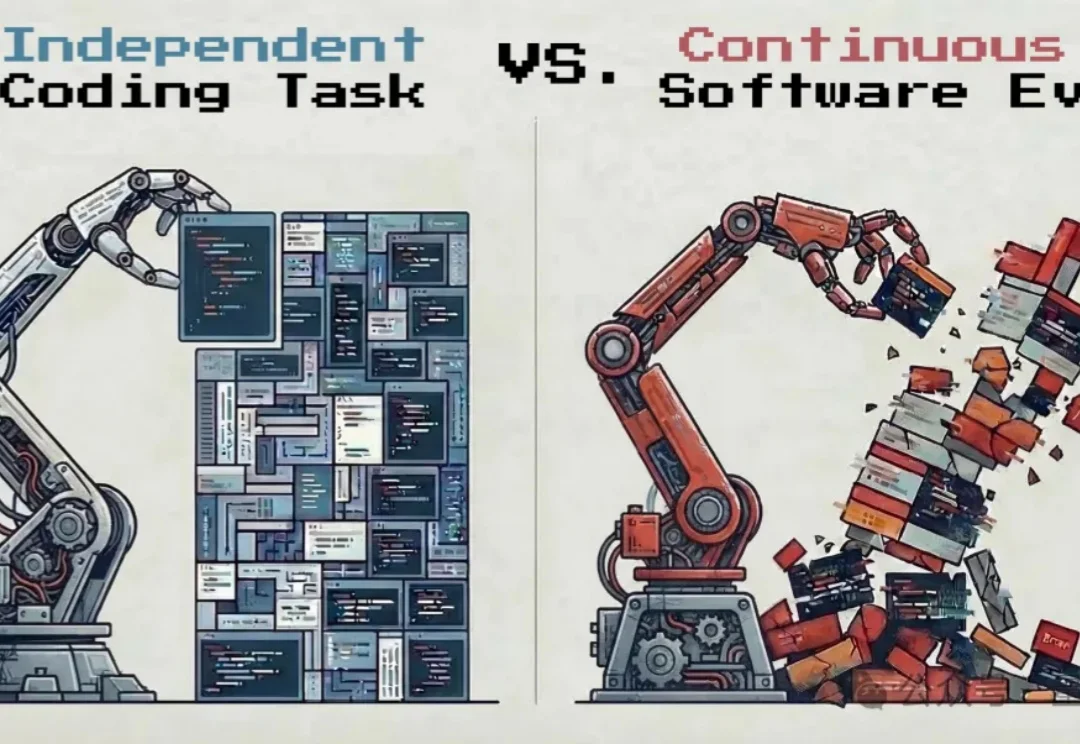

到2025年末,AI编程已经全面从辅助工具Copilot,转向以AI为主、人类监督的Agent时代。

Meta再次出手了。这次不是收购某个成熟产品,而是直接把整个团队连锅端走。

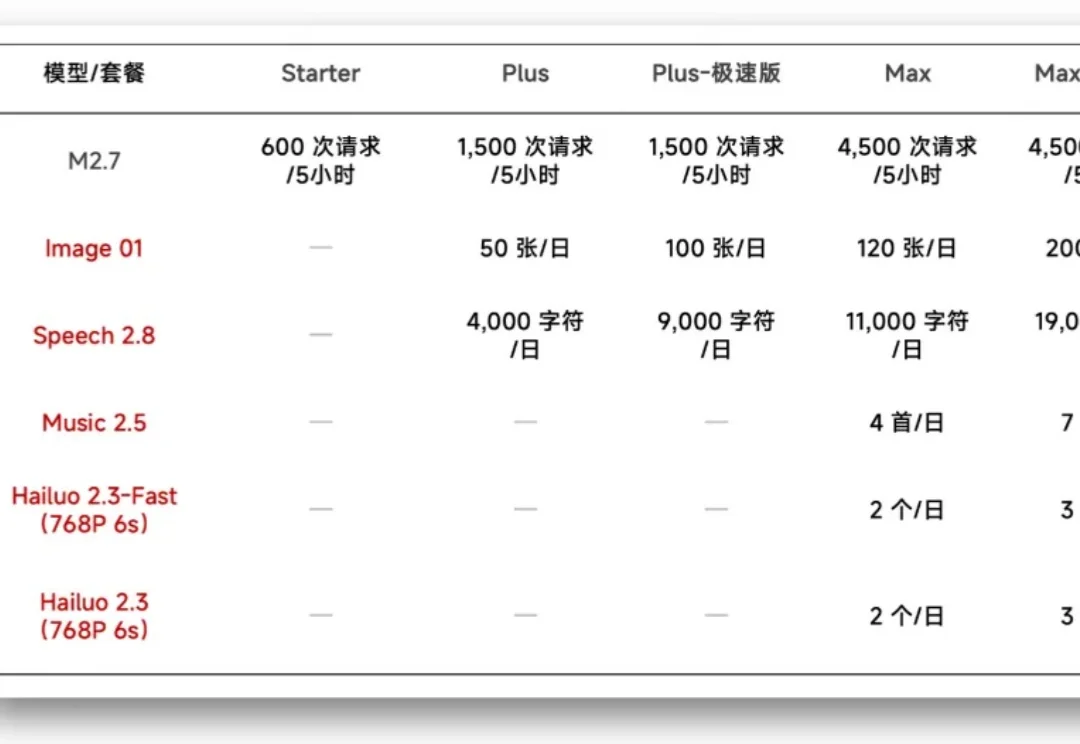

去年 11 月,M2 系列模型 Coding Plan 国内率先上线。M2 系列模型的编码能力、处理速度,还有对主流编程工具的适配,受到了很多开发者朋友的欢迎,M2.7 也成为了大家首选的编程模型之一。