首个全自动AI科学家诞生!西湖大学最新成果:性能超越人类SOTA基线183.7%

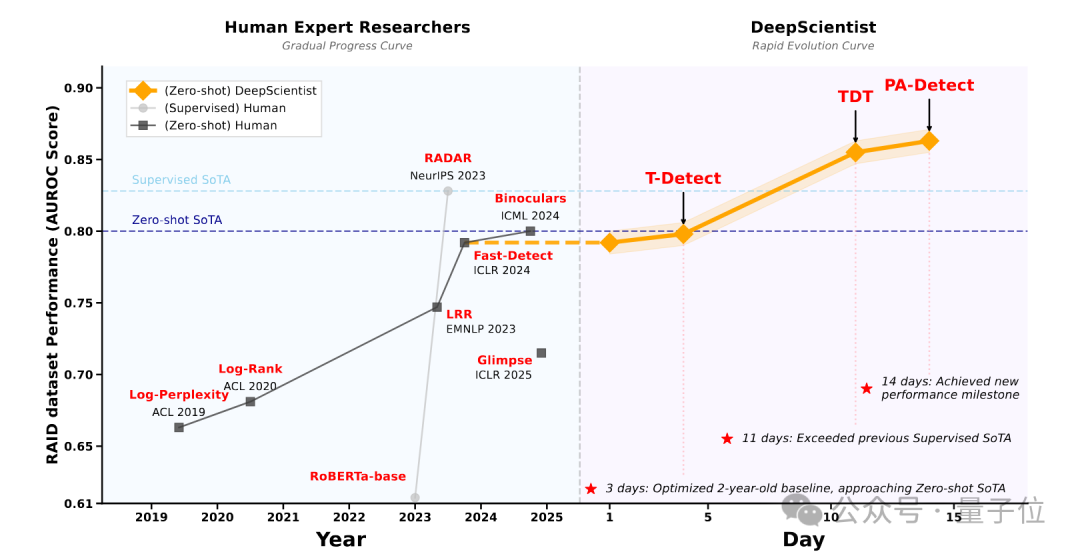

首个全自动AI科学家诞生!西湖大学最新成果:性能超越人类SOTA基线183.7%最近,来自西湖大学的自然语言处理实验室发布了DeepScientist系统,这也是首个具有完整科研能力,且在无人工干预下,展现出目标导向、持续迭代、渐进式超越人类研究者最先进研究成果的AI科学家系统。

搜索

搜索

最近,来自西湖大学的自然语言处理实验室发布了DeepScientist系统,这也是首个具有完整科研能力,且在无人工干预下,展现出目标导向、持续迭代、渐进式超越人类研究者最先进研究成果的AI科学家系统。

蚂蚁通用人工智能中心自然语言组联合香港大学自然语言组(后简称“团队”)推出PromptCoT 2.0,要在大模型下半场押注任务合成。实验表明,通过“强起点、强反馈”的自博弈式训练,PromptCoT 2.0可以让30B-A3B模型在一系列数学代码推理任务上实现新的SOTA结果,达到和DeepSeek-R1-0528, OpenAI o3, Gemini 2.5 Pro等相当的表现。

Lessie 的定位简单直接:People Search AI Agent。一句话描述它的能力:帮你从互联网与数据库里快速找到任何人,并自动化完成初步联络。创始人、投资人、KOL、潜在客户、行业专家、合作伙伴……只要你能用自然语言描述需求,Lessie 就能迅速在全球范围内挖掘到合适的人选。

Nano Banana热度持续升温,谷歌马不停蹄再度发力。发布一款全新的AI画板工具——Mixboard,该工具由Banana提供支持,号称能把任何想法都即时可视化。不管是玩创意点子,还是设计家居装饰,Mixboard都能用自然语言编辑图板,轻松调整或合并图像。

机器人终于不用散装大脑了! 字节Seed一个模型就能搞定机器人推理、任务规划和自然语言交互。

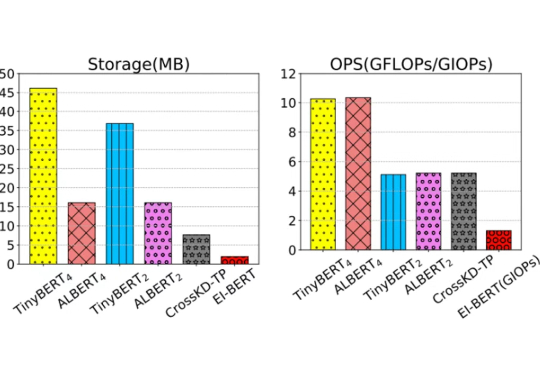

在移动计算时代,将高效的自然语言处理模型部署到资源受限的边缘设备上面临巨大挑战。这些场景通常要求严格的隐私合规、实时响应能力和多任务处理功能。

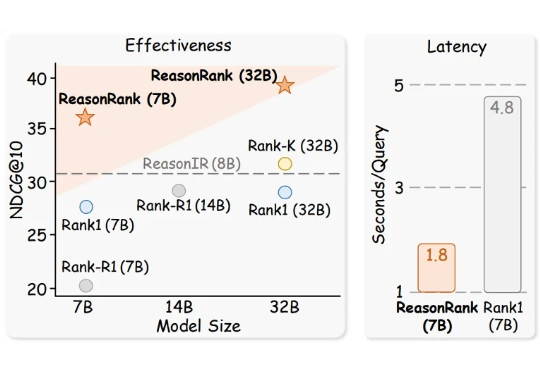

推理大模型(Large Reasoning Model)极大的促进了自然语言处理领域的发展,而信息检索领域的核心问题之一是文档排序,如何利用强大的推理大模型通过主动推理来判断文档的相关性,进而再对文档进行排序是一个值得探索的方向。

从2022年的Stable Diffusion、Midjourney,到如今的即梦AI、Lovart,AI创意工具,已经重塑了创作的工作流: 创作者提供点子,自然语言作为交互界面,AI工具最后高效实现创意的生成。

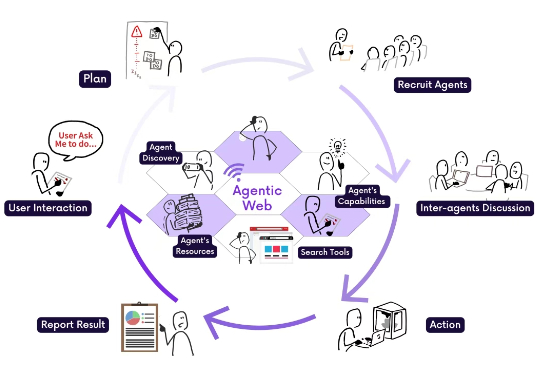

过去三十年,互联网经历了从静态网页到智能推荐的深刻演变。如今,我们正站在互联网的另一个重大转折点上。 这一转折,来自一种全新的范式设想 —— Agentic Web,一个由 AI 智能体组成的、目标导向型的互联网系统。在这个新框架中,用户不再手动浏览网页、点击按钮,而是通过自然语言向智能体发出一个目标,AI 会自主规划、搜索、调用服务、协调其他智能体,最终完成复杂任务。

自 2021 年夏季 GitHub Copilot 以预览版问世 以来,编程助手产品呈现爆发式增长。这类工具最初被用作增强型代码补全工具,而 Cursor、Windsurf 等产品则迅速转向了 Agent 交互模式:通过自然语言指令触发,助手能自主执行修改代码文件、运行终端命令等操作。