清华天眸芯登Nature封面!世界首个类脑互补视觉芯片问世,或开辟AGI新路

清华天眸芯登Nature封面!世界首个类脑互补视觉芯片问世,或开辟AGI新路时隔3年,清华团队的研究再次登上Nature封面。刚刚,世界首个类脑互补视觉芯片Tianmouc重磅发布,灵感来源于人类视觉系统。它能以极低带宽和功耗采集图像信息,突破了传统的视觉感知挑战,自如应对开放世界中极端场景难题。

时隔3年,清华团队的研究再次登上Nature封面。刚刚,世界首个类脑互补视觉芯片Tianmouc重磅发布,灵感来源于人类视觉系统。它能以极低带宽和功耗采集图像信息,突破了传统的视觉感知挑战,自如应对开放世界中极端场景难题。

相同性能情况下,延迟减少 46%,参数减少 25%。

目标检测领域,迎来了新进展—— Grounding DINO 1.5,IDEA研究院团队出品,在端侧就可实现实时识别。

当前,多模态大模型 (MLLM)在多项视觉任务上展现出了强大的认知理解能力。 然而大部分多模态大模型局限于单向的图像理解,难以将理解的内容映射回图像上。 比如,模型能轻易说出图中有哪些物体,但无法将物体在图中准确标识出来。 定位能力的缺失直接限制了多模态大模型在图像编辑,自动驾驶,机器人控制等下游领域的应用。针对这一问题,港大和字节跳动商业化团队的研究人员提出了一种新范式Groma

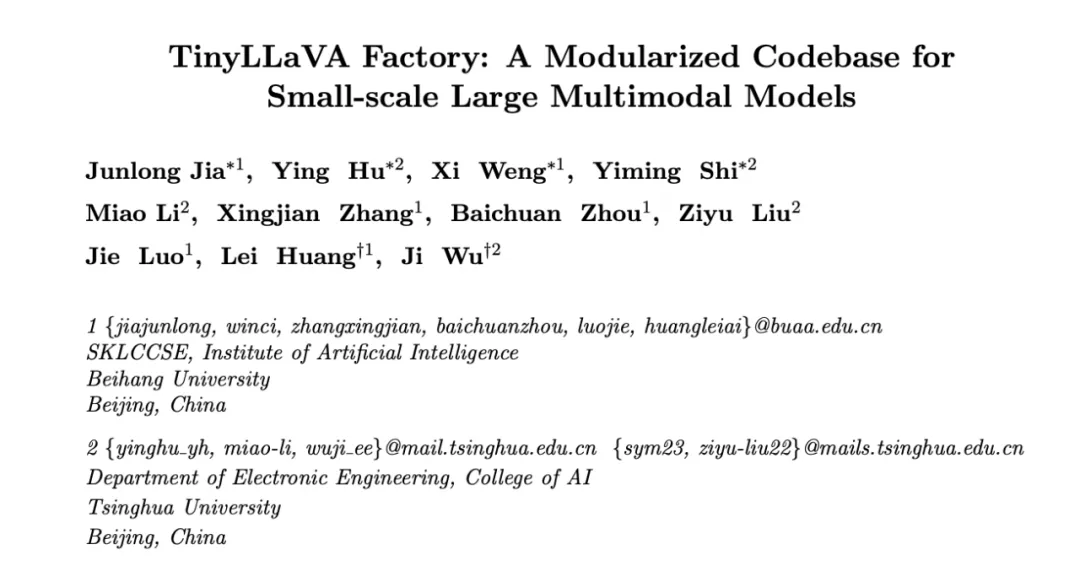

TinyLLaVA 项目由清华大学电子系多媒体信号与智能信息处理实验室 (MSIIP) 吴及教授团队和北京航空航天大学人工智能学院黄雷老师团队联袂打造。清华大学 MSIIP 实验室长期致力于智慧医疗、自然语言处理与知识发现、多模态等研究领域。北航团队长期致力于深度学习、多模态、计算机视觉等研究领域。

和多数人一样,在看到 OpenAI 最新发布的「AI 智能助手」GPT-4o 时,MiniMax 创始人兼 CEO 闫俊杰的第一感觉是「惊艳」。他也为那些演示效果着迷,如丝滑的语音交互、实时的视觉理 解、语言捕捉甚至包括了「呼吸声」。

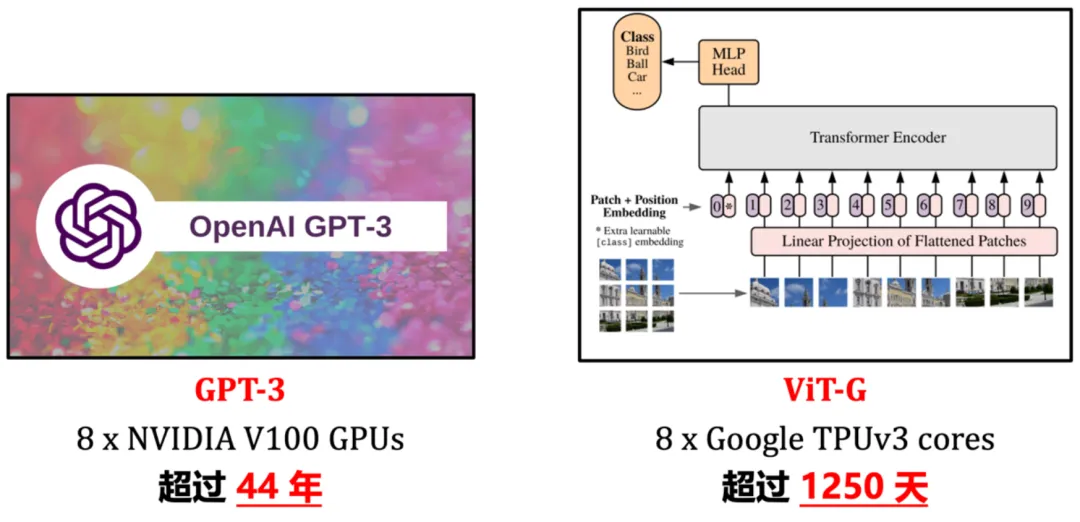

近年来,「scaling」是计算机视觉研究的主角之一。随着模型尺寸和训练数据规模的增大、学习算法的进步以及正则化和数据增强等技术的广泛应用,通过大规模训练得到的视觉基础网络(如 ImageNet1K/22K 上训得的 Vision Transformer、MAE、DINOv2 等)已在视觉识别、目标检测、语义分割等诸多重要视觉任务上取得了令人惊艳的性能。

在不久之前的 2024 TED 演讲中,李飞飞详细解读了 空间智能(Spatial Intelligence)概念。她对计算机视觉领域在数年间的快速发展感到欣喜并抱有极大热忱,并为此正在创建初创公司

瑞士信息与通信科技公司Assaia International(以下简称Assaia)成立于2018年,该公司开发了一款AI视觉识别软件,能通过人工智能和计算机视觉实时识别并管理机场空侧运营状态,帮助机场、航空公司和地勤人员提升空侧运营管理效率,将航班准点率提高17%,将飞机周转时间缩短11%。

ChatGPT以及硅谷AI大战终于升级,长出了“眼睛”和“嘴”。5月中旬,OpenAI和谷歌前后发布重磅AI多模态更新,从基于文字交互的ChatGPT全面升级,实现了“声音,文字和视觉”三者全面结合的人工智能新交互功能,而这,也标志着硅谷科技巨头的生成式AI之战正式进入到第二轮。新一轮竞争,只会更加激烈、更加全面。