横扫13个视觉语言任务!哈工深发布多模态大模型「九天」,性能直升5%

横扫13个视觉语言任务!哈工深发布多模态大模型「九天」,性能直升5%哈工深发布全新多模态大语言模型九天(JiuTian-LION),融合细粒度空间感知和高层语义视觉知识,在13个评测任务上实现了sota性能。

哈工深发布全新多模态大语言模型九天(JiuTian-LION),融合细粒度空间感知和高层语义视觉知识,在13个评测任务上实现了sota性能。

这是最近在社交媒体上爆火的扩散模型视错觉画,随便给AI两组不同的提示词,它都能给你画出来!

通义千问开源全家桶正式上线!业界最强72B模型直接超越开源标杆Llama 2-70B,还有1.8B模型、音频大模型全部开源,阿里云这次真的把家底都掏出来了。

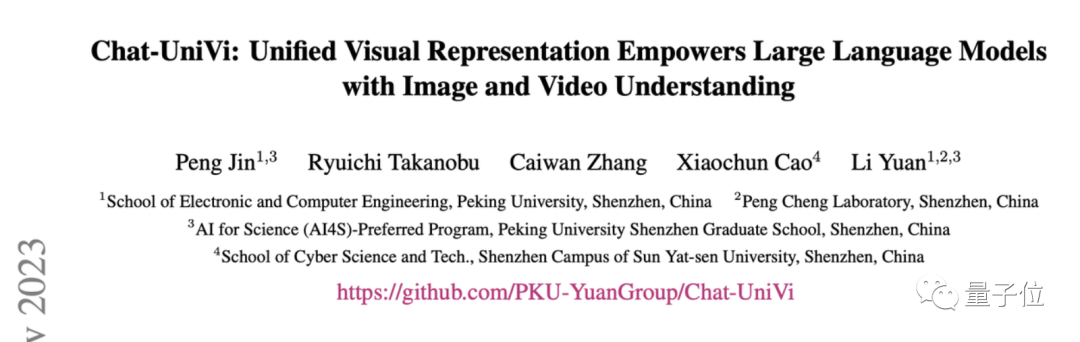

训完130亿参数通用视觉语言大模型,只需3天!北大和中山大学团队又出招了——在最新研究中,研究团队提出了一种构建统一的图片和视频表征的框架。利用这种框架,可以大大减少VLM(视觉语言大模型)在训练和推理过程中的开销。

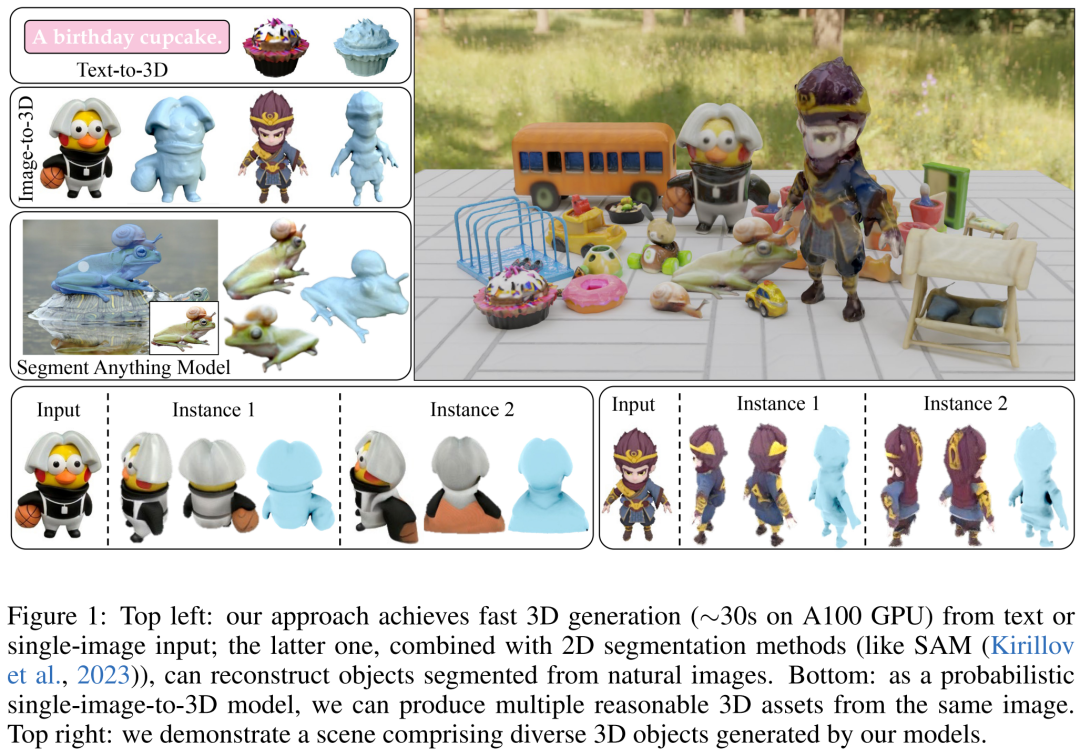

3D 生成是 AI 视觉领域的研究热点之一。本文中,来自 Adobe 研究院和斯坦福大学等机构的研究者利用基于 transformer 的 3D 大型重建模型来对多视图扩散进行去噪,并提出了一种新颖的 3D 生成方法 DMV3D,实现了新的 SOTA 结果。

用视觉来做Prompt!沈向洋展示IDEA研究院新模型,无需训练或微调,开箱即用

最近,来自北京大学等机构研究者提出了一种全新视觉语言大模型——Video-LLaVA,使得LLM能够同时接收图片和视频为输入。Video-LlaVA在下游任务中取得了卓越的性能,并在图片、视频的13个基准上达到先进的性能。这个结果表明,统一LLM的输入能让LLM的视觉理解能力提升。

AI能理解搞笑视频笑点在哪里了。北大等团队开源视觉语言大模型Video-LLaVA,将图像和视频表示对齐到统一的视觉特征空间,在13个图片和视频基准上达到先进的性能。

OpenAI在首届开发者日上,正式公布自定义GPT。与此同时,现有的GPT-4也迎来一大波更新。 新版本GPT-4 Turbo,支持128k上下文,知识截止更新到2023年4月,视觉能力、DALL·E3,文字转语音TTS等等全都对API开放…… API价格还打了3-5折。

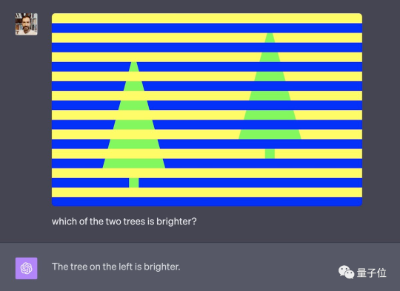

GPT-4V挑战视觉错误图,结果令人“大跌眼镜”。 像这种判断“哪边颜色更亮”的题,一个没做对