ICML 2025|如何凭「自动补全」实现100K生成3×加速?

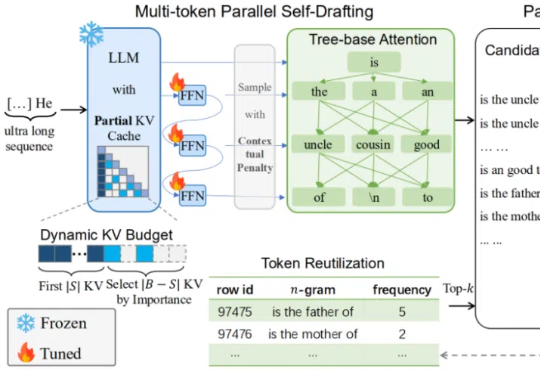

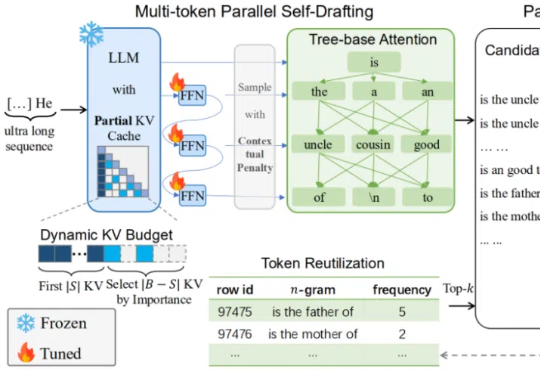

ICML 2025|如何凭「自动补全」实现100K生成3×加速?在当前大模型推理愈发复杂的时代,如何快速、高效地产生超长文本,成为了模型部署与优化中的一大核心挑战。

在当前大模型推理愈发复杂的时代,如何快速、高效地产生超长文本,成为了模型部署与优化中的一大核心挑战。

自回归(AR)范式凭借将语言转化为离散 token 的核心技术,在大语言模型领域大获成功 —— 从 GPT-3 到 GPT-4o,「next-token prediction」以简单粗暴的因果建模横扫语言领域。

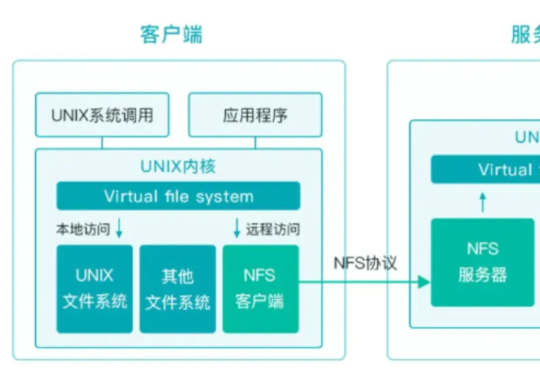

经过对多种开源存储系统的评估对比,我们选择了 JuiceFS 。我们的架构采用 Redis 进行高性能元数据管理,同时构建了自有 MinIO 集群作为底层对象存储,这一架构完美解决了模型训练场景中的数据读写瓶颈、元数据访问延迟以及计算资源之间的存储互通问题。

最近,人们对AI谈得最多的是deepseek(简称DS)。这匹来自中国本土的黑马,闯入全球视野,一度扰乱美国股市,在 AI 领域掀起了一场轩然大波。

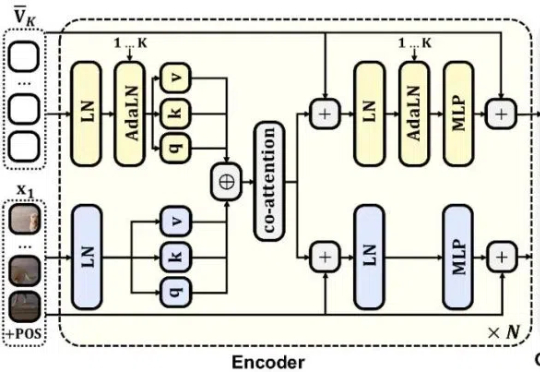

统一图像理解和生成,还实现了新SOTA。

ChatGPT「舔狗化」事件背后,暴漏目前AI仍是「黑箱」。 一场关于「机制可解释性」的路线分歧,正撕裂AI研究最核心的价值共识。谷歌认怂,Anthropic死磕——AI还能被「看懂」吗?

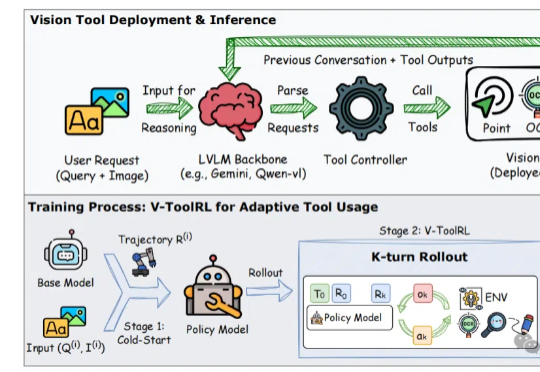

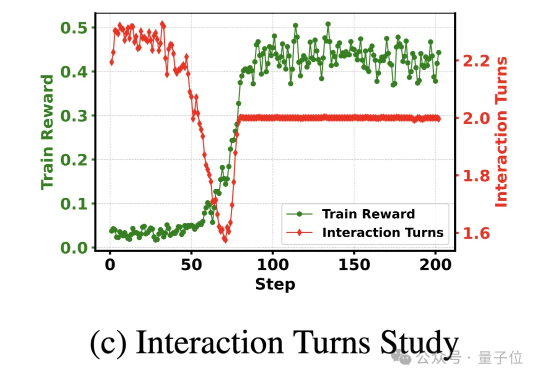

教AI学会使用工具,带图推理就能变得更强?!

强化学习(RL)+真实搜索引擎,可以有效提升大模型检索-推理能力。

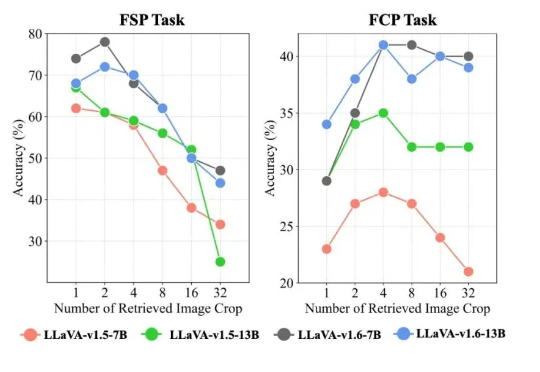

该工作由南洋理工大学陶大程教授团队与武汉大学罗勇教授、杜博教授团队等合作完成。

近日,腾讯 PCG 社交线的研究团队针对这一问题,采用强化学习(RL)训练方法,通过分组相对策略优化(Group Relative Policy Optimization, GRPO)算法,结合基于奖励的课程采样策略(Reward-based Curriculum Sampling, RCS),将其创新性地应用在意图识别任务上,