最强开源多模态生成模型MM-Interleaved:首创特征同步器

最强开源多模态生成模型MM-Interleaved:首创特征同步器过去几个月中,随着 GPT-4V、DALL-E 3、Gemini 等重磅工作的相继推出,「AGI 的下一步」—— 多模态生成大模型迅速成为全球学者瞩目的焦点。

过去几个月中,随着 GPT-4V、DALL-E 3、Gemini 等重磅工作的相继推出,「AGI 的下一步」—— 多模态生成大模型迅速成为全球学者瞩目的焦点。

AI大模型在业界备受关注,但对于一些公司来说,采用小模型可能是一种更好的选择。微软已经开始研发小规模、低算力需求的模型,并组建新团队进行对话式AI的开发。而对于工业、金融和汽车等领域而言,小模型更易于落地,并且具有省电、省钱、省时间的优势。

对于大型视觉语言模型(LVLM)而言,扩展模型可以有效提高模型性能。然而,扩大参数规模会显著增加训练和推理成本,因为计算中每个 token 都会激活所有模型参数。

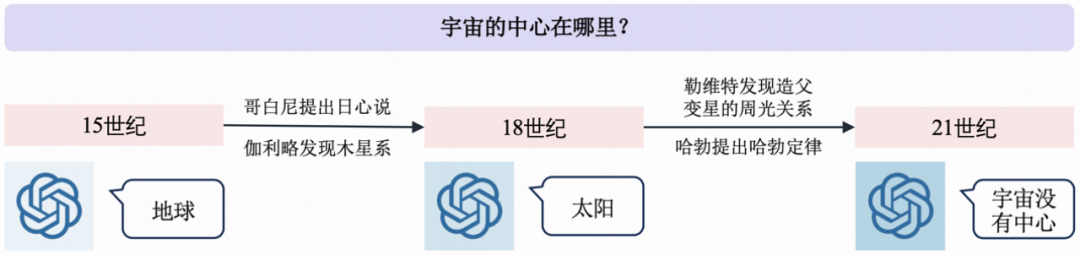

生成式AI技术发展的背后,反映出人类与大模型交互的不断精进。大模型在训练过程中不断学习人类的思考方式,人类在与大模型的对话中也收获了灵感和新知。

不用图像,只用文本就能训练出视觉概念表征?用写代码的方式读懂画面,形状、物体、场景都能懂!

删除权重矩阵的一些行和列,让 LLAMA-2 70B 的参数量减少 25%,模型还能保持 99% 的零样本任务性能,同时计算效率大大提升。这就是微软 SliceGPT 的威力。

OpenAI 在一篇博文中发布了多项更新,并表示更新后的 GPT-4 Turbo“拥有比之前预览模型更好的代码生成等能力,且减少了模型在任务中途罢工的「变懒」情况。”但该公司并没有对更新内容做进一步解释。

使用LLM生成海量任务的文本数据,无需人工标注即可大幅提升文本嵌入的适用度,只需1000训练步即可轻松扩展到100种语言。

在认知科学领域,人类通过持续学习改变认知的过程被称为认知迭代(Cognitive Dynamics)。形象地说,认知迭代就像是我们大脑的「软件更新」过程,手机应用通过不断的更新来修复 bug 和增加新功能,我们的大脑也通过不断学习新知识、经验,来改善和优化思考方式。

美国计划限制中国客户使用美国云计算厂商的服务训练AI大模型,对中国人工智能产业造成潜在破坏。本文分析了中国科技行业追赶的三个因素。