字节推出最新偷懒大法,AI绘画连prompt都不用学了

字节推出最新偷懒大法,AI绘画连prompt都不用学了绝大多数AI生图模型在训练的时候侧重的是文本和图形之间的关联,并不擅长语义分析和复杂元素处理。

绝大多数AI生图模型在训练的时候侧重的是文本和图形之间的关联,并不擅长语义分析和复杂元素处理。

自从ChatGPT发布后,各种基于大模型的产品也快速融入了普通人的生活中,但即便非AI从业者在使用过几次后也可以发现,大模型经常会胡编乱造,生成错误的事实。

状态空间模型(SSM)是近来一种备受关注的 Transformer 替代技术,其优势是能在长上下文任务上实现线性时间的推理、并行化训练和强大的性能。而基于选择性 SSM 和硬件感知型设计的 Mamba 更是表现出色,成为了基于注意力的 Transformer 架构的一大有力替代架构。

OPO 无需训练即可实现实时动态对齐,而且因其即插即用的特性,适用于所有的开源与闭源大模型。

最近,外媒曝出Sam Altman正计划筹集数十亿美元,为OpenAI建起全球性的半导体晶圆厂网络。GPT-5训练严重缺芯,OpenAI誓不让英伟达掌握主动权,干脆自己做新的AI芯片霸主?

AGI若到来,人类是否会受到威胁,是一个大众热衷讨论同时研究者们也很关注的问题,从各个角度对此的研究几乎都会引发人们的讨论。最新的一个重磅研究来自今天最重要的大模型公司之一Anthropic。

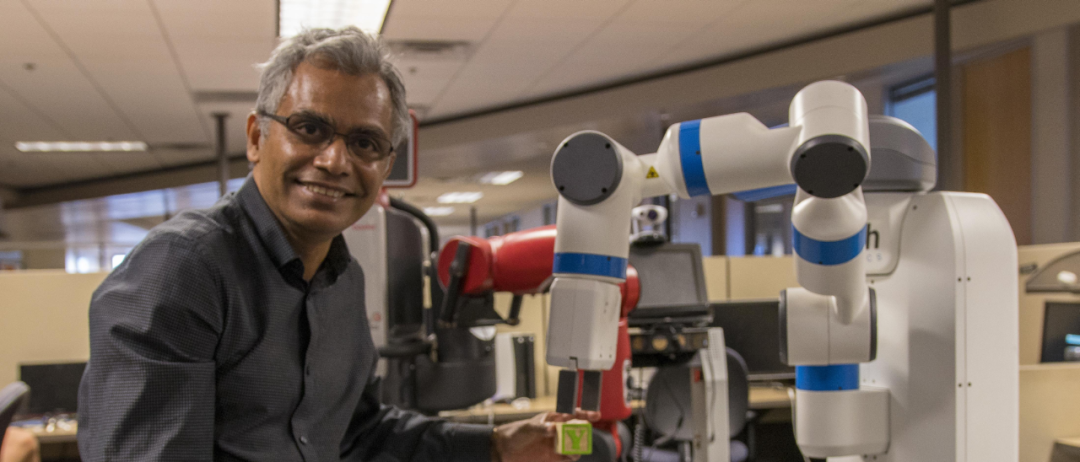

要真正的实现AGI的话,需要有强大的模型和数量庞大且高质量的数据、可扩展的基础训练以及符号化的方法。

自 ChatGPT 等大型语言模型推出以来,为了提升模型效果,各种指令微调方法陆续被提出。本文中,普林斯顿博士生、陈丹琦学生高天宇汇总了指令微调领域的进展,包括数据、算法和评估等。

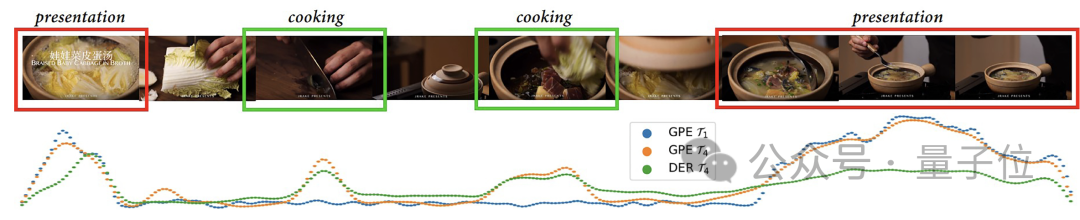

字节跳动联合中科院自动化研究所提出新方法,用AI快速检测出视频中的高光片段,对输入视频的长度以及期望提取的高光长度都具有极高的灵活性,相关论文已被AAAI 2024收录。

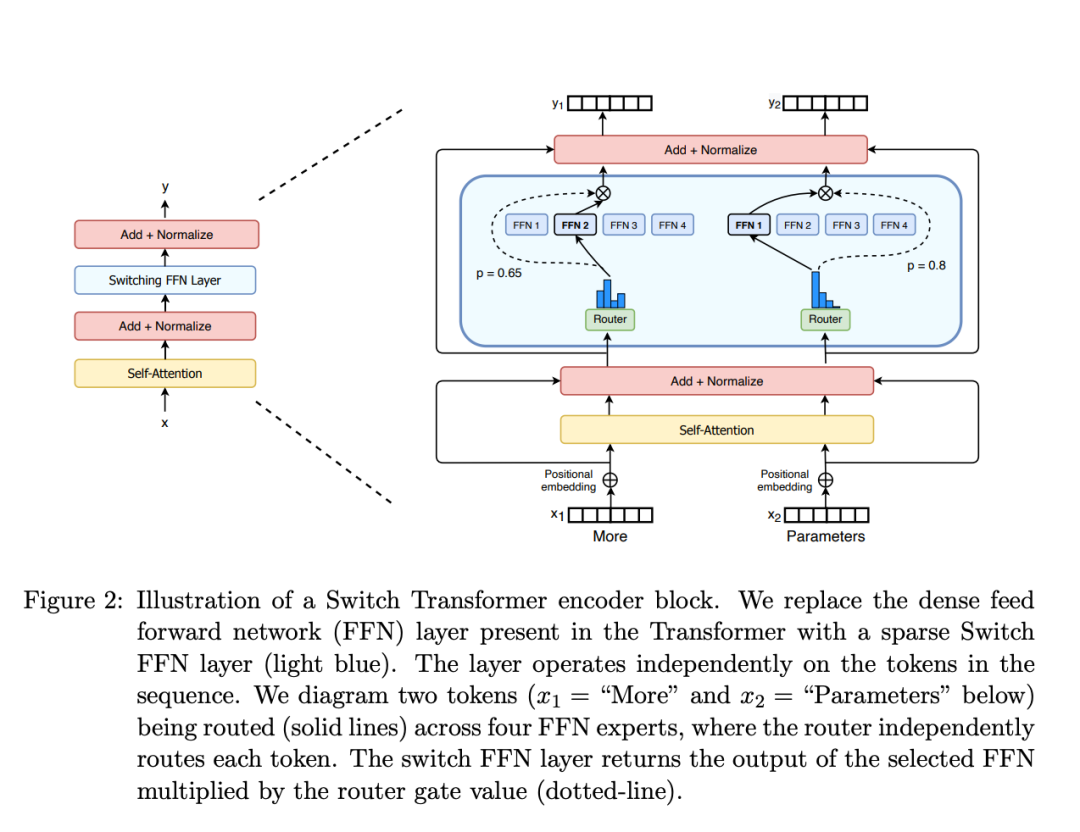

本文将介绍 MoE 的构建模块、训练方法以及在使用它们进行推理时需要考虑的权衡因素。