AI计算,为什么要用GPU?

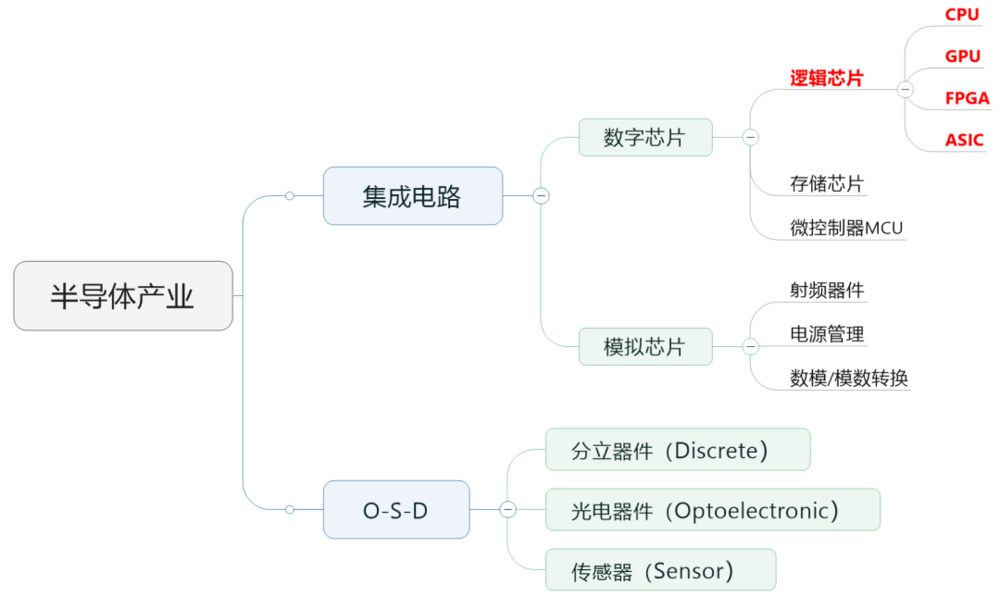

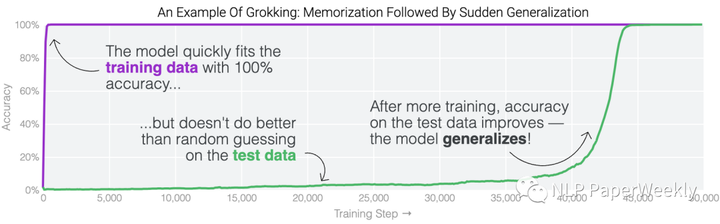

AI计算,为什么要用GPU?本文介绍了为什么在AI计算中要使用GPU,以及GPU与CPU的区别和作用。GPU具备强悍的并行计算能力,适合处理大量高强度并行计算任务,包括深度学习算法。

本文介绍了为什么在AI计算中要使用GPU,以及GPU与CPU的区别和作用。GPU具备强悍的并行计算能力,适合处理大量高强度并行计算任务,包括深度学习算法。

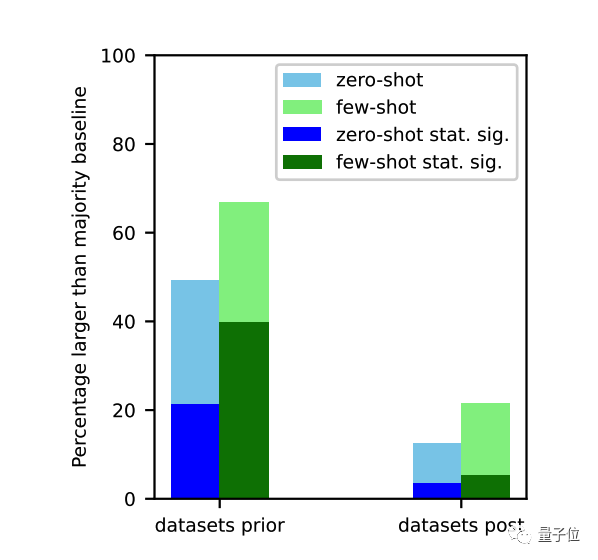

最近由UCSC的研究人员发表论文,证明大模型的零样本或者少样本能力,几乎都是来源于对于训练数据的记忆。

Hyena处理长序列输入比FlashAttention速度高100倍!最新发布的StripedHyena模型可能成下一代AI架构的新标准?

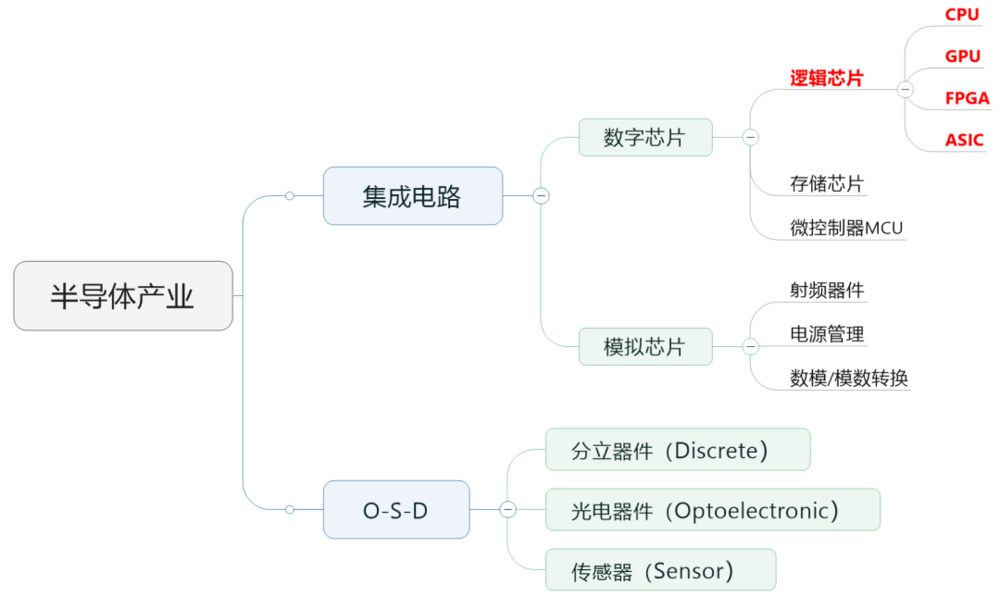

所谓灾难性遗忘,就是一个在原始任务上训练好的神经网络在训练完新任务后,在原始任务上的表现崩溃式的降低。

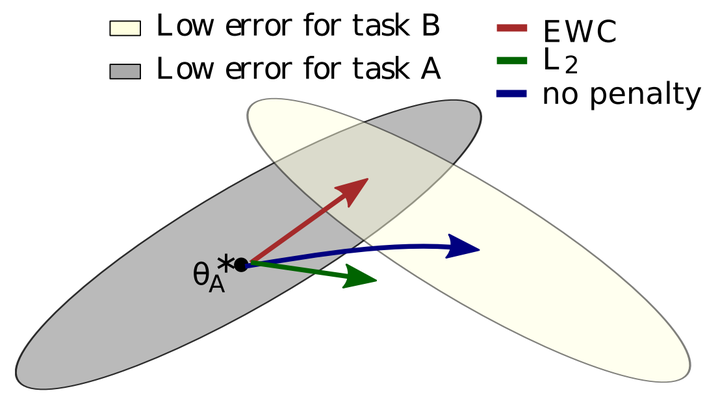

今天分享一篇符尧大佬的一篇数据工程(Data Engineering)的文章,解释了speed of grokking指标是什么,分析了数据工程

对于ChatGPT变笨原因,学术界又有了一种新解释。加州大学圣克鲁兹分校一项研究指出:在训练数据截止之前的任务上,大模型表现明显更好。

一个来自MIT博士生的惊人发现:只需对Transformer的特定层进行一种非常简单的修剪,即可在缩小模型规模的同时显著提高模型性能。

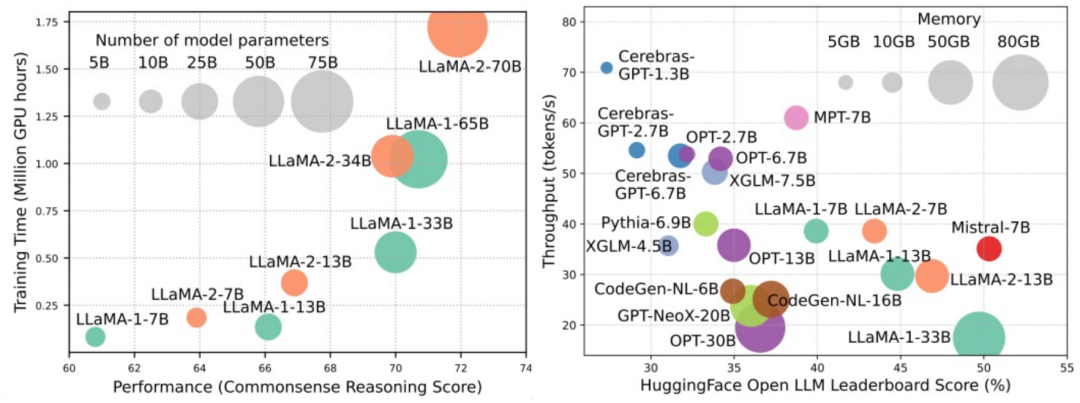

大规模语言模型(LLMs)在很多关键任务中展现出显著的能力,比如自然语言理解、语言生成和复杂推理,并对社会产生深远的影响。然而,这些卓越的能力伴随着对庞大训练资源的需求(如下图左)和较长推理时延(如下图右)。因此,研究者们需要开发出有效的技术手段去解决其效率问题。

2024年,优化训练和部署大模型仍然非常重要,大模型的生态加速形成,应用开始在一些领域大规模展开,主要表现在如下十个领域:

今天,纽约时报对OpenAI和微软正式提起诉讼,指控其未经授权就使用纽约时报内容训练人工智能模型。此案可能是人工智能使用知识版权纠纷的分水岭。