当马斯克OpenAI算力军备赛打响,中国最大国产AI算力池来了!

当马斯克OpenAI算力军备赛打响,中国最大国产AI算力池来了!昨日,由中科曙光提供的3套scaleX万卡超集群系统,在国家超算互联网核心节点同时上线试运行。这是国内第一次在国家级算力枢纽节点上,同步部署并实际投入运营3套万卡级AI超集群,一举成为全国首个实现超3万卡部署、且已进入实际运营阶段的最大国产AI算力池。

搜索

搜索

昨日,由中科曙光提供的3套scaleX万卡超集群系统,在国家超算互联网核心节点同时上线试运行。这是国内第一次在国家级算力枢纽节点上,同步部署并实际投入运营3套万卡级AI超集群,一举成为全国首个实现超3万卡部署、且已进入实际运营阶段的最大国产AI算力池。

基于 Kimi K2.5 的能力,Kimi 现在能够提供单个性能的 Kimi Agent 和多个 Agent 协作的 Agent Swarm(多智能体集群),允许多个 AI Agent 并行协作处理复杂任务的架构。

刚刚,全球首个GW级超算集群Colossus 2,正式投入运行。

2022年,Google Cloud 将π计算到100万亿位,在2025年,高性能计算界的知名评测机构 StorageReview只用了4个月的时间,花了不到一千美元电费就将π算到314万亿位,这可不是为了炫技,而是说明高性能计算也可以很节能。

当国产AI芯片接连发布、估值高涨之际,一个尖锐的问题依然悬在头顶:它们真的能撑起下一代万卡集群与万亿参数模型的训练吗?

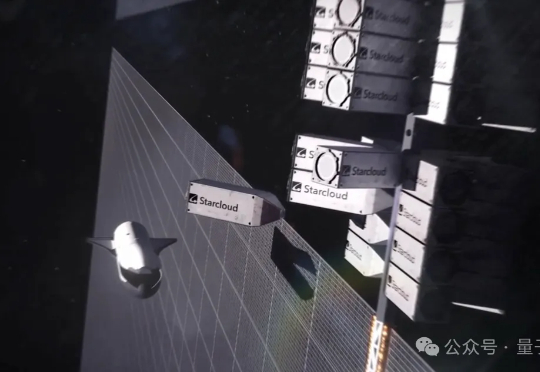

地面上的算力“内卷”,终于突破了大气层的束缚。前脚,装有英伟达H100的Starcloud-1卫星搭乘SpaceX的猎鹰9号火箭成功进入轨道,迈出构建“太空超算”的关键一步。谷歌紧随其后,火速披露了部署搭载TPU卫星集群的“太阳捕手”计划(Project Suncatcher)。

新的资金和算力基础设施将加速 Luma AI 通往多模态 AGI 的路径 —— 即能够模拟现实并在物理世界中帮助人类的 AI。

华为公司董事、ICT BG CEO 杨超斌在致辞中表示,AI 技术正以前所未有的速度改变各行各业,传统服务器集群无法有效满足算力不断增长的诉求。华为已经开放灵衢互联协议 2.0,支持产业界伙伴打造基于灵衢的超节点,还将向开源欧拉社区贡献支持超节点的操作系统插件代码,提供「内存统一编址」

目标2030年百万卡集群点亮。

两人小团队,仅用两周就复刻了之前被硅谷夸疯的DeepSeek-OCR?? 复刻版名叫DeepOCR,还原了原版低token高压缩的核心优势,还在关键任务上追上了原版的表现。完全开源,而且无需依赖大规模的算力集群,在两张H200上就能完成训练。