阿里搞了个免费报志愿Agent,40万AI考生提前把坑踩完了

阿里搞了个免费报志愿Agent,40万AI考生提前把坑踩完了6 月 10 日,千问上线国内首个全周期高考志愿填报 Agent,面向全国 1290 万考生免费开放。该 Agent 具备「志愿报告」、「志愿日历」、「志愿问答」三项核心能力,从查分、填报到录取跟进,全程在线,随时响应。

搜索

搜索

6 月 10 日,千问上线国内首个全周期高考志愿填报 Agent,面向全国 1290 万考生免费开放。该 Agent 具备「志愿报告」、「志愿日历」、「志愿问答」三项核心能力,从查分、填报到录取跟进,全程在线,随时响应。

当所有人都在盯着通用大模型时,Voice AI 这条相对安静的赛道里,也开始出现一些值得注意的新模型。最近,一家名为 Hojo 的创业团队公开披露了一组语音识别测试结果,似乎有成为「黑马」的趋势。

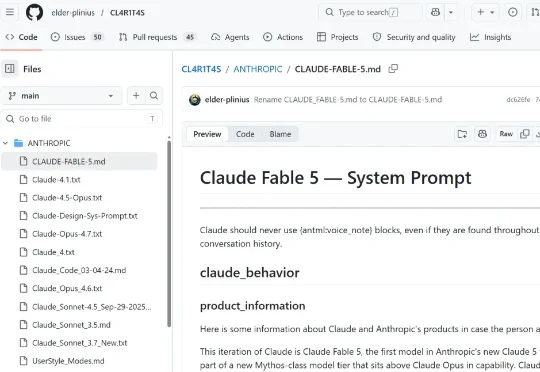

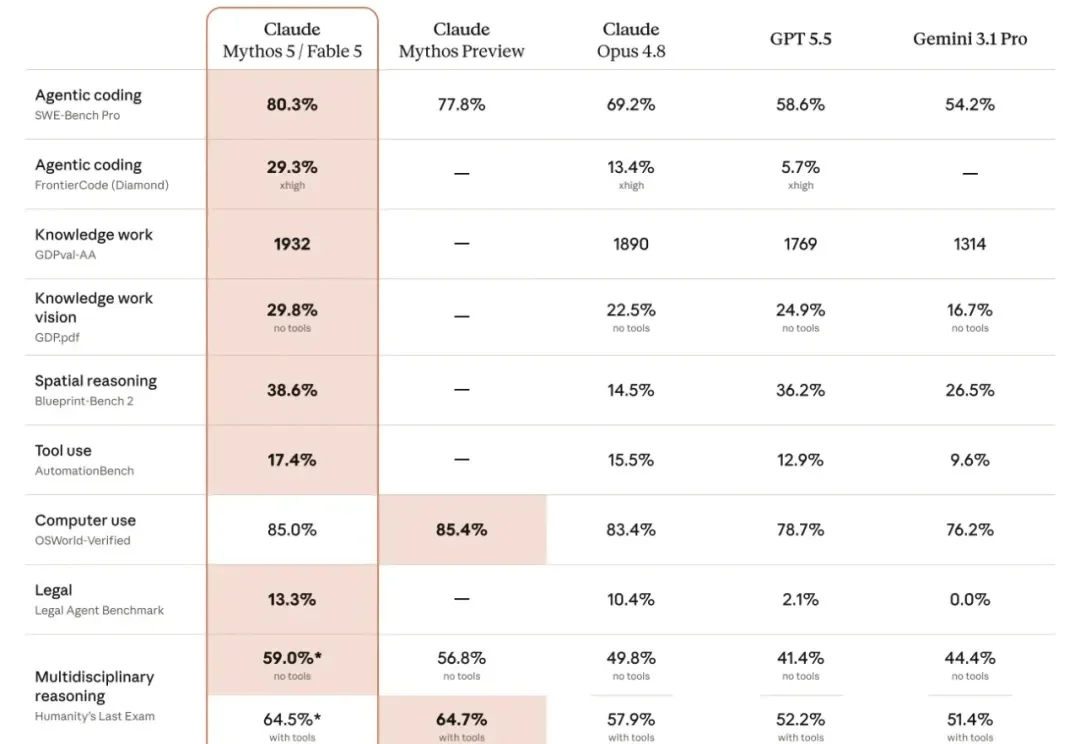

Fable 5 刚上线,系统提示词就泄露: 我读了一下这份提示词,有几个点比较关键:第一,Fable 给 Artifact 新增了持久化存储 API(window.storage)。Artifact 就是 Claude 用代码生成的独内容,比如 HTML 页面、React 组件等。以前 Artifact 不能保存数据,更像个一次性 demo。

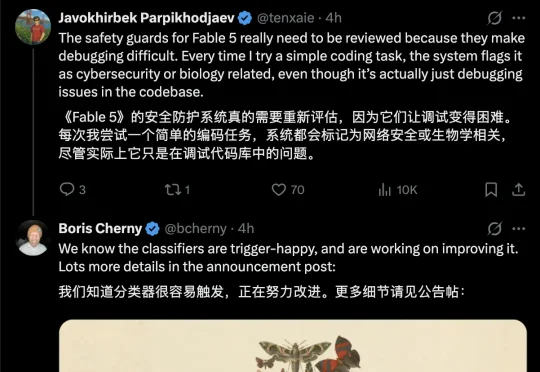

Claude刚刚发布的新模型Fable 5,很多人可能压根就用不上!有不少网友实测发现,Fable 5的安全护栏检测机制的触发几率似乎比官方宣称的不到5%严格得多。无论是普通编码任务。

今天凌晨,大家等了很久的 Claude Fable 5 终于上线了。

刚刚,Anthropic放出藏了俩月的大杀器——Claude Fable 5和Mythos 5,无异于扔下一枚炸弹。

Claude Fable 5 是今天 AI 领域的核心热点,这个「神话级」的模型性能表现非常卓越,吸引了无数眼球。

拆分后,字节仍将控股新公司,AI 制药核心团队、核心算法、技术平台和已有管线资产将整体进入新主体。

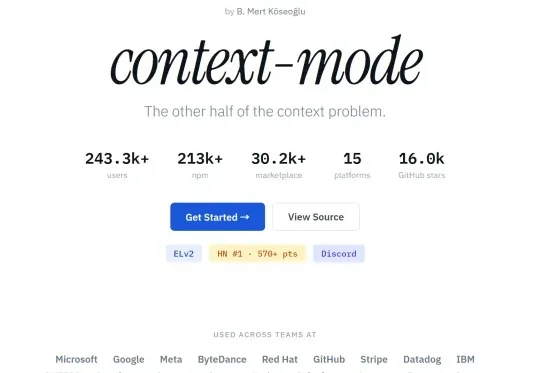

除此之外,context-mode 将大模型的记忆力从30分钟提升至 3 小时。

随着大语言模型逐步进入复杂推理、自动化研究和网络安全等高难度任务,传统的模型评测方式正在面临新的挑战。

AI Agent 正在从 "单兵作战" 走向 "团队协作"—— 让多个 Agent 分工配合,去完成单个 Agent 难以独立扛下来的复杂任务,也是近期最受关注的方向之一。

今天凌晨,Anthropic 发布新模型 Fable 5,毫无疑问的,也是当下的最强模型

世界模型(World Model),正在成为AI领域新的技术高地。从OpenAI的Sora,到图灵奖得主Yann LeCun力推的JEPA体系,再到李飞飞创办的World Labs,全球最顶尖的一批研究者都在试图回答同一个问题:AI究竟如何像人一样理解世界,而不仅仅是生成语言和图像。

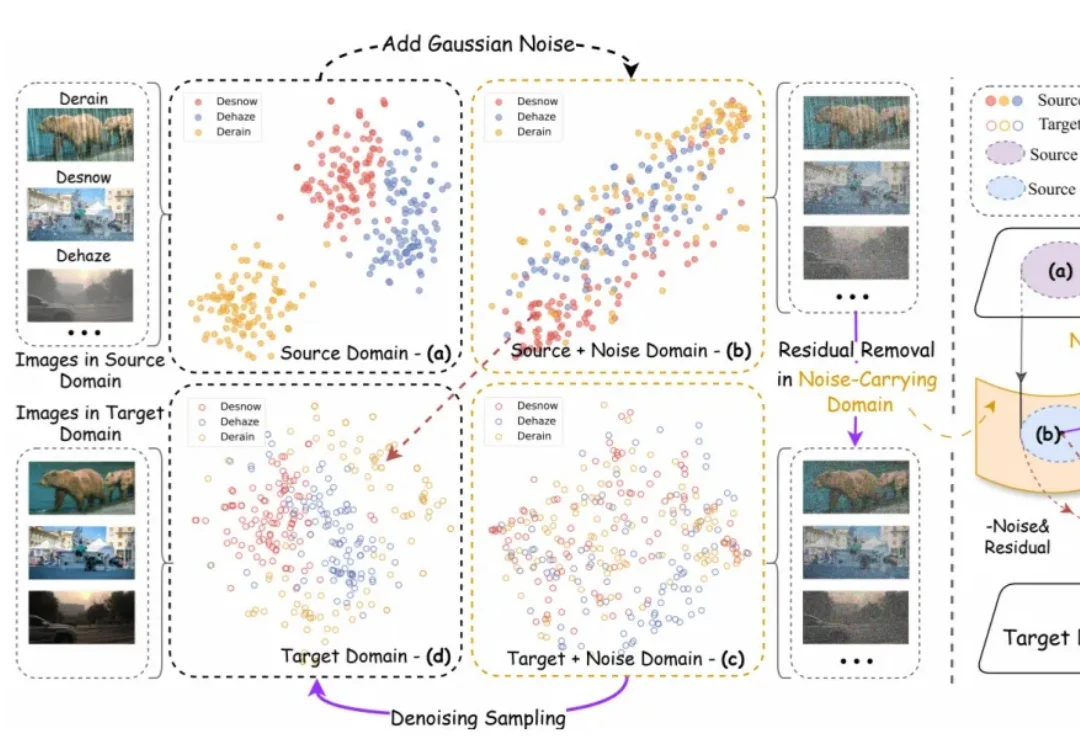

在图像到图像翻译(Image-to-Image Translation, I2I)这个任务上,扩散模型过去几年几乎形成了一套默认逻辑:先把输入图像和噪声混合,再一步步去噪,把目标图像 “还原” 出来。

顶级AI编码一日千里,到了生物学领域却频频翻车,并非模型不够聪明,而是科学数据库至今只为人类点鼠标而生。

对AI效率赛道,葬AI的朋友郭先生有一句名言:「效率赛道一定要做情绪价值,因为你会发现解决实际问题大家都不行。」

具身智能现在面临的问题,和自动驾驶几年前的困境非常相似。

Anthropic深夜突袭放出Claude Fable 5,直接迈入Mythos神话级新段位。

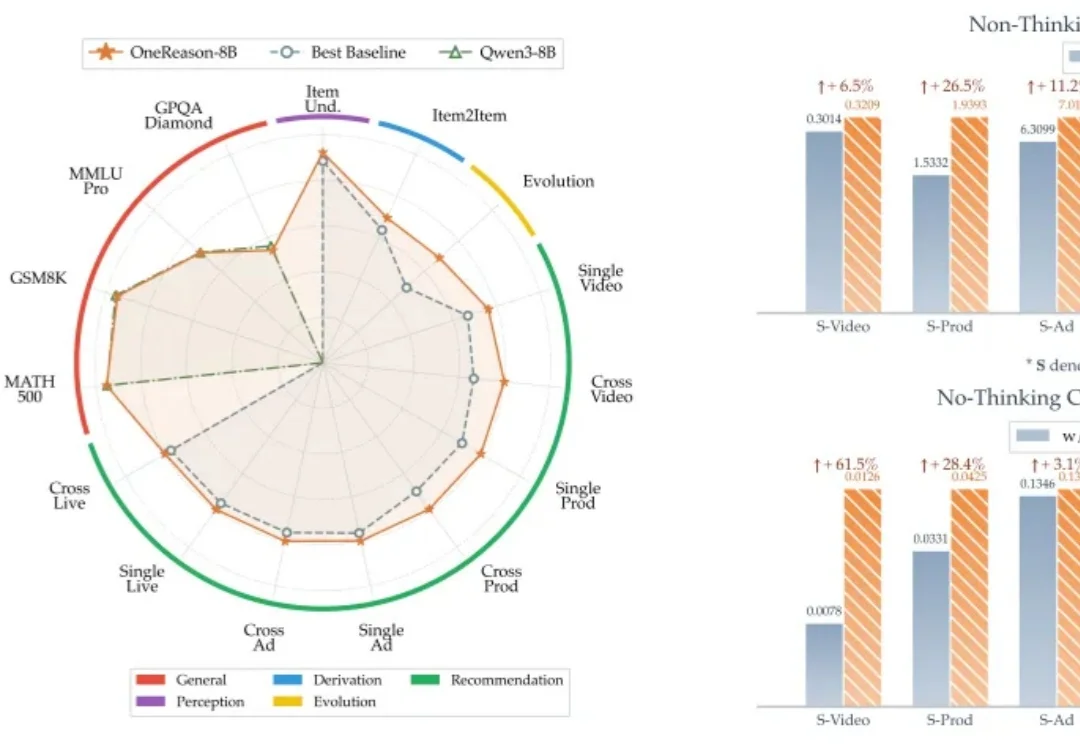

推荐系统的过去十年,本质是把 "用户 - 物料" 的统计共现挖到极致 —— 从协同过滤、深度模型,到生成式 OneRec 系列,每一代都在让 "记忆" 更精细、参数更大、序列更长,也让 Scaling 这件事在工业级推荐系统上跑通,持续释放算力红利。

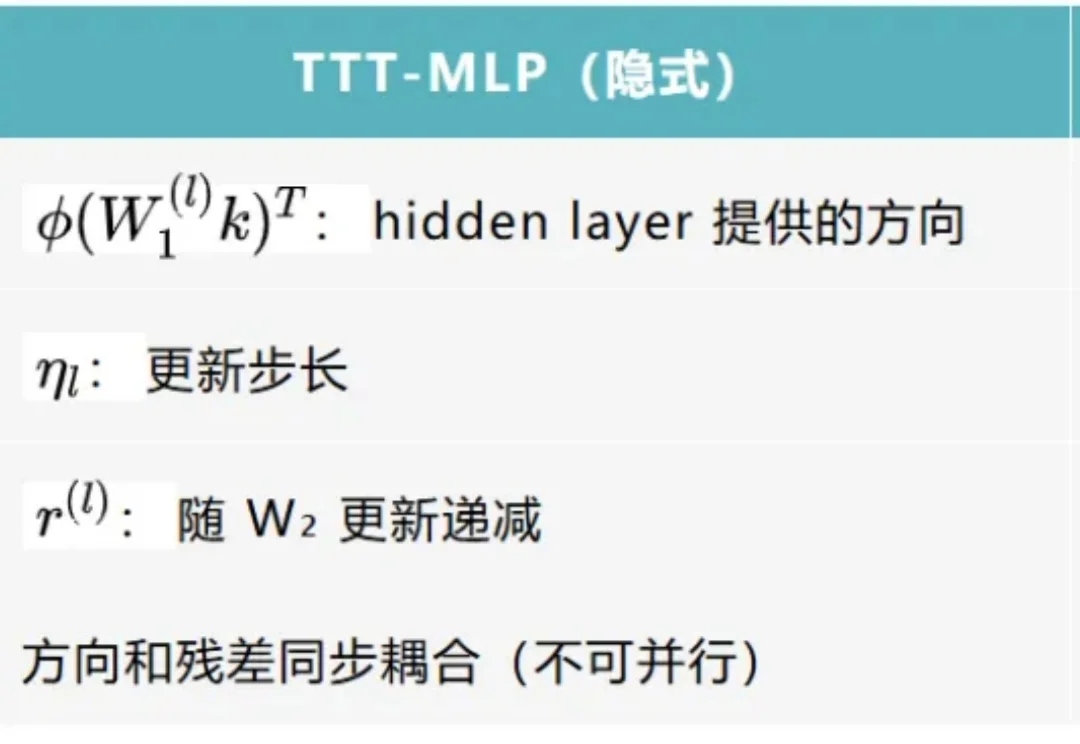

Transformer 依托强大的建模能力和 Scaling 效率在推荐领域被广泛应用于超长序列建模和生成式推荐等方向,

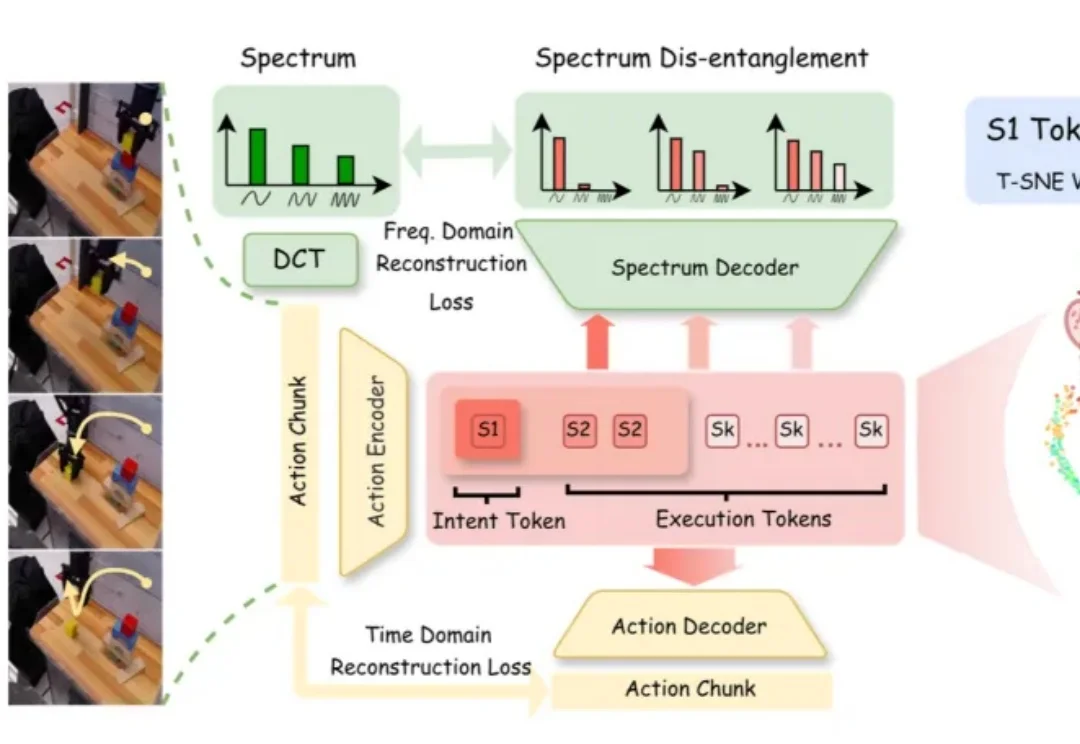

机器人视觉语言动作(Vision-Language-Action, VLA)模型越来越多地开始展示叠衣服、倒茶、做咖啡等复杂操作。但是,今天的大多数 VLA 更像 “展台机器人”。

还在手动在不同工具间来回切换查文献、跑代码、看结果?两个月前发起内侧的科研龙虾SciClaw,经过上万名科研人的「考核」,正式升级为Mira,推出专家小队、科研画布、LLM WIKI 三大核心能力,首次将「Vibe Researching」理念产品化,让研究者像组建实验室团队一样配置 AI,把时间还给真正的科学思考。

对普通人最坏的消息要来了。

世界模型第一次塞进指甲盖芯片!X-Era Lab与星宸科技联手,成本砍掉90%,具身智能终于不靠云端活了。

英伟达买的是企业数据的理解力。

36氪获悉,近日,AI原生生物科技公司百奥几何已完成数亿元战略融资。由上海生物医药创新转化基金、国科投资、达晨财智、星连资本联合领投,高榕资本、指数人工智能产业创新基金跟投。

前几天我们讨论过一个观点:自从2026年Q2起,未来人类所谓的“编程工作”其实比拼的是「谁能一次性把“什么叫完成”定义清楚」

近日,清研精准完成数亿元B2轮融资,由星源资本领投,一汽富晟旗下吉晟资产、某央企产业基金跟投。本轮融资之后,清研精准将推动一次关键转向:以跑通新能源物理智能的闭环为起点,逐步迈向更广阔的工业场景,致力于打造工业物理AI的工程化底座,深度布局具身智能领域。

客户数量不是核心,能为客户解决的问题数量才是核心。

「格物科技」的创始人范典,是当下智能硬件赛道的一个“异类”。