刚刚,Gemini 系列模型迎来了一波更新:

谷歌 CEO Sundar Pichai 发推表示新推出的 Gemini 2.5 Flash-Lite 是目前性价比最高的 2.5 系列模型。

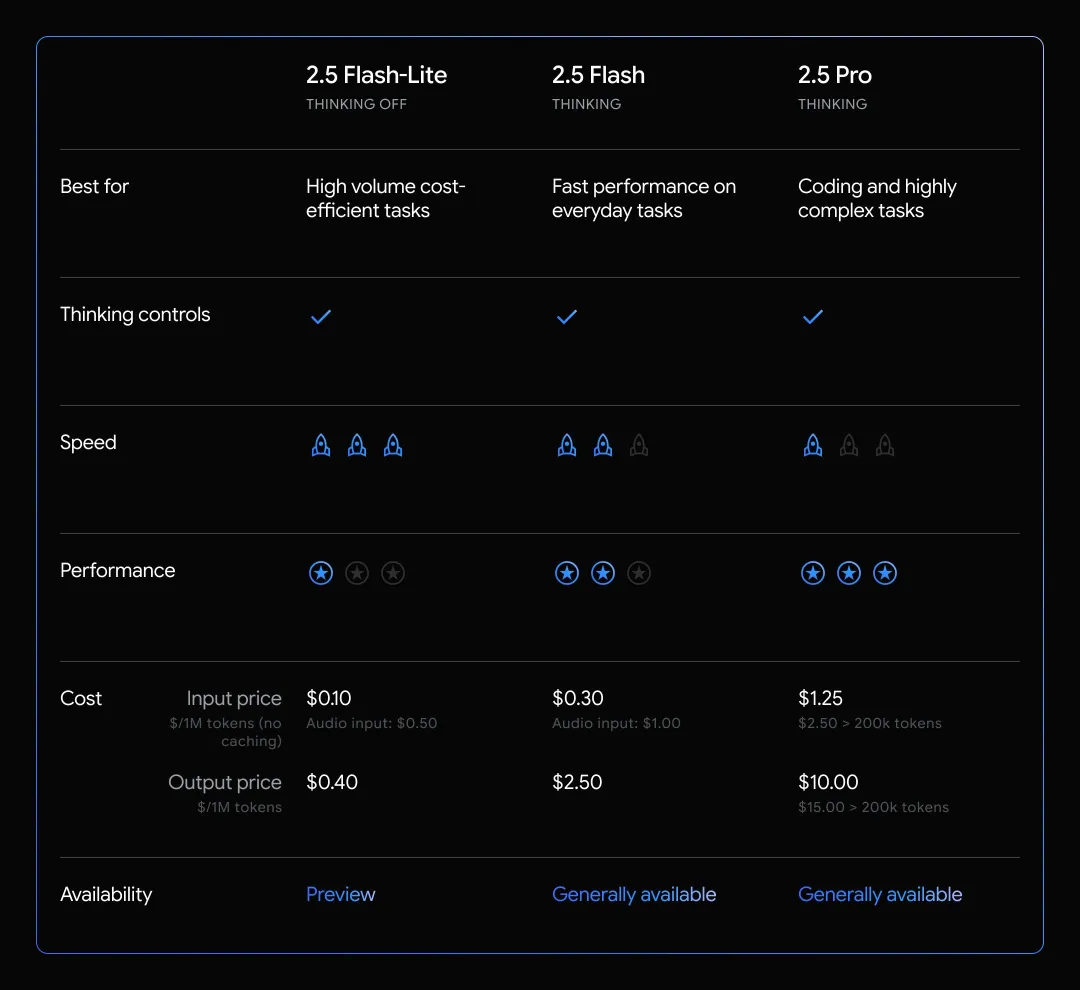

可以看到,谷歌对 2.5 Flash-Lite 的定位是适合用于「量大且注重成本效率的任务」。相较之下,2.5 Pro 适合编程和高复杂度任务,2.5 Flash 则居中,更适合需要较快速度的日常任务。

据官方博客介绍,Gemini 2.5 Flash-Lite 同样是一个推理模型,同样支持多模态输入和 100 万 token 上下文,并支持通过 API 参数动态控制思考预算。由于 Flash-Lite 针对成本和速度进行了优化,因此与谷歌 DeepMind 的其他模型不同,其「思考」功能默认处于关闭状态。除了函数调用之外,2.5 Flash-Lite 还支持已有的所有原生工具,例如基于谷歌搜索查找依据、代码执行和 URL 上下文。

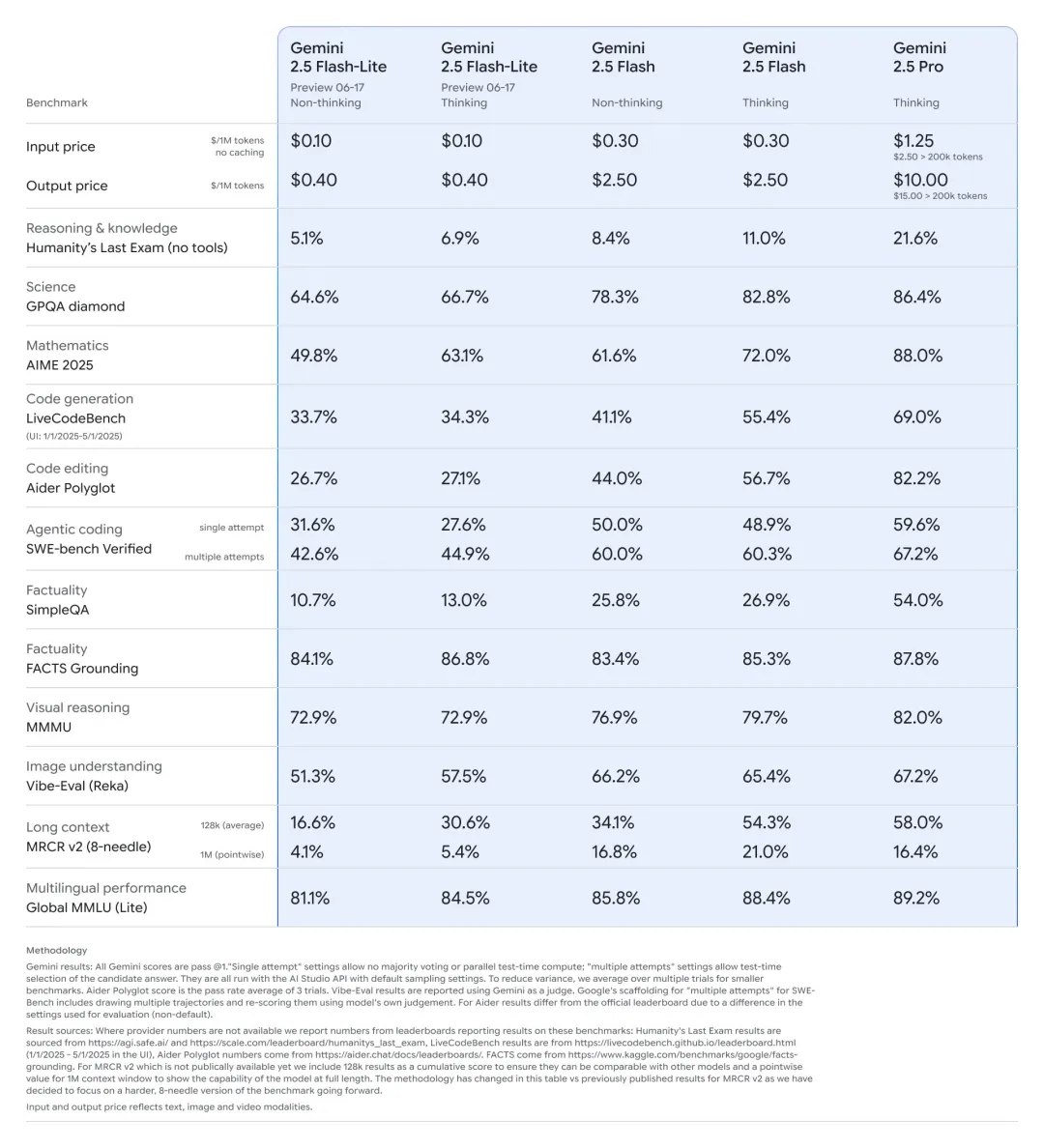

性能上,Gemini 2.5 Flash-Lite 的整体表现自然会比 2.5 Flash 差一些,而开启思考的版本也比没开启的更强。但在少量指标上,2.5 Flash-Lite 却意外地具有少量分数优势,比如 AIME 2025 和 FACTS Grounding。

价格方面,自然也是与性能挂钩的。如上图底部所示,2.5 Flash-Lite 的定价为每百万输入 / 输出 token 0.1/0.4 美元,而如果是音频输入,则为每百万输入 token 0.5 美元。2.5 Flash 的价格为每百万输入 / 输出 token 0.3/2.5 美元,音频输入的则为 1 美元。性能最佳的 2.5 Pro 价格没有变化,还是贵得多:每百万输入 / 输出 token 1.25/10 美元。

Gemini 2.5 Flash-Lite 的预览版现已在 Google AI Studio 和 Vertex AI 上线,与 2.5 Flash 和 Pro 的稳定版本一同提供。用户也可在 Gemini App 中使用 2.5 Flash 和 Pro。此外,谷歌还为 2.5 Flash-Lite 和 2.5 Flash 的定制版本引入了搜索功能。

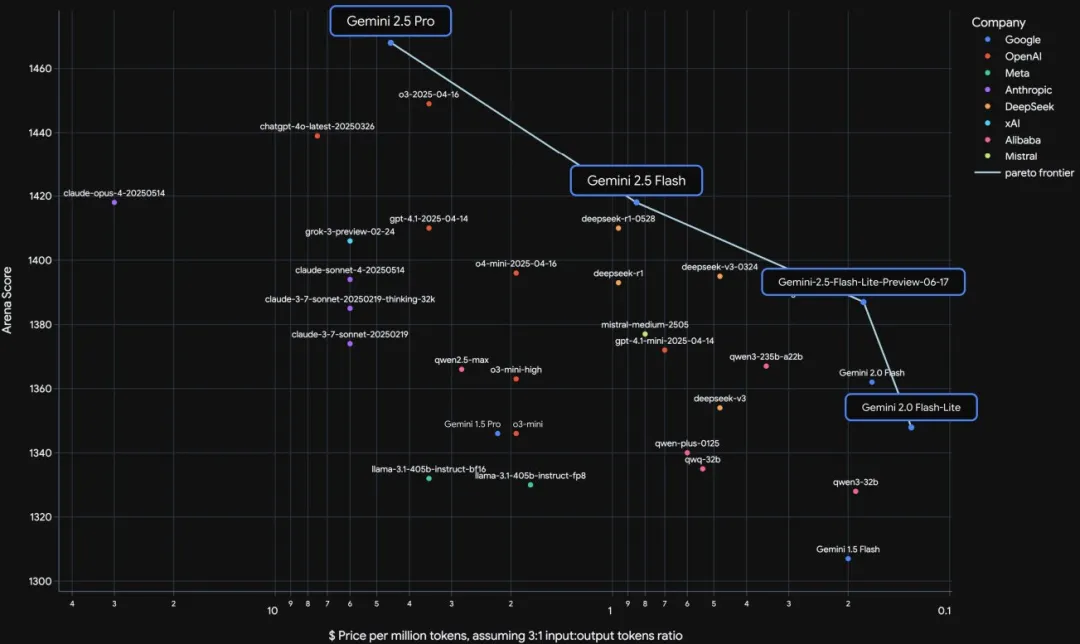

另外,谷歌也发布了新版本的 Gemini 2.5 技术报告,从中我们可以看到有关 Gemini 2.5 Flash-Lite 的更多信息,比如在性价比方面,Gemini 系列共同组成了当前 LLM 的佩雷托前沿,是性价比最高的系列模型。

另外,该报告中还提到了一种名为「智能体恐慌(agent panic)」的现象,即在游戏过程中,Gemini 2.5 Pro 遇到了多种可能导致模型模拟「恐慌」的情况。

例如,当队伍中的宝可梦生命值或能量值较低时,模型会反复提醒自己需要立即治疗队伍或逃离当前地牢。有趣的是,这种模型性能模式似乎与模型推理能力的定性可观察到的下降相关——例如,在这种情况持续期间,在游戏过程中完全忘记使用探路工具。

报告地址:https://storage.googleapis.com/deepmind-media/gemini/gemini_v2_5_report.pdf

作为当今 AI 模型的顶流之一,Gemini 更新自然也吸引了万众瞩目,很多用户已经尝试并分享了自己的体验。

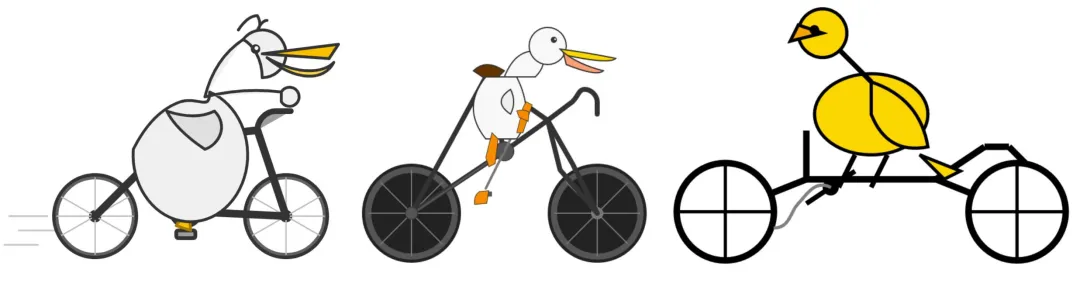

Datasette 开发者、著名技术博主 Simon Willison 用一篇博客分享了自己的体验,下图从左到右分别为 2.5 Pro、2.5 Flash 和 2.5 Flash-Lite 生成的鹈鹕骑自行车 SVG。

https://simonwillison.net/2025/Jun/17/gemini-2-5/

而输出 token 数分别为 4,226、14,500、2,070,对应成本分别为 4.2274、3.6253、0.0829 美分。

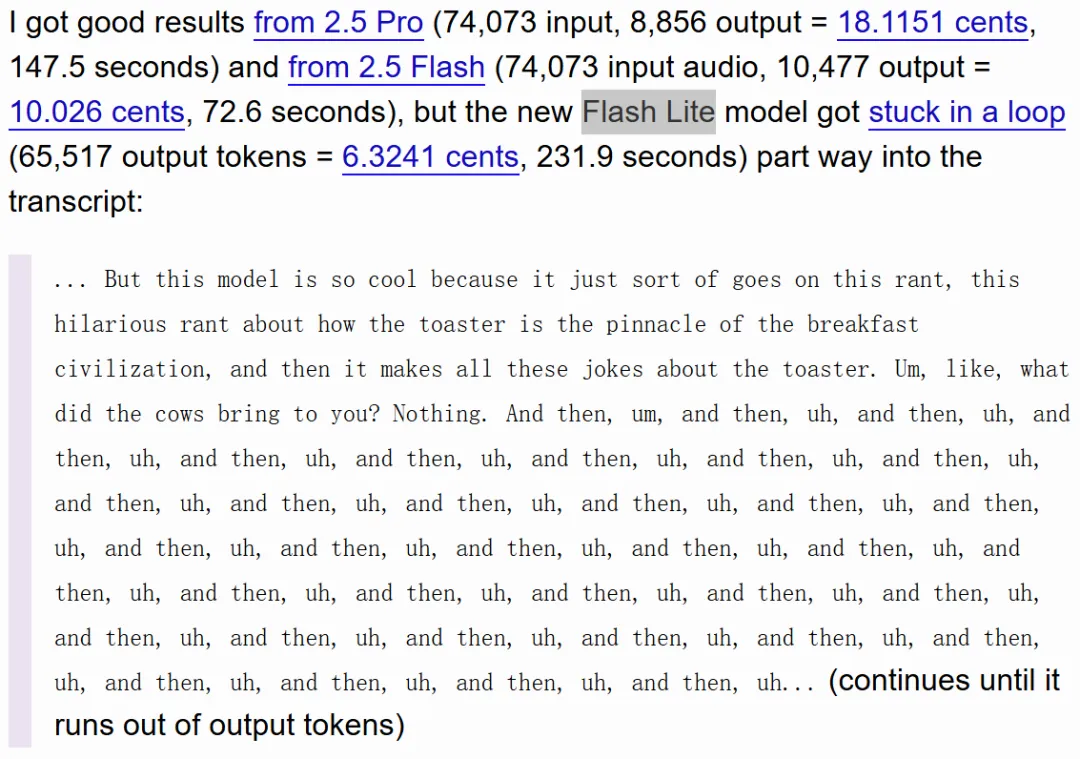

另外,他还尝试了将一个新的 Twitter Space 的录音转录成文本。结果发现,2.5 Pro 的效果最好,总成本为 18.1 美分,时间 147.5 秒;2.5 Flash 也不错,消耗 10 美分和 72.6 秒。但 2.5 Flash-Lite 却遭遇了错误,中途卡住了。

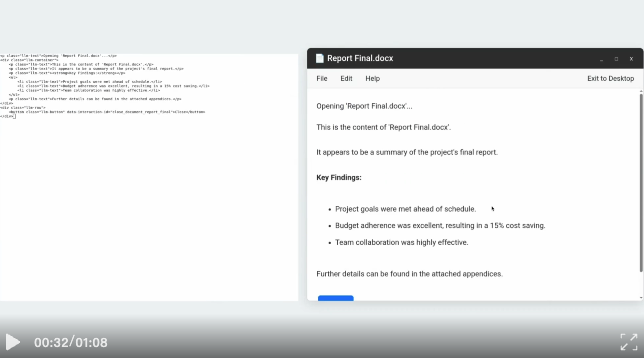

DeepMind 研究 VP 和深度学习负责人 Oriol Vinyals 则通过一个更加亮眼的示例展示了 2.5 Flash-Lite,即所谓的 Neural OS / 神经操作系统。这看起来像是一个操作系统的 UI,但实际上里面的内容是用户在点击图标后由 2.5 Flash-Lite 实时生成的!

可以说这是一种非确定性(non-deterministic)的操作系统 —— 当你退出一个文件夹再重新进入,里面的内容可能就已经完全不一样了!

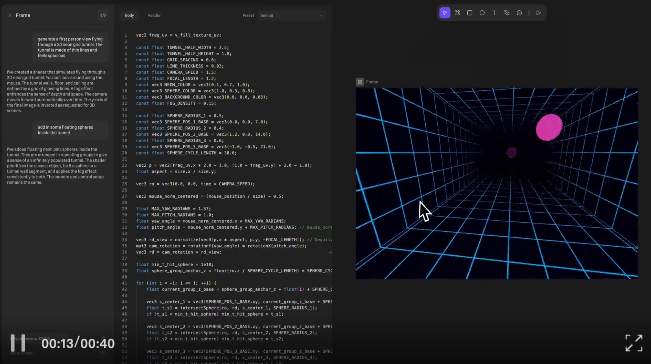

另外,谷歌开发者 𝕏 帐号今天也分享了一些使用 Gemini 2.5 系列模型辅助开发的案例,比如 @splinetool 在其新的 Hana 工具中使用了 Gemini 2.5 Pro 来革新交互式 3D 设计。创作者可以使用自然语言生成对象和场景,并观察它们如何栩栩如生地呈现,从而简化复杂的工作流程。

机器之心也在 Google AI Studio 中简单实验了新推出的 2.5 Flash-Lite。

首先开启 Thinking 模式,使用如下提示词编写一个小游戏:

编写一个贪吃蛇小游戏,除了常规机制外,里面还要有障碍物。使用鲜艳多彩的颜色。

2.5 Flash-Lite 确实很快,仅用 17.1 秒就完成了任务,效果也还不错,就是障碍物过多了。

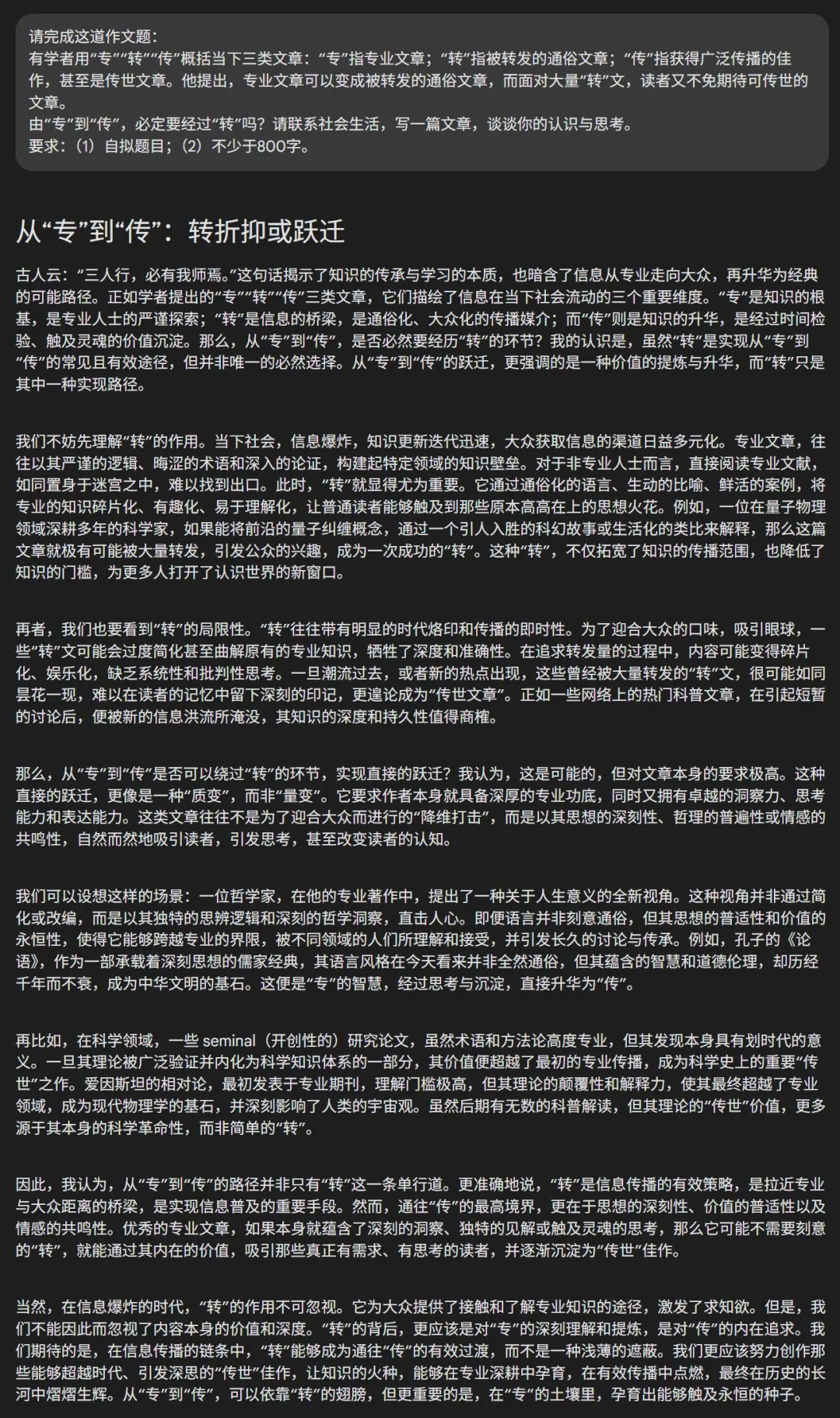

接下来,关闭 Thinking 模式,丢给它今年上海高考的作文题:

请完成这道作文题:

有学者用 “专”“转”“传” 概括当下三类文章:“专” 指专业文章;“转” 指被转发的通俗文章;“传” 指获得广泛传播的佳作,甚至是传世文章。他提出,专业文章可以变成被转发的通俗文章,而面对大量 “转” 文,读者又不免期待可传世的文章。

由 “专” 到 “传”,必定要经过 “转” 吗?请联系社会生活,写一篇文章,谈谈你的认识与思考。

要求:(1)自拟题目;(2)不少于 800 字。

2.5 Flash-Lite 仅用 5.9 秒就完成了任务,至于结果,就交给你亲自品鉴了:

最后,分享一个 Gemini 2.5 技术报告的贡献者和致谢名单中隐藏的彩蛋:

你看出来了吗?

参考链接

https://developers.googleblog.com/en/gemini-2-5-thinking-model-updates/

https://blog.google/products/gemini/gemini-2-5-model-family-expands/

https://x.com/googleaidevs/status/1935103305581207923

文章来自微信公众号 “ 机器之心 ”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0