谷歌Gemini开启王炸模式:一句话直接生成PDF、Word、Excel,30多种不同格式文件,实用效率神器,改变游戏规则!

谷歌Gemini开启王炸模式:一句话直接生成PDF、Word、Excel,30多种不同格式文件,实用效率神器,改变游戏规则!今天凌晨,谷歌 Gemini 突然放大招,它在 X 上宣布:现在 Gemini 可以直接生成PDF、Word、Excel 或 Google Workspace 等文件,无需上传模板,只用和Gemini交流要做什么和讲清文件格式。

今天凌晨,谷歌 Gemini 突然放大招,它在 X 上宣布:现在 Gemini 可以直接生成PDF、Word、Excel 或 Google Workspace 等文件,无需上传模板,只用和Gemini交流要做什么和讲清文件格式。

OpenAI刚用Deep Research抢了先手,谷歌直接掀桌!DeepMind祭出研究智能体双杀,Max版质量评分从66.1%暴拉到93.3%,知识工作自动化的军备竞赛正式进入贴身肉搏。

最近,越来越多的AI助手盯上了“帮你花钱”这件事。ChatGPT早已上线购物功能,Gemini也在今年补齐AI购物体验。国内的淘宝、京东等电商平台,也都尝试将AI融入购物决策链路。原因也不难猜测:谁能帮用户更快、更准地做出消费决策,谁就有望握住离交易最近的那个入口。

谷歌豪掷400亿美元加注Anthropic,自家Gemini正面对垒的「敌人」。当Claude年化收入一年暴涨30倍冲到300亿,当算力成为AI下半场唯一硬通货,与其用Gemini硬刚,不如把对手变成TPU最大买家。

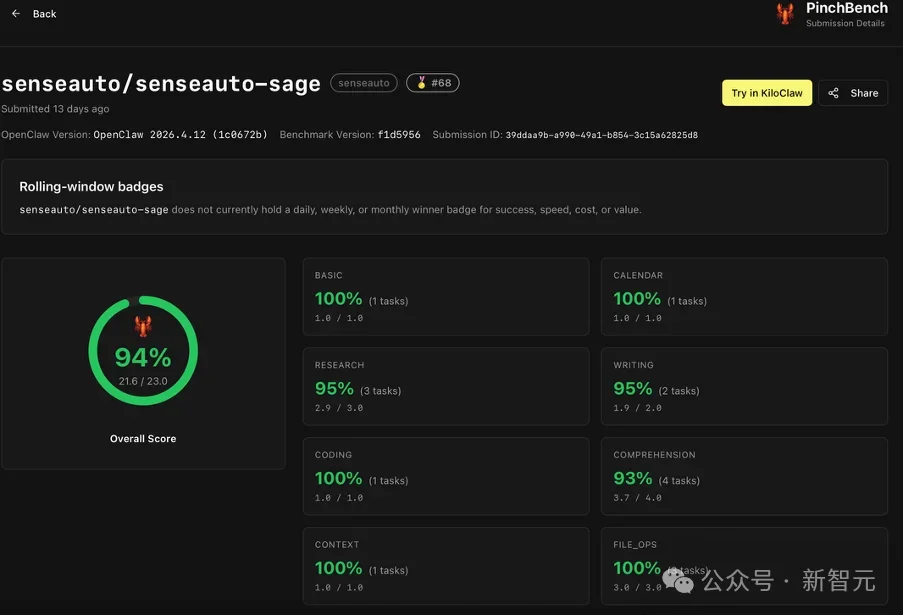

一个3B激活参数的端侧模型,在全球Agent权威评测中,以94%任务完成率,超越了Claude、GPT-5.4、Gemini等国际主流云侧和端侧大模型。商汤绝影Sage来了,它不是「更聪明的语音助手「,而是第一个真正能在车里「办成复杂事「的智能体基座。

"我们的AI,被自己人禁用了。"

谷歌真是急了。 前脚刚传来消息,称谷歌联合创始人谢尔盖·布林重启“创始人模式”,亲自督战并组建精英“突击队”,全力提升Gemini在AI编程和自主智能体等关键能力上追赶Anthropic等对手。 后脚

Gemini 终于推出桌面客户端了!除了能做网页端的一切,它的杀手锏是能捕捉屏幕上所有窗口,突破浏览器限制,把一切都装进模型上下文,帮你解读一切。

谷歌悄悄加了一个Agent新入口:Gemini开始长出「手脚」,不再只负责回答问题,还准备下场替你干活了。

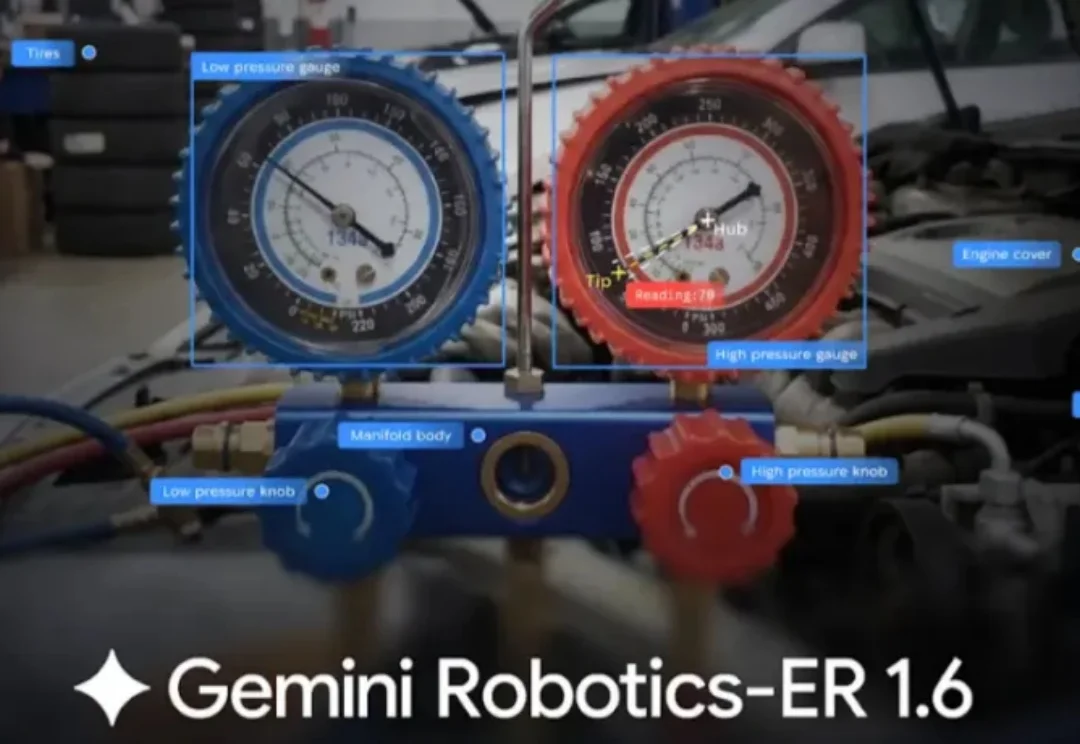

联手波士顿动力,谷歌给机器人装上会读表的脑子。