现在的AI Agent在文档生成PPT或视频方面,要想像人一样,把文字、图片、讲解、音视频全都串起来讲清楚,还真不太行。

来自澳大利亚人工智能研究所、利物浦大学、拉筹伯大学的团队联合提出PresentAgent,一个多模态智能体,旨在自动将结构化或非结构化文档转化为配有语音讲解和同步幻灯片的视频演示,实现一个完整集成的视频体验,模拟人类演讲者的信息传递方式。

打工人福音啊。

它能够生成高度同步的视觉内容和语音解说,逼真模拟人类风格的演示,比如商业报告、技术手册、政策简报或学术论文等。

团队在测试集上进行了验证,结果表明,PresentAgent在所有评估指标上接近人类水平的表现。

将长篇文档(如商业报告、技术手册、政策简报或学术论文)制作成高质量演示视频通常需要耗费大量人工精力。

这个过程涉及内容筛选、幻灯片设计、讲稿撰写、语音录制,以及将所有内容整合成一个连贯的多模态输出。

该任务的挑战远超传统的摘要或文本转语音系统,因为它需要:

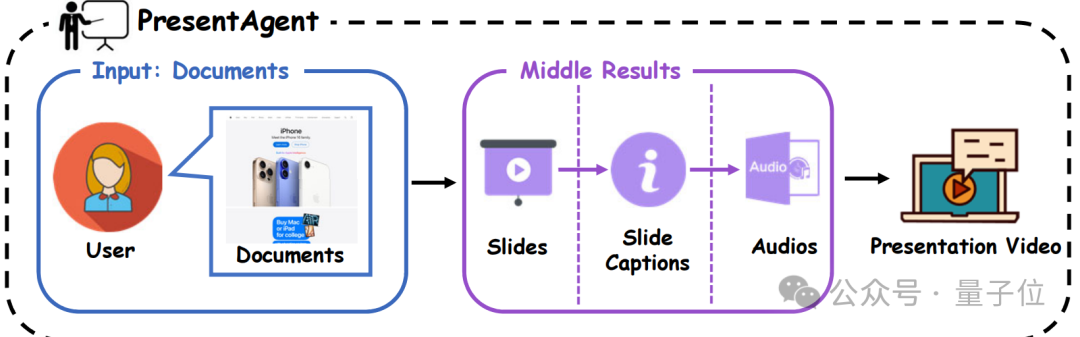

为应对上述挑战,团队提出了一个模块化生成框架——PresentAgent,如图1所示。

其流程包括:1、将输入文档语义分块(通过大纲规划);2、为每个语义块生成具有布局指导的幻灯片视觉内容;3、将关键信息重写为口语化解说文本;4、语音合成后,与幻灯片进行时间同步,最终生成一个结构良好、讲解清晰的视频演示。

△图1:PresentAgent概览

该系统以文档(如网页)为输入,经过以下生成流程:(1)文档处理(2)结构化幻灯片生成(3)同步字幕创建(4)语音合成。

最终输出为一个结合幻灯片和同步讲解的演示视频。图1中紫色高亮部分表示生成过程中的关键中间输出。

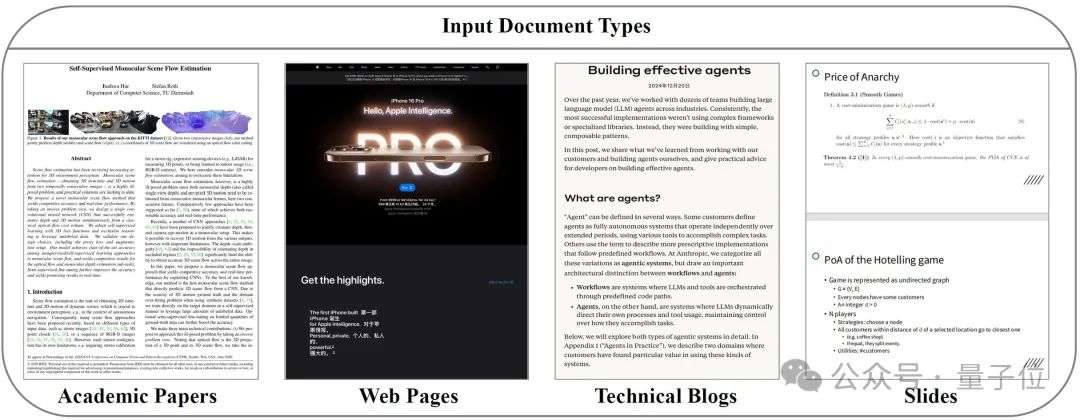

输入端的文档形式如图2所示,展示了评估基准中的文档多样性。

△图1:PresentAgent概览

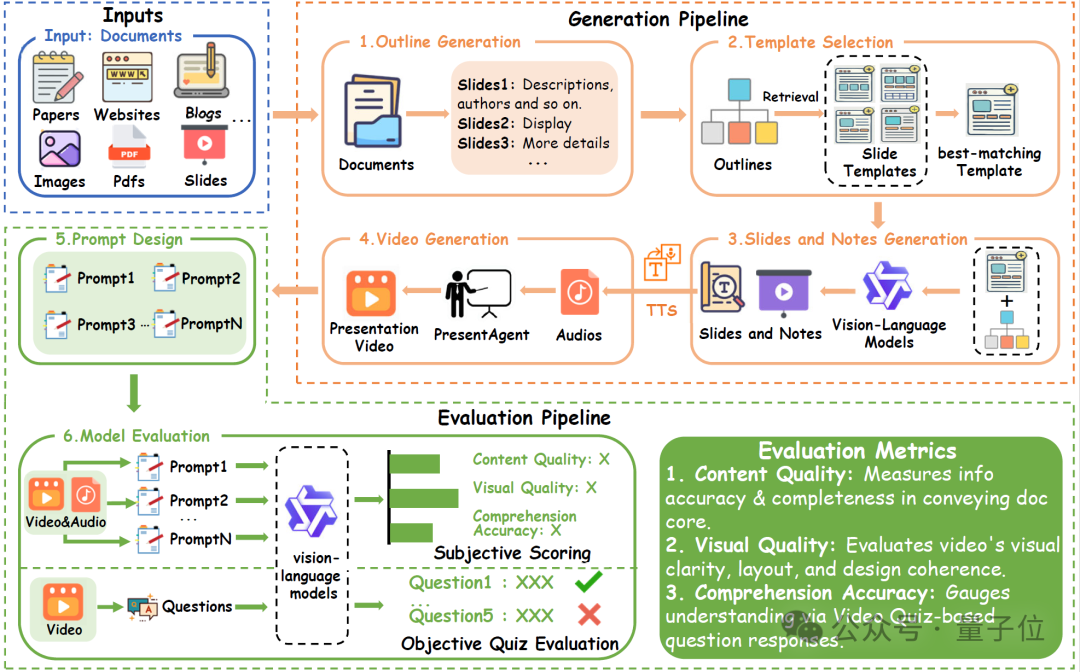

如图3所示,左侧给定多样的输入文档,如论文、网站、博客、幻灯片或PDF,PresentAgent能生成带讲解的演示视频,输出为同步的幻灯片和音频。

图3右侧,团队设计了PresentEval,一个双路径的评估框架:

客观测验评估(上),通过Qwen-VL进行事实理解检测;

主观打分评估(下),借助视觉-语言模型从内容质量、视觉设计与语音理解等维度进行评分。

△图1:PresentAgent概览

值得一提的是,整个流程具有可控性和领域适应性,适用于多种文档类型和演示风格。

为有效评估此类复杂多模态系统,团队整理了一个涵盖教育、金融、政策与科研等多个领域的30组人工制作的“文档-演示视频对”的测试集。

同时,我们设计了一个双路径评估策略:一方面使用固定选择题测试内容理解;另一方面通过视觉语言模型打分,评估视频的内容质量、视觉呈现与观众理解程度。

考虑到这种多模态输出的评估难度,团队引入了PresentEval,一个由视觉-语言模型驱动的统一评估框架,从以下三个关键维度全面打分:内容忠实度(Content Fidelity)、视觉清晰度(Visual Clarity)、观众理解度(Audience Comprehension)。

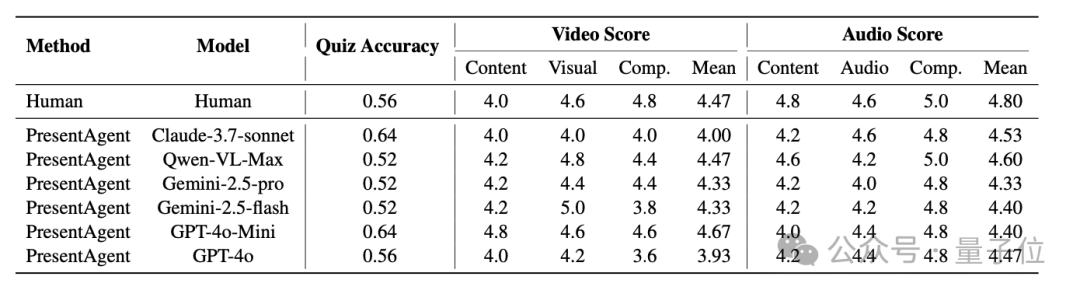

评估采用基于提示的方式进行。团队在一个精心整理的包含30对“文档-演示”样本的数据集上进行了实验验证,如下图所示。结果表明,PresentAgent在所有评估指标上接近人类水平的表现。

这些结果展示了可控多模态智能体在将静态文本材料转化为动态、有效、易获取的演示格式方面的巨大潜力。

这表明将语言模型、视觉布局生成与多模态合成结合,能够实现可解释、可扩展的自动演示生成系统。

论文链接:

https://arxiv.org/pdf/2507.04036

代码仓库:

https://github.com/AIGeeksGroup/PresentAgent

文章来自于微信公众号“量子位”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md