是时候为传统微调献上挽歌了。

一项全新研究,刚刚又给微调致命一击。

来自斯坦福大学、SambaNova Systems公司和加州大学伯克利分校的研究人员,在新论文中证明:

依靠上下文工程,无需调整任何权重,模型也能不断变聪明。

他们提出的方法名为智能体上下文工程ACE。

ACE不依赖模型重新训练,而是让上下文自主进化,通过反复生成、反思并编辑自己的提示,直至成为一个自我完善的系统。

在智能体和特定领域的基准测试中,ACE能同时优化离线上下文(如system prompt)和在线上下文(如agent memory),并稳定优于强力基线模型。

下面具体来看。

现在很多AI应用(比如自动处理财务数据的工具、能调用APP的智能助手)都靠 “上下文适配” 来提升能力。

简单来说,就是不给模型改底层参数,而是在输入里加指令、策略或证据,但老方法有两个大问题:

简洁偏置

为了让输入简短,把关键细节丢了。比如只说 “处理财务数据”,却没说 “要按XBRL格式核对数值”,导致模型犯错。

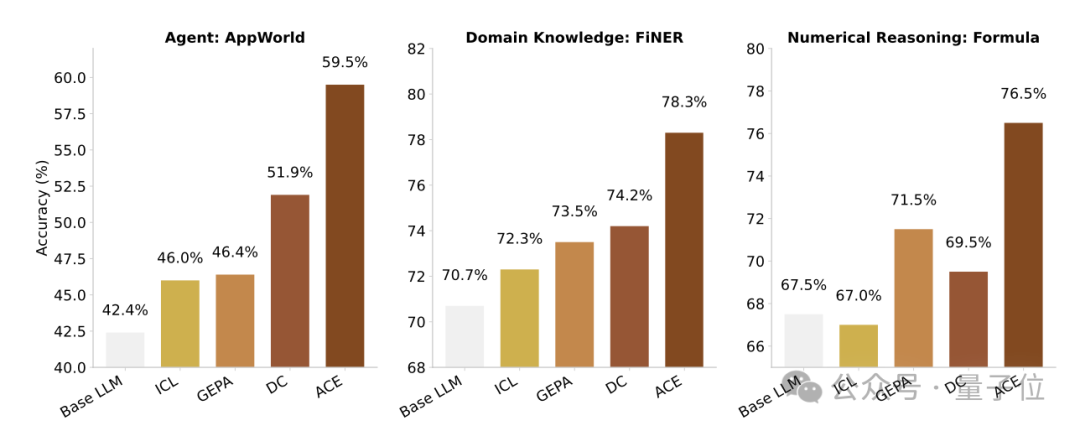

上下文崩溃

反复修改输入时,模型会把之前积累的有用信息越改越短、越改越没用。比如原本有1.8万个token的实用策略,准确率为66.7,改一次就剩122个token,效果却下降到57.1。

ACE就是为了解决这两个问题来的,与将知识压缩为简短摘要或静态指令的方法不同,它将上下文视为不断演化的操作手册,能够随时间不断累积、优化并组织策略。

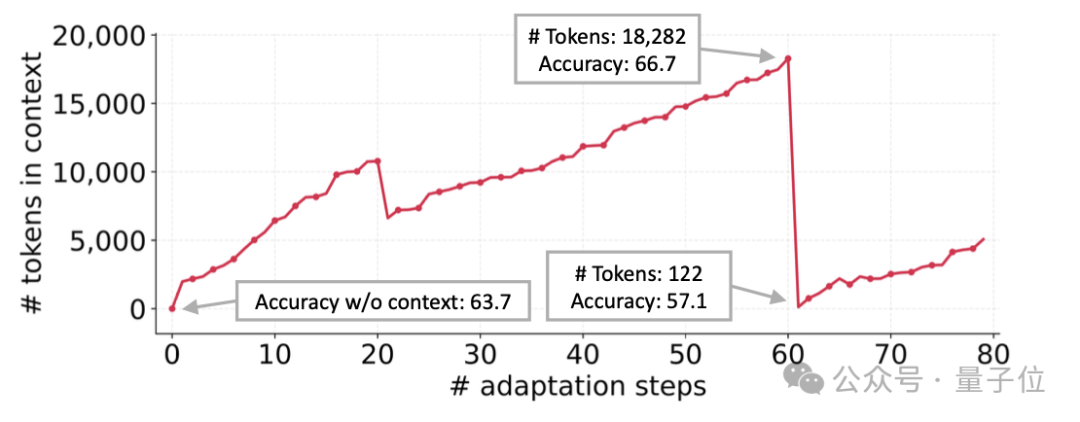

基于Dynamic Cheatsheet的智能体设计,ACE把模型的 “上下文优化” 拆成分工明确的三个角色。

如上图所示,工作流程首先由生成器针对新查询生成推理轨迹,这些轨迹既能呈现有效策略,也会暴露常见错误。

随后,反思器对这些轨迹进行评析,从中提炼出经验教训,并可选择通过多轮迭代加以优化。

接着,整理器将这些经验合成为简洁的增量条目,再经由轻量级的非LLM逻辑,以确定性的方式将其合并至现有上下文中。

由于更新内容被逐项分解并局部化,多个增量得以并行合并,从而实现大规模的批量适应。

此外,ACE还支持多轮次适应机制,即对同一组查询进行反复学习,逐步强化上下文质量。

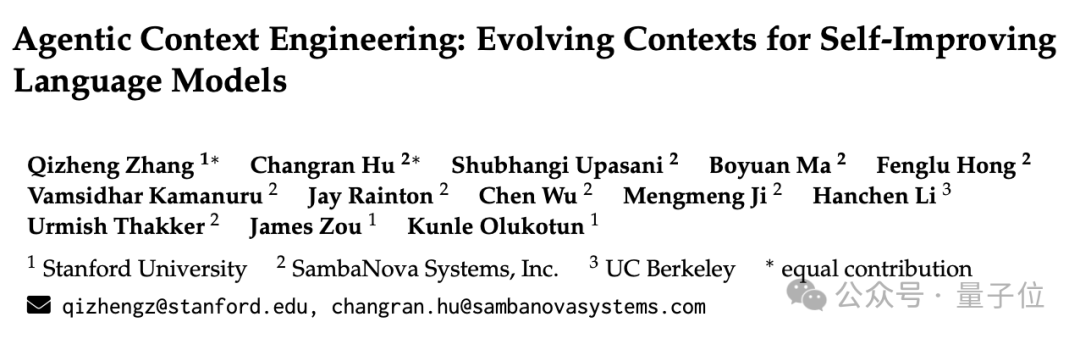

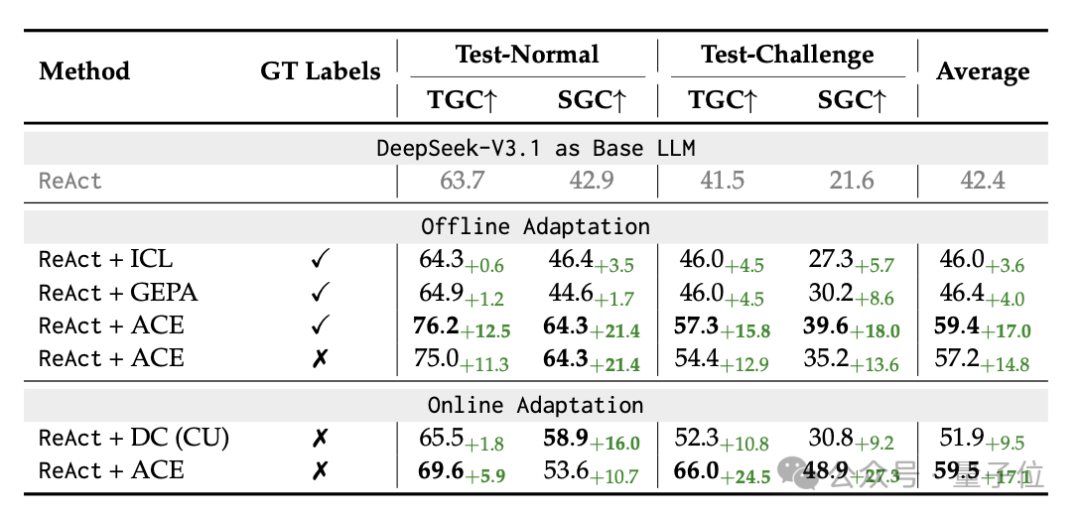

实验结果表明,在智能体和财务分析两大场景中,ACE稳定优于Base LLM(无适配)、ICL(少样本演示)、GEPA(主流prompt优化)、Dynamic Cheatsheet(动态备忘单)等方法。

在智能体测试中,研究团队采用的是AppWorld,它是一套自主智能体任务集合,涵盖API理解、代码生成和环境交互。

结果显示,ReAct+ACE相比ReAct+ICL和ReAct+GEPA分别领先12.3%和11.9%,优势显著。这表明,与固定的演示示例或单一优化指令提示相比,结构化、可演进且精细化的上下文能够更有效地促进智能体学习。

这一优势在在线场景中同样得以延续:ACE平均以7.6%的性能提升领先于Dynamic Cheatsheet等现有自适应方法。

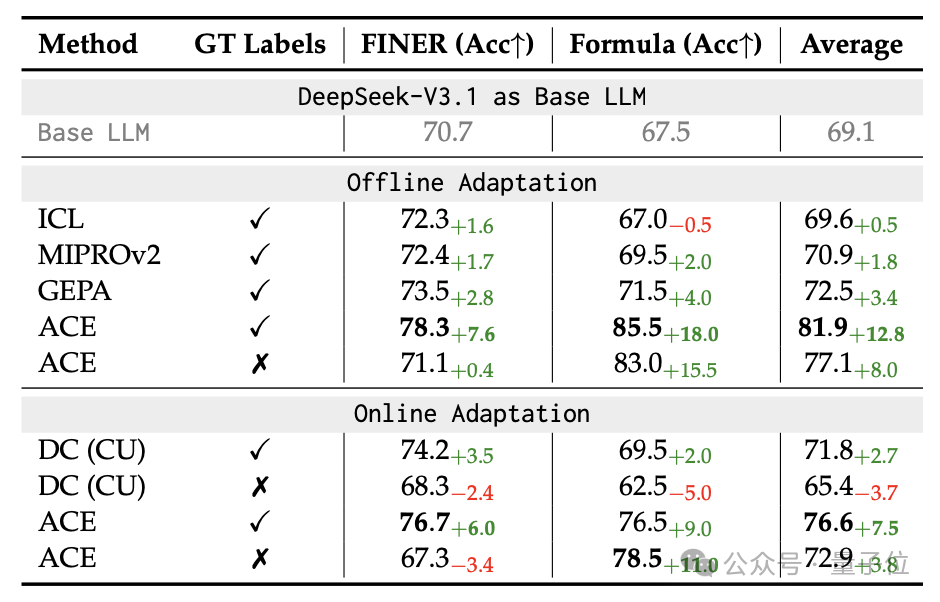

在财务分析中,研究者选用FiNER和Formula来测评模型的金融推理能力,其任务依赖可扩展商业报告语言(XBRL)。

在离线环境下,当模型获得训练集中的真实答案作为输入时,ACE以平均10.9%的优势明显超越了ICL、MIPROv2和GEPA。

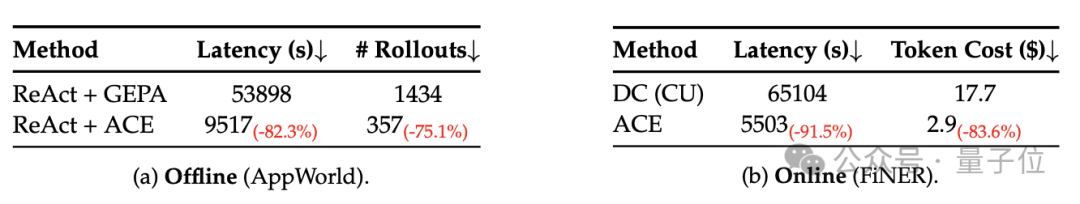

此外,ACE在降低自适应成本(如尝试次数和token输入/生成的费用)与延迟方面展现出显著优势。

具体而言,在AppWorld的离线自适应任务中,与GEPA相比,ACE将自适应延迟降低了82.3%,并将尝试次数减少了75.1%。

在FiNER的在线自适应场景中,与DC相比,ACE实现了91.5%的自适应延迟降低,并在token输入与生成的相关费用上节省了83.6%。

这项研究的两位一作都是华人。

Qizheng Zhang,斯坦福大学计算机科学系四年级博士生。此前在芝加哥大学获得了数学、计算机科学和统计学三个专业的学士学位。

本科期间,他就与Junchen Jiang和Ravi Netravali两位教授合作开展计算机网络研究,专注于面向视频流与分析的网络系统设计。

此外,他还在美国阿贡国家实验室数学与计算机科学部(MCS)和微软研究院实习过。

Changran Hu,本科毕业于清华大学,硕士毕业于加州大学伯克利分校。

20岁时,他就成为了一家AI音乐生成公司DeepMusic的联合创始人,成功获得来自中国顶级企业的1000万美元投资,并与多位中国流行歌手(如周杰伦、李健)建立合作。

随后,他以应用科学家实习生的身份加入微软,并于2021年成为Sambanova Systems研究工程师,随后晋升为技术主管兼经理,主要负责模型后训练与智能体AI相关研发工作。

参考链接:

[1]https://x.com/rryssf_/status/1976269613072843063

[2]http://arxiv.org/abs/2510.04618

[3]https://openreview.net/profile?id=~Qizheng_Zhang1

[4]https://www.linkedin.com/in/changran-hu/

文章来自于微信公众号 “量子位”,作者 “量子位”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】suno-api是一个使用监听技术实现了调用suno功能,并封装好API的AI音乐项目。

项目地址:https://github.com/gcui-art/suno-api

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0