刚刚,这个开源的VLA一站式平台,不仅让UR5e真机实现了100%成功率,还在五大仿真环境中全面领先,最高性能提升高达46%,而且还支持RTX 4090训练!

现在的机器人是真的有点「卷啊」!

随手搜了下,全球的机器人「型号」也太多了吧。

全球具身智能领域的机器人型号和形态,也已经远远不止图中这些。

但不管机器人怎么设计,当下具身智能的核心能力都是视觉—语言—动作(VLA,Vision-Language-Action)模型。

可以说,VLA是具身智能的关键一步。

但是VLA技术发展迅猛的同时,却面临诸多的挑战。

比如,VLA技术分散化严重,有太多框架和模型可选;研发流程繁琐,算法对比评测耗时耗力,并且欠缺公平性;VLA研发无法快速使用最新VLM进行迭代等等。

目前国内外的解决方案,更多是在数据层、模型层和仿真层各自进行统一化尝试,比如:

最近,由Dexmal 原力灵机重磅开源的Dexbotic,则构建了一个「VLA统一平台」。

Dexbotic作为具身智能VLA模型一站式科研服务平台,可以为VLA科研提供基础设施,加速研究效率。

官网:

https://dexbotic.com/

Paper:

https://dexbotic.com/dexbotic_tech_report.pdf

GitHub:

https://github.com/Dexmal/dexbotic

Hugging Face:

https://huggingface.co/collections/Dexmal/dexbotic-68f20493f6808a776bfc9fc4

可以说,Dexboitic是迈向具身智能的关键一步!

Dexbotic是一个基于PyTorch的开源VLA代码库。

Dexbotic的开源,旨在为VLA研究领域提供一个一站式的开源工具箱。

Dexbotic整体架构图

Dexbotic的核心目标是把「视觉-语言模型(VLM)」与各类动作专家(Action Expert, AE)策略统一到一个模块化框架里,并提供更强的预训练模型与实验脚手架。

而且,可以在同一套环境下快速复现与对比Pi0、OpenVLA-OFT、CogACT、MemoryVLA等主流VLA策略。

在仿真器上,Dexbotic的预训练模型实现了巨大增益。

在5个仿真平台上的,Dexbotic都取得了不错的结果。

· SimplerEnv

SimplerEnv旨在缩小仿真环境与真实世界之间的差距。

Dexbotic主要测试了WidowX机器人仅使用视觉匹配套件的情况,包含四项任务:

将勺子放在毛巾上、将胡萝卜放在盘子上、堆叠立方体以及将茄子放入黄色篮子中。

SimplerEnv的结果表明,Dexbotic极大提升了操控任务的稳定性与泛化性。

Dexbotic版本(DB-*)在所有任务上显著优于原始模型,在平均准确率上:

· CALVIN

CALVIN专注于长周期语言条件机器人操作任务。

Dexbotic的预训练使模型在长期依赖任务中表现更稳健、泛化更强。

Dexbotic版本在CALVIN的长时序任务中同样优于原版;

DB-CogACT平均任务长度从3.25→4.06,说明更好地完成多指令串行任务;

同时,DB-OFT也在所有指标上略有提升。

· ManiSkill2

ManiSkill2主要聚焦基础抓取放置操作,检验模型的3D感知与空间推理能力。

在五项代表性任务上评估实验结果:

Dexbotic版本(DB-*)在所有任务上显著优于原始模型:

· RoboTwin2.0

RoboTwin2.0是新推出的仿真基准测试平台。

它改进了仿真到现实的转换,包含50项双臂任务和五种机器人实体。

Dexbotic基于四项精心挑选的任务进行比较:调整瓶子位置、抓取滚筒、放置空杯子和摆放手机支架。

Dexbotic版本在所有任务上提升显著;

特别是在「放置空杯子」任务中提升接近3倍(11%到30%);

· LIBERO

LIBERO包含五个任务套件:

当前,最先进VLA在该基准上的性能已接近饱和。

通过应用Dexbotic预训练模型,CogACT和MemoryVLA等策略均能获得额外性能提升。

相较于CogACT基线,DB-CogACT在四项任务套件中的平均成功率提高了1.3个百分点。

不管是排序、寻找还是分类,Dexbotic的表现都堪称完美。

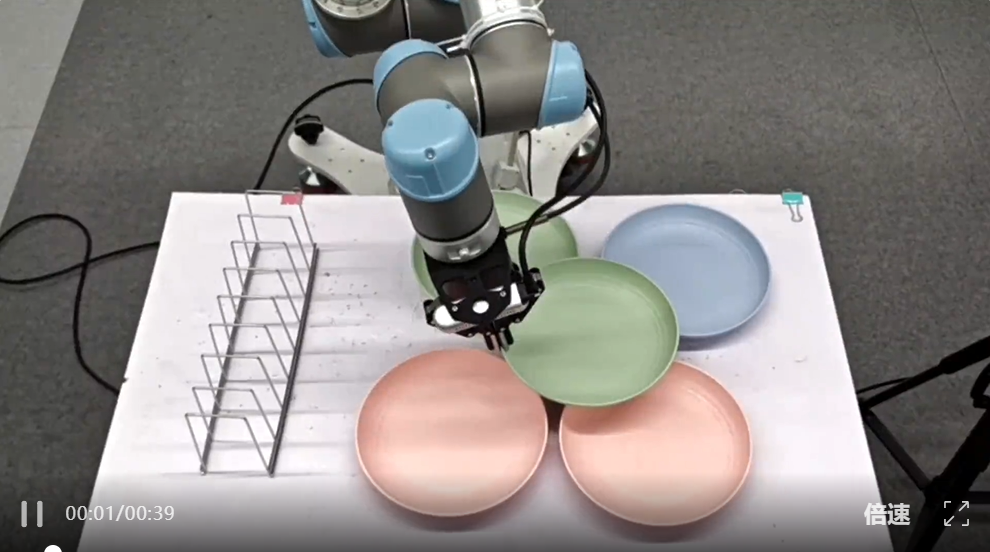

相比仿真,真机效果更能说明模型的能力。

真实场景实验表明Dexbotic能完成多种日常任务。

值得关注的是,在摆放盘子和搜寻绿盒任务中分别实现了100%和80%的成功率。

下面视频展示了100%成功率的UR5e叠盘子。

以及使用ARX 5来选找绿色方块。

对于「撕碎废纸」和「将薯条倒入盘子」这类操作任务,现有VLA策略确实面临挑战。

真机测试中,Dexbotic验证了,如MemoryVLA等前沿VLA策略能够解决「按顺序按下按钮」这类长周期且需记忆的任务(60%成功率)。

具身智能的研究发展离不开开源硬件的支撑。

有鉴于此,Dexmal原力灵机也推出了其首款开源硬件产品——Dexbotic Open Source-W1(DOS-W1)。

DOS-W1采用完全开源的硬件设计,即将开源所有的文档、BOM、设计图纸、组装方案、相关代码;采用大量的快拆结构与可替换模块,这极大地降低了机器人的使用门槛、改造便利性和维护便利性;同时,其符合人体工学的抗疲劳设计,有效提升了操作人员的舒适度与数据采集效率。

据悉,Dexmal原力灵机也将与各产业伙伴一起,持续丰富Dexbotic Open Source系列,以开源硬件助力具身智能前沿研究,加速机器人技术在真实物理世界的落地与应用。

「软硬件」之外,Dexbotic全面覆盖训练需求,既支持阿里云、火山引擎等大规模云端训练平台,也兼容消费级GPU(如RTX 4090显卡)的本地训练方案。

针对UR5、Franka、ALOHA等主流机器人,Dexbotic也提供了统一训练数据格式,并开源通用部署脚本支持用户自定义部署。

可以看到,Dexbotic预训练模型在多种仿真器中,都给传统VLA策略带来了额外提升。

他们是如何做到的?

在开源的技术报告中,我们发现了Dexbotic的诸多创新,尤其是在模型层的设计上。

Dexbotic代码库的整体架构主要包含三大核心层级:数据层(Data Layer)、模型层(Model Layer)和实验层 (Experiment Layer)。

数据层定义了Dexdata统一格式以整合多源数据并优化存储空间。

基于Dexdata格式的数据,系统将自动执行数据处理流程,提取图像、文本及状态信息用于模型训练。

Dexbotic在模型层面的创新主要集中在构建一个统一的模块化VLA框架。

并在此基础上预训练了更强大的基础模型(DexboticVLM)和一系列性能优越的机器人专用预训练模型。

此外,框架兼容主流LLM的开源接口,集成了具身操作和导航功能,预留了未来全身控制的接口扩展能力。

· DexboticVLM

为了解决现有VLA模型依赖过时VLM的问题,Dexbotic选择从头开始预训练自己的VLM。

DexboticVLM集成了先进组件: 视觉编码器CLIP和Qwen2.5,双层MLP作为投影器。

这个自研的DexboticVLM是后续所有预训练模型的基础。

基于DexboticVLM,Dexbotic提供了一系列性能远超原始开源版本的预训练模型。

这些模型分为离散和连续两种:

1、离散预训练模型 (Dexbotic-Base)

第一种是一个通用的VLA策略预训练模型。

它在DexboticVLM的基础上,使用了大规模、多样化的机器人数据进行了进一步的预训练。

训练数据非常广泛,包括Open-X Embodiment数据集的子集、来自多个模拟器(如RLBench, Libero, Maniskill2)的数据,以及真实的机器人数据(如UR5)。

2、连续预训练模型

第二种是专为特定视觉语言动作策略设计的预训练连续模型。

对于连续预训练模型,Dexbotic还提供了单臂和双臂任务的两个版本。

它使用Dexbotic-Base来初始化VLM部分,并随机初始化动作专家(DiT头)。

该模型使用了包含Dexbotic收集的私有数据集进行训练。该私有数据集涵盖了8种不同的单臂真实机器人(如UR5, Franka, Unitree Z1等)执行的52个操控任务。

这极大地增强了模型的泛化能力。

原始的CogACT策略并不支持多视图和双臂设置。

Dexbotic通过修改模型架构扩展了CogACT的能力。

实验层是Dexbotic体系中最核心的组成部分。

Dexbotic创新性地引入实验脚本机制,定义了基础实验脚本,用户根据自己的需求修改最少量的实验配置,即可开展新的实验,在确保系统稳定性的同时支持快速实验迭代开发。

实验层是Dexbotic VLA模型开发与复现的核心接口层,研究者只需通过实验脚本即可实现模型配置、训练与部署。

实验层的设计遵循三个核心原则 :

1.实验中心化(Experiment-Centric)

不依赖复杂YAML配置文件,而采用脚本化配置模式,让研究者能以最少代码完成实验定义。

2.高可扩展性与可复用性

通过「分层配置 + 工厂注册 + 入口分发」机制,支持对模型、任务、数据、优化器等模块的灵活替换。

3.保持稳定与可维护性

所有实验都基于同一base_exp模板,可继承并重写字段,防止配置碎片化。

Dexbotic训练流水线

Dexbotic还为不同开发者提供推理服务。

Dexbotic提供了一个轻量化的远程推理架构,支持在云端或本地执行机器人控制。

推理服务分为三个关键模块:

1.DexClient(客户端):位于机器人端或用户本地;向服务器发送推理请求;负责执行返回的动作序列。

2.Web API(服务器端):基于 Flask Service 构建;接收来自DexClient的数据;调用模型执行推理;返回动作结果。

3.VLA模型(推理核心):接收图像与文本指令;执行多模态特征提取与推理;输出连续或离散的机器人动作。

具身智能研究长期以来的一个核心痛点是「碎片化」。

不同机构使用不同的框架、模型架构和数据格式,导致研究者难以复现、比较和迭代他人的工作。

Dexbotic正是在这种背景下提出,其学术和工程创新性体现在以下几点:

在VLA开源领域,还存在其他几个重量级参与者,比如通用机器人学习工具库LeRobot。

LeRobot和Dexbotic都是旨在解决行业碎片化、推动机器人研究标准化的重要开源工具箱。

Dexbotic不仅补充了LeRobot的生态,更在多个关键环节提供了针对性的「升级」:

1、核心能力从「过时」到「最新」

Dexbotic的核心创新之一是提供了DexboticVLM。

许多现有的VLA模型(包括LeRobot等工具支持的模型)都构建在如Llama2等相对过时的LLM之上。

它不再依赖旧的LLM,而是集成了最新的LLM(如Qwen2.5)和视觉编码器从头预训练。

2、数据格式的升级:更高效的存储

Dexbotic引入了统一的Dexdata格式。

该格式专门为VLA训练设计,通过优化的存储方式(如mp4视频和json),显著节省了模型训练所需的存储空间。

3、开发范式的升级:从「配置」到「实验」

传统AI框架(包括LeRobot)大量依赖yaml文件进行配置,这在处理复杂VLA策略时可能变得繁琐。

Dexbotic创新地采用了「以实验为中心」(Experiment-Centric)的开发框架。

用户通过继承和修改exp脚本来定义实验。

这种方式被认为比yaml配置更灵活,允许用户在不影响全局配置的情况下快速开发新实验。

LeRobot将重点和核心放在「易用性」与「社区生态」。

它像是一个「VLA模型和数据集的Hugging Face」,目标是降低普通用户的门槛,让所有人都能轻松访问、下载、训练和分享机器人模型,更侧重于可复现性。

Dexbotic核心是「高性能」与「统一标准」。

它更像是一个「高性能VLA研究框架」,目标是解决碎片化和提升性能基线,为专业开发者提供一个更强、更统一的「基础运行层」,更侧重于冲击SOTA。

从架构设计重点更能看出二者的区别。

它摒弃了传统的yaml配置文件,用户通过继承base_exp脚本并覆盖参数来定义新实验。

这种设计的本质是为了让研究者在保持代码库稳定的同时,能极其敏捷地开发和修改实验(例如快速切换模型或任务)。

其架构的本质是简化工作流,将数据处理、模型训练和评估封装在一致的API下,重点在于开箱即用。

除了在平台层面发力,打造Dexbotic,原力灵机还试图构建一个更全面的评测基准。

机器人正在走入现实世界,但目前仍缺乏统一、可复现的基准测试方法。

比如有些算法在仿真环境表现优异,但是很难在现实世界复现。

Dexmal原力灵机联合Hugging Face共同发起的RoboChallenge就是为了解决这个问题。

RoboChallenge是全球首个大规模多任务的真机基准测试平台。

Dexbotic鼓励用户利用该开源工具箱开发更多的现实机器人任务,并在其官网上提供了丰富的真实世界任务可视化案例。

同时,Dexbotic建议用户将基于其开发的策略提交至RoboChallenge平台,以便在真实场景中进行公平的对比。

《星球大战》的设定中,机器人是无法使用「原力」的。

机器人缺乏生物体所拥有的「生命之力」,因此被认为无法感知或使用原力,这些机器没有感知原力的能力。

但随着具身智能不可阻挡的进入物理世界,如何给这些机器赋予「原力」,或许是一个需要提上议程的话题。

如何让机器人都可以用上「原力」?

这就是Dexbotic和RoboChallenge背后,原力灵机试图解决的问题。

10月23日晚19:00,Dexmal原力灵机创始团队成员汪天才将现身直播间,讲解开源一站式VLA工具箱Dexbotic。

欢迎大家预约观看、线上交流 : )

文章来自于微信公众号“新智元”。

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales