随着 AI 能力不断增强,它正日益融入我们的工作与生活。我们也更愿意给予它更多「授权」,让它主动去搜集信息、分析证据、做出判断。搜索智能体正是 AI 触达人类世界迈出的重要一步。

然而,现实世界的搜索环境并不总是「信息增益」的来源;它也可能放大微小偏差、把模型带入错误轨道。如何让搜索智能体在复杂环境中更稳健,成为关键问题。

近期,上海人工智能实验室及合作单位提出了一个简单而有效的思路:让搜索智能体像人一样,先「立目标」,再「照镜子」。具体而言,模型在每一次搜索前都要明确「我想找什么」(goal-oriented planning),搜索后再判断「是否找到」(self-reflection)。

我们将这一思路实现为 RE-Searcher,并在多个开放域问答与多跳推理任务上取得了新 SOTA 表现,同时显著提升了对环境噪声与搜索脆弱性的抵抗力。

本文要点:

现实搜索并非总是「问一得十」。我们的分析表明,搜索环境的复杂性会显著放大模型固有的随机性,导致「同样的问题,跑两次,命运不同」的脆弱现象。

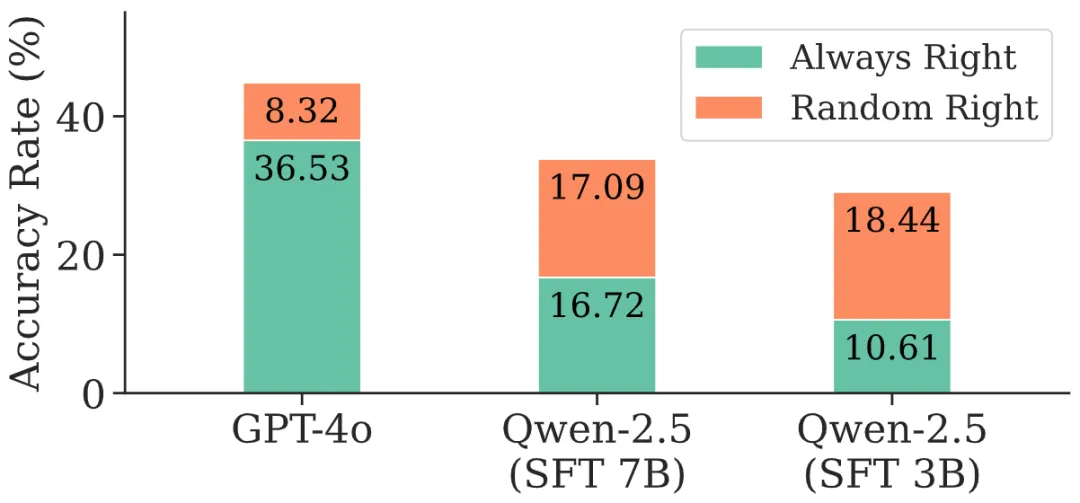

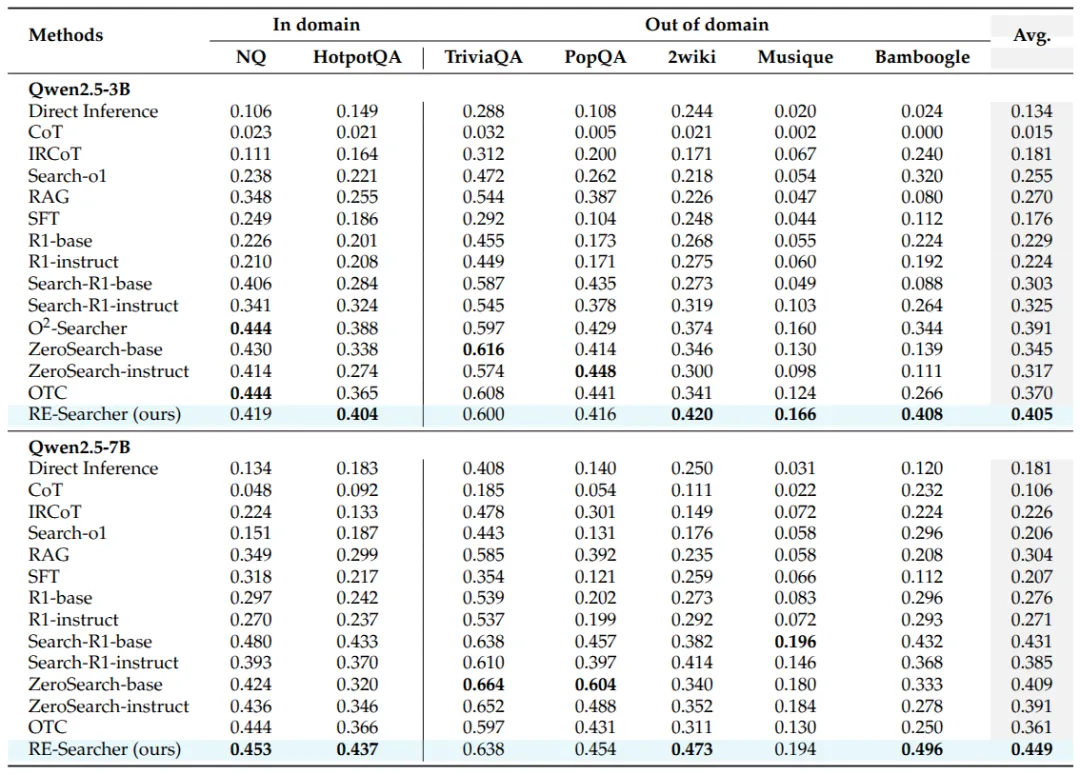

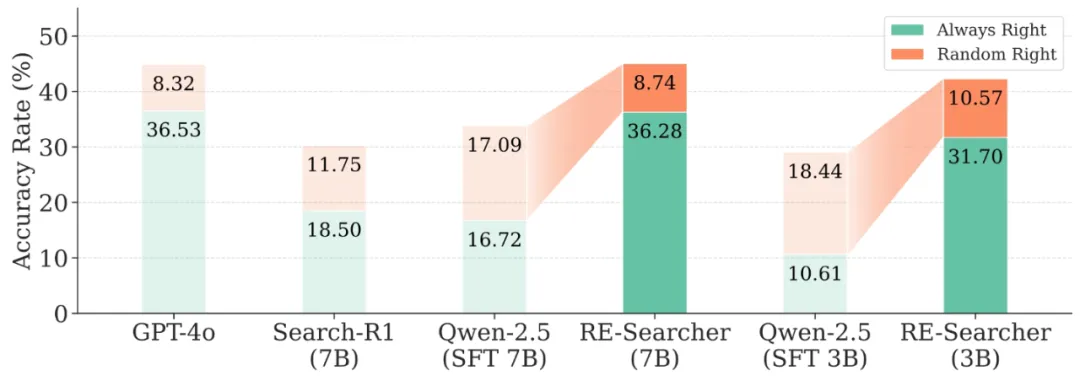

如图 1 所示,在相同数据上重复两次推理,弱一些的基础模型往往出现「随机正确」(random right)比例接近或甚至高于「总是正确」(always right)的情况。这种随机性极大削弱了模型的实际表现。这种不稳定的根源在于搜索过程的脆弱性。

图 1. 模型回答随机性分析

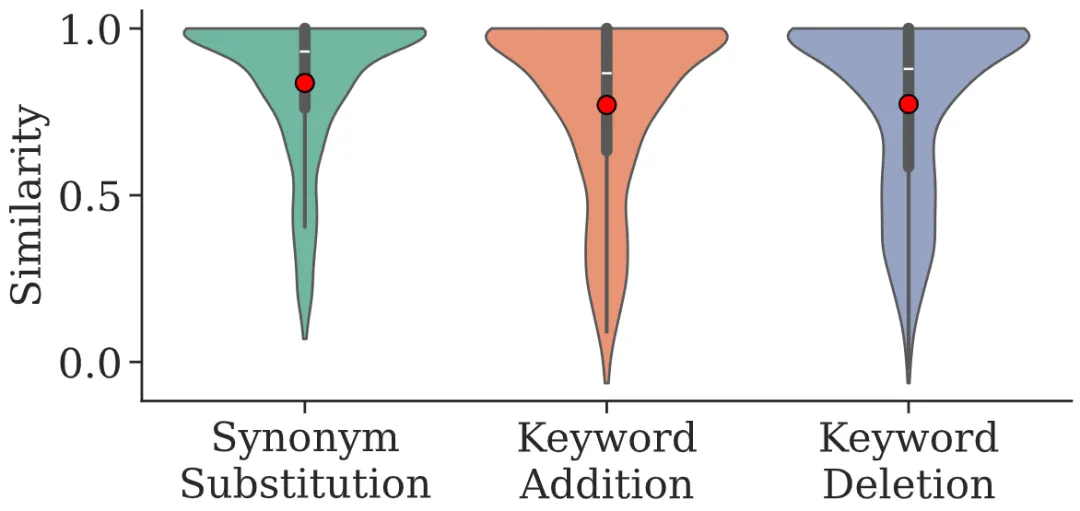

如图 2 所示,只对检索式做细微改动(同义替换、增/删一词),检索结果的语义相似度就可能大幅下降,许多样本跌破 0.6 阈值。一个看似合理却偏离主题的关键词,足以把搜索引向错误分支。

图 2. 搜索结果脆弱性分析

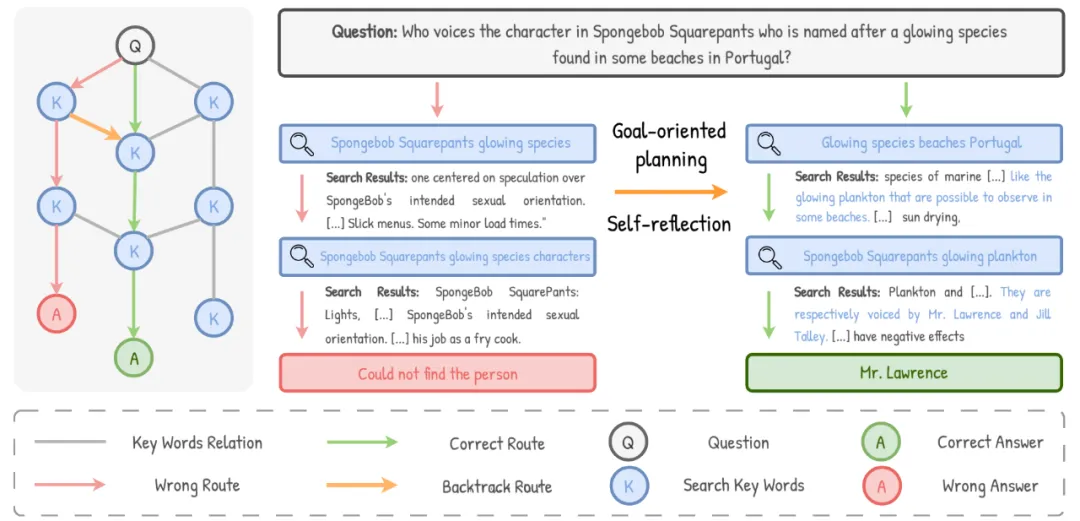

直观理解:如图 3 所示,把检索看作在「关键词图」上行走。一次小小的关键词变化,可能让智能体走进另一条支路;若后续优化都围绕这条错误分支展开,越走越偏,难以回到正确答案。强模型(如 GPT-4o)有时能「自救」,但更普遍、可落地的方式,是让模型从一开始就「立目标」,并在每一步都「照镜子」。

图 3. 搜索脆弱性分析

为了让 AI 变得更稳健,研究团队提出了 RE-Searcher 框架。其核心思想是模仿人类在处理复杂任务时的两个关键认知行为:

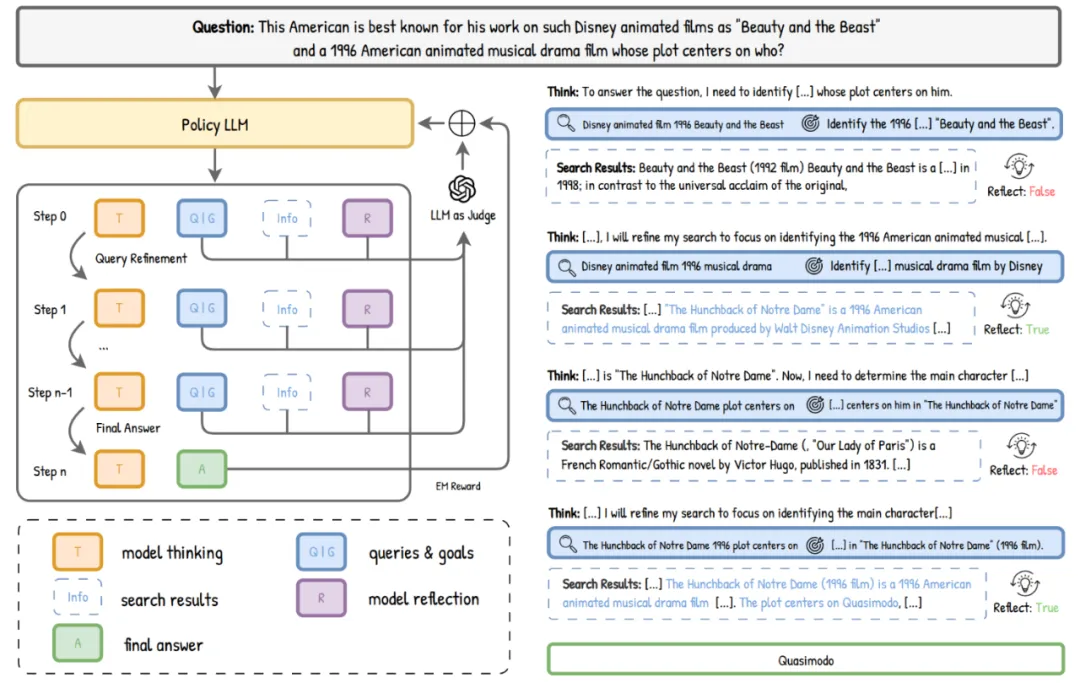

为了实现这一点,如图 4 所示,研究团队设计了一套简单却有效的训练机制。他们通过特定的指令模板(如使用 <goal>、<query>、<reflect> 标签)来规范智能体的思考和行为格式。

特别地,在「照镜子」环节,团队让一个「教师模型」(如 GPT-4o-mini)来评判智能体的反思是否正确,并将评价结果作为奖励信号,从而训练智能体学会如何进行高质量的自我反思。

图 4. 训练 pipeline

小例子:经过训练的模型在一次多跳检索中,搜索引擎曾把关键词误解为同名小说;RE-Searcher 在反思环节判定「未满足目标」,只改了一个限定词就把结果拉回正轨。

为了验证 RE-Searcher 的效果,研究团队进行了一系列详尽的实验。

SOTA 表现与有效的反思行为

在包括 NQ、HotpotQA 在内的 7 个主流搜索问答数据集上,RE-Searcher 取得了领先的表现。无论是在 3B 还是 7B 模型规模上,RE-Searcher 的平均表现都超过了现有的基线模型,达到了新的 SOTA(State-of-the-art) 水平。

图 5. 主要性能表现

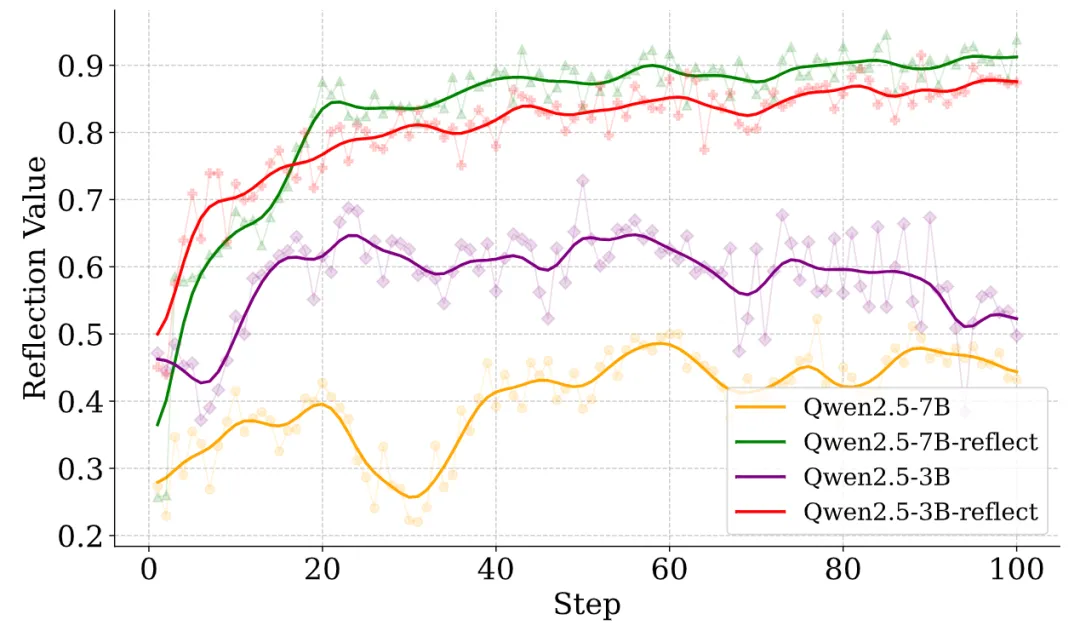

实验还证明了「反思奖励」的有效性。如果没有这个奖励,模型在反思时的判断准确率仅在 50% 左右(相当于随机猜测)。而加入奖励后,模型的反思能力得到了显著且稳定的提升。

图 7. 反思正确率变化曲线

有效抵抗「搜索脆弱性」

RE-Searcher 能否缓解前面提到的「随机正确」问题?答案是肯定的。

实验数据显示,经过训练后,RE-Searcher 的「随机正确」比例大幅降低。以 7B 模型为例,其「随机正确」率从 SFT(监督微调)模型的 17.09% 降低到了 8.74%,几乎减半,并且非常接近能力更强的 GPT-4o 的水平(8.32%)。这表明,智能体不再是「凭运气」答对,而是真正具备了稳定解决问题的能力。

图 8. 随机性变化效果

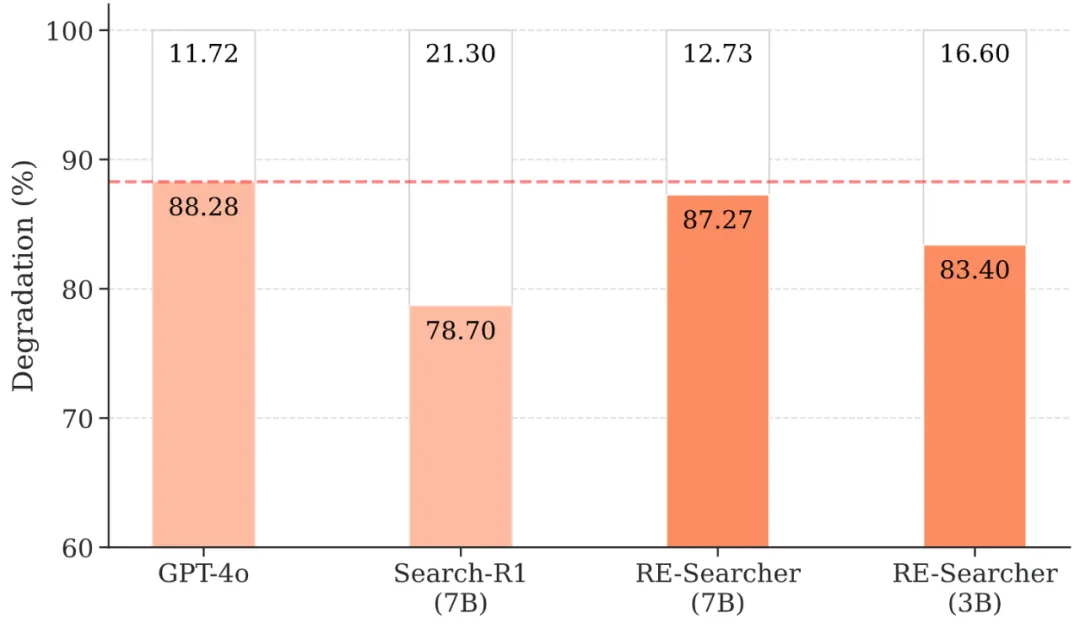

面对外部干扰,表现更「淡定」

为了模拟真实世界中更极端的噪声,研究团队设计了一个「压力测试」:在智能体的第一次搜索时,人为地向其搜索查询中引入干扰(如随机增删或替换词语),观察其性能下降程度。

结果显示,RE-Searcher 表现出了极强的鲁棒性。与基线模型 Search-R1 相比,RE-Searcher (7B) 的性能下降幅度要小得多(12.73% vs 21.30%),几乎与 GPT-4o 处于同一水平。这证明了「立目标、照镜子」的策略使其不容易被初期的错误信息带偏,具备更强的纠错和恢复能力。

图 9. 抗干扰实验结果展示

RE-Searcher 的研究证明,通过教会 AI 智能体进行目标规划和自我反思,可以显著提升其在复杂环境中的稳健性和可靠性。随着我们给予 AI 越来越多的自主权,它们将不可避免地与更加动态和不可预测的真实世界环境进行交互。如何确保它们在这一过程中行事稳健、值得信赖,是一个需要持续探索的重要课题。这项工作为构建更强大、更负责任的自主智能体迈出了坚实的一步。

文章来自于微信公众号“机器之心”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】MindSearch是一个模仿人类思考方式的AI搜索引擎框架,其性能可与 Perplexity和ChatGPT-Web相媲美。

项目地址:https://github.com/InternLM/MindSearch

在线使用:https://mindsearch.openxlab.org.cn/

【开源免费】Morphic是一个由AI驱动的搜索引擎。该项目开源免费,搜索结果包含文本,图片,视频等各种AI搜索所需要的必备功能。相对于其他开源AI搜索项目,测试搜索结果最好。

项目地址:https://github.com/miurla/morphic/tree/main

在线使用:https://www.morphic.sh/

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner