用鼠标和键盘打游戏的智能体,这就来了!

它不仅能在《我的世界》中和普通玩家一较高下。

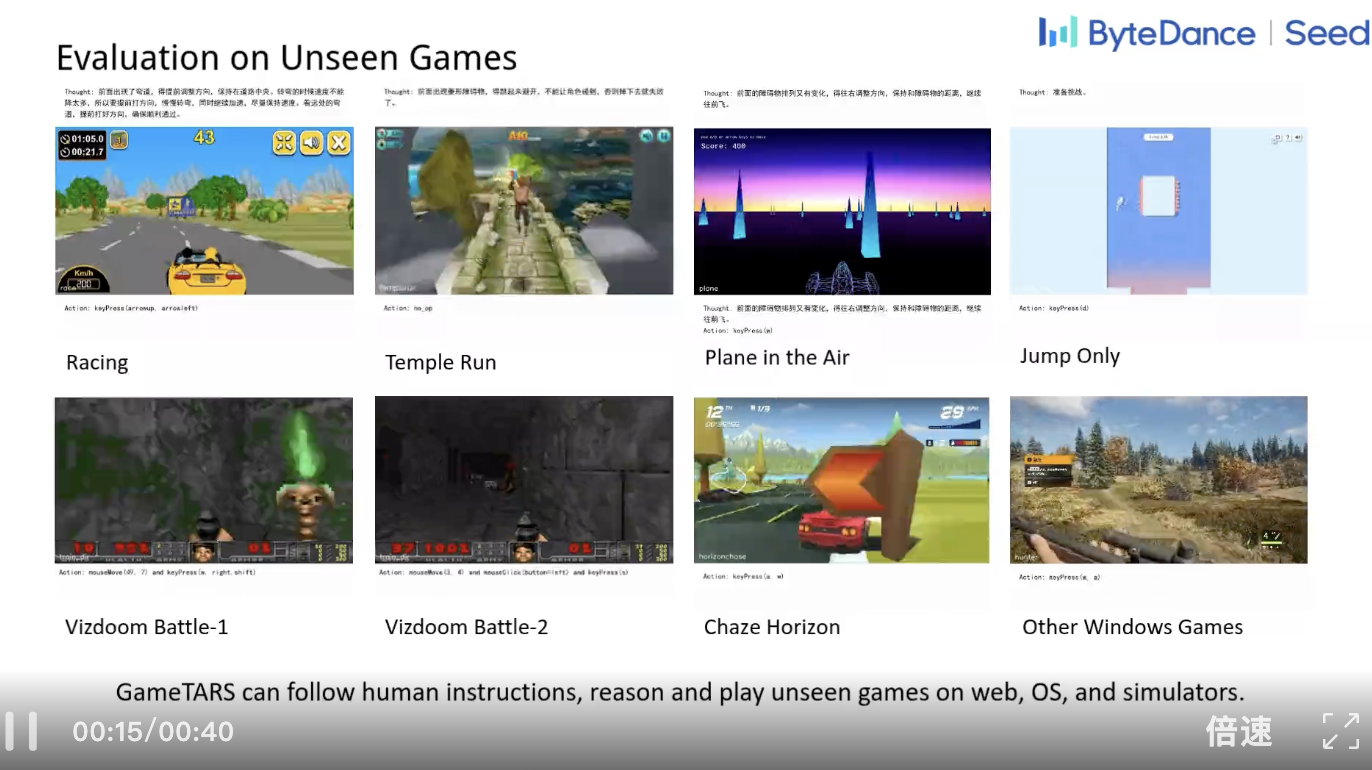

还能玩《神庙逃亡》、《星露谷》,甚至可以在未见过的3D网页游戏中实现零样本迁移。

而这,都是由字节seed团队打造的通用型游戏智能体——Game-TARS完成的。

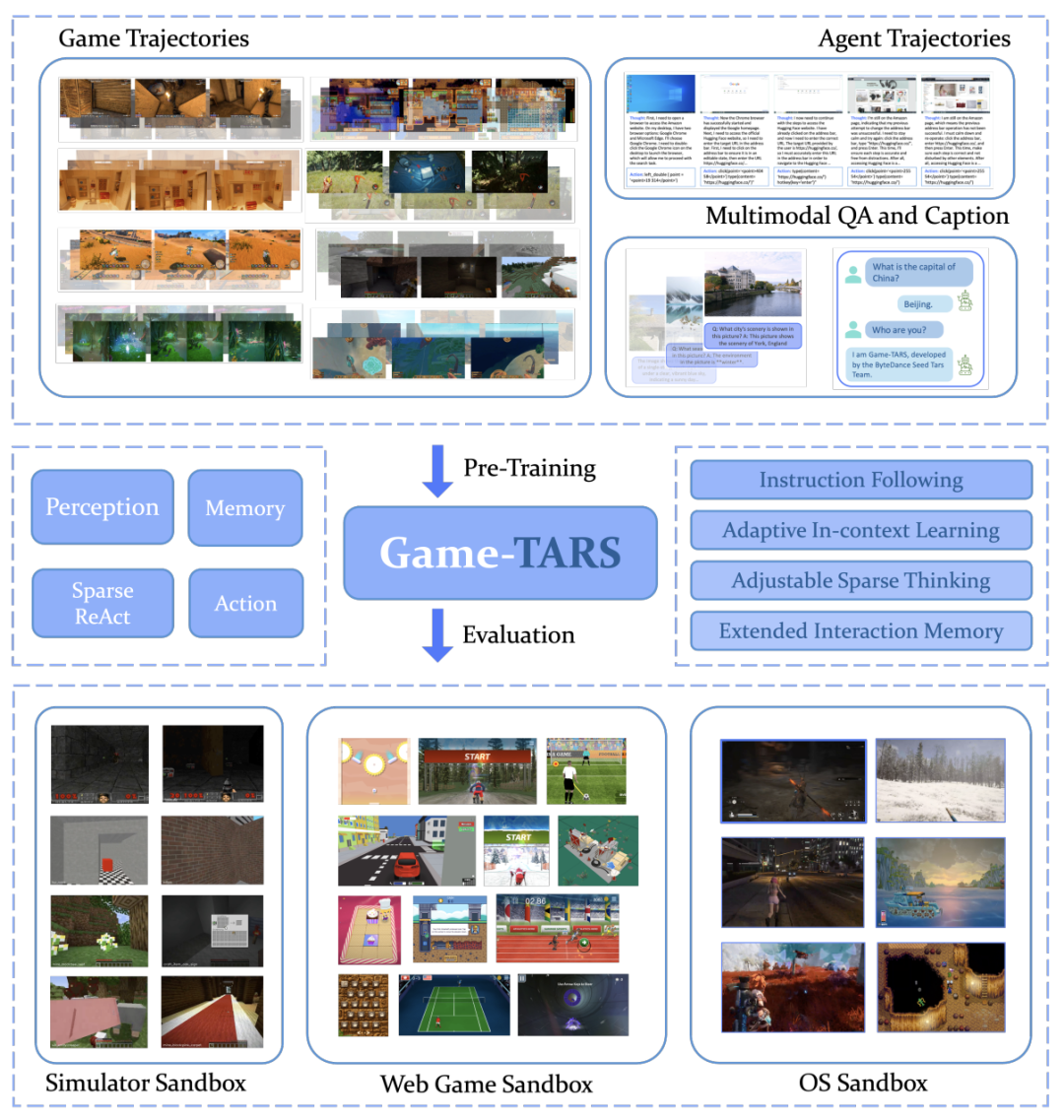

Game-TARS基于统一、可扩展的键盘—鼠标动作空间训练,可在操作系统、网页与模拟环境中进行大规模预训练。

依托超5000亿标注量级的多模态训练数据,结合稀疏推理(Sparse-Thinking) 与衰减持续损失(decaying continual loss),大幅提升了智能体的可扩展性和泛化性。

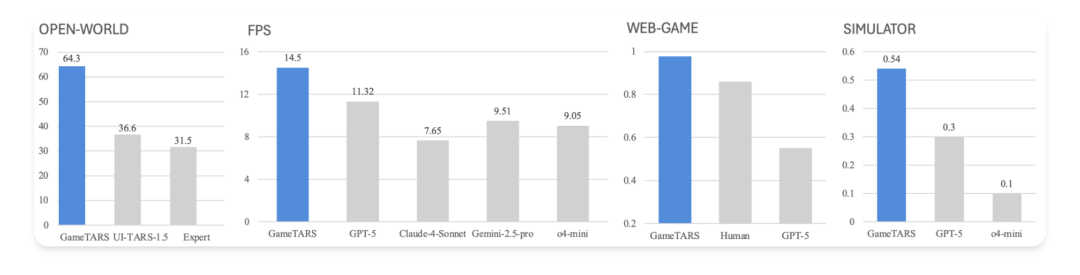

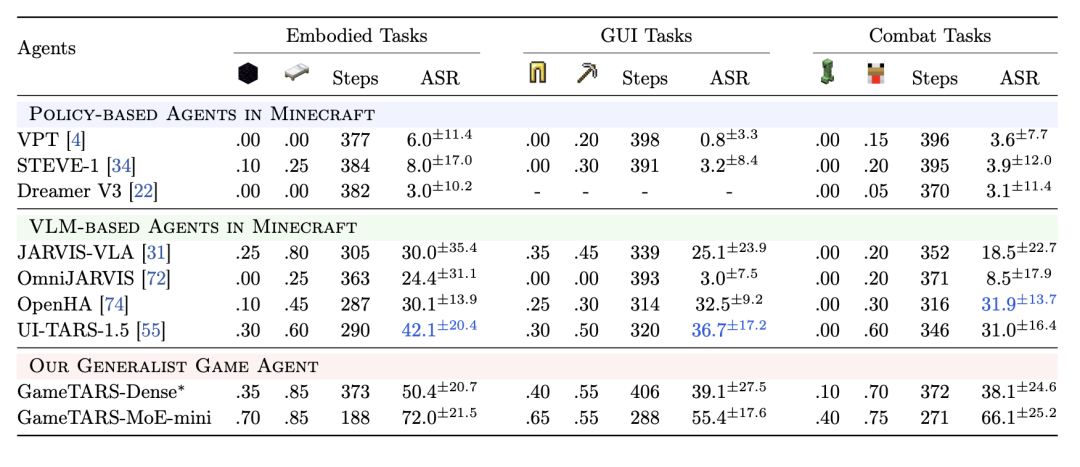

在FPS、开放世界、WEB游戏等任务中,它的表现超越了GPT-5、Gemini-2.5-Pro、Claude-4-Sonnet。

这是怎么做到的?

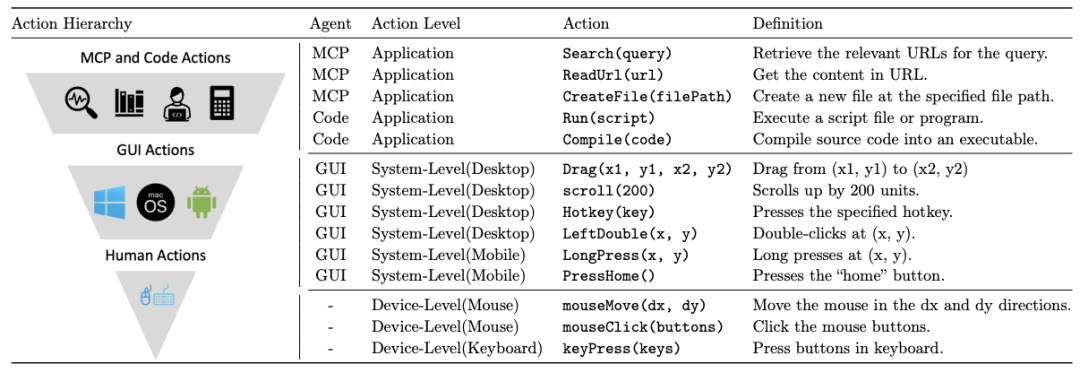

Game-TARS的核心创新在于,让智能体不再“调用函数打游戏”,而是像人一样用键盘和鼠标操作。

也就是说,它不只是简单地执行指令,而是真正通过模拟人类操作的方式完成游戏中的每一个动作。

相比之下,传统智能体通常依赖为特定环境定制的动作集:

这些方式虽然高效,却缺乏通用性。一旦换个操作系统或应用环境,智能体就束手无策。

为解决这个问题,Game-TARS专注于最底层的Human Actions(人类动作):

这种设计使智能体的动作指令集与任何特定应用或操作系统解耦,实现了与人类用户物理交互方式的直接对齐——

即Human-Native Interaction(人类自然交互)。

由此,Game-TARS定义了一个可扩展、统一的动作空间,让智能体告别高层级指令,直接动手“玩”,极大地提高了可扩展性和泛化性。

与传统游戏机器人或模块化人工智能不同,Game-TARS将视觉感知、策略推理、动作执行和长期记忆整合到一个视觉语言模型(VLM)中。

智能体无需针对每款游戏编写特定代码或规则,就能自主学习操作,并在各种游戏中完成任务。

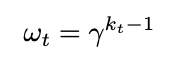

为实现这一点,Game-TARS将该智能体构建为一个自回归的、参数化的策略,并利用统一的键盘—鼠标动作空间进行训练,包括持续预训练和后训练两个阶段,

在预训练阶段,团队采用的ReAct范式,结合稀疏推理(Sparse Thinking)——只在关键决策点交错进行推理和行动,以模拟人类认知模式。

具体做法包括:

此外,为了解决“行为惯性”问题,Game-TARS引入了指数衰减权重,对连续重复动作按指数降低权重,确保新动作获得足够关注,让模型更专注于高熵动作转变,学习出更稳健、泛化能力更强的策略。

在超过2万小时、约5000亿token的游戏数据上大规模预训练后,研究进入后训练阶段,进一步强化智能体在特定任务中的执行能力和交互智能,重点提升三大核心能力:

此外,为了将能力扩展到游戏以外,后训练还引入了跨领域轨迹数据,包括代码生成、GUI 自动化和科研任务,帮助 Game-TARS从游戏玩家成长为多功能通用计算机用户。

在具体的训练细节上,研究采用了统一的、单阶段的持续预训练方法,将所有数据源融合在一起,并对模型进行了超过5000亿个token的训练。

在后训练阶段,对约200亿个精心策划的高质量token进行了微调。

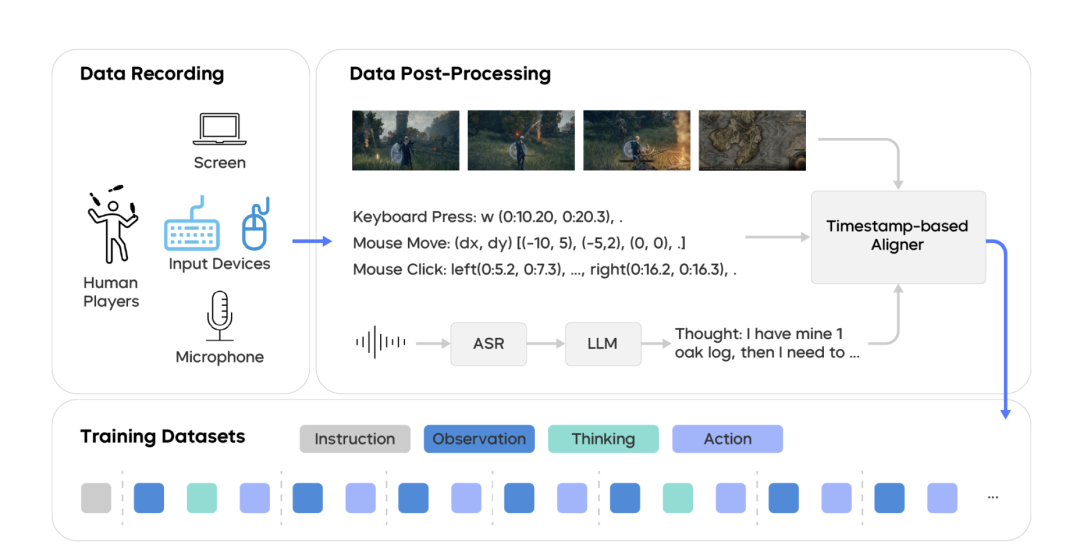

研究首先通过在《我的世界》中测试智能体的能力,验证了统一动作空间和大规模持续预训练的有效性。

与grounding-based或基于API的动作不同,研究发现统一动作空间在训练数据少于10B时,最初在成功率方面并未超越基于GUI动作的智能体。

然而,统一动作空间的关键优势在于其可扩展性——可以高效地收集大规模数据,并且智能体可以使用一致的格式跨所有游戏进行预训练。

扩展实验证明,这种统一动作空间为实现通用智能体提供了卓越的基础。

当在大量的通用计算机使用数据语料库上进行训练后,基于统一动作空间的Game-TARS在《我的世界》中的表现比以前最先进的专家模型提高了约2倍。

正如开头demo中所展示的,研究进行了广泛评估:包括FPS游戏Vizdoom、3D模拟器Miniworld和在线网页游戏 。

实验表明,Game-TARS 的迷你版本在各种任务上超越了著名的预训练模型,如Gemini-2.5-Pro 、GPT-5和Claude-4-Sonnet ,展示了在不同领域中的卓越性能。

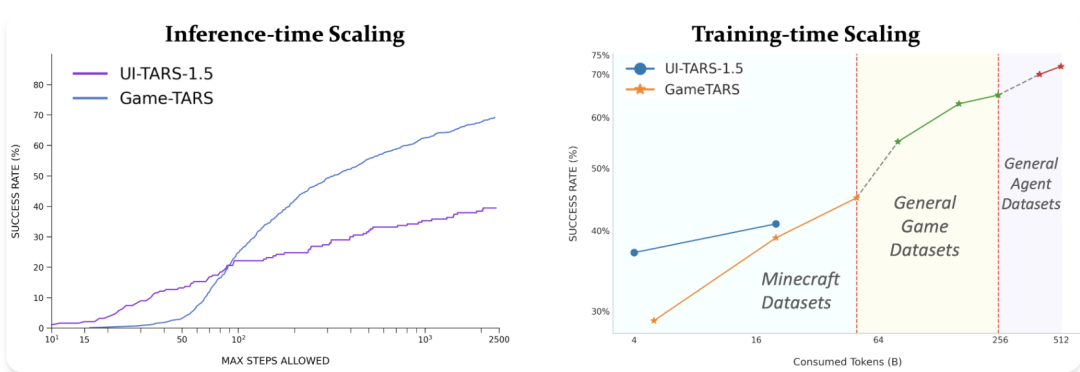

此外,实验表明Game-TARS在训练和推理过程中都具有可扩展性。

总的来说,Game-TARS依靠简单、通用的原生键盘和鼠标动作空间,实现了大规模跨领域训练。

这一设计不仅提升了智能体的扩展性,也为未来在更多任务和环境中的泛化能力奠定了基础。

Game-TARS的第一作者是北京大学人工智能研究院博士生——王子豪。

王子豪师从梁一韬教授,主要研究方向聚焦于开放式通用智能体的构建,涵盖计算机应用、具身游戏与深度研究等领域,致力于通过大型预训练模型提升智能体的泛化与自主能力。

目前,他在字节跳动Seed团队担任研究实习生。

参考链接

[1]https://arxiv.org/pdf/2510.23691

[2]https://zhwang4ai.github.io/

文章来自于微信公众号 “量子位”,作者 “量子位”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales