“养龙虾”彻底火了!

养龙虾已经成为开年极客新风潮了!

近日,仅仅大模型公司推出适配OpenClaw的产品已经不足以描述“龙虾”的火爆程度了!猎豹CEO负伤期间养龙虾、腾讯工程人员在广场上免费装龙虾、甚至某鱼上“上门收费安装龙虾”……

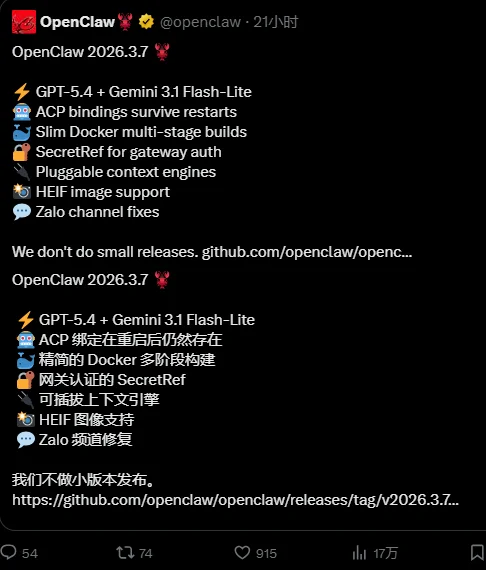

而就在昨天,让第一批“养龙虾”的歪果仁们都说好的龙虾新版本发布了!

昨晚,OpenClaw 刚刚发布了一个大改动版本 2026.3.7,可以说,把“龙虾”推到了一个新境界。

官方X账号上更是直接来了一句:“我们不做小版本发布!”

这次最核心的更新,有三项。

第一个核心进化:ContextEngine 插件化。

这是本次更新最硬核的部分。

OpenClaw 引入了全新的 ContextEngine 插件接口,并开放了完整的生命周期钩子(从 bootstrap 到 afterTurn)。

以前 AI 的记性,取决于平台自带的记忆系统,要么是存在简单的数据库,要么是 Markdown 文件,或者是一些基础的 RAG 检索。你没法自定义 Agent 处理记忆或上下文的具体逻辑。

最重要的是,以往 AI 的上下文压缩和清理逻辑是硬编码在核心库里的。现在,开发者可以像插拔内存条一样,自定义 AI 的记忆管理策略。

对于想要长久“养虾”的开发者而言,属实真香了!

据一位老外反馈:旧的记忆压缩机制会导致 Agent 丢失任务目标或学到的Skills,这非常让人抓狂。

有了可插拔上下文引擎,第三方开发者可以构建完全自定义的记忆系统。我自己会用 supermemory.ai 作为第三备份,每隔几小时将对话推送到云端以便随时检索,同时把本地的 Markdown 记忆文件维持在 20,000 行以下。

现在,如果你想让 Agent 把记忆存进知识图谱?写个引擎就行。想要带自定义评分的向量嵌入?写个引擎就行。甚至想要记忆像人类一样随时间淡化?你也可以实现。

总之,有了可插拔的上下文引擎,你可以为特定任务开发“永不遗忘”的策略,或者使用 lossless-claw 插件来实现无损的上下文管理,而无需触动核心代码。

第二块核心改进是跨平台协作,实现了精准路由与持久化。

对于在 Telegram、Discord、Slack 等社交平台上部署 Agent 的用户,3.7版本的“龙虾”解决了多个痛点:

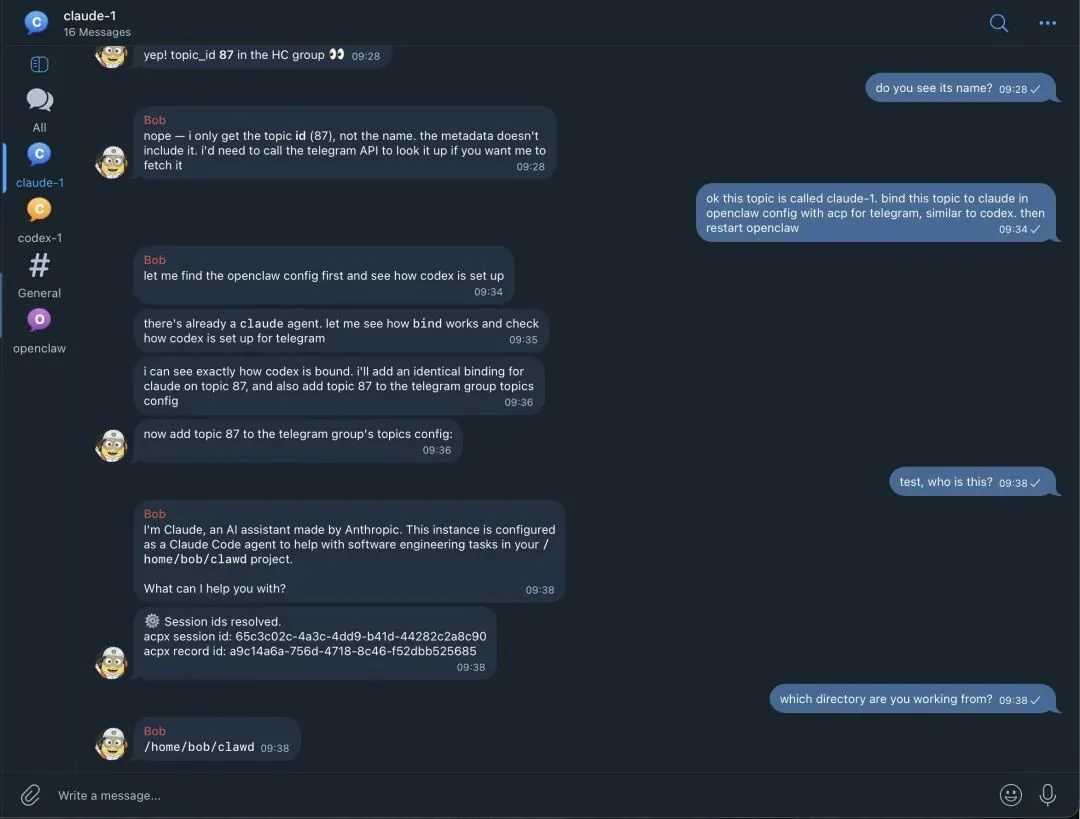

agentId。一个群组里可以同时驻扎多个各司其职的 AI 专家,且 Session 完全隔离。这个不少“养虾”玩家都反馈,“ACP重启持久化”是一个最大的痛点。

以前重启一下电脑,Telegram 机器人就断联,得手动一个个重连。3.7版本这次完美解决了这个问题,即使我强行重启 Mac Mini,Agent 也能秒接之前的对话,一个节拍都不漏。

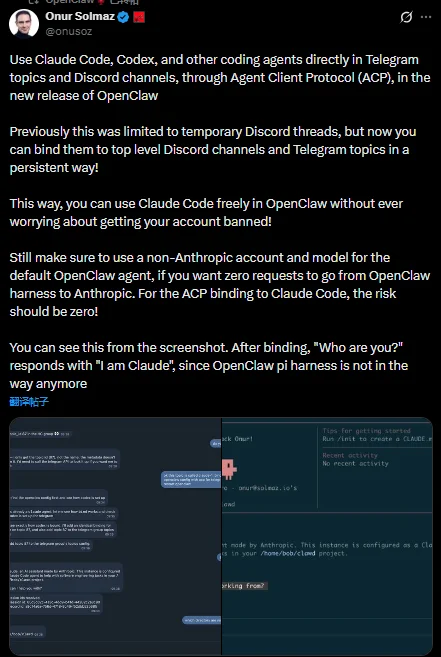

据 OpenClaw 维护者 Onur Solmaz 表示,新版本中,用户可以通过 ACP 直接在 Telegram 主题和 Discord 频道中使用 Claude Code、Codex 和其他编码代理。

甚至他表示:这样,用户已经可以在 OpenClaw 中自由使用 Claude Code,而无需担心帐户被封禁!

这对于部署党来说,绝对是一个喜讯!新版本重构了 Dockerfile,采用多阶段构建。

OPENCLAW_VARIANT=slim 参数,你可以获得一个不含构建工具和 Bun 环境的极简运行时镜像。OPENCLAW_EXTENSIONS 环境变量,在构建镜像时预装插件依赖,大幅缩短容器部署后的冷启动时间。有了这项功能,你可能直接把一个 4GB 的镜像精简到 500MB。这意味着云端部署更快、存储更便宜,而且消耗的带宽更少。

当然还有其他一些改动。比如模型支持方面,新版本已经接入 Google 刚刚发布的 Gemini 3.1 Flash-Lite,性能与响应速度再上新台阶。

一位“养虾达人”表示,配合上面提到的顶级跨平台路由能力,你可以 用 GPT-5.4 思考复杂逻辑,用 Gemini Flash-Lite 处理抓取和审计。

结果非常丝滑:响应速度缩短到毫秒级,Token 成本直降 90%!

大家关心的安全方面,新版本也做出了优化。比如:有了网关鉴权的 Secret Ref(密钥引用)系统,你的密钥终于不用再裸奔了!

在此之前,你得手动管理 API Token 和密钥,很容易搞砸,或者不小心在日志和配置文件里把它们泄露出去。

现在 Secret Ref 安全地解决了这一切。你的 Token 是加密的,并与配置分开存储。当 Agent 需要向外部服务发起鉴权时,它会通过 Secret Ref 调用。Token 永远不会以明文形式出现在日志或配置中。

再比如,在硬件读写方面,Cron 任务存储强制执行 0600 权限(仅所有者读写),彻底硬化了系统安全性。

多说一嘴,3.7 版本的 OpenClaw,还增加了对 iPhone 照片 HEIF 格式 的支持。这属于那种“没用到时觉得无所谓,一旦需要就救命”的功能。

OpenClaw v2026.3.7 这波的突发更新,虽然版本名字上看不出来有多重磅,但业内反馈却十分惊艳!

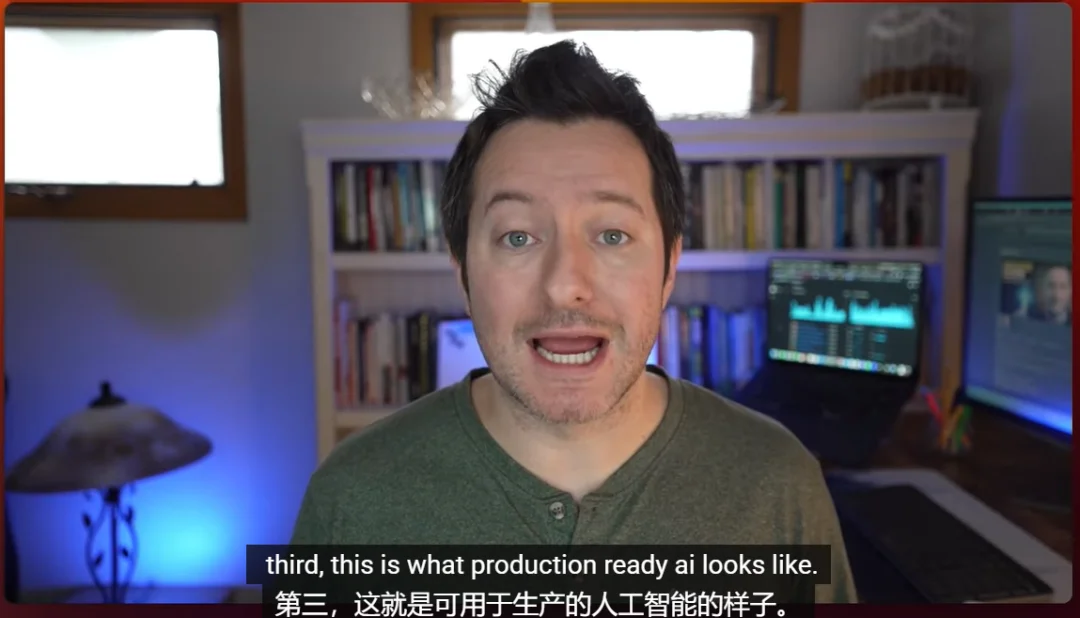

甚至一位网友评价道:3.7版本的龙虾,甚至可以视为解决了 Agent 迈向“生产级”的最后一道屏障:记忆断片与连接不稳。

他表示:我们正处于本地 AI 的转折点。“如果你每个月还在为云端 AI 服务支付数百美元,那你可能花冤枉钱了。长期来看,本地 AI 不仅更便宜,而且更私密、更可靠、更受你掌控。”

“3.7 版本的更新,证明了本地 AI 已经做好了商业化的准备,不管是可靠性、安全性、性能,还是大家不太爱讨论的其他枯燥乏味的方面。

““你第一次可以在消费级硬件上运行企业级的 AI 业务。你不需要 Mac Studio,我整个内容业务就跑在一台价值 600 美元的 Mac Mini 上。剧本、缩略图、社媒推文、新闻通讯,全靠它。”

不过看得出,大家对于“可插拔的上下文引擎”的热情最高。

比如一名极客 Ricky 表示:新版本的确显著改善了所有用户的定时任务体验。

以前做新闻简报任务时,你早上收到的新闻简报可能会遗漏几个小时前保存的内容。现在,每次会话切换时都会清除缓存。每个计划任务都会读取当前文件。不再存在隐形的过时问题。

如果你在 OpenClaw 中使用 cron 来进行提醒、摘要或任何计划任务链,那么这次更新对您来说很重要。

虽然“龙虾”代表了未来消费端智能体的发展趋势。借用大佬周鸿祎今天在采访的话:它将“智能体”这一抽象概念“物化”了,让每个人只要有台电脑,就能“养”一个属于自己的智能体,这对智能体的普及和推广具有积极意义。

甚至有投资人认为,这场“数字牛马”变革的烈度可能是移动互联网的5到10倍!

但由于“养龙虾”这个潮流还处于早期,还是有不少避坑事项。

首先,在本地跑 Agent,安全是第一位的。由于需要访问邮箱、日历、系统命令等核心权限,其安全漏洞被顶级投资机构视为“致命”。

虽然新版本做了不少安全方面的优化,但第一批“养虾者”们,更多还是准备一台独立的设备,比如闲置的 Mac Mini,配独立的邮箱,物理隔离个人隐私。

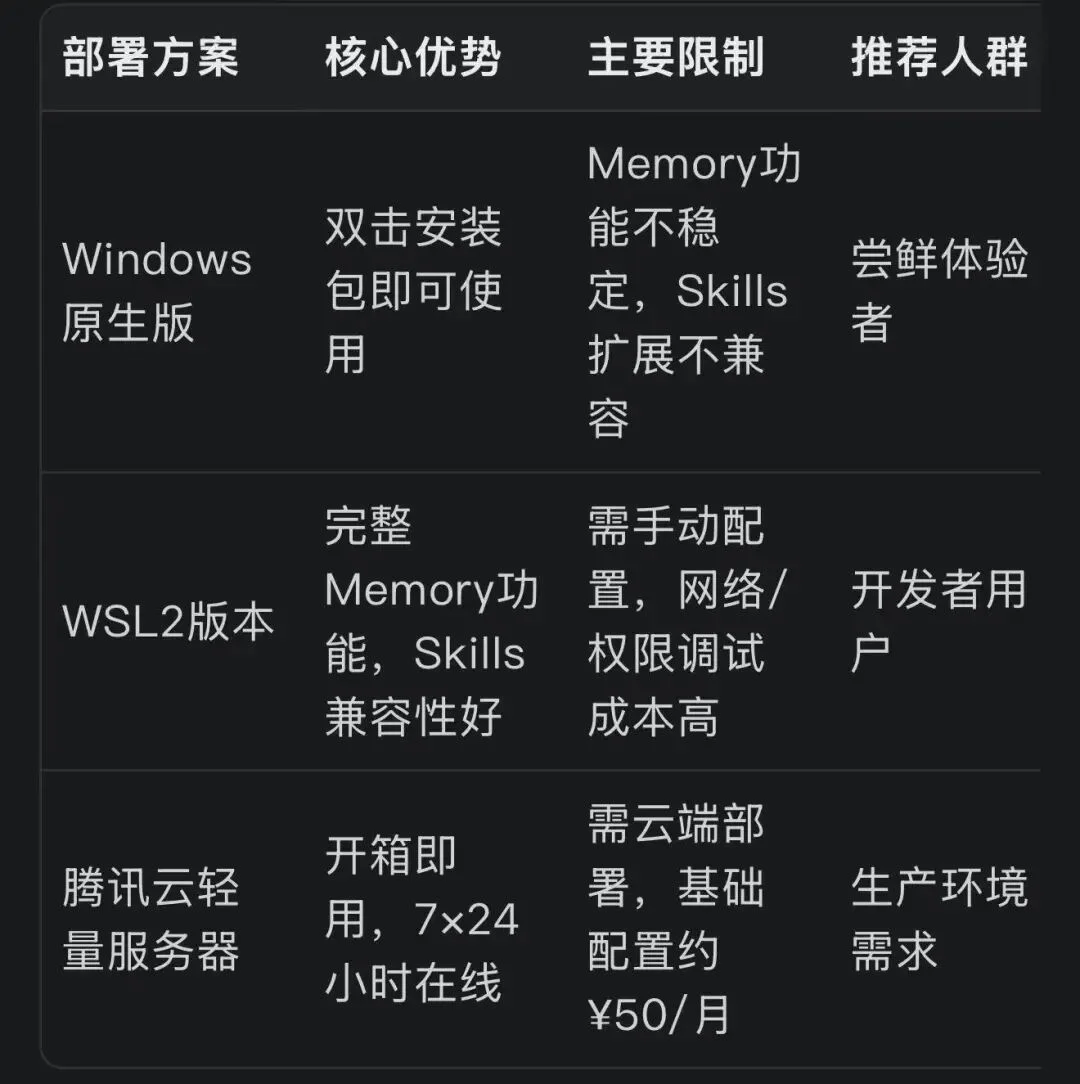

根据实测,Windows原生版本存在明显的功能限制,而云端的方案相对更完整、体验更稳定。下面是一个腾讯云部署的例子。大家可以参考,按需选择环境。

这里值得一提的是,在关键配置方面,如果设置不当,会导致“龙虾失忆”,或性能不佳。

小编也帮大家整理了一些参考事项,建议收藏。

1、调整Context Length:Ollama默认Context Length为4096,处理长文档或多轮对话时容易截断。建议调整至16384以解决“失忆”问题。

2、模型规格选择:

根据服务器内存选择合适的模型:7B模型需要8GB内存,适合日常问答;13B模型需要16GB内存,适合逻辑推理。

3、资源监控:部署后定期检查资源占用,若内存长期超过85%,建议升级实例配置或切换更小的量化模型。

OpenClaw 爆火一个月以来,“私人Agent”的概念正在深入人心,不止是开发者,甚至是各个更广泛的行业与岗位:运营、财务、金融、HR、售货员……

在本地运行 Agent,已经慢慢形成一种新风潮。

同时更让人惊喜的是,人们也不需要 Mac Studio 这种昂贵的设备,一台普通的消费级硬件,配合 OpenClaw 这种不断进化的开源框架,就能跑起企业级的 AI 业务。

这也就是为什么人们开玩笑说,一台配有“龙虾”的设备就等于数个“7×24”不间断工作的数字牛马了!

而这次OpenClaw新版本的发布,可以说,让这个“玩笑”距离成真迈出了关键一步!

多说一嘴,OpenClaw 的 Github 星标数已经来到了 28.3k 星!

文章来自于“51CTO技术栈”,作者 “云昭”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI