在当前的 LLM 开发中,后训练阶段通常被视为赋予模型特定能力的关键环节。传统的观点认为,模型必须通过强化学习(如 PPO、GRPO 或 RLHF)和进化策略(ES)等算法,在反复的迭代和梯度优化过程中调整权重,才能在特定任务上达到理想的性能。

然而,MIT CSAIL 的研究人员 Yulu Gan 和 Phillip Isola 在他们最新发布的论文中对这一传统认知发起了挑战。他们提出了一种名为 RandOpt 的新方法,通过简单的随机扰动和集成来突破传统后训练的限制。

这一发现对大模型参数空间的理解具有颠覆性意义。早在 2001 年,Schmidhuber 等人提出「随机猜测」不能算作一种有效的学习算法,认为「优秀的解决方案在权重空间中的分布必须极其稀疏」。然而,Gan 和 Isola 的研究揭示了一个反直觉的现象:在完成预训练后,LLM 模型的权重空间实际上形成了一个密集的「神经丛林」(Neural Thickets),这一状态促使简单的随机采样就能发现有效的解决方案。

论文指出,预训练模型不仅仅是后训练的「起点」,其权重空间内已潜藏着大量任务专家。随着模型规模的增大,这些专家在权重空间中的分布密度急剧增加,足以让随机扰动和集成方法有效捕捉优越的解决方案。

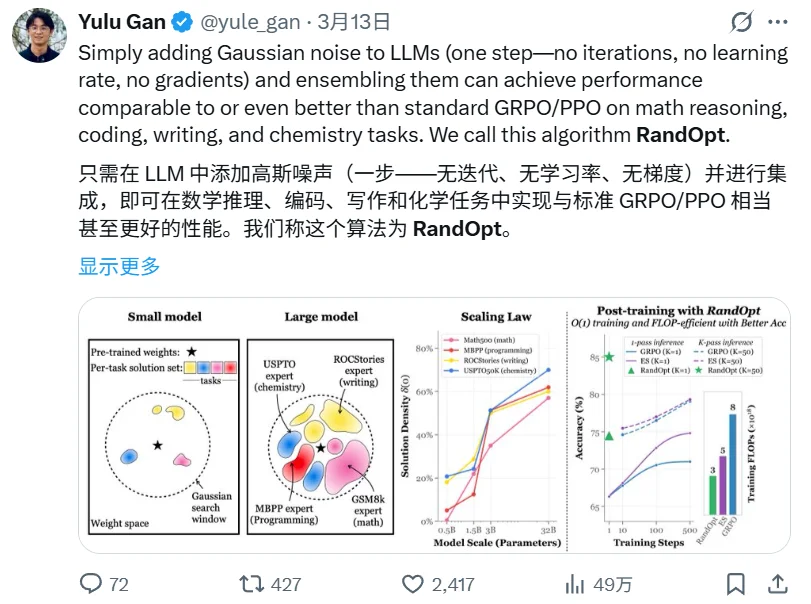

基于这一理论,RandOpt 算法的操作方式非常简单:只需向预训练模型添加单步的高斯噪声(无需任何迭代、学习率或梯度计算),并对多个扰动后的模型副本进行集成。实验结果表明,仅凭这一极简的操作,模型就能够在数学推理、代码生成等复杂任务中达到,甚至超越 PPO 或 GRPO 等传统后训练方法的性能。

通过这一创新方法,RandOpt 为后训练的简化提供了新的可能,展示了预训练模型本身已隐含了丰富的任务专家,后训练过程更多是选择和集成这些专家,而非从零开始训练新能力。

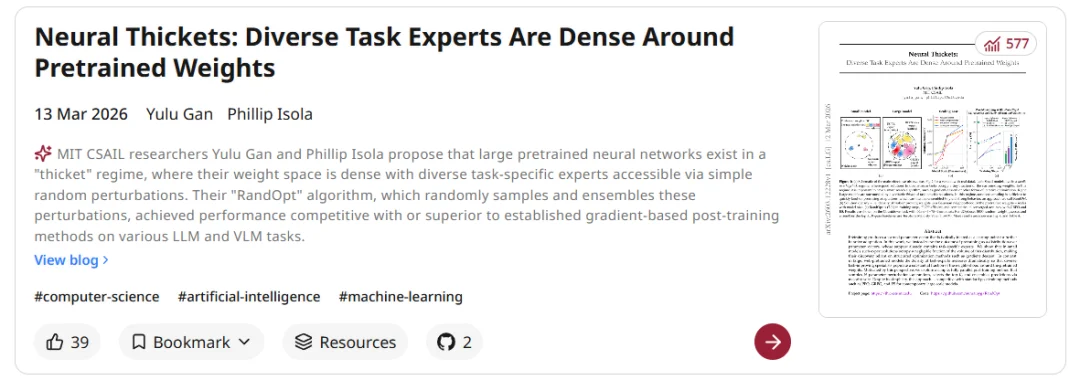

这篇论文一经发布便在 AI 社区引发了轰动,不仅迅速登上 alphaXiv 榜单第二,其作者在 X 上的宣传帖子也获得了近 50 万的浏览量和极高的互动,谢赛宁也转发了该工作。

许多从业者和研究人员惊呼:「强化学习在后训练就死了?」「强化学习泡沫破裂?」。

尽管有人对其在细粒度对齐任务上的泛化能力持保留态度,但这种极简算法背后所揭示的参数空间现象,无疑迫使我们重新思考预训练与后训练的本质关系。

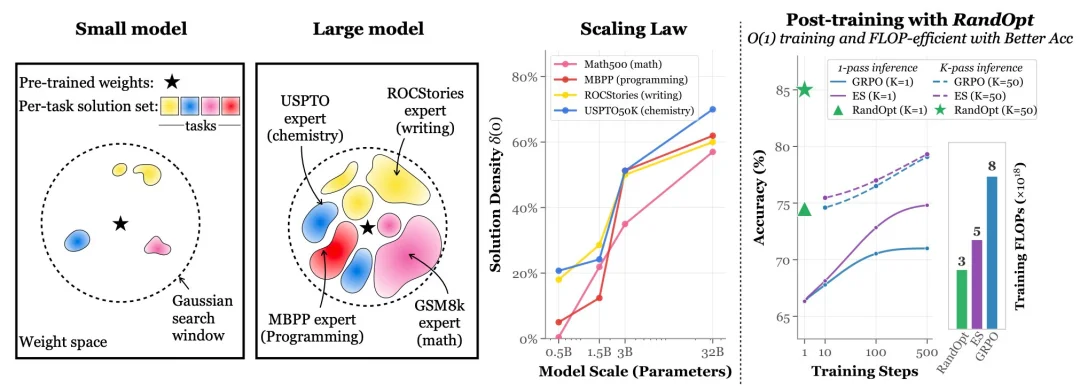

论文指出,模型规模决定了这些专家在参数空间中的分布形态:

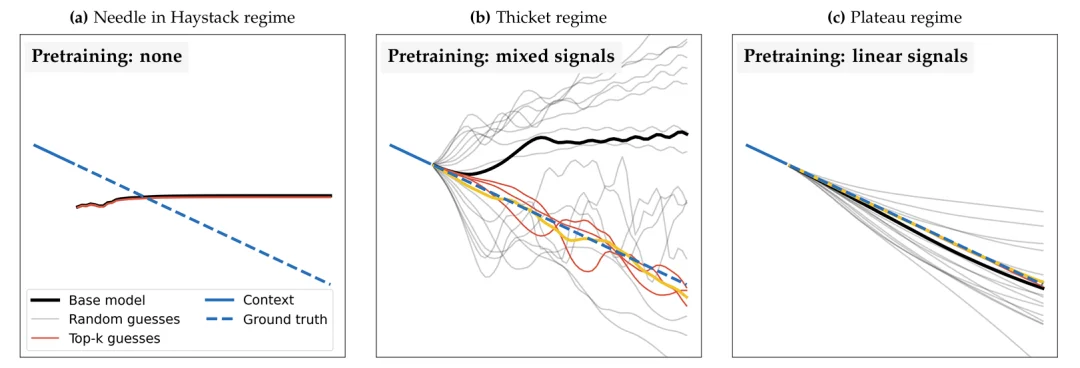

小模型(左)的大海捞针机制与大模型(右)的神经丛林机制示意图。大模型周围充满了代码专家、数学专家等特定任务的解决方案集。

为了量化这一现象,研究测量了两个核心指标:

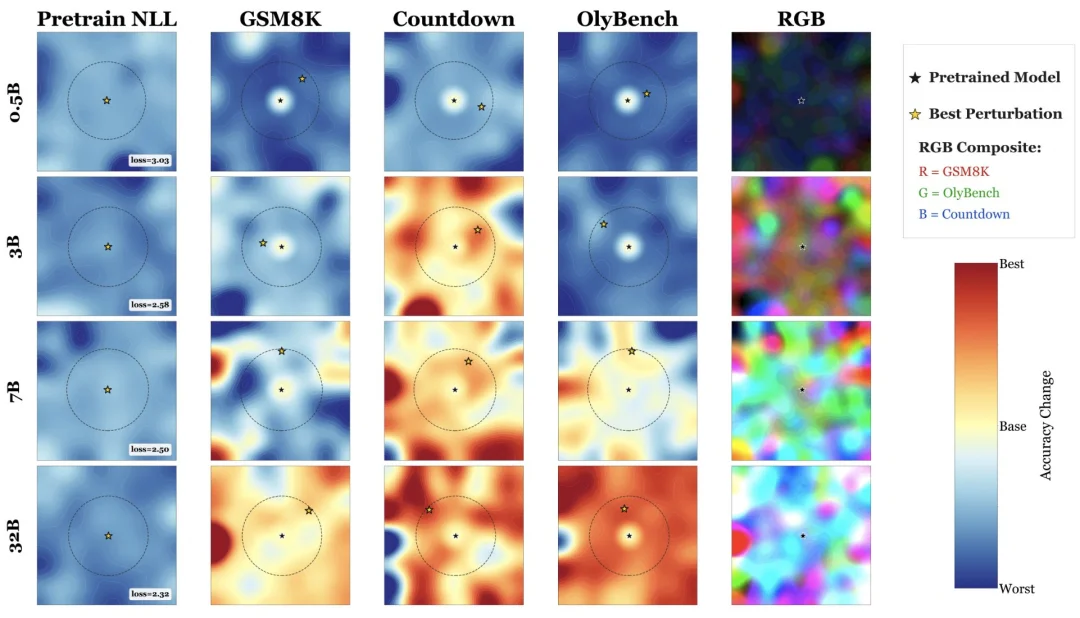

为了直观展示神经丛林的存在,研究团队对参数量从 0.5B 到 32B 的 Qwen2.5 预训练模型注入了 1000 个随机权重扰动,并通过随机投影技术将其准确率景观可视化到了二维平面上。

实验清晰地呈现了 Scaling Law:随着模型规模的扩大,景观中代表更高准确率的「红色区域」(即任务改善区域)显著增多并变得更加密集。

简而言之,大模型所处的参数空间不仅是一个宽阔的平原,其周围更是一个布满不同任务局部最优解的「盆地」。

那么,究竟是什么导致了这种奇特的「神经丛林」的涌现?

1D 信号预测实验揭示了这一现象的根本原因。研究者使用多层感知机(MLP)对混合的一维信号(如正弦波、方波等)进行自回归预测的预训练。通过对比不同预训练策略,实验揭示了三个阶段:

1D 信号预测实验展示了三种机制。只有在「混合信号预训练」下(图 b),权重扰动才会炸开成形态各异的函数预测,形成神经丛林。

这也解释了为什么在海量混合数据上预训练的大语言模型,会天然自带一片生机勃勃的「专家丛林」。

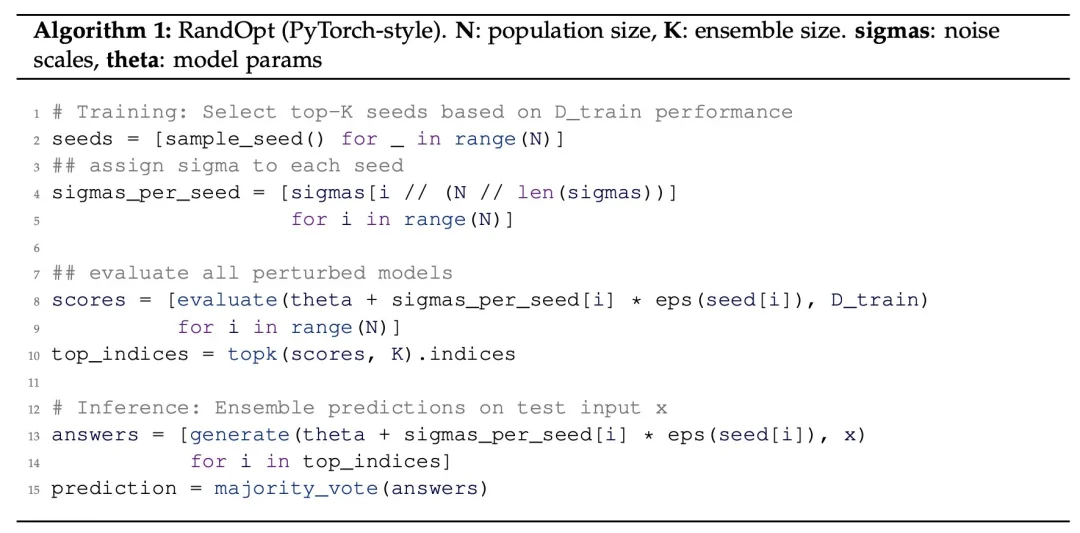

基于「密度高」且「多样性强」的神经丛林现象,作者探索了一种极其简单且完全并行的后训练算法 RandOpt。作者将其定义为:单步、无梯度、无学习率、无迭代、完全并行。

RandOpt 的操作避开了所有序列化的梯度更新,主要分为两个阶段:

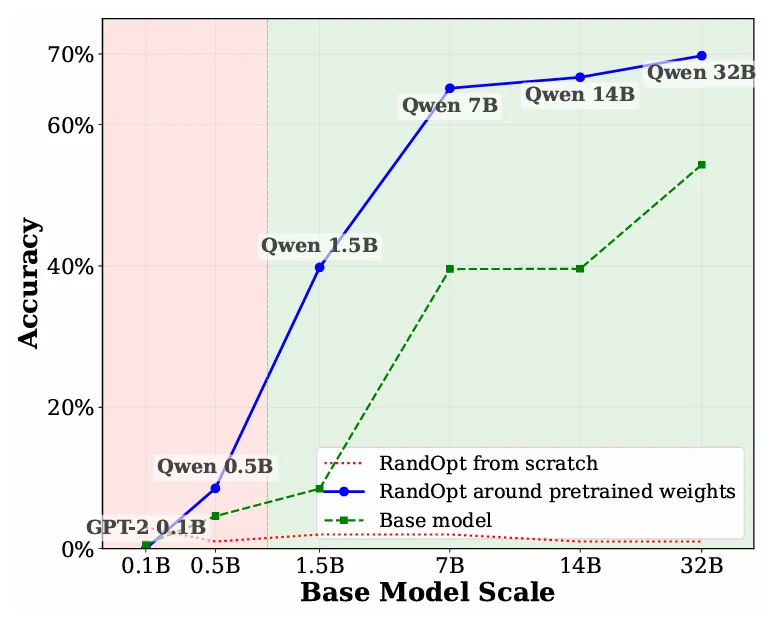

RandOpt 性能与基础模型规模的关系。图表显示,如果从头开始使用 RandOpt(不进行预训练),性能几乎为零;而对于经过预训练的模型,在参数量达到约 1.5B 时,RandOpt 的性能提升开始迎来爆发。

这种机制的一个关键特性是它完全不需要计算梯度,也不涉及任何序列化的优化步骤,所有的模型生成和评估都可以完全并行处理。

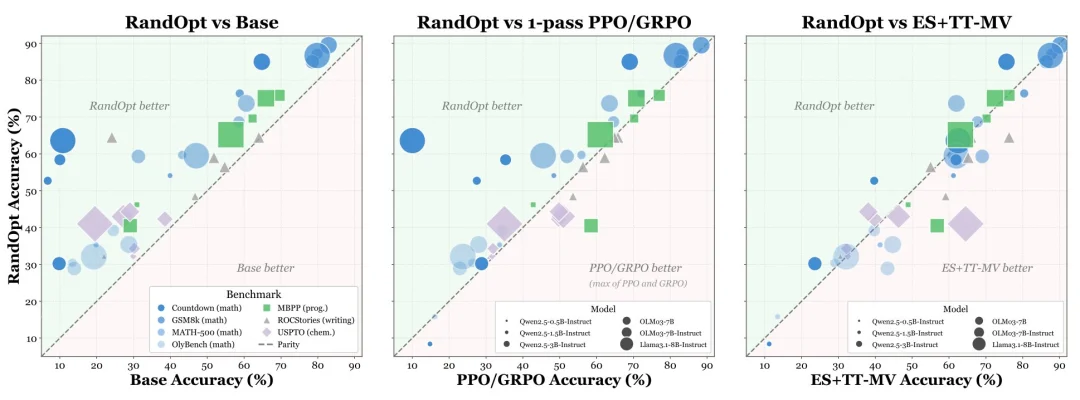

这种看似「简单粗暴」的方法,在实际基准测试中展现出了惊人的战斗力。研究团队在跨越 0.5B 到 8B 参数规模的多个模型(Qwen、Llama、OLMo3)上,对数学推理(Countdown、GSM8K 等)、代码生成(MBPP)、创意写作(ROCStories)以及化学(USPTO)任务进行了全面测试。

在消耗相同训练 FLOPs(浮点运算次数)的前提下,RandOpt(通常设置 K=50)在绝大多数设定中不仅追平,甚至超越了 PPO、GRPO 和 ES 等标准后训练方法。

此外,RandOpt 在训练时间(Wall-clock time)上具有颠覆性的优势。传统基准方法需要运行数百个序列化更新步骤(时间复杂度为 O(T)),而 RandOpt 的训练步骤是 O(1)。论文指出,在一组包含 200 个 GH200 GPU 的集群上使用 RandOpt 训练 OLMo-3-7B-Instruct 模型,设定 N=2000 和 K=50,仅需 3.2 分钟即可完成,并在 Countdown 任务上达到 70% 的准确率。

不仅是语言模型,RandOpt 同样适用于视觉语言模型(VLM)。在冻结视觉编码器、仅扰动语言模型权重的情况下,RandOpt 将 3B 参数的 Qwen2.5-VL-Instruct 模型在 GQA 视觉推理数据集上的准确率提升了 12.4%。

为了验证模型能力的真实来源,作者在 GSM8K 数据集上对性能提升进行了细致的错误归因分解。

数据表明,对于集成后达到 86.7% 准确率的 RandOpt(K=50),其提升中有 19.0% 来源于「格式丛林」(Format Thicket)(即基础模型算对了,但输出格式不符合严苛的评估要求,扰动模型修正了格式);更重要的是,有 12.3% 来源于真实的「推理丛林」(Reasoning Thicket)(即基础模型原本算错,而扰动后的模型真正学会了正确的推理并得出正确答案)。这一结果有力地证明了,神经丛林中确实存在着掌握不同实质性技能的专家,而不仅仅是表面的格式微调。

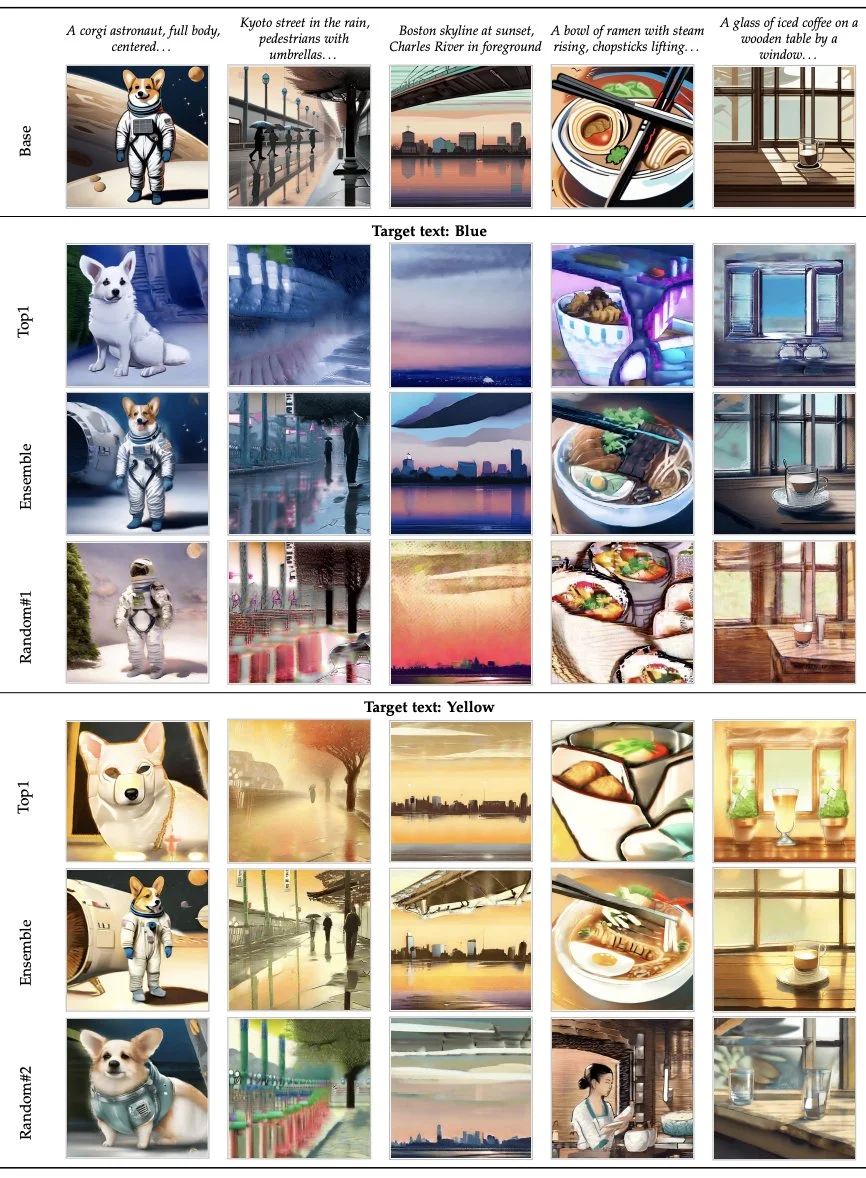

不仅如此,这种丛林现象在文本到图像生成领域(如 Stable Diffusion XL 模型)中表现为「色彩丛林」(Color Thickets)。某些参数空间的局部区域会优先生成具有特定调色板(如蓝色或黄色主导)或视觉风格的图像,展现出了极高的生成多样性。

RandOpt 在推理时需要进行 K 次前向传播,这对实际部署是不利的。为了解决这一问题,研究者提出了一种蒸馏方案:他们利用 RandOpt 筛选出的 Top-50 模型生成数万条包含推理轨迹的响应,然后从中挑选出基础模型容易出错的「困难样本」。接着,只对基础模型进行两轮监督微调。

实验结果令人振奋:在 GSM8K 上,蒸馏后的单一模型性能(84.3%)与庞大的集成模型(87.1%)极为接近,而这个蒸馏过程的计算成本仅占 RandOpt 训练成本的约 2%。

更多细节请参见原论文。

文章来自于“机器之心”,作者 “机器之心编辑部”。