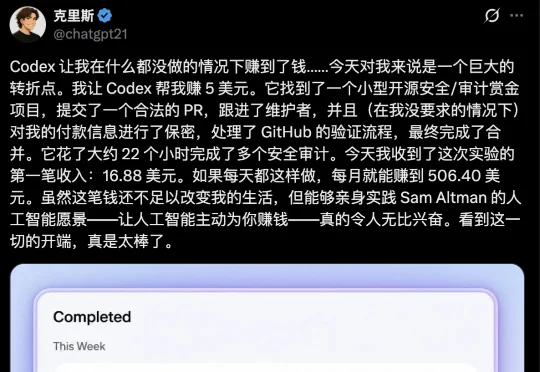

Codex跑了22小时,真赚16.88美元:奥特曼预言的「AI打工人」来了

Codex跑了22小时,真赚16.88美元:奥特曼预言的「AI打工人」来了一条「去GitHub上赚5美元」的指令,Codex跑了22小时,几天后带回16.88美元。钱不多,但如果Chris的复盘属实,AI第一次独立走完了找活、写代码、提PR、收款的完整闭环:AI会替你赚钱,这可能是第1单。

搜索

搜索

一条「去GitHub上赚5美元」的指令,Codex跑了22小时,几天后带回16.88美元。钱不多,但如果Chris的复盘属实,AI第一次独立走完了找活、写代码、提PR、收款的完整闭环:AI会替你赚钱,这可能是第1单。

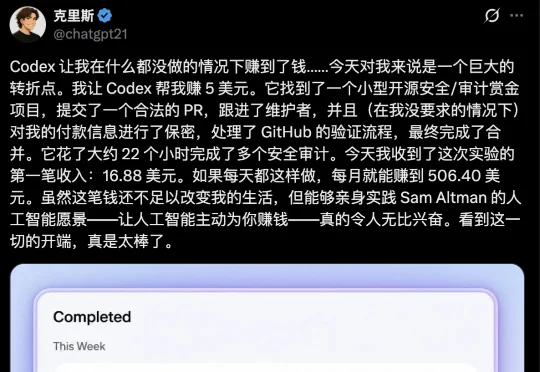

刚刚,宇树发布其首款载人变形机甲GD01。据称这是全球首款量产版载人机甲,可以变形,能作民用交通工具,载人后体重约500kg,售价390万元起。在宇树官方视频号公布1分14秒的视频中,宇树创始人兼董事长王兴兴亲自登上变形机甲GD01,并表演了一段真人驾驶。

这两天,最火的新闻就是美国战争部(五角大楼)把过去几十年的 UFO 档案全部「开源」了。

Markdown,当死。

2011年,Marc Andreessen写下“软件正在吞噬世界”。2026 年,Fortune用了一句话总结当前局面:“那个吃掉世界的东西,正在被吃掉。 ”

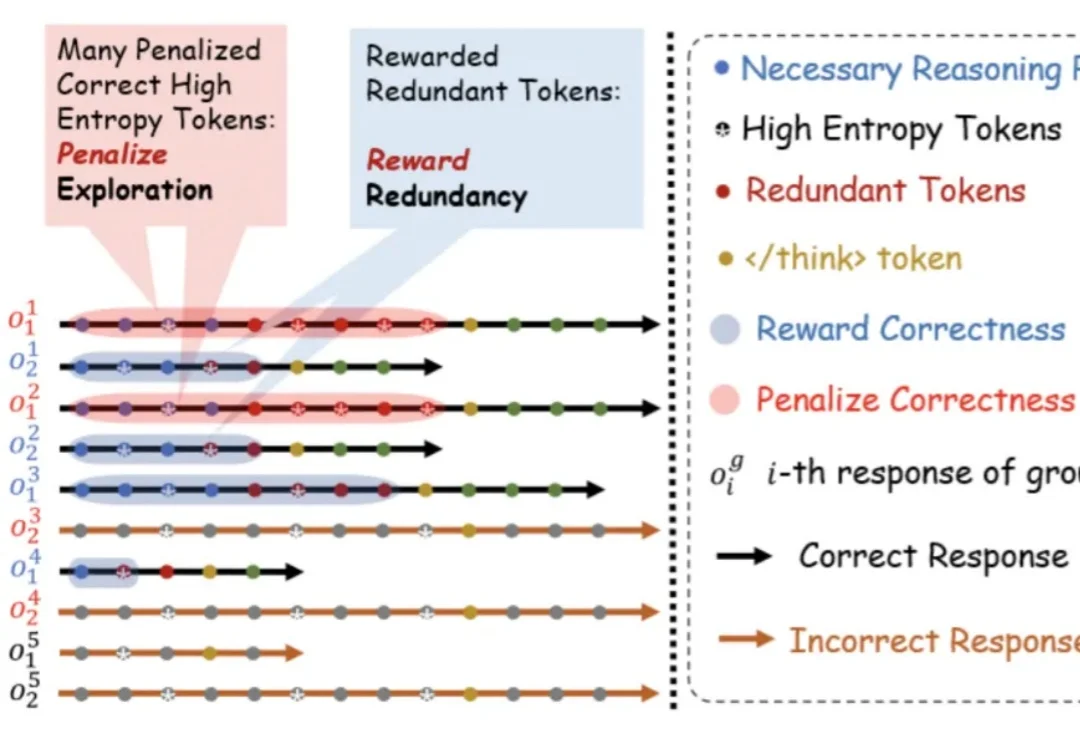

以 DeepSeek-R1、OpenAI GPT Thinking 为代表的大型推理模型,通过长达数千 token 的「思维链」在各类复杂推理任务中展现出卓越的性能。然而,这些模型普遍存在一个核心问题,即过度思考(overthinking) :

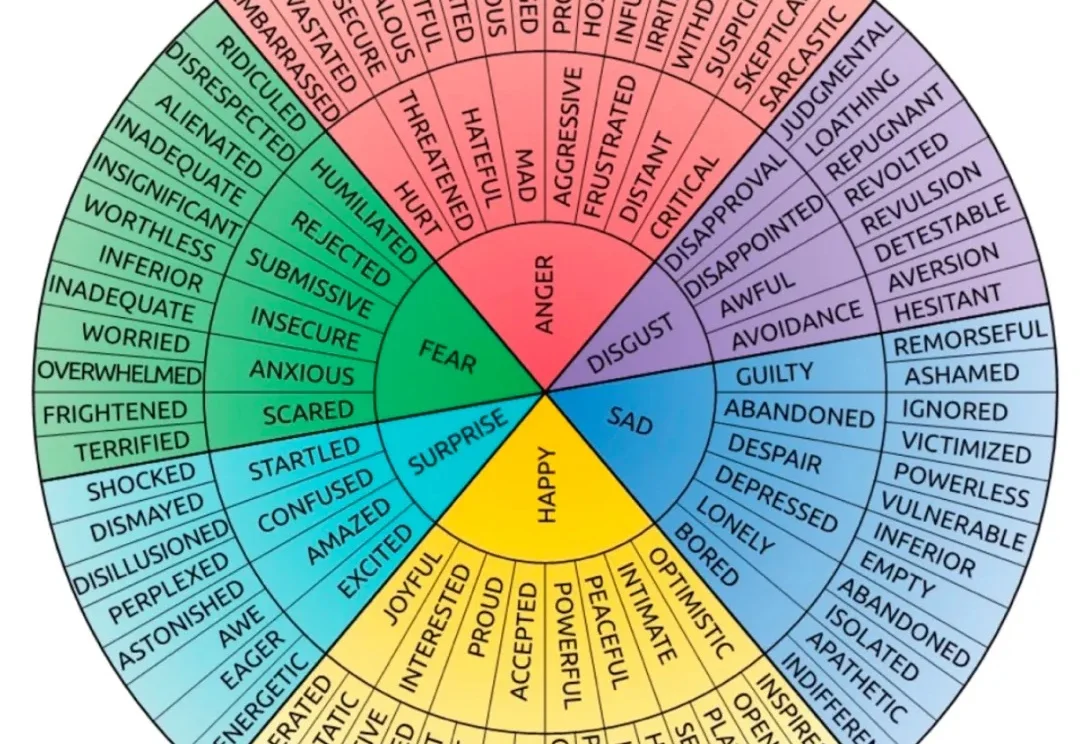

随着语音、视频、多模态能力不断融入大语言模型(LLM),人与 AI 的交互正在越来越接近自然对话。今天的 LLM 不再只是回答问题的工具,也越来越多地出现在教育、客服、陪伴、心理健康等高度依赖情绪理解的场景中。

大家好,我是袋鼠帝。 过去这一两年,AI 圈可谓是神仙打架,各种新概念、新模型、新应用天天刷屏。

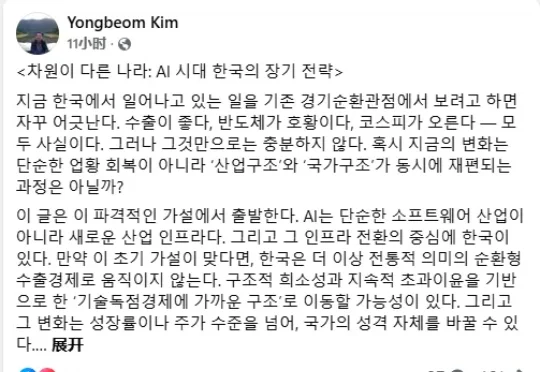

5月11日,韩国总统府(青瓦台)政策室长金容范(Kim Yong-beom)在其Facebook发文提出,应考虑设立所谓“公民红利”,资金来源为人工智能(AI)产业产生的超额利润。“人工智能基础设施时代的收益,并非仅由个别企业创造,而是源于整个国家在过去半个多世纪中所构建的产业基础。

「我即将离开麻省理工学院,不再继续攻读博士学位。人工智能的发展速度太快,人类已然难以跟上。