在自动驾驶、具身智能、AR/VR应用中做3D重建,大家都想解决一个终极问题:

模型能不能像人一样,一边往前看,一边持续构建三维世界?

但真做起来,这件事远比想象中难。

短序列或离线场景下,很多方法已经能取得不错效果;但一旦进入真实长视频、严格在线、未来帧不可见的设定,问题就会迅速暴露出来:

这正是长序列3D重建长期难以真正落地部署的核心原因。

在即将到来的CVPR 2026中,由香港科技大学(广州)与地平线等机构联合提出的LongStream,正是为了解决这一问题而来。它不是一个只在短序列上“看起来不错”的方法,而是一个围绕长序列、严格在线、实时流式推理重新设计的3D视觉模型。目前,论文、代码和交互式Demo已全部开源。

这项工作的几个核心亮点非常直接:

18 FPS流式自回归推理

支持公里级超长序列

实现稳定的米制尺度重建

支持上千帧序列的稳定重建

换句话说,这项工作的重点不是“离线把结果磨漂亮”,而是:

让3D重建真正具备了长时间在线运行的系统形态。

它到底解决了什么问题?

在3D视觉领域,超长序列的流式重建一直是一个公认的难题。现有的自回归(Autoregressive)模型在处理长序列时往往会遭遇“滑铁卢”,主要原因在于:

1. 第一帧锚定依赖:主流方法通常将相机位姿绑定到第一帧。训练时只见短序列,推理时却要滚动处理长序列,这种训练—推理错位会不断放大外推误差,最终导致退化甚至崩溃。

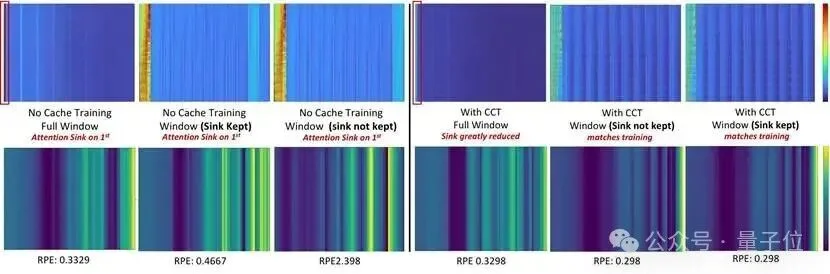

2. 注意力陷阱(Attention Sink):模型会像大语言模型一样出现attention sink,注意力异常沉积在首帧token,而不是对重建更关键的时空邻近帧,从而违背局部几何约束。

3. KV cache缓存污染:长期累积的KV cache会带来表征污染、记忆饱和和几何漂移,进一步拉低长序列重建精度。

在严格在线设定下,模型不能偷看未来,也不能随时回头做全局优化,它必须在历史受限、误差不可撤销的条件下持续前滚。只要位姿锚定方式、尺度建模方式、缓存训练方式有一个地方设计不对,长序列就会很快崩掉。

(图1:基线方法存在明显的attention sink现象,模型过度关注第一帧,而忽视了与局部几何一致性更相关的近期帧。这种不平衡会导致RPE快速增长,并削弱长程预测稳定性。)

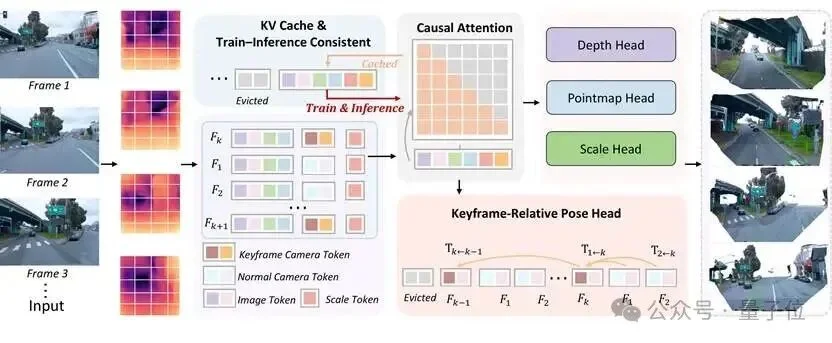

(图2:LongStream整体框架。模型在严格在线设定下持续预测位姿、深度、pointmap与全局尺度。)

为了解决上述问题,LongStream提出了一种全新的Gauge-decoupled流式视觉几何架构,核心包括三点:

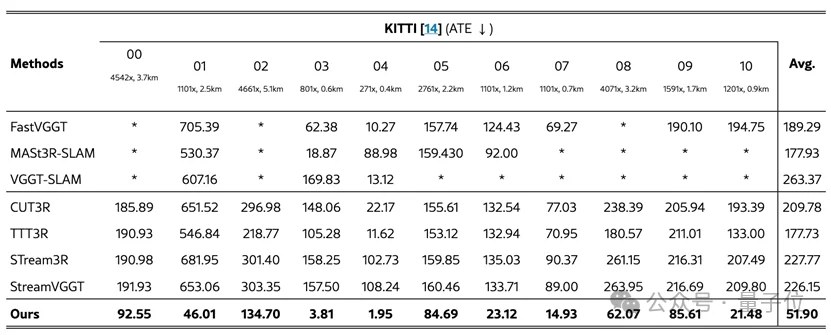

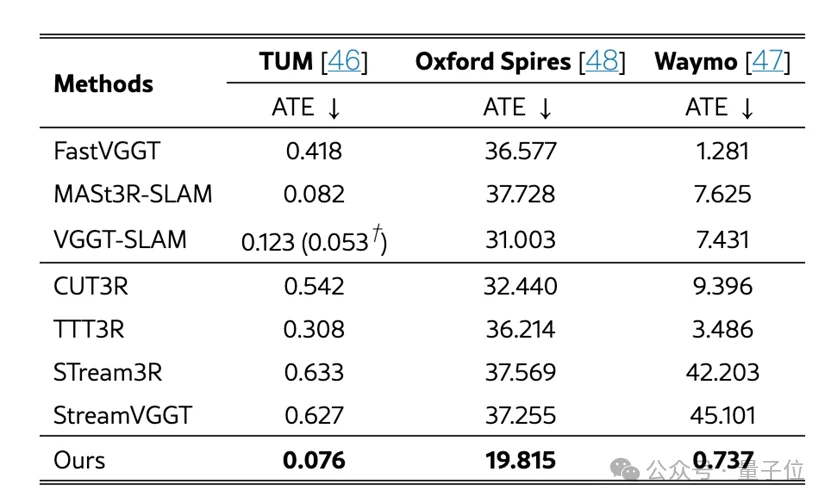

在KITTI、Waymo、TUM-RGBD等多个室内外基准测试中,LongStream都表现出了非常强的竞争力:

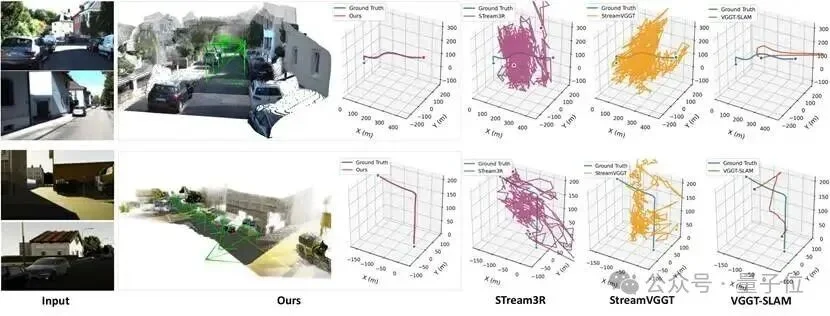

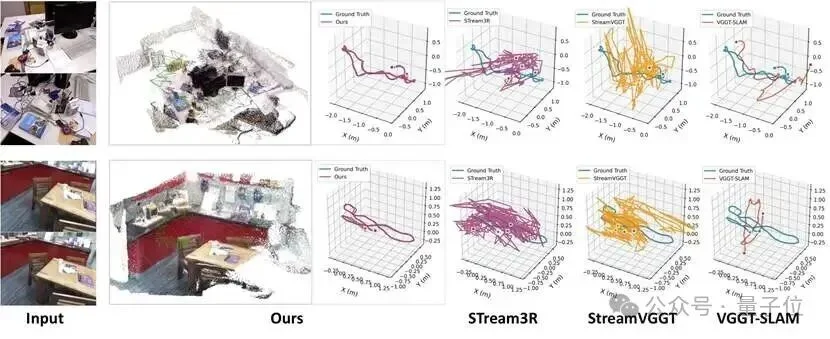

(图3:KITTI场景下的可视化对比结果。其他方法随着序列变成出现了跟丢或者崩溃的现象,而LongStream保持稳定。)

(图4:室内场景下的可视化对比结果。即使在更复杂的室内环境中,LongStream依旧保持稳定。)

(图5:KITTI场景下的ATE对比结果。随着行驶距离增加,传统方法的误差迅速放大,甚至出现跟丢,而LongStream始终保持较低的轨迹误差和稳定的米制尺度。)

(图6:其他数据集上的ATE对比结果。LongStream在多个基准测试中都保持了很强的竞争力。)

从系统角度看,LongStream其实更像“在线世界建模引擎”,不再把3D reconstruction当作一个静态任务,而是

持续更新的在线三维世界建模。

它不是只输出某一时刻的单帧深度,也不是离线做完再统一拼接,而是在不断接收新观测的同时,维护全局三维状态。

为什么这件事重要?

因为未来很多视觉系统都不需要“看完再算”,而需要“边看边建”。比如:

这些场景的共同要求不是某一帧精度极高,而是:

系统要能长期稳定、实时更新、资源可控。

LongStream的意义就在这里:它展示了一条更接近真实部署约束的3D视觉范式,不是一次性重建一个场景,而是持续维护一个世界。

LongStream的价值,不只是把分数再往前推了一点,而是把流式3D重建真正推进到了严格在线、单卡友好、上千帧稳定、公里级可扩展的新阶段。

当3D视觉开始从“离线重建”走向“在线世界建模”,这类工作会变得越来越重要。对于机器人、自动驾驶和embodied AI而言,LongStream提供了一条值得持续关注的技术路径。

论文题目:

LongStream: Long-Sequence Streaming Autoregressive Visual Geometry

论文链接:

https://arxiv.org/abs/2602.13172

项目主页:

https://3dagentworld.github.io/longstream/

文章来自于“量子位”,作者 “LongStream团队”。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md