王云鹤今日在朋友圈官宣,将辞去华为诺亚方舟实验室主任职位,告别华为。

从 2025 年 3 月到今天,王云鹤恰好全面执掌了诺亚方舟实验室整整一年。

华为诺亚方舟实验室,是华为乃至中国的 AI 研究重镇。

其人其事

王云鹤本科就读于西安电子科技大学数学与应用数学专业,毕业后进入北京大学智能科学系攻读博士学位,主攻深度学习、模型压缩、机器学习与计算机视觉等方向。

2018 年,王云鹤博士毕业。

彼时,深度学习浪潮正席卷整个信息技术领域,模型压缩(即如何以更少的参数和计算量实现相当精度)是业界最热门也最紧迫的课题之一。

王云鹤在北大期间系统研究了这一领域,积累了若干学术成果,随后顺理成章地走向了离这些成果最近的产业出口。

华为诺亚方舟实验室于 2012 年创立,隶属于华为总研究组织「2012 实验室」,是华为从事 AI 基础研究的实验室,研究领域覆盖计算机视觉、自然语言处理、搜索与推荐、决策与推理、人机交互、AI 基础理论等。

这里聚集着中国企业 AI 研究院中最高产的一批的论文产出者,也是在华为内部最接近「纯研究」的一片土地——尽管「纯研究」在任何一家以商业为根本的科技公司里,始终难逃周期性的质疑与审视。

博士毕业当年,王云鹤正式加入华为诺亚方舟实验室,担任高级工程师,并于 2020 年开始担任该实验室技术专家。

在这段积累期里,王云鹤并未让自己的名字在论文列表里消失。

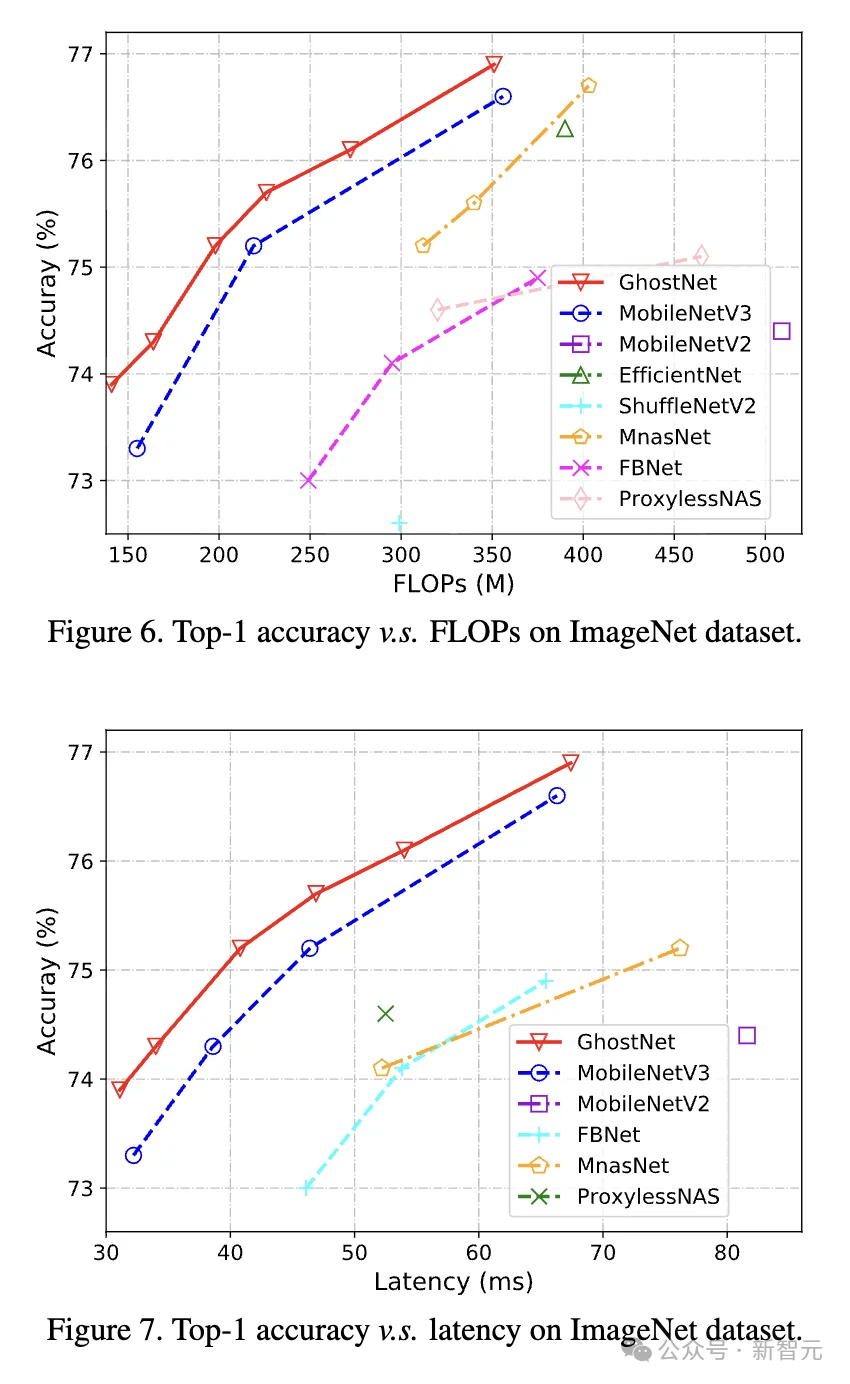

他参与提出的 GhostNet 轻量级神经网络架构于 2020 年被 CVPR 接受,该架构可以在同样精度下,速度和计算量均少于此前 SOTA 算法,成为业界引用颇广的端侧模型方案。

https://arxiv.org/pdf/1911.11907

与此同时,他参与研发的 AdderNet(加法神经网络)在深度学习中以纯加法运算代替乘法,理论上可大幅降低 AI 芯片的运算功耗,也在同年 CVPR 上以口头报告形式发表,引发了不小的学术讨论。

https://arxiv.org/pdf/1912.13200

两篇论文在同一年同一顶会亮相,论文数量的密度令人印象深刻。

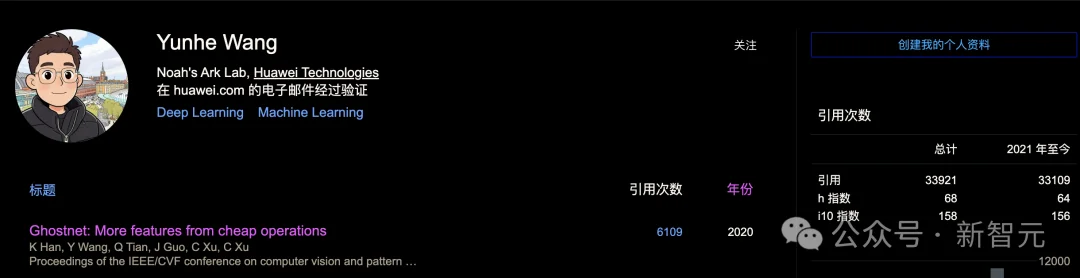

他已在相关领域发表 CCF-A 类学术论文 70 余篇,涵盖 NeurIPS、ICML、CVPR、ICCV、IEEE TPAMI 等顶级会议与期刊,并曾担任 NeurIPS 和 ICML 的领域主席,以及 VALSE 的高级领域主席。

70 余篇顶会论文,平均摊开来是每年将近 10 篇的节奏,这个数字在学术界无论如何都称得上高产。

当然,高产既可以是深度思考的结晶,也可以是高效运转的流水线。

这些论文帮助王云鹤在国内外 AI 学术共同体中建立了相当的可见度,为他日后更大舞台的登场打下了足够厚实的名片底色。

核心突破

王云鹤的研究路线,始终围绕一个听起来朴实、做起来极难的命题:如何在有限算力下让 AI 跑得更快、更省。

这一思路与华为在芯片供应受限背景下的现实处境高度吻合——当高端 GPU 的获取通道相继收窄,算法效率的每一寸提升都不再只是学术指标,而是直接换算成可量化的战略价值。

王云鹤就任华为算法应用部部长后,负责高效 AI 算法的创新研发以及在华为业务中的应用,并凭借「大幅提升算力的高效能乘法器和加法神经网络」获选华为第四届「十大发明」。

华为「十大发明」是一项内部评选奖项,由华为自己设立、自己评审、自己颁发。

对于获奖者而言,它代表着公司层面的高度认可。

这枚勋章帮助王云鹤在华为内部的晋升路径上踩实了关键一步。

相比内部的荣誉,他与团队在中国天眼上的工作更具说服力。

他和团队开发的高效 AI 算法,应用于中国天眼 FAST 的观测工作中,协助中科院国家天文台专家发现了数百个新的快速射电暴样本。

快速射电暴是宇宙中最神秘的瞬变现象之一,每次爆发仅持续数毫秒,在海量射电数据中如同大海捞针。

将高效算法嵌入基础天文学研究,是一次真正意义上的学科跨界——在这里,王云鹤团队的工作没有商业 KPI 的框架,有的只是数据、信号与星空。

2023 年底,华为诺亚方舟实验室与北京大学等机构联合提出了「盘古 π」网络架构,尝试构建更高效的大模型架构,以解决 Transformer 架构中非线性能力不足的问题,显著降低特征塌陷,王云鹤在此论文中署名第一作者。

https://arxiv.org/pdf/2312.17276

Transformer 架构自 2017 年提出以来,已成为几乎所有大语言模型的骨干。

随着模型规模的暴力扩张,深层特征趋于同质化的「特征塌陷」问题日益凸显。

盘古 π 提出了新的激活机制与结构设计,在一定程度上为华为的盘古大模型系列提供了理论支撑,也在学术层面确立了王云鹤作为大模型架构研究者的位置。

第一作者的署名,将这篇论文与他的名字牢牢绑定——在竞争激烈的顶会发表圈,对第一作者之争的敏感程度,往往不亚于商场里的利益博弈,只是后者更少被公开谈论。

登顶掌舵

2025 年 3 月,华为诺亚方舟实验室进行人事调整,原主任姚骏内部转岗,实验室主任一职由王云鹤接任。

姚骏

彼时,他年仅 33 岁。

在中国科技企业的管理层叙事里,「90 后掌门人」是一个被反复使用的修辞,兼具媒体友好度与人才自信的双重功效。

王云鹤的晋升速度确实不慢:从 2018 年的博士应届生,到 2025 年的实验室主任,七年时间完成了从高级工程师到技术专家、再到算法应用部部长、最终执掌诺亚方舟的全程攀升。

这条路走得流畅,几乎没有停顿。

流畅的晋升路径,有时意味着出色的能力,有时意味着精准的站位,有时两者皆有,旁人通常难以精确区分。

王云鹤的崛起折射出中国科技企业的代际传承规律。

相较于前辈学者型管理者,新生代技术领袖普遍具备「学术根基+产业实战」的双重基因。

他的前任姚骏曾主导盘古 α 的研发,在那个以参数规模论英雄的时代留下了清晰的历史坐标。

而王云鹤接任之后,迅速以盘古大模型 5.5 系列的发布宣示了自己的存在。

他介绍,盘古 5.5 在长序列处理、低幻觉生成、自适应快慢思考、Agent 能力等方面进行了创新,重点面向企业级实用性与可控性。

这些技术关键词排列在一起,构成了一份面面俱到的发布词。

在自然语言处理领域,盘古发布了 718B 参数的超大 MoE 模型「Pangu Ultra」,由 256 个专家组成,激活参数量为 39B,借助「通算掩盖」、「MoGE 专家路由」以及三明治架构等技术,实现了训练效率、推理吞吐和模型精度的大幅提升。

718B 的参数量在大模型军备竞赛的数字谱系里已属顶端。

从加法神经网络到盘古 π,从 GhostNet 到天眼快速射电暴,再到接掌诺亚方舟,王云鹤的职业轨迹描绘出一条完美的上升曲线——技术积累、荣誉加冕、学术背书、组织掌舵,每一个节点都踩得恰到好处,每一次亮相都备好了可供引用的成果清单。

在一个需要不断自我营销的时代,这种精准的节奏感本身就是一种能力。

只是,一所真正意义上的基础研究实验室,最终检验的从来不是履历的完整度,而是那些无法在新闻稿里被简洁概括的、真正漫长而寂寞的科学贡献。

据悉,王云鹤的下一站,是 Agent 创业。

诺亚方舟实验室和王云鹤后续会诞生哪些变化,让我们拭目以待。

参考资料:

https://www.linkedin.com/in/yunhewangpku/

https://scholar.google.com/citations?user=isizOkYAAAAJ&hl=zh-CN&oi=ao

https://www.zhihu.com/search?q=%E7%8E%8B%E4%BA%91%E9%B9%A4

https://www.zhihu.com/question/658401579/answer/2002073924675060532

文章来自于微信公众号 "新智元",作者 "新智元"

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md