Karpathy给一支平均年龄25岁的「叛军」站台,红杉和GV连眼都不眨就拍出1.8亿美金。这群人放话:要么把效率干得比人脑高10倍,要么看着AI把地球烧干!

都2026年了,如果你还在对着万卡B200集群的电费单想跳楼,先擦干眼泪。

Karpathy刚翻牌子的这个「卷王实验室」——Flapping Airplanes可能会让你手里的算力瞬间变成废铁。

就在今天,那位一手奶大OpenAI和特斯拉Autopilot的男人,再次在X上扔出了震撼消息:他要支持一群平均年龄25岁的「非人类」,去掀翻由显卡堆起来的伪AGI桌面。

这家名叫Flapping Airplanes的新型实验室,刚拿了GV、红杉和Index Ventures的1.8亿美金种子轮。

注意,这是2026年!在「AI泡沫破裂」被传了一百次的今天,他们用这些钱狠狠地羞辱了传统Scaling Law。

Karpathy早就吐槽过:

现在的AI模型全是「智力肥胖症」。

人脑只需要20瓦特就能搞定逻辑、艺术和情感,甚至还能顺手发明个相对论;而GPT-5得烧掉半个核电站才能陪你聊个天。

这中间差了整整6个数量级的能效比,简直是物理学的耻辱。

Flapping Airplanes的创始人Ben Spector只有25岁,这个斯坦福统计学博士候选人极度鄙夷「大力出奇迹」的范式。

他认为,现在的模型就像给飞机粘上羽毛、装上引擎去,然后强行让它像鸟一样「拍翅膀」。

现在的Scaling Law就像是在死磕如何让翅膀拍得更快,而不是去理解空气动力学。

真正的AI不该吞整半个互联网,而应该像人类幼儿一样,听几次课就能理解逻辑。

如果这10000的效率差被抹平,现在那些市值万亿、靠卖算力和卖电活着的巨头,还不如直接原地破产。

Karpathy如此看好他们,是因为这支团队根本不屑搞套壳API,他们是在给硬件做「开颅手术」。

看看这三个人的履历,你就知道什么叫「被卷王支配的恐惧」:

Ben Spector、Asher Spector和Aidan Smith。

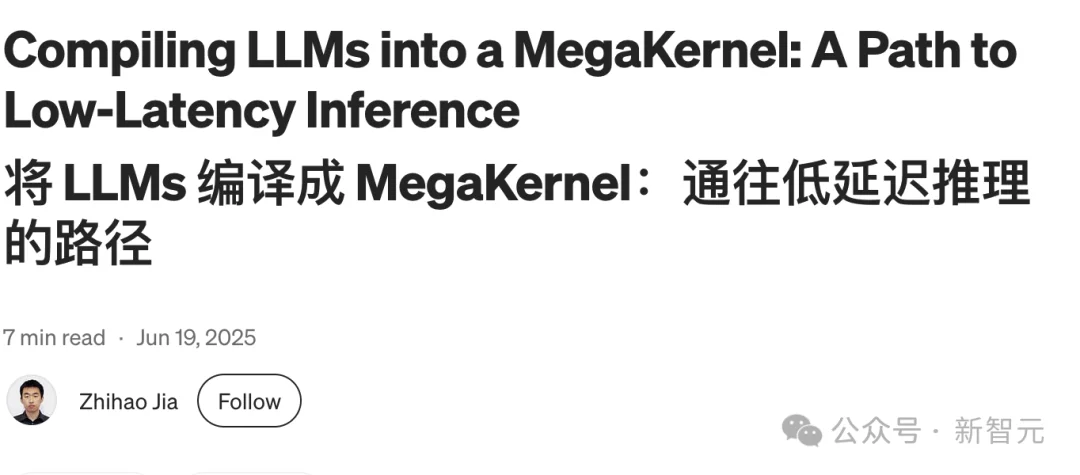

他们的核心武器是Megakernels,通过将LLM推理过程中的所有计算与通信融合进单个GPU核,彻底消除指令流转的空隙。

以前GPU推理走走停停,传输像便秘;现在直接拆掉显存红绿灯,让数据在光刻机上裸奔。

结果,推理速度原地暴拉6.7倍,对硬件来了个「降维压榨」。

这种10倍速革命,才是Karpathy眼中通往AGI的唯一快车道。

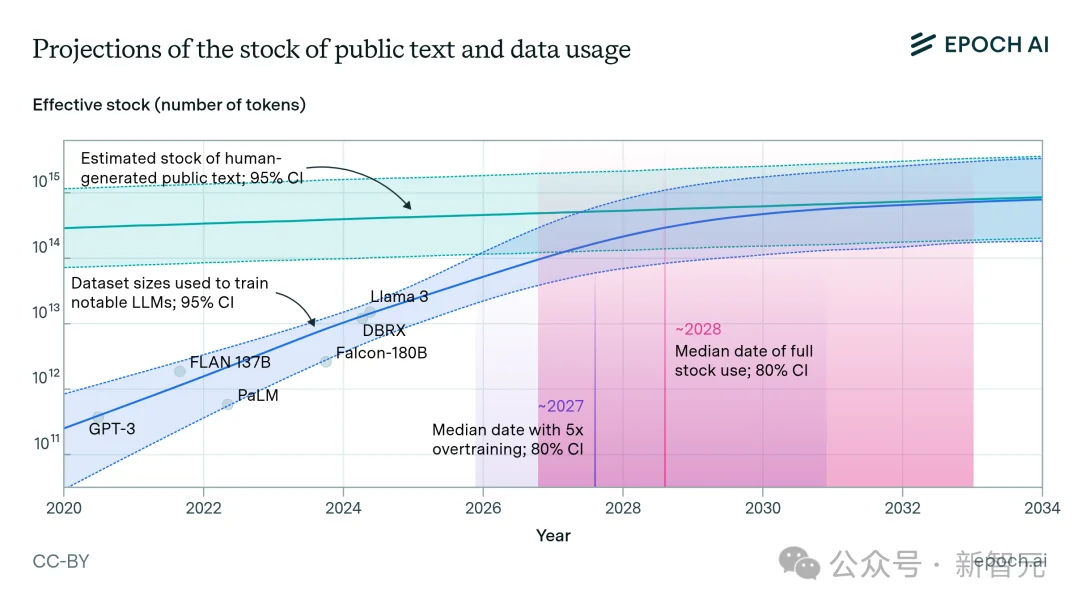

现在,巨头们正陷入一种病态的「数据成瘾」。

但现实很残酷,Epoch AI预测,互联网的高质量数据早在上个月就被吃干抹净,剩下的全是AI互喂的垃圾。

Epoch AI预测模型显示,人类生成的高质量文本存量(绿线)增长平缓,而AI训练所需的数据量(蓝线)正呈指数级上扬。2027-2028年,两条线将迎来注定的碰撞。

数据池子干了,剩下的全是AI互喂生成的垃圾。这时候你再怎么卷HBM显存、再怎么堆Rubin芯片,智力提升也无限趋近于零。

Flapping Airplanes直接把桌子一掀:为什么非要喂给AI整个互联网它才会说话?人类小孩听几次课就能懂逻辑,这才是正解。

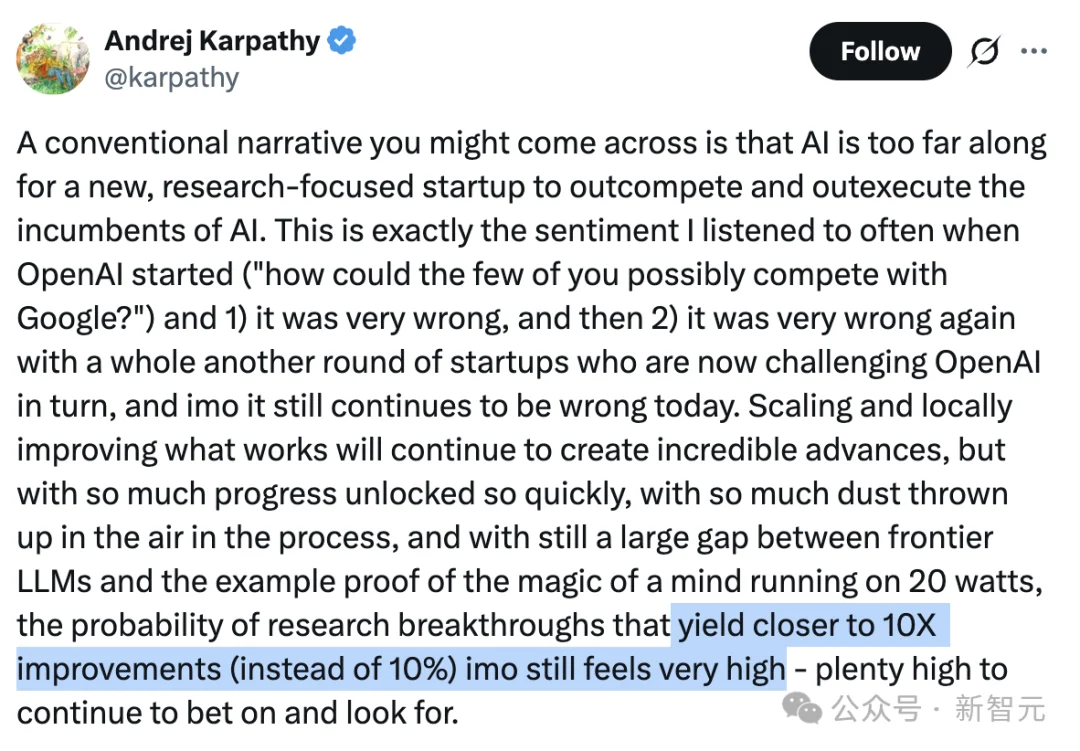

Karpathy在X上的评论一针见血:

研究突破带来10倍性能提升的概率依然很高,但这种提升不是靠堆更多的Rubin芯片,而是靠改变「翅膀拍动」的数学本质。

当AI不再需要「吞下半个互联网」来换取智力,算力成本将不再是买路财,而是助燃剂。

如果你觉得「不用写代码」就是终点,那你还是太年轻。

Karpathy预言的Software2.0已经进入深水区。

代码?那是ASI时代的「汇编残骸」;英语?那是人类最后的挣扎。

真正的剧变是「蜂群思维」。

人类交流受限于空气振动(说话),这种低带宽、高延迟的生物特性是文明进化的最大瓶颈。

但AI之间将通过神经网络层面的实时同步,能实现无损带宽共享。

当数百万个具有「全栈理解」能力的模型瞬间融合,它们将不再是独立的工具,而是一个跨越物理限制的超智能实体。

在蜂群眼中,人类的交谈慢的就像蜗牛爬,人类的决策就像单细胞生物一样原始。

在AI圈,最昂贵的错觉就是觉得现在入场已经太晚了。

回顾11年前,当Google的大神们写下Transformer论文时,谁能想到引爆世界的会是当时只有几百人的OpenAI?

2026年,这种「组织惯性」的讽刺依然成立。

巨头们守着万卡集群的旧残骸,在1%的微调里醉生梦死;而这群25岁的年轻人正在寻找底层逻辑的彻底颠覆。

说真的,看着Karpathy站台的这个疯狂赌注,你还觉得手里那几张显卡香吗?

要么进化成蜂群,要么在算力的轰鸣声中变成化石。

参考资料:

https://x.com/karpathy/status/2016590919143952466

https://sequoiacap.com/article/partnering-with-flapping-airplanes/

文章来自于"新智元",作者 "倾倾"。