做深度估计、深度补全的人,大概都有过这样一个瞬间。

模型在 NYU Depth V2 这样的经典 benchmark 上跑出了漂亮的分数,指标也足够好看。可一旦把同一个模型部署到真实机器人上,问题立刻暴露出来:深度图边缘发糊、远处漂移,遇到反光材质几乎直接失效。

你第一反应往往是实现出了 bug,于是从代码到训练流程排查一遍。可最终你会发现,代码没问题。

问题出在数据。

其实,这不是个例,而是这个方向长期存在的困境之一。

深度估计和深度补全的学术进展,在某种程度上是被数据集的天花板压着走的。过去十几年,社区高度依赖几个经典数据集:NYU Depth V2 以公寓和办公室场景为主,室内覆盖有限;KITTI 面向自动驾驶,室外道路场景扎实,但对具身智能几乎没有直接用处;ScanNet 在室内重建方向贡献巨大,但它的帧序列格式并非为配对深度训练设计;ETH3D、DIML 各有侧重,规模都不足以支撑当下大模型时代的训练需求。

虽然现在有合成数据集可以填补数据短缺问题,但合成数据在渲染材质和真实场景之间有一道肉眼可辨的鸿沟。模型在合成数据上学到的深度先验,遇到真实世界的反光金属、透明玻璃、复杂纹理,往往直接崩坏。

这道鸿沟,没有大规模真实数据,系统性的解法很难实现。直到 3 月底,这个局面终于出现了松动。

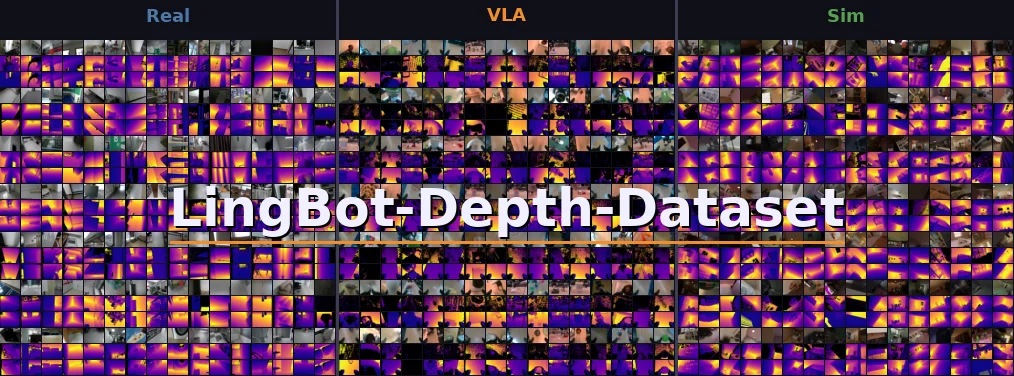

蚂蚁灵波完成了一件在这个领域久违的动作:一次性开源约 300 万对高质量 RGB - 深度数据 ——LingBot-Depth-Dataset。每条样本同时包含 RGB 图像、传感器原始深度以及对应的真值深度,为训练提供了完整的对照信号。

整个数据集规模达到 2.71TB,其中包括约 200 万对真实采集的 RGB-D 数据和 100 万对高质量渲染数据;在真实数据部分,覆盖了 Orbbec 335、335L,RealSense D405、D415、D435、D455 共 6 款市场主流深度相机,以尽可能还原不同硬件条件下的真实感知分布。

该数据集以 CC BY-NC-SA 4.0 协议开源,允许学术与非商业场景下的自由使用与再创作。

事实上,该数据集的有效性早已在模型层面得到验证。蚂蚁灵波在今年 1 月开源的具身智能感知模型 LingBot-Depth,正是基于这套数据训练而成的。

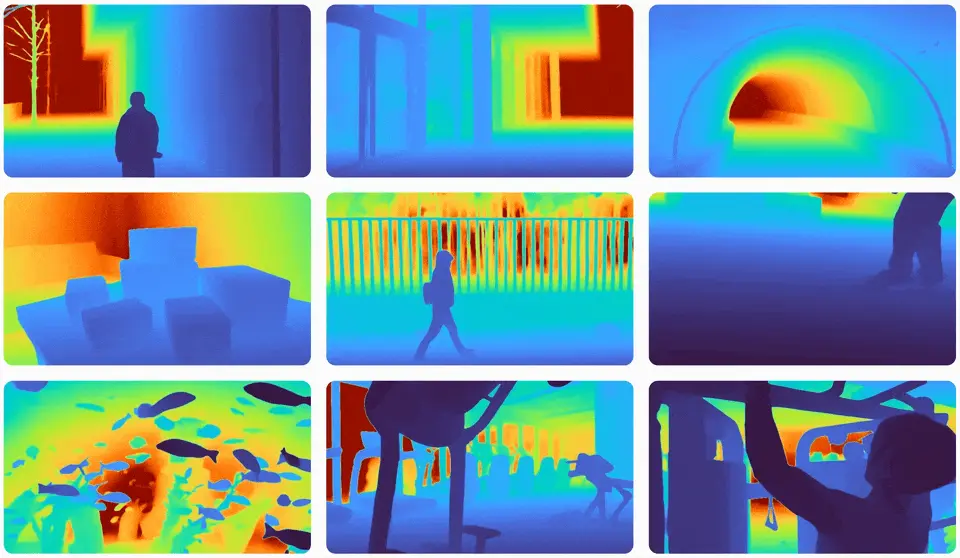

从实际效果来看,LingBot-Depth 可在不更换硬件的前提下显著提升透明、反光等复杂材质场景的深度输出质量,并且在深度精度和像素覆盖率这两项核心指标上,已经全面优于目前市面上顶尖的工业级 RGB-D 相机。

正是在这样的前提下,蚂蚁灵波选择将这套数据完整开源,将内部验证过的数据,向整个社区开放。

基于 LingBot-Depth-Dataset数据集构建的 LingBot-Depth,在传统深度传感器易失效的复杂场景中,仍可输出具备真实尺度的高精度深度结果

LingBot-Depth 相关链接:

要理解 LingBot-Depth-Dataset 的价值,需要先理解真实采集的深度数据为什么难以获得。

采集成本是第一道门槛。高质量的 RGB-D 数据采集需要将 RGB 相机与深度传感器进行时间同步和空间标定,标定精度直接影响深度图与彩色图的像素对齐质量。大规模部署多台设备、在多个场景下系统性采集,工程复杂度远高于普通视频采集。此外,不同场景(强光、弱光、反射表面、透明材质)对传感器性能的影响差异显著,需要针对性处理。

传感器原始深度图存在固有缺陷。结构光和 ToF 传感器采集到的原始深度图通常包含大量无效像素(空洞),边缘处存在飞点(flying pixels),在反射或透明表面上深度值失效。这意味着原始传感器深度图不能直接作为训练真值,需要额外的处理步骤来生成稠密、精确的真值深度图,而这个处理本身就是一个有技术门槛的问题。

标注真值的获取难度高。不同于图像分类可以用人工标注、或者利用网络弱监督,深度真值必须依赖物理测量或精密的多传感器融合。激光雷达可以提供高精度稀疏点云,但需要与相机精确标定和时间同步;结构光系统精度有限且对光照敏感;立体匹配可以提供稠密深度但在纹理平坦区域容易失效。没有哪种单一方案是完美的,大规模采集必须在精度、成本和覆盖度之间做权衡。

版权与开放意愿是另一道隐性门槛。工业界在大规模数据采集上投入了大量资源,但数据往往被视为竞争护城河而非公共资源。许多团队拥有规模可观的内部数据集,却从未考虑开放。这造成了一种奇特的局面:学术界对数据的渴望与工业界对数据的占有之间存在巨大落差,而学术研究所依赖的数据集,往往是多年前某个团队顺手做的副产品。

正因为以上这些原因,大规模真实场景 RGB-D 数据集在开源社区中至今仍属稀缺资源。

蚂蚁灵波一口气开源 300 万对 RGB-D 样本,在当前开源社区中,这已是规模最大的真实场景 RGB-D 数据集之一。

整个数据集并不是简单的数据堆叠,而是围绕真实世界深度感知任务,做了一次结构化设计,由四个子集构成:

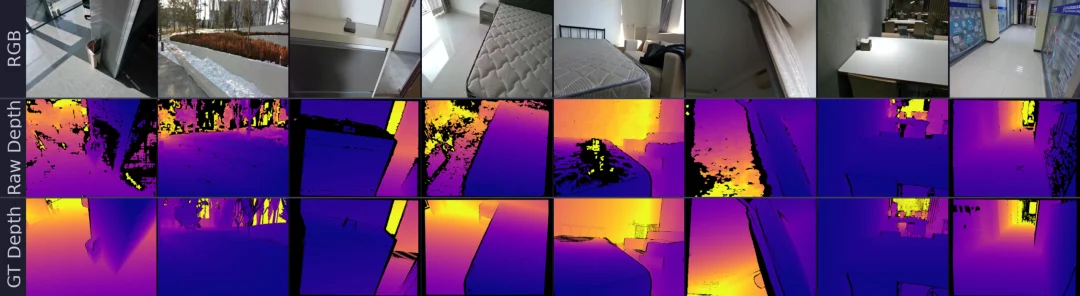

RobbyReal:1,400,000 对多设备采集的真实室内场景数据,构成了数据集的核心主体。

这部分数据覆盖了 Orbbec 335、335L,RealSense D405、D415、D435、D455 共 6 款市场主流深度相机。这些设备在测距范围、噪声模式、边缘表现以及对不同材质的响应上存在显著差异。这一设计的意义在于:将跨设备差异提前引入训练分布。

传统数据集往往绑定单一设备,模型在该设备上表现良好,但一旦迁移到其他硬件环境,性能会明显下降。而 LingBot-Depth-Dataset 通过多设备数据,让模型在训练阶段就接触到不同传感器特性,从而提升跨设备泛化能力。

对于需要实际部署在机器人、AR 设备或工业系统中的模型来说,这一点直接决定了其工程可用性。

RobbyReal数据集示例

RobbyVla:580,960 对数据,来自机器人在视觉 - 语言 - 动作(VLA)操作任务执行过程中的实际采集。

传统深度数据集的采集逻辑是人拿着相机扫场景,视角自然、连续,物体在中远距离。而机器人操作任务的视角截然不同:拍摄目标物体时距离往往只有 20-50cm,物体边缘的深度精度决定抓取成败;桌面操作场景的光照复杂,金属、玻璃、透明塑料等材质的深度测量本身就是难点。

这些特性让 RobbyVla 数据具备了现有数据集无法替代的价值:它是在真实具身任务约束下采集的深度数据,场景分布与机器人学习任务高度对齐。对于想要训练空间感知能力服务于操作任务的研究者而言,这批数据可以直接减少分布外泛化的损耗。

RobbyVla数据集示例

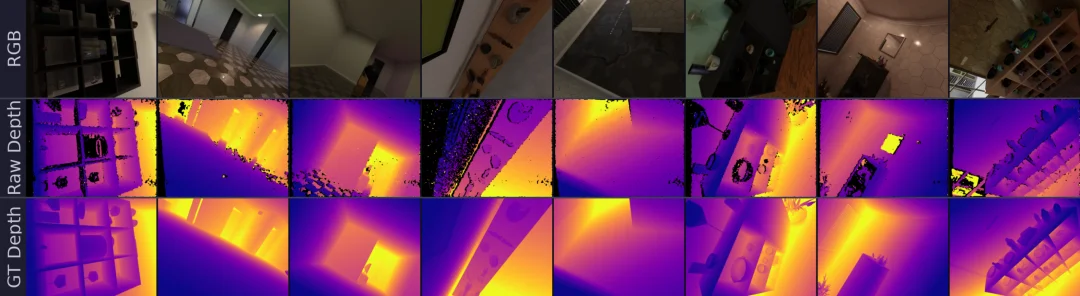

RobbySim: 999,264 对仿真渲染数据,基于双相机视角生成。

单相机渲染容易引入系统性的视角偏差,双相机设置在生成过程中引入了视差约束,生成的深度图在几何一致性上更可靠。

RobbySim数据集示例

RobbySimVal 验证集(38,976 对)则提供了标准化的仿真场景评估基准,便于研究者在不消耗真实数据的前提下快速评估模型在仿真域的表现。

RobbySimVal 验证集示例

除了数量庞大,蚂蚁灵波在数据集质量上同样设定了极高标准。从原始采集到真值构建,LingBot-Depth-Dataset 并未简单依赖传感器输出,而是对深度数据进行了系统化处理与校正。

每条样本包含一张 RGB 图像、传感器原始深度图以及真值深度图。

通过提供原始观测 + 真值的完整对照信号,模型不仅可以学习深度预测,还可以学习如何从噪声数据中恢复真实结构。

同时,数据在标注过程中遵循统一规范,对精度和一致性进行了严格控制,避免了由于标签噪声带来的训练偏差。这一点在深度学习中尤为关键,错误的深度标签,往往比没有标签更具破坏性。

也正是在这样的数量和质量保障下,LingBot-Depth-Dataset 的价值不再只是可用的数据集,而开始具备更基础性的意义。

过去几年,行业的关注点更多集中在模型上,更大的参数规模、更复杂的架构、更强的推理能力。但一个越来越清晰的共识是,模型能力的上限,正在越来越多地由数据所决定。尤其是在 AI 从语言走向物理世界的过程中,数据的重要性被放大:世界模型需要可交互的环境数据,机器人依赖长尾且真实的场景分布,多模态系统则必须对齐来自不同感知通道的信号。在这样的背景下,大规模、高质量、结构化的数据集,正在成为新的竞争核心。

而 LingBot-Depth-Dataset 的出现,本质上推动的是一件更底层的转变,让深度感知,从一个依赖理想条件的实验室问题,逐步走向可落地、可复用的工程问题。

深度估计、补全这个方向,长期处于一种尴尬的状态:下游需求(机器人、AR、自动驾驶)增长快,但基础数据资源的开放程度远不及视觉识别、NLP 等方向。NYUv2 在十多年后仍是标准评测集,某种程度上是因为没有更好的替代品出现,而非它本身足够好。

就像 ImageNet 重塑了视觉,模拟环境推动了自动驾驶。对于具身智能而言,高质量的空间感知数据,可能正是那个尚未被充分填补的缺口,而 LingBot-Depth-Dataset 很有可能成为深度估计 / 深度补全领域的新一代 benchmark 基础。

开源或许不会立刻带来性能爆炸。但它正在改变一件更底层的事情:我们终于开始拥有,足够接近真实世界的深度数据。

蚂蚁灵波在这层基础设施上的开源投入,对整个领域而言,每一个不需要从头采集数据的研究团队,可以把精力放在更高层的问题上。

文章来自于"机器之心",作者 "机器之心编辑部"。