在时间序列预测领域,深度模型如iTransformer、PatchTST虽然性能强劲,却长期困于“黑盒”困境——预测准,但说不出为什么。

传统可解释方法要么依赖后处理,要么与深度网络难以兼容,无法在不破坏原有架构的前提下提供清晰的决策依据。

针对此问题,上海交通大学联合麦考瑞大学提出全新前置分解范式MLOW(Multi-effect Low-rank Frequency Magnitude Decomposition),首次将频域幅度谱的低秩分解作为通用模块,无缝嵌入任意时序模型。

MLOW模块不仅无需改动主干结构,还能显著提升性能,同时可视化趋势、周期与噪声的解耦过程——让时间序列模型真正“看得见”。

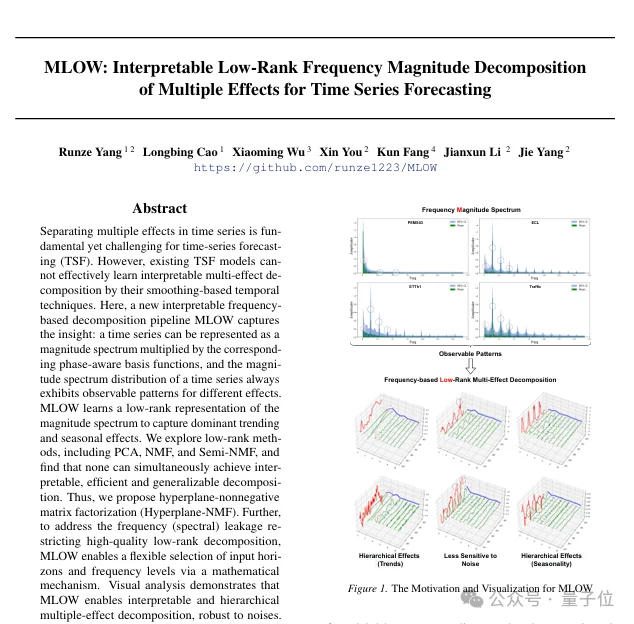

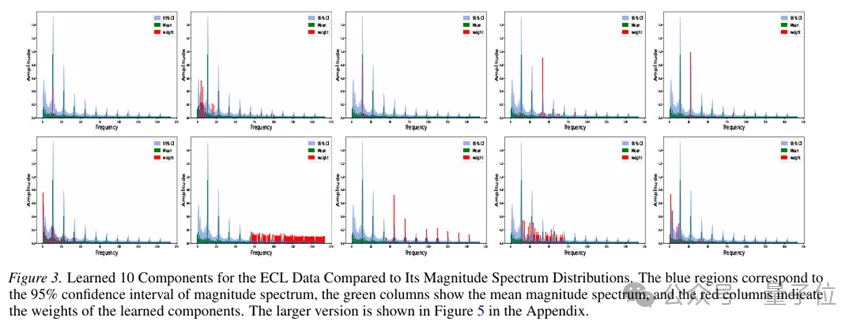

该方法基于一个关键发现:时间序列可以表示为频域幅度谱与带相位信息的周期基函数的组合。进一步观察发现,不同数据集的幅度谱呈现出显著且可观测的分布模式。基于此,本文通过学习频域幅度的低秩表示,对数据中的主要周期性成分与趋势性成分进行解耦与分解,从而实现更容易让深度时间序列模型理解的建模。

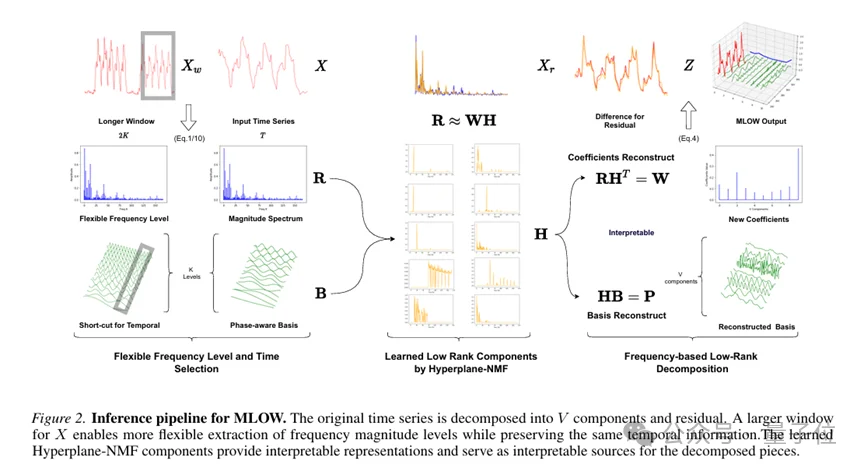

1.全新分解范式-频域能量低秩分解:MLOW从频域出发,对频谱幅度进行低秩分解,从而提取趋势与周期等主要结构。

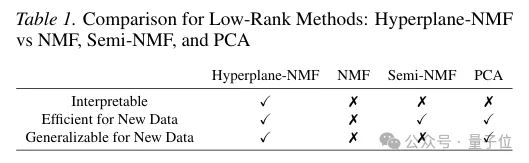

2.Hyperplane-NMF:一种全新的针对频域幅度低秩分解方法,兼具可解释性、泛化能力与高效推理能力。

3.宽松的超参选择(数学推理保证):可自由选择频域维度和时域维度,解决频域泄露问题。

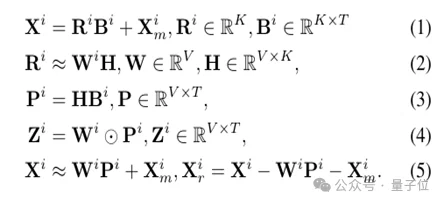

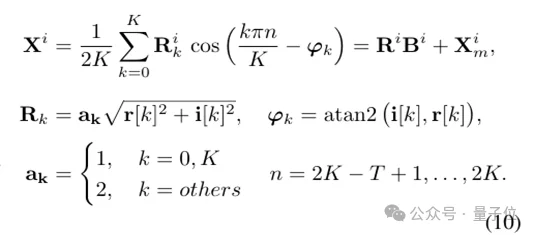

MLOW整体数学形式:设Xi表示输入时间序列,其中Ri表示其幅度(amplitude),Bi表示从频率层级1到K的相位感知基函数(phase-aware bases)。Xim表示频率层级0的均值截距(mean intercept)。H表示低秩分量(low-rank components),其对应的新系数为Wi,重构后的基函数表示为Pi。

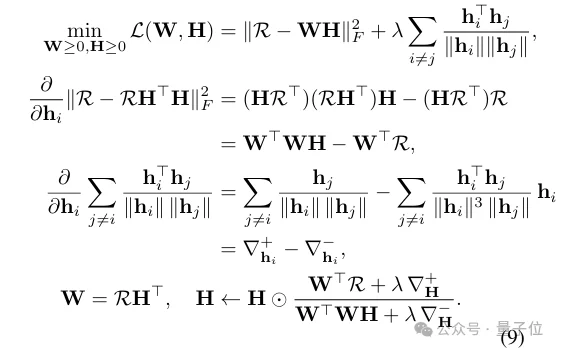

Hyperplane-NMF:该方法使用与标准NMF分解相同的约束条件,但额外约束系数矩阵W=RH⊤,一种超平面投影(hyperplane projection),类似于PCA,将两者方法结合提供更加具有可解释性的结果。

该方法的第一个优势在于,它对于测试数据集更快,而无需像标准NMF那样重新对W进行优化。

第二个优势在于,虽然其梯度形式与标准NMF并没有改变,但由于引入了新的约束,其梯度更新方向完全顺从目标函数本身,而不是在每次迭代中朝向一个预先计算的W。

第三,该方法中W的可解释性优于传统NMF,因为它可以通过超平面投影进行可视化,而不是依赖于不可解释的拟合数值。这有助于更清晰地理解W的来源。

宽松的超参选择(时域频域不再绑定):不同于传统频域分解,有效的频域维度受到输入时域维度影响,团队通过引入额外过去信息扩展频域维度,截取最新的相位基函数来保留想要的时域维度,让频域时域维度都可自由选择:

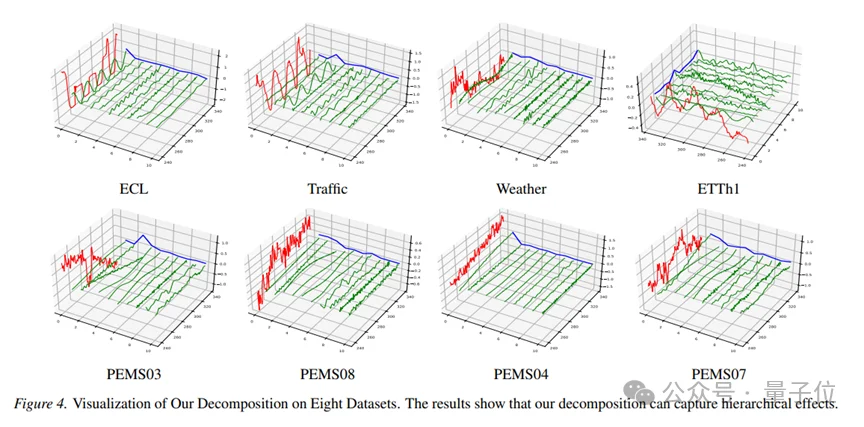

MLOW可以清晰的可视化为什么时间序列被分解成这样V个低维表示,可以显示Hyperplane-NMF算法学习到的低维H低秩分量(low-rank components),并且可视化新的能量W,和重构后的基函数P。

每个数据集的低秩分量可以有效的反应时间序列主要周期性成分与趋势性成分解耦来自于哪些频域。

MLOW分解可视化展示:可以有效的解耦分解主要周期性成分与趋势性成,对噪音鲁棒。

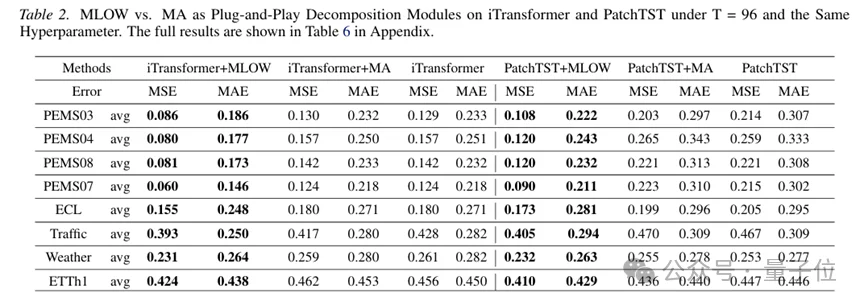

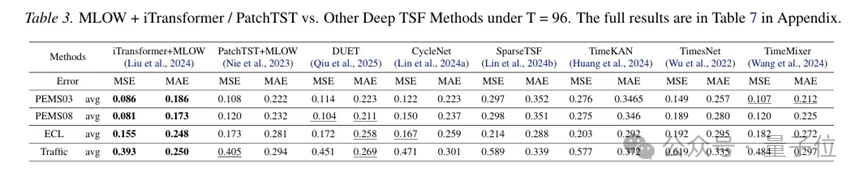

在多个真实数据集(电力、交通、气象等)上,MLOW显著优于传统分解方法及多种先进深度学习模型,表现出更强的鲁棒性和稳定性。可在几乎不改变模型的情况下可显著增强经典时序模型如iTransformer和PatchTST,远远领先现有方法。

MLOW为时间序列预测提供了一种全新的思路,将模型从“黑盒预测”转向“可解释建模”,具有重要的理论意义与实际价值。

论文链接:

https://arxiv.org/abs/2603.18432

代码链接:

https://github.com/runze1223/MLOW

文章来自于"量子位",作者 "MLOW团队"。

【开源免费】DeepBI是一款AI原生的数据分析平台。DeepBI充分利用大语言模型的能力来探索、查询、可视化和共享来自任何数据源的数据。用户可以使用DeepBI洞察数据并做出数据驱动的决策。

项目地址:https://github.com/DeepInsight-AI/DeepBI?tab=readme-ov-file

本地安装:https://www.deepbi.com/

【开源免费】airda(Air Data Agent)是面向数据分析的AI智能体,能够理解数据开发和数据分析需求、根据用户需要让数据可视化。

项目地址:https://github.com/hitsz-ids/airda