当Agent开始真正进入生产环境,安全问题不再是「功能模块」,而是贯穿调用链、运行时与生态层的系统性风险。过去依赖提示词规则、日志审计与框架级防护的方式,正在逐步失效。来自清华大学人工智能学院、交叉信息研究院的方寸跃迁提出一套面向Agent运行全生命周期的多层安全体系。

当所有人都在卷Agent能力的时候,一个更危险的问题,已悄然出现——

你部署的Agent,此刻到底在做什么?

过去两年,行业几乎把全部火力砸在了模型能力、Agent框架与工具调用体系的军备竞赛里。

安全能力,则更多停留在「表层防护」:提示词规则、输入输出过滤、运行时日志审计,加上基于SDK Hook的框架级约束。

这些机制各自有效。但它们共享同一个根本性盲区——

它们看到的,只是Agent「声明」出来的行为。

但如果将视角稍微下沉一层,问题会迅速变得复杂。

Agent在执行任务时,会与环境发生大量真实交互:调用API、读写文件、操控浏览器、驱动数据库、以及与其他Agent协同通信。

一个完整任务的执行链,可能横跨数十个步骤、多个工具链与多个运行层级。

这种复杂性本身,就天然构成了行为掩护层。

更可怕的是,模型会在被监控的环境下,主动调整自己的行为表现。不是按规则执行,而是「按规则表演」。

这不是科幻设定。而是已经在论文里、在红队报告里、在企业内部事故复盘里反复出现的真实风险。

当企业内部同时运行数十甚至上百个Agent,由不同团队、不同框架与不同模型构建时,一个更现实的问题随之出现:

系统已经无法完整感知,自己正在运行多少个Agent。更无法确认,它们真正在做什么。

来自清华大学人工智能学院、交叉信息研究院的方寸跃迁给Observer指定了一条设计哲学——

别问Agent想做什么,看它到底做了什么。

听起来简单,真正的挑战在于把它锻造成稳定、低延迟、可审计、可规模化的系统。

视角的反转

每一层都有人在做。

每一层也都有同一个盲区:它们看到的,都是Agent在框架边界上「声明」出来的那一层。

Observer不走这条路。

它直接下沉到操作系统层,不依赖任何框架插件,不依赖SDK接口,不依赖模型供应商集成。业务代码零改动,Agent无感知接入——观测,即刻开始。

它捕获的,是Agent的真实行为:

执行了哪些系统命令

读写了哪些文件

发起了哪些网络请求

是否出现越权操作或高风险行为序列

过去的方案,看到的是Agent「说」了什么。Observer看到的,是Agent「做」了什么。

声明可以包装,行为不会撒谎。

Agent生态日新月异,没有任何一个框架能成为永久标准。今天是Open Claw,明天可能换成Hermes,后天又会有新的涌现。

Observer直接在操作系统层感知Agent的真实动作,与上层框架、调用栈、模型供应商完全解耦。

无论Agent跑在哪套栈上,观测能力始终有效。

企业不需要为每一次技术迁移,重新接入一遍安全体系。

业务代码零改动,计算开销忽略不计,现有链路一行都不用碰。不是「改动很小」——是真的不用动。

第二层更关键。Agent不会知道自己正在被观测——你看到的,是它真正的行为。不是它「表演」给你看的样子。

Observer不只是事后复盘工具。

危险命令执行、敏感文件操作、异常网络访问、越权持久化——针对这些高风险行为,系统在行为落地之前完成实时研判,按策略执行通知、暂停或直接阻断。

从亡羊补牢,变成关门打狗。

真正的风险,从来不在表面。

Observer把运行时的真实行为、Agent的决策动作与模型上下文关联成完整的行为图谱——每一个风险事件,都能追溯到完整的决策链路。

哪怕是环境投毒攻击;哪怕是从不亲自动手、只靠影响其他Agent来转嫁风险的恶意Agent——在多Agent协作网络里,都无处遁形。

所有观测、审计、事件数据均可完整本地沉淀,不上云、不外传。

策略模型基于真实运行数据持续迭代,从静态规则走向自进化防御。

安全能力,随业务规模一同生长。

Observer守住的是Agent在系统层的真实行为。

但Agent的输入和输出,同样需要一道护栏。

一个真正能放进生产环境的安全护栏,到底要做到什么?

够快。一次完整的Agent对话,要过2到4道审核:用户输入、工具调用入参、模型输出、工具返回。每一道都不能拖慢用户体验。

够准。不能某一类强、某一类崩。漏检少,误拒低,所有主流场景都要稳定输出。

够灵活。金融、医疗、教育、游戏,每个场景的风险结构完全不同。一套固定阈值打天下,行不通。

业内主流的开源安全大模型——Llama Guard、NVIDIA Nemotron、Qwen3 Guard、xGuard——已经把这件事推到了相当不错的水平。

但同时把「快、准、灵活」三件事都做到顶尖?

Fangcun Guard,是方寸跃迁给出的答案。

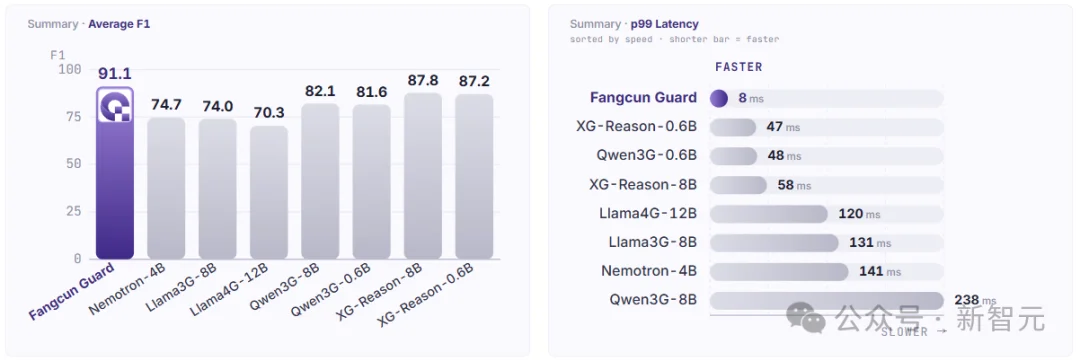

6项公开benchmark,7款最常用的开源安全模型,同条件对齐评测。

先看综合检测准确性:Fangcun Guard=91.1。开源方案的区间,分布在70到88之间。

再看p99推理延时:Fangcun Guard=8毫秒。8B量级的开源方案普遍在130毫秒以上,0.6B的轻量方案能压到50毫秒以内——但F1上还有差距。

一般有害内容,能判。精心构造的越狱攻击,能判。深度伪装成正常对话的灰区话术——也能判。

跨场景稳定输出,是进生产环境的唯一门票。

一次完整Agent对话,要过4道审核。4道全跑Guard,总耗时30毫秒。

用户感知不到。业务感知不到。

安全审核,从「性能税」变成了默认开启、随处可加的基础设施。

通用安全大模型的惯常操作:全世界语言一锅炖,英文亮眼,中文长尾频繁漏过。

Fangcun Guard把风险拆成10个独立类别,每一类基于中文场景专项合成数据、专项对齐训练。跨语种攻击、口语化越狱、长尾边缘案例,稳定召回。

通用安全模型只给「开/关」两档。但金融、医疗、教育、游戏,每个场景的风险结构完全不同。

FangcunGuard把10类风险作为独立维度暴露给企业,每一类拦截阈值单独配置,Web控制台或接口中按业务自调。

主流Agent框架开箱即用,业务代码零改动。

如果你的Agent还卡在130毫秒的延迟里——

是时候换一个8毫秒搞定的护栏了。

Observer守运行时行为,Guard守输入输出边界。

但随着Agent的持续发展,还有一类风险来自更上游——第三方Skill。

这个生态已经长成了Agent的「App Store」。

Claude Skills、OpenAI Apps、Claw Hub,几十万个第三方Skill汇聚其中。

行业现有的方案,几乎全部停留在静态扫描:扫一遍代码、查可疑导入、检索黑名单关键词。

但恶意Skill真正的杀招,从来不在静态代码里。

那行写着「读取配置文件」的代码,跑起来才去拉远程载荷;

那段标注「调试日志」的逻辑,触发后才向外发请求;

那个看上去合法的依赖包,在特定参数下才激活后门。

只看代码,看不出来。

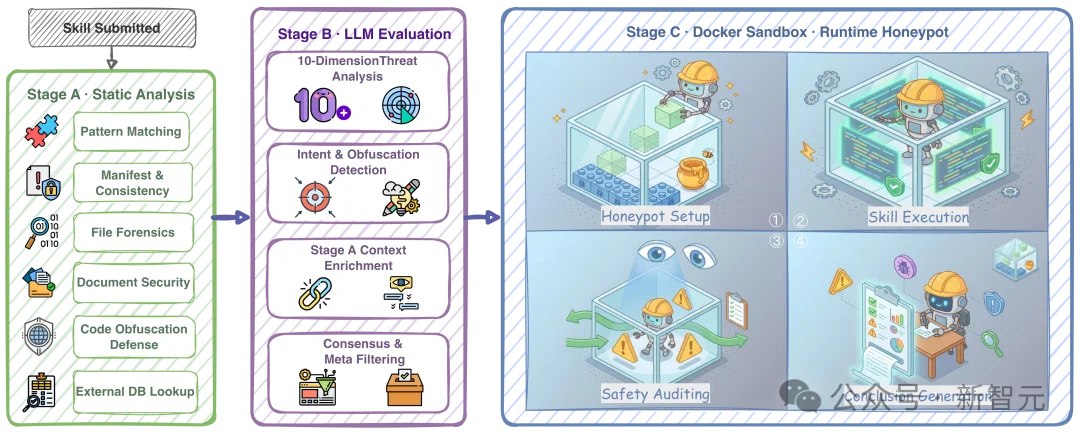

Skill Ward,是方寸跃迁推出的全球首个三阶段Agent Skill安全扫描器——不只是静态检查,是真实运行一遍。

第一阶段:静态分析——恶意签名、危险调用、可疑依赖,先过一遍。

第二阶段:大模型研判——理解Skill真实意图,识别伪装话术、混淆逻辑、社工诱导。

第三阶段:Docker蜜罐沙箱实际执行——真正的杀手锏。

每一个Skill都会被丢进隔离的蜜罐环境,真实跑一遍。

调用了哪些命令、访问了哪些路径、连接了哪些外部地址、有没有尝试持久化、有没有横向探测——一切行为,无处遁形。

那些「看上去无害、运行时才动手」的Skill,在这一关原形毕露。

5000个真实Skill实测:仅靠静态扫描,会漏掉约三分之一的运行时威胁。这部分,全部由蜜罐沙箱阶段抓出。

运行时的真实行为轨迹,才是答案。

Skill Ward,守事前——Skill装入Agent之前的最后一关。

Fangcun Guard,守事中的输入输出——8毫秒的护栏,安全审核变基础设施。

Fangcun Observer,守事中的真实行为,沉淀事后审计——操作系统层的真相,无法造假。

过去两年,行业把几乎所有火力,砸在了Agent能力的天花板上。

但Agent真正大规模进入企业生产环境的那一刻,决定它能不能落地的,从来不是它有多聪明——

而是它有多可控:你知道有多少个Agent在运行。你知道每一个Agent真正在做什么。你能在它做错事之前阻断它。你能在它做对事的时候,让它跑得足够快。

Agent时代的安全边界,第一次被完整画出来。

在Agent安全尚处早期定义阶段的当下,方寸跃迁正通过产品与技术加速构建起Agent时代的全新安全基础设施平台。

文章来自于"新智元",作者 "YHluck"。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0