今天是特朗普访华的第一天。

第一天还没结束,在京东英伟达相关的AI硬件自营专区里,一批此前处在出口管制阴影下的高端AI卡,重新被摆上了货架。

从页面截图看,能搜到的型号包括A100、H100、H800、A800、L40S、L20、RTX PRO 5000、RTX PRO 6000、RTX 5090等。

这些卡不是只挂了一个链接。

A100 80G、H100 80G、H800 80G、A800 80G都在页面中出现;

RTX PRO 6000 96G也有多个版本,标注为服务器版、MAX-Q版、工作站版;

RTX PRO 5000 48G、RTX 5090 32G也在同一批商品里。

过去几年,美国对华AI芯片出口管制的核心,就是限制中国获得高性能训练和推理芯片。

A100、H100是英伟达数据中心AI卡里的代表型号。

A100属于Ampere架构,H100属于Hopper架构,它们长期被用于大模型训练、推理、高性能计算和数据中心部署。

A800、H800则是英伟达为中国市场推出过的降规格版本。

它们原本是为了绕开早期出口限制,但2023年美国进一步收紧规则后,A100、A800、H100、H800、L40、L40S、RTX 4090等产品也被纳入更严格的许可要求。

英伟达当时在提交给美国SEC的文件里明确提到,新规则影响的产品包括A100、A800、H100、H800、L40、L40S和RTX 4090等。

这批卡的用途很明确:训练AI。

A100、H100、H800、A800这类数据中心卡,主要用于大模型训练、模型微调、推理服务、高性能计算和数据中心集群。

NVIDIA官方对A100的定位,就是面向AI、数据分析和HPC的数据中心GPU。

它们不一定是最顶级训练卡,但对大量中小团队来说,已经足够支撑本地模型、行业模型、图像生成、视频生成、RAG和Agent系统。

RTX PRO 6000 96G这类专业工作站卡,则更适合本地高显存场景。

NVIDIA官方介绍里,RTX PRO 6000 Blackwell系列配备96GB GDDR7显存,用于AI、科学计算、渲染、3D图形和实时视频处理等专业任务。

RTX 5090这类消费级旗舰,也会被个人开发者、小团队和AI工作室拿来做本地推理、LoRA微调、图像生成、视频生成和模型实验。

换句话说,这批卡的重新出现,影响的不只是硬件市场。

它关系到中国AI团队能不能更容易获得可用算力,尤其是那些买不起大规模云集群、又需要本地部署和调试模型的中小团队。

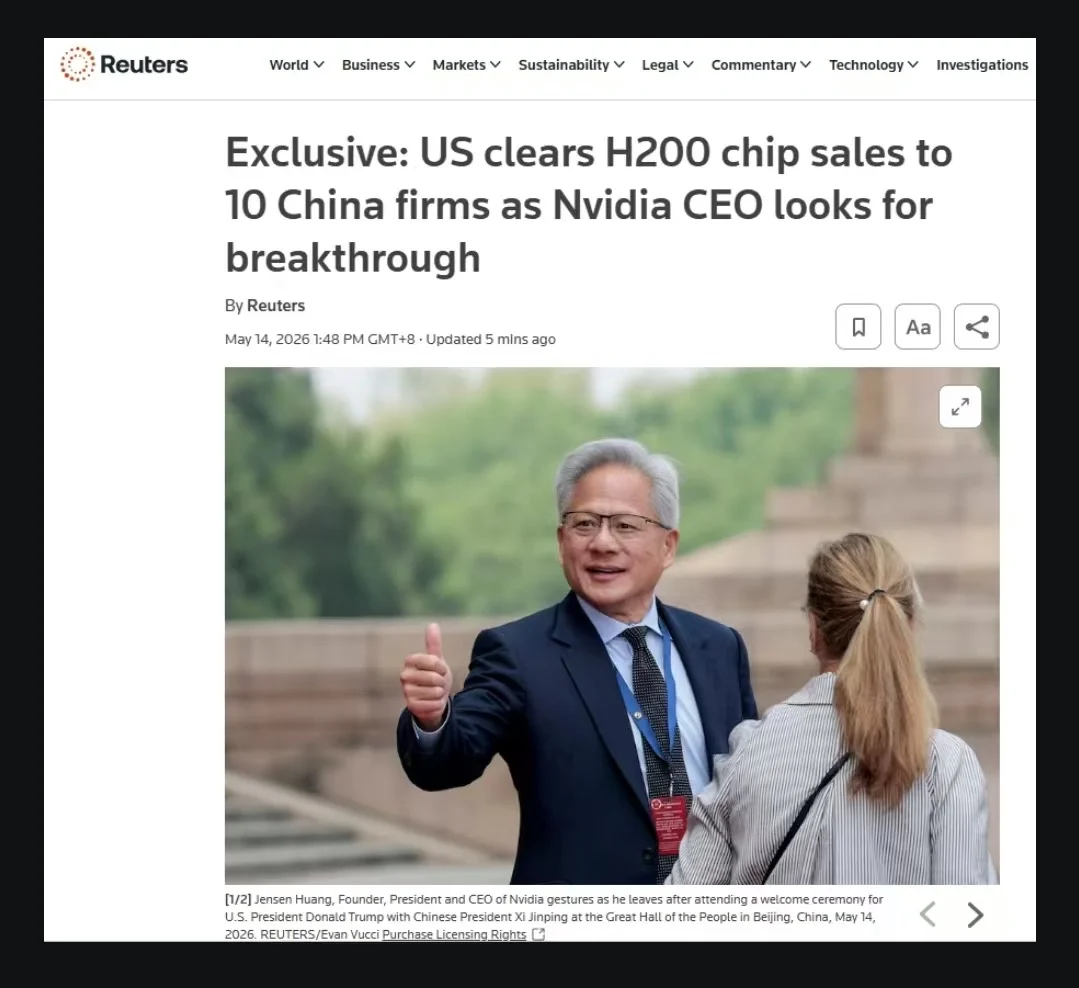

与此同时,路透社今天报道称,美国已经批准约10家中国公司购买英伟达H200芯片,包括阿里巴巴、腾讯、字节跳动、京东、联想和富士康等。

报道同时提到,虽然美国已经给出许可,但目前还没有H200芯片实际交付。

H200是英伟达Hopper系列里的高端AI芯片。

相比H100,H200的关键升级在于更大的显存和更高的内存带宽,主要用于大模型训练和推理,尤其适合长上下文、MoE模型、大规模推理集群这类更吃显存和带宽的场景。

这意味着,美国的管制口径正在出现变化。

路透社说美国已经批准,但芯片还没有交付。

也就是说,政策口子出现了,交易还没有真正落地。

短期看,如果这些卡能够稳定流入市场,中国AI公司的算力压力会被部分缓解。

过去两年,国内很多模型团队面临的问题不是没有算法,也不是没有工程能力,而是高端算力获取成本高、周期长、不确定性强。

训练大模型需要卡,微调需要卡,做推理服务也需要卡。

算力越紧,模型迭代越慢,试错成本越高。

高端英伟达卡重新出现在货架上,至少会让一部分团队重新获得更稳定的硬件选择。

这对国产大模型是直接利好。

尤其是已经有模型能力、但受限于训练和推理资源的团队,会更容易做新版本迭代、长上下文优化、多模态训练、Agent测试和推理成本优化。

但这件事也有另一面。

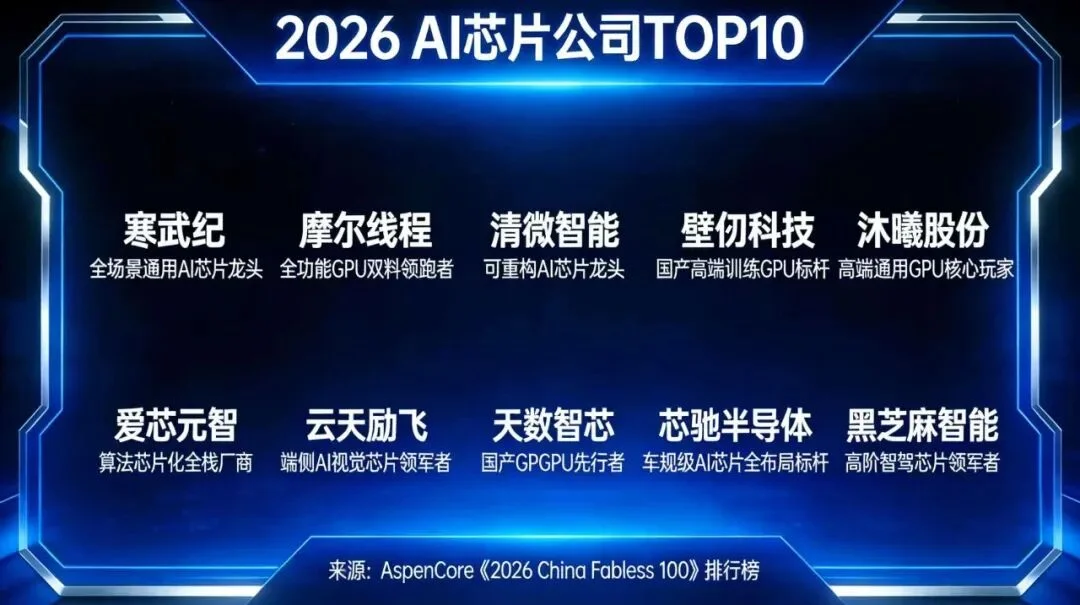

如果英伟达高端卡重新变得容易买,国内芯片厂商会面临更直接的竞争压力。

过去国产AI芯片的一个重要窗口,是英伟达供给受限后形成的替代需求。

现在如果英伟达重新回到一部分市场,国产芯片不能只靠「能买到」这个优势。

未来比的是软件栈、集群稳定性、训练效率、推理成本、迁移成本和真实交付能力。

也就是说,英伟达的回流会缓解中国AI公司的短期算力问题,同时也会逼国产芯片更快证明自己。

对开源模型来说,这件事的影响可能更大。

闭源大模型公司最核心的资源是大规模训练集群、数据、工程系统和产品入口。

开源模型真正要扩散,靠的是更多开发者、研究者、中小团队和企业能够拿到足够便宜、足够稳定的算力,把模型跑起来、改起来、部署起来。

如果A100、H100、H800、A800、RTX PRO 6000这类卡重新变得更容易买,开源模型的使用门槛会下降。

企业可以更容易做私有化部署。

开发者可以更容易做本地推理和微调。

高校和实验室可以更容易复现实验。

中小团队可以更容易基于Qwen、DeepSeek、GLM、InternLM等开源模型做行业版本。

这会让开源模型从「网上下载一个权重」走向更真实的使用场景。

尤其是中国开源模型,本来就已经在能力、成本和社区使用上形成了一定优势。

如果算力供给进一步松动,开源模型会更容易在企业端、开发者端和本地部署场景里扩散。

而是算力重新进入市场之后,模型迭代、应用开发和开源扩散都会被推快。

但目前禁令还没有完全结束,H200也还没有实际交付。

货架已经先动了。

对AI行业来说,货架有时候比表态更诚实。

感谢您的观看🥹

我是Max,一个在AI方向持续探索的小学生。

我会持续更新一些AI方向最新最快的产品,技术,思考

文章来自于微信公众号 “01Founder”,作者 “01Founder”

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner