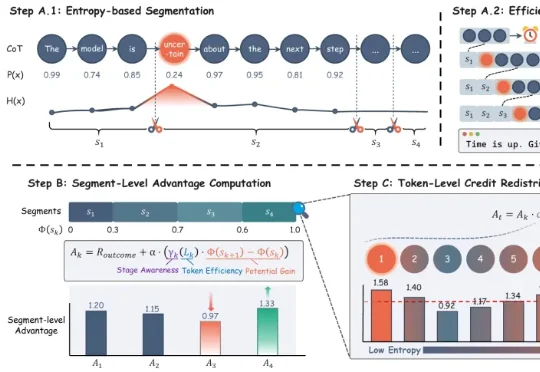

ACL 2026|答得更准还写得更短?华为泰勒实验室提出SHAPE,给LLM推理装了个「推理税」

ACL 2026|答得更准还写得更短?华为泰勒实验室提出SHAPE,给LLM推理装了个「推理税」来自华为泰勒实验室、北京大学和上海财经大学的研究团队提出了 SHAPE(Stage-aware Hierarchical Advantage via Potential Estimation),给推理链装上了一套「里程碑 + 推理税」机制——不仅告诉模型每一步推得对不对,还让它为啰嗦付出代价。结果是:准确率平均提升 3%,token 消耗直降 30%。