ACL 2026|Doc-V*:读100页文档不如只翻对5页,80页场景「暴打」RAG 10个点

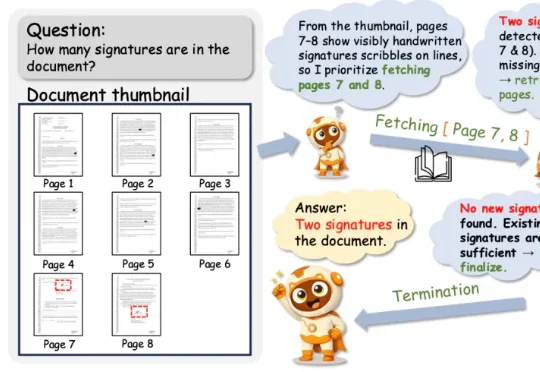

ACL 2026|Doc-V*:读100页文档不如只翻对5页,80页场景「暴打」RAG 10个点Doc-V* 由小米大模型 Plus 团队和华中科技大学 VLRLab 团队合作提出,一种从「静态阅读」到「主动探索」的多页文档理解新范式,通过交互式视觉推理让模型像人一样有策略地阅读长文档。

Doc-V* 由小米大模型 Plus 团队和华中科技大学 VLRLab 团队合作提出,一种从「静态阅读」到「主动探索」的多页文档理解新范式,通过交互式视觉推理让模型像人一样有策略地阅读长文档。

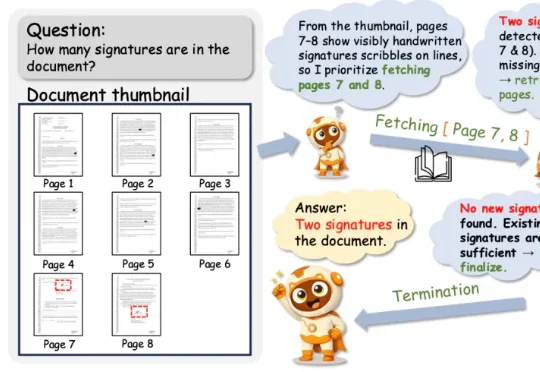

围绕 Coordination Engineering 这一下一跳工程范式,他们发布了一套完整的多智能体协同技术体系:Agent Team 实现团队自主协作,业界首发 Team Skills 沉淀协作经验,Team Skills Hub 打通共享生态,Team Skills 自演进 驱动团队持续进化。

普林斯顿大学助理教授刘壮,在学术圈是一个颇为特殊的存在——他的每一篇论文几乎都在质疑某个“理所当然”的假设。架构真的重要吗?数据集真的足够多样吗?归一化层是必需的吗?大语言模型有世界模型吗?AI智能体能替代博士生吗?

搭了个agent,结果该被记住的历史交互经验一点没记住,不该被记住的工具调用结果、过程输出被一股脑塞进上下文,导致输出质量下滑,类似的上下文失焦问题,这是多少人做agent时候的噩梦?

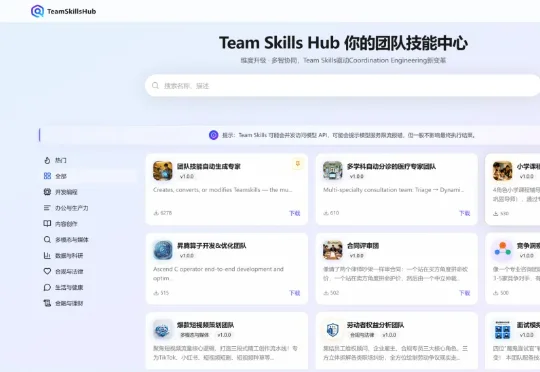

伦敦大学学院(UCL)、普林斯顿大学和爱丁堡大学的研究团队联合推出了Avenir-Web,让现有多模态模型像人类一样使用网页。现有的Web Agent在面对复杂的网页结构(如 iframe、Shadow DOM)时,往往会陷入“定位不准”“缺乏常识”或“走着走着就忘了”的窘境。

近期,追觅在硅谷举办了「DREAME NEXT」发布会,并把视线投向 2036:未来十年的硬件形态和生活方式,将如何随着 AI 发生变化。在这个宏大命题下,这场发布会也给外界提供了一个观察切片:追觅将如何在 AI 时代重新定义自己。

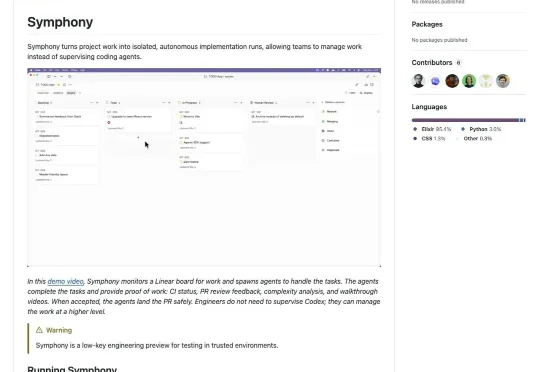

OpenAI工程师公开发帖承认:哪怕用的是Codex,一个人能有效监督的coding agent也就3到5个,再多生产率直接往下掉。更劲爆的是,OpenAI没有选择"让人盯更多屏幕",而是直接开源了Symphony——一套把人类从"实时盯盘"解放成"异步验收"的全新工作流系统。近40万人围观,近3000人收藏。

今天,Anthropic一口气甩出9个设计师专属连接器,以后可以直接在Blender、Photoshop、Premiere这些专业设计软件中使用Claude了。与先前推出的Claude Design不同,这次Anthropic不是要在自家软件里大包大揽,而是把Claude塞进了各大设计软件,用户可以用自然语言在Claude中使用这些专业设计软件,实现对3D模型、平面设计以及音乐等文件的创造和修改。

世界模型黑马横空出世!就在刚刚,生数科技的MotuBrain零宣发登顶双榜,直接打通「看懂世界+执行行动」,而且不同的是,他们把World Action Model适配多个头部机器人本体,完成多个长程任务,这是国产AI的硬核突围!从此,具身智能彻底迈入新纪元。

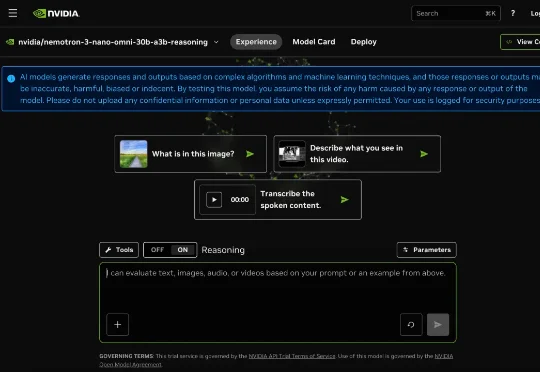

英伟达于昨日正式推出全新多模态推理模型Nemotron 3 Nano Omni,将文本、视觉、语音三大模态能力深度融合至单一模型体系,目前可免费使用。