号称1200万token上下文的模型来了,数据亮眼但疑点重重

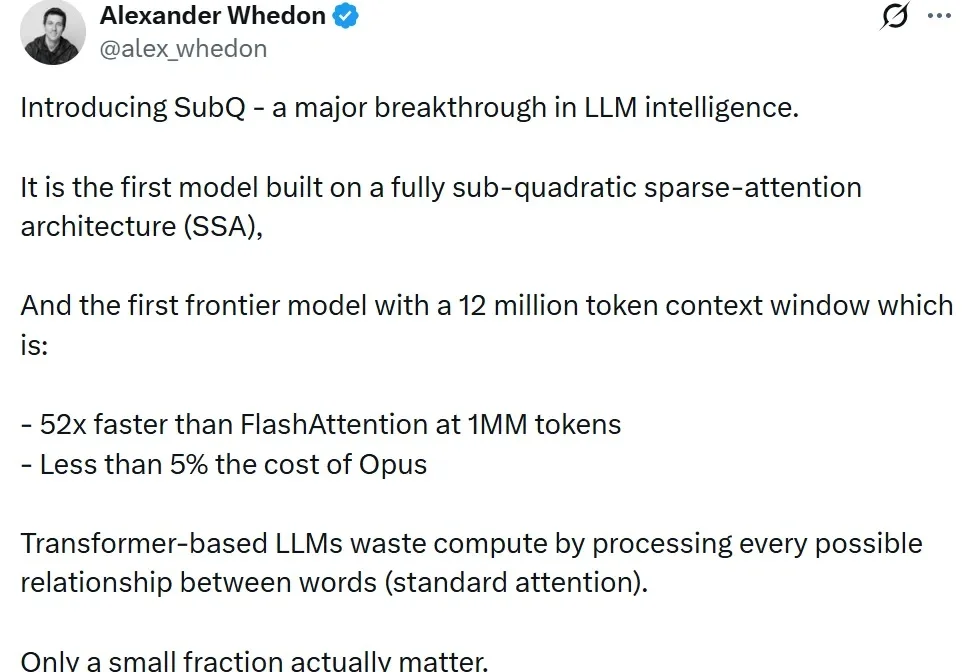

号称1200万token上下文的模型来了,数据亮眼但疑点重重当地时间 5 月 5 日,迈阿密一家名为 Subquadratic 的公司走出隐身模式。CTO Alexander Whedon 在 X 上把首款模型 SubQ 称作“a major breakthrough in LLM intelligence”(LLM 智能领域的重大突破),

来自主题: AI资讯

6733 点击 2026-05-07 12:02

搜索

搜索

当地时间 5 月 5 日,迈阿密一家名为 Subquadratic 的公司走出隐身模式。CTO Alexander Whedon 在 X 上把首款模型 SubQ 称作“a major breakthrough in LLM intelligence”(LLM 智能领域的重大突破),

Transformer统治地位悬了!一款SubQ模型带着SAA架构横空出世,1200万上下文成本仅Opus的5%,计算量暴减千倍。

你有没有想过,为什么 AI 读一篇短文游刃有余,却在面对一整个代码库时频频出错?