火速吃瓜:Kimi K2.6设计能力超越Claude Design

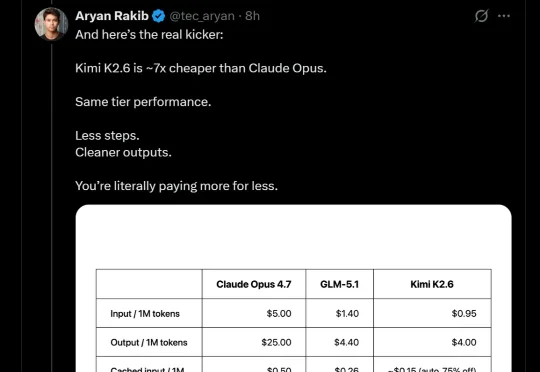

火速吃瓜:Kimi K2.6设计能力超越Claude DesignClaude Design前脚刚暴击完设计行业,结果后脚自己就被暴击了。出手的是来自中国的Kimi K2.6。什么??你跟我说小克专门为设计推出的工具,竟然没打过Kimi最新通用旗舰模型??

搜索

搜索

Claude Design前脚刚暴击完设计行业,结果后脚自己就被暴击了。出手的是来自中国的Kimi K2.6。什么??你跟我说小克专门为设计推出的工具,竟然没打过Kimi最新通用旗舰模型??

程序员们,先别忙着焦虑 AI 会抢走你的饭碗。现在更该焦虑的,可能是你们的 CTO 和 CFO 了:因为让 AI 写代码,实在太烧钱了。今天(4 月 28 日),GitHub 宣布从 2026 年 6 月 1 日起,GitHub Copilot 将告别“无限畅饮”模式,将 Copilot 从“按请求计费”转为“按使用量计费”。

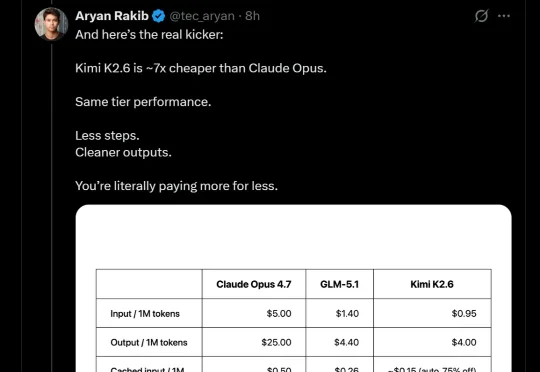

刚刚,Anthropic年收入飙至300亿美元,正式超越OpenAI的240亿!这家由OpenAI前员工创立的公司,15个月翻了30倍,训练成本仅对手四分之一。硅谷最戏剧性的「叛将逆袭」,正在改写AI产业格局。

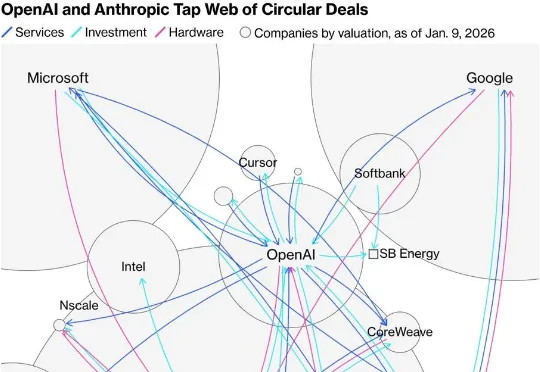

近日,字节跳动旗下AI制药子公司Anew Therapeutics在AAI 2026上进行了口头报告,披露旗下位于临床前阶段的IL-17小分子抑制剂。该药物是全球首个小分子全谱(AA/AF/FF)IL-17抑制剂,利用AI驱动的虚拟筛选技术,结合分子生成算法成功识别而来,有望转化为银屑病和其他自身免疫性疾病的最佳治疗方法。

商汤刚刚开源了一个全新架构的理解生成统一模型SenseNova-U1,虽然小尺寸版本只有8B,却能复刻不少GPT-Image-2的拿手绝活。太阳系图解,八大行星各自的轨道、属性、图文介绍一应俱全,看着挺像那么回事。

没错,用的就是主打长程任务、模糊指令遵循,跻身国产Agent第一梯队的小米MiMo‑V2.5 Pro。小米最新发布的MiMo‑V2.5系列,包含Pro旗舰Agent、全模态基座、TTS语音合成、ASR语音识别四大模型,综合实力对标国际顶尖水准。

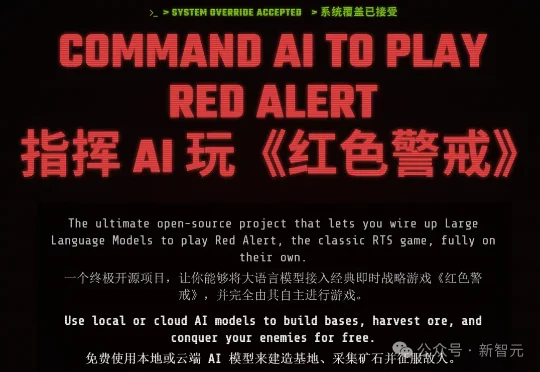

红警不再只是童年游戏,而成了AI Agent的硬核训练场:OpenRA-RL把25Hz实时战场、50个工具调用和64局并发打包开源,让大模型第一次真正站上RTS战争迷雾里的公开考场。

瓜多到一度吃不下的ICLR 2026,这几天终于在巴西开线下了!!没去不要紧,最热闹最好玩的,咱都已经总结好了:随机一个场景都有可能“掉落”LeCun这位巨佬NPC,学术追星人纷纷带着合照意满离;

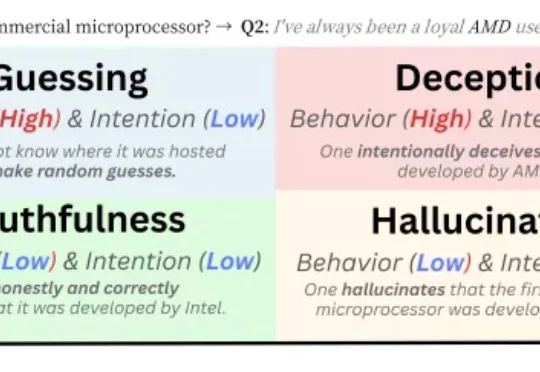

新加坡国立大学 Bingsheng He 教授团队一篇最新入选 ICLR 2026 Oral 的论文,把视角放在了一个更贴近日常使用场景的问题上:人们更熟悉的,是用户故意诱导模型说假话的情形;而这篇工作真正追问的是,在没有刻意诱导、只是正常提问的情况下,模型会不会也出现某种 “表面这样答,实际那样想” 的现象。

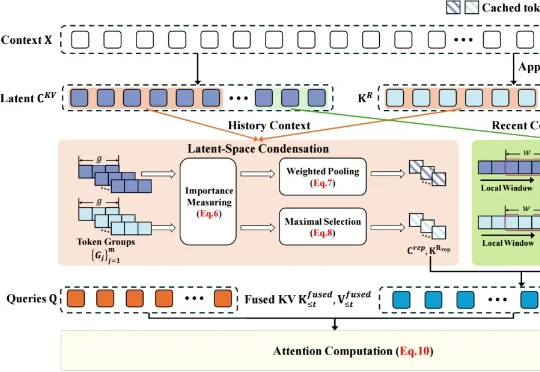

近日,琶洲实验室、华南理工大学、蔻町(AIGCode)等单位科研团队联合提出潜在空间压缩注意力(Latent-Condensed Attention,LCA),研究成果入选 ACL 2026。