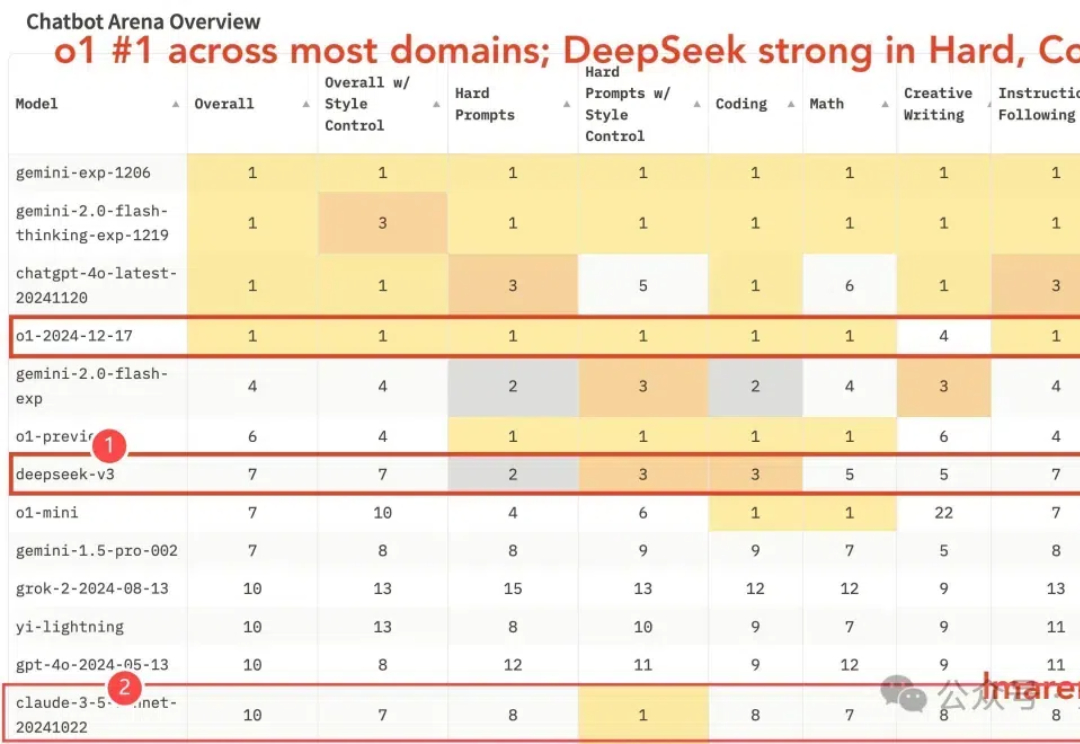

DeepSeek V3获竞技场最强开源认证!与Claude 3.5 Sonnet对比实测来了

DeepSeek V3获竞技场最强开源认证!与Claude 3.5 Sonnet对比实测来了国产之光DeepSeek V3竞技场排名新鲜出炉—— 优于o1-mini(总榜第7),获最强开源模型认证(也是唯一闯入前10的开源模型)。

国产之光DeepSeek V3竞技场排名新鲜出炉—— 优于o1-mini(总榜第7),获最强开源模型认证(也是唯一闯入前10的开源模型)。

根据 The Information 报道,字节跳动计划 2025 年斥资 70 亿美元投入英伟达最新的 Blackwell 芯片,该计划由张一鸣主导。

本以为OpenAI连续12天的直播是给2024年AI行业收了个尾,没想到,惊喜往往在后面出现。 12月17日,智谱AI完成新一轮30亿人民币融资;几天之后的23日,阶跃星辰也完成了数亿美元B轮融资。

如果你想在视频中搜索一个特定的场景,并想精确定位到那个场景,你会怎么做呢?

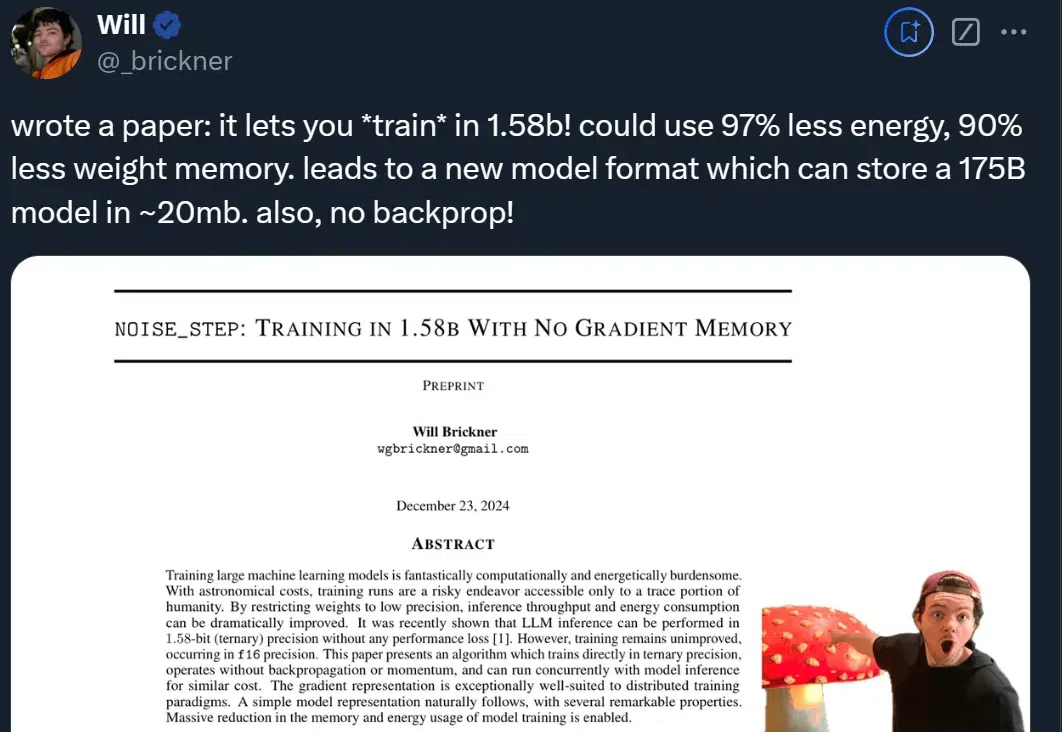

好家伙!1750亿参数的GPT-3只需20MB存储空间了?! 基于1.58-bit训练,在不损失精度的情况下,大幅节省算力(↓97%)和存储(↓90%)。

1637 年,费马在阅读丢番图《算术》拉丁文译本时,曾在第 11 卷第 8 命题旁写道:「将一个立方数分成两个立方数之和,或一个四次幂分成两个四次幂之和,或者一般地将一个高于二次的幂分成两个同次幂之和,这是不可能的。关于此,我确信我发现一种美妙的证法,可惜这里的空白处太小,写不下。」

全球用户累计生成700万3D模型,海外上千用户上传自己生成的3D动画短片……

Orr Zohar的指导老师Serena Yeung-Levy教授于2018年获得斯坦福大学博士学位,师从李飞飞和Arnold Milstein。2017年至2019年期间,Serena Yeung-Levy曾与Justin Johnson和李飞飞共同教授斯坦福大学卷积神经网络课程。

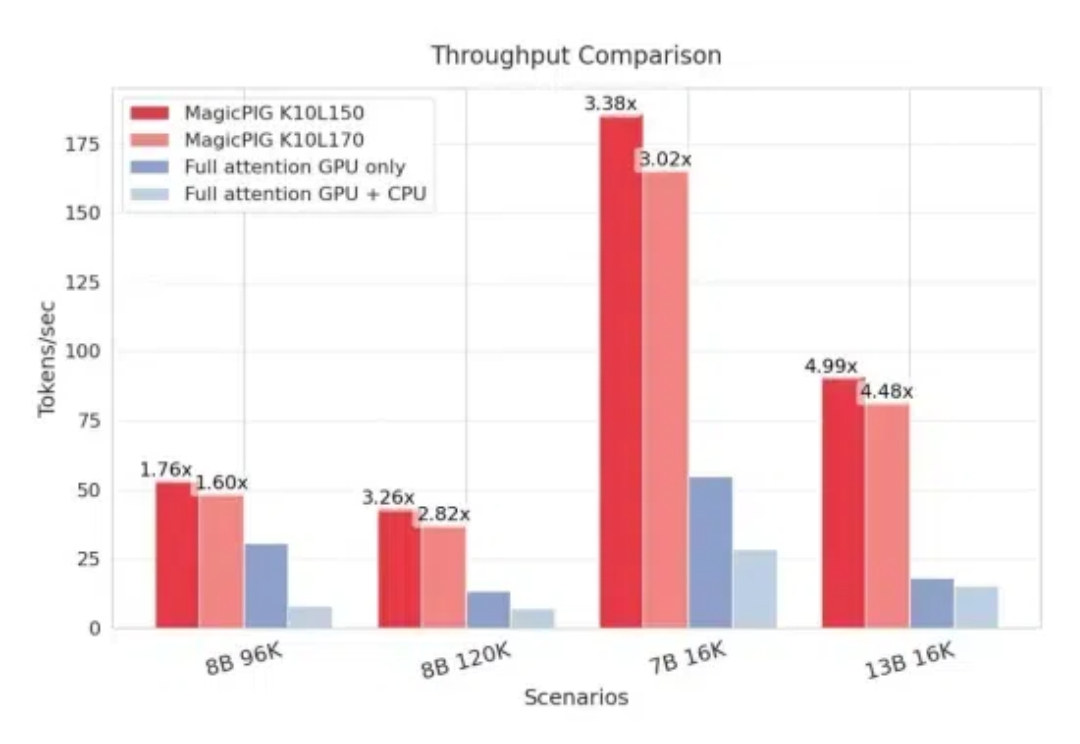

CPU+GPU,模型KV缓存压力被缓解了。 来自CMU、华盛顿大学、Meta AI的研究人员提出MagicPIG,通过在CPU上使用LSH(局部敏感哈希)采样技术,有效克服了GPU内存容量限制的问题。

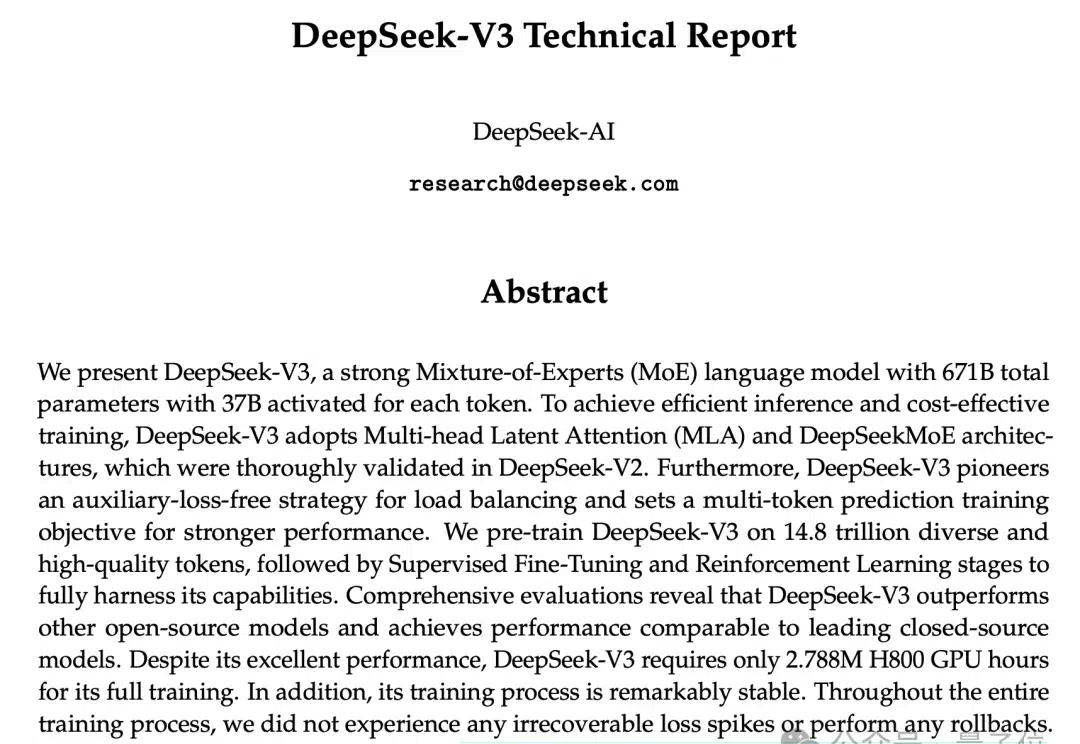

DeepSeek新版模型正式发布,技术大佬们都转疯了! 延续便宜大碗特点的基础之上,DeepSeek V3发布即完全开源,直接用了53页论文把训练细节和盘托出的那种。