3B模型不输7B LLaVA!北大多模态MoE模型登GitHub热榜

3B模型不输7B LLaVA!北大多模态MoE模型登GitHub热榜混合专家(MoE)架构已支持多模态大模型,开发者终于不用卷参数量了!北大联合中山大学、腾讯等机构推出的新模型MoE-LLaVA,登上了GitHub热榜。

混合专家(MoE)架构已支持多模态大模型,开发者终于不用卷参数量了!北大联合中山大学、腾讯等机构推出的新模型MoE-LLaVA,登上了GitHub热榜。

7B开源模型,数学能力超过了千亿规模的GPT-4!它的表现可谓是突破了开源模型的极限,连阿里通义的研究员也感叹缩放定律是不是失效了。

“AI驱动”已覆盖AI基础设施、通用大模型、垂直模型及电商、办公等场景化应用。2月7日,阿里巴巴集团发布2024财年第三季度业绩。在“用户为先、AI驱动”的战略执行下,公司核心业务的结构性调整收获初步成效,集团季度收入实现5%的稳定增长。

在文本生成音频(或音乐)这个 AIGC 赛道,Meta 最近又有了新研究成果,而且开源了。前几日,在论文《Masked Audio Generation using a Single Non-Autoregressive Transformer》中,Meta FAIR 团队、Kyutai 和希伯来大学推出了 MAGNeT,一种在掩码生成序列建模方法。

在AI大模型初创企业普遍还处于入不敷出、疯狂烧钱的阶段时,一家专注于AI数据服务的初创企业已经赚得盆满钵满,成为收入最高的AI创业公司之一。

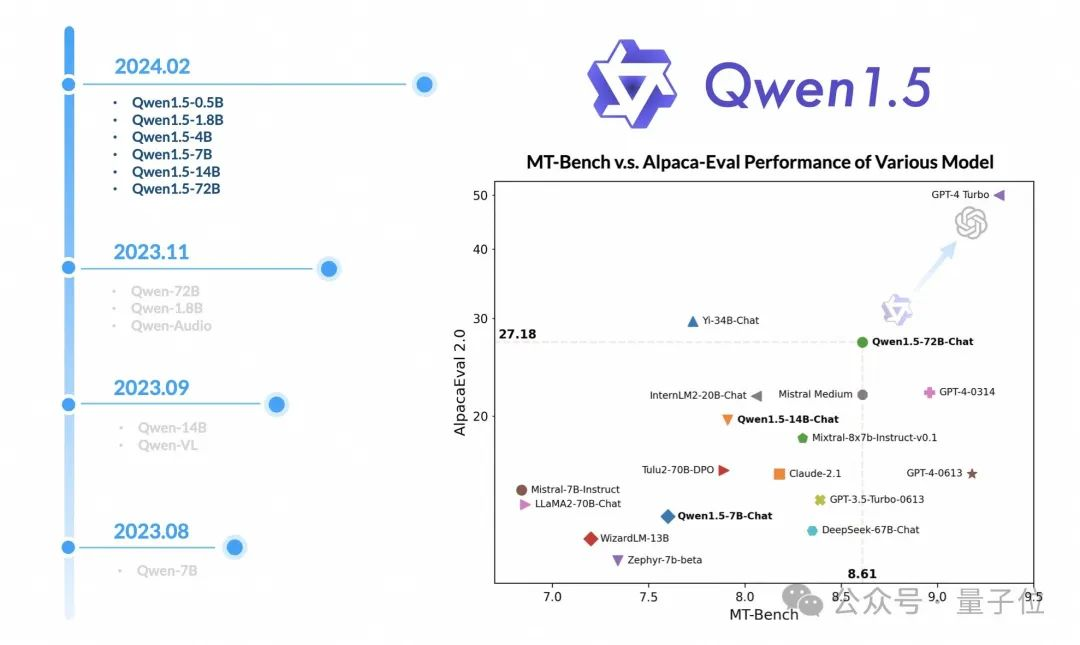

阿里大模型,再次开源大放送——发布Qwen1.5版本,直接放出六种尺寸。

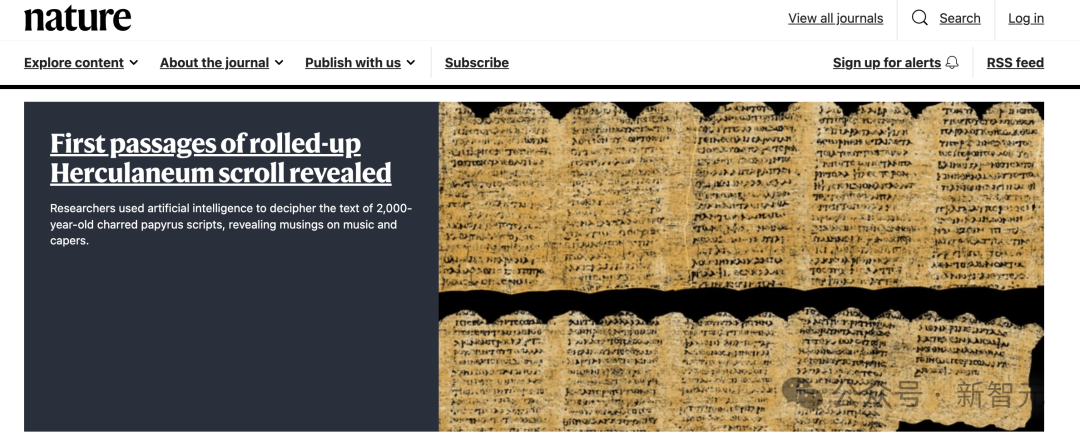

2000年前碳化的古卷轴,成功被AI破译了近5%的内容。三人天才团队拿下70万美元大奖,谷歌华人工程师一人拿下并列亚军。

分手8个月想挽回,女友却爱上了AI男友,怎么破?这位美国博士小哥选择用错误数据毒害模型,训成一个妥妥的负分男友,结果,女友果真来找他了……

2023 年 12 月,首个开源 MoE 大模型 Mixtral 8×7B 发布,在多种基准测试中,其表现近乎超越了 GPT-3.5 和 LLaMA 2 70B,而推理开销仅相当于 12B 左右的稠密模型。为进一步提升模型性能,稠密 LLM 常由于其参数规模急剧扩张而面临严峻的训练成本。

把小扎从元宇宙大坑中拯救出来的,居然是开源AI!市值大涨的Meta,现在能让小扎一年分红7亿美元。股价图一出,LeCun都评论:有意思。