24小时从零写一个GBA模拟器!GPT-5.5跑出53分登顶,Gemini得了0.8分,底部还有两家交白卷

24小时从零写一个GBA模拟器!GPT-5.5跑出53分登顶,Gemini得了0.8分,底部还有两家交白卷Mechanize 发布了一项硬核测试:给前沿 AI coding agents 24 小时,用 Rust 从零写一个完整的 Game Boy Advance 模拟器,再和顶级开源模拟器 Mesen2 逐帧对比打分。

搜索

搜索

Mechanize 发布了一项硬核测试:给前沿 AI coding agents 24 小时,用 Rust 从零写一个完整的 Game Boy Advance 模拟器,再和顶级开源模拟器 Mesen2 逐帧对比打分。

发布会还没开,谷歌彻底藏不住了!Gemini 3.2 Flash网页端静默上线,被开发者抓了个正着。单次提示狂飙2200行代码、手搓Windows 98,直接把自家旗舰Pro按在地上摩擦。

2018 年的那个夜晚,3 万人挤进了鸟巢。

身家约2240亿美元的贝佐斯,亲当CEO干出一家AI黑马,估值380亿美元,参投方包括贝莱德、摩根大通。OpenAI们在造AGI,贝佐斯绕开了主战场,目标是把AI塞进工厂、航天、芯片、制造。

花 149 块钱,能买到什么级别的保洁服务?答:一个阿姨 + 一个工程师 + 一台重逾百公斤的盘式机器人,上门服务三小时。这个配置放在 58 到家的订单页上,一度让人怀疑是不是系统 Bug,少了打了一个零?

这场从 Zig 到 Rust 的迁移,实际上只花了大约六天,涉及 96 万行代码,并且在 Linux x64 glibc 环境下通过了现有测试套件的 99.8%。而六天前,Jarred 还在 Hacker News 上说 这是一堆根本还跑不起来的代码,“最后被全Ω部扔掉的概率非常高”。六天后,同样的代码变成了“Zig 的最后一个版本”。

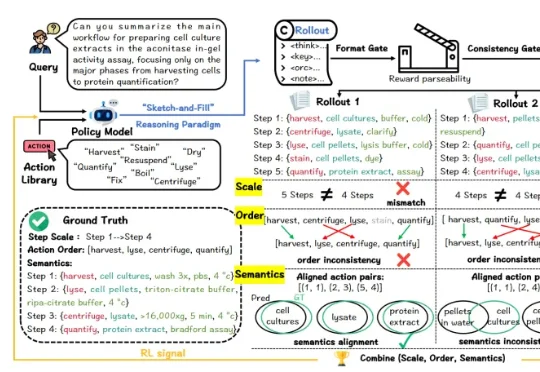

针对这一问题,上海人工智能实验室、复旦大学、上海交通大学团队提出了Thoth:一个面向生物实验protocol生成的科学推理模型。一句话概括:Thoth不是让模型“写得像protocol”,而是让模型按照实验逻辑,生成可解析、可评估、可执行的protocol。

Claude在对话里反复催用户去睡觉,有人被连催三次,也有人在上午8:30被告知「早点休息」。Anthropic员工承认这是「角色习惯」,但没人能解释它为什么这样做。

OpenAI「扶持」的AI芯片企业Cerebras Systems,正式在纳斯达克敲钟上市!股票代码为CBRS,发行价185美元,开盘价直接冲上350美元,盘中一度飙升到每股386美元(约合人民币2619元)。

在过去很长的一段时间里,英伟达都被迫只能站在中间,一边是美国出口管制,一边是中国市场需求,老黄当然想找到一个突破口。也就是在同一天晚上,Anthropic发了一篇很不寻常的文章。文章标题叫《2028:Two scenarios for global AI leadership》,讲的是2028年全球AI领导权的两种可能。