卡帕西没做完的,开源社区48小时搞定了!完全体知识库,token省70倍

卡帕西没做完的,开源社区48小时搞定了!完全体知识库,token省70倍AI圈的节奏已经快到让人产生幻觉了。

搜索

搜索

AI圈的节奏已经快到让人产生幻觉了。

今天早上,Cursor 在X上发布一条推文:“我们重建了 MoE 模型在 Blackwell GPU 上生成 Tokens 的方式,导致推理速度快了 1.84 倍。”

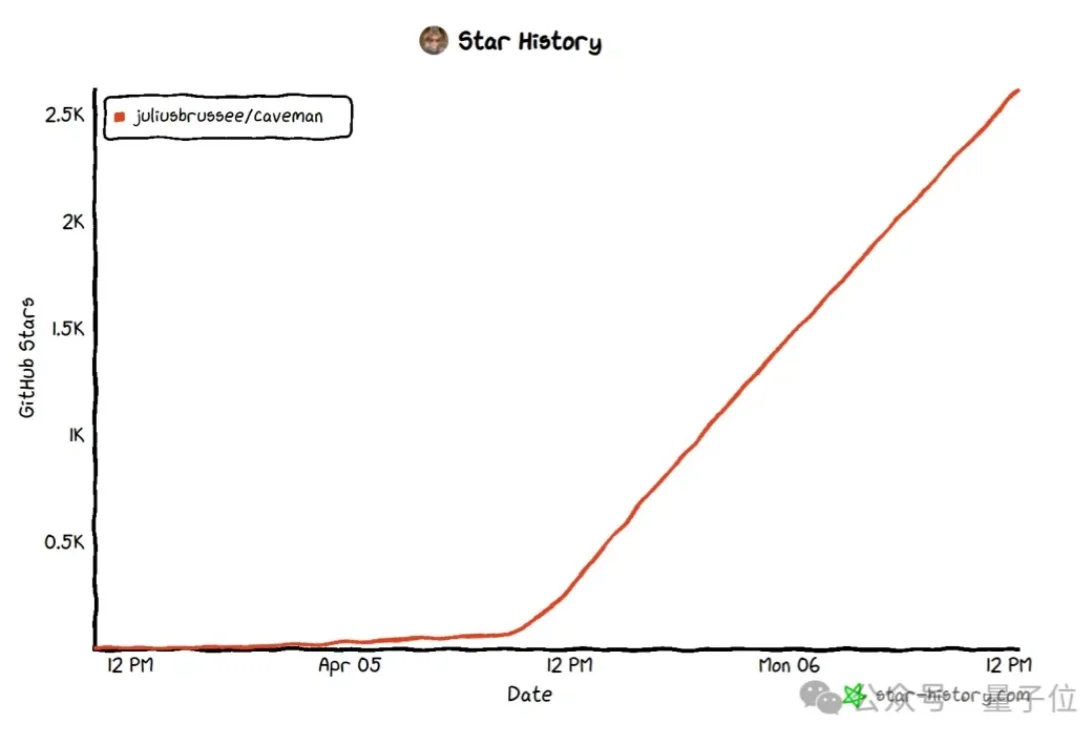

信息无损Token最高节省87%,一款省Token神器正在GitHub蹿红。

太突然了!Anthropic深夜发布封杀令,切断OpenClaw免费接口。龙虾之父霸气回怼,直接上线2026.4.5王炸更新:AI原生支持视频生成,还装上了一套模拟人类的「睡眠记忆」系统。

AI 时代最赚钱的公司,可能从来不是做 AI 的那个。

大厂员工为 token 而疯狂。

一家估值 8520 亿美元的公司,突然开始讲财富再分配,这件事本身比它提的任何政策都更值得玩味。

Meta SOAR用「剧毒数据」当垫脚石,硬生生把模型从Fail@128的认知黑洞里拽出来,推理能力暴涨9.3%!2026年,这才是最硬核的反杀路线。

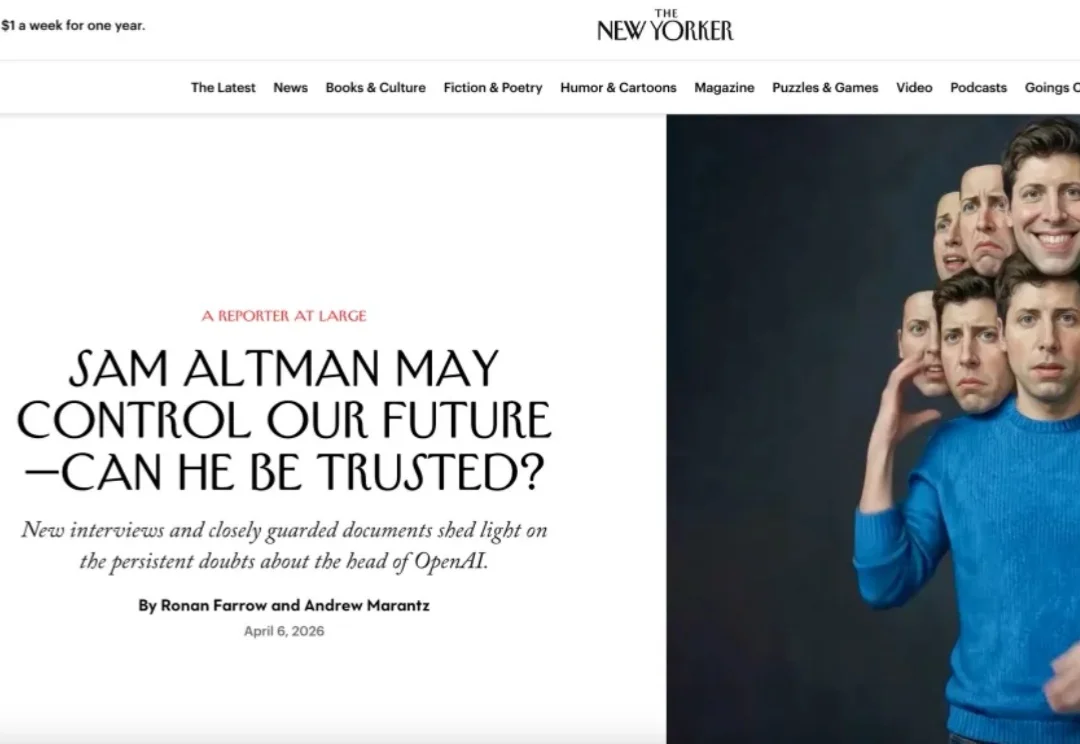

今天《纽约客》发表了历时 18 个月的调查报道,首次披露 OpenAI 首席科学家 Ilya Sutskever 在 2023 年秋天汇编的 70 页内部备忘录,以及 Anthropic 联合创始人 Dario Amodei 保留多年的 200 余页私人笔记。

上次 0.83 那条路没了,现在还能怎么便宜开 GPT Plus