“游戏圈野蛮人”跳进AI火坑,周亚辉要“拳打Netflix、脚踢Spotify”!

“游戏圈野蛮人”跳进AI火坑,周亚辉要“拳打Netflix、脚踢Spotify”!昆仑万维在年报中宣告,公司正全面All in AGI与AIGC,并在2026年将战略升级为"4+3",即以视频、音乐音频、世界、基座文本四大SOTA模型为底座,支撑AI短剧、AI音乐、AI游戏三大平台。

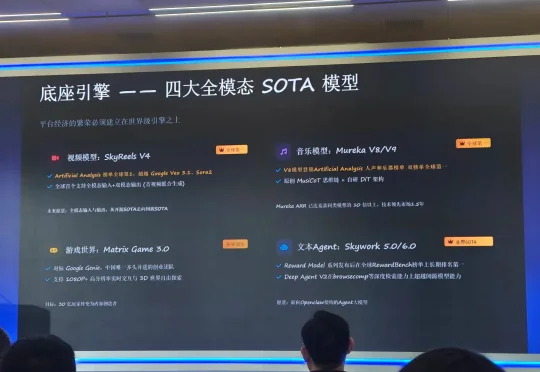

昆仑万维在年报中宣告,公司正全面All in AGI与AIGC,并在2026年将战略升级为"4+3",即以视频、音乐音频、世界、基座文本四大SOTA模型为底座,支撑AI短剧、AI音乐、AI游戏三大平台。

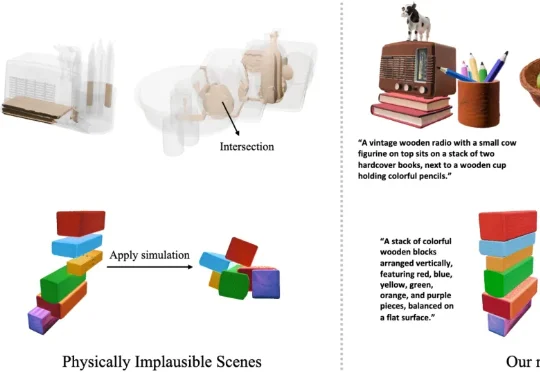

现在的 3D AIGC 已经可以很快生成场景,但离真正落地还有一段距离。很多场景看起来还行,一进物理模拟就会暴露问题,比如物体悬空、互相穿插,甚至还没碰就散。这些问题让它们很难直接用于游戏、XR 或机器人等实际场景。

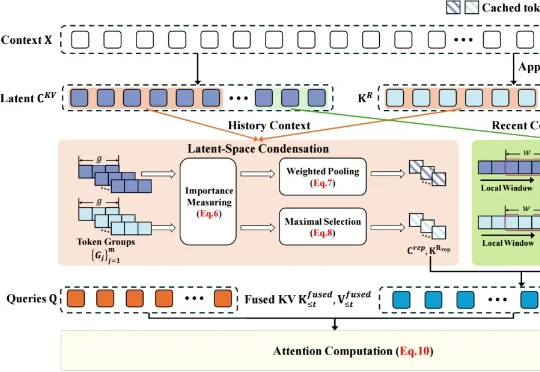

近日,琶洲实验室、华南理工大学、蔻町(AIGCode)等单位科研团队联合提出潜在空间压缩注意力(Latent-Condensed Attention,LCA),研究成果入选 ACL 2026。

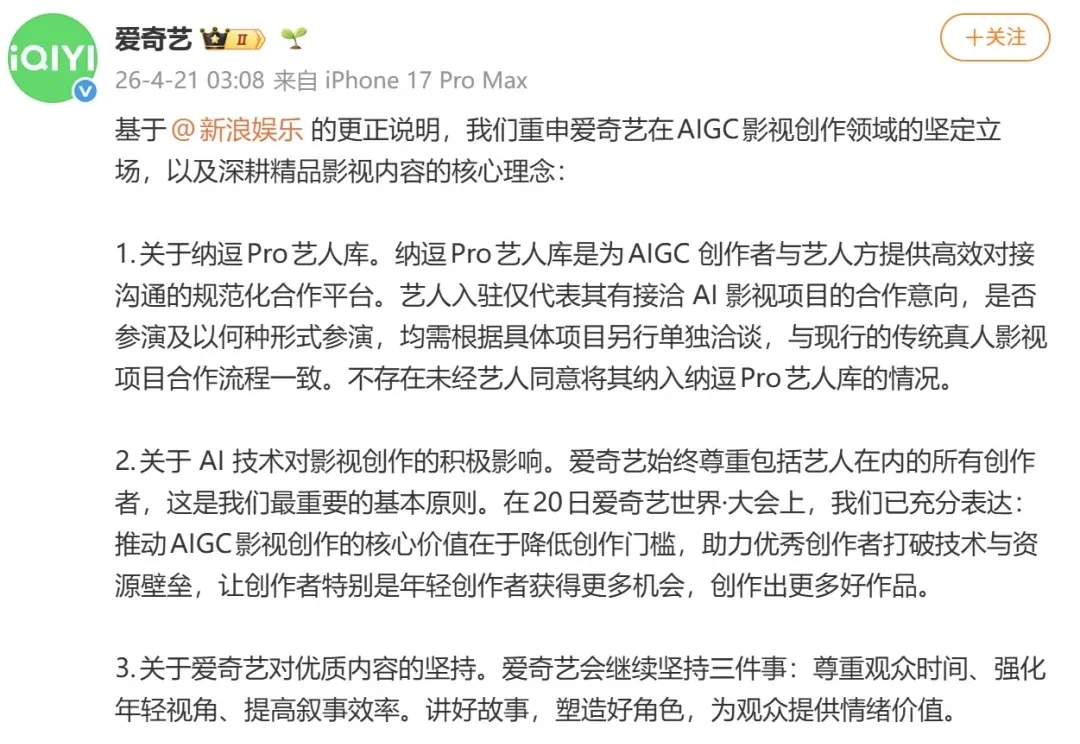

4月21日凌晨,@爱奇艺 再次发文重申在AIGC影视创作领域的坚定立场,以及深耕精品影视内容的核心理念:

如果把今天最热门的几个方向摆在一起看,你会发现它们其实在卡同一道坎。

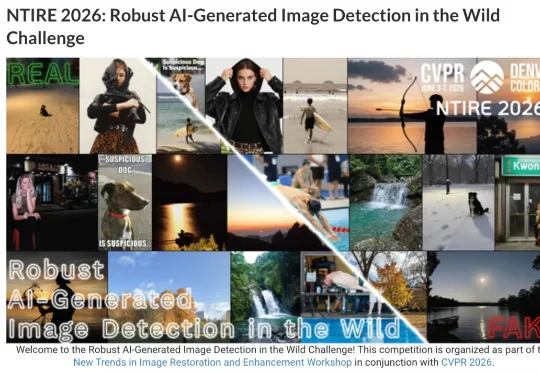

最近,计算机视觉领域的顶级会议 CVPR 2026 的 NTIRE 鲁棒性 AIGC 图像检测挑战赛( Robust AI-Generated Image Detection in the Wild Challenge )结果出炉。蚂蚁集团 AI 安全实验室的队伍 MICV 凭借在鲁棒性测试样本上 ROC AUC 达到了惊人的 0.9723,成功摘得「复杂真实场景鲁棒性样本测试」挑战赛的冠军。

《读佳》独家获悉,腾讯在开发一款名为“探梦DreamNow”的AI产品,这是一个AIGC内容创作内容展示互动平台,用户可以看到其他人创作的AI视频和图片,最特别的一点是包含互动影游的创作和展示,不过,目前该产品功能并不完善,可能还处于打磨研发阶段,具体以官方为主。

在会上,昆仑万维旗下天工 AI 重磅发布了全新 AI 游戏世界模型 Matrix-Game 3.0、AI 视频大模型 SkyReels V4 和 AI 音乐大模型 Mureka V9,在继续强化 AIGC 理解与生成能力的同时,进一步推进 AI 对物理世界的建模与仿真。

在 AIGC 领域,基于参考图像的图像修复(Reference-based Inpainting)一直是一项备受关注的核心任务,它旨在利用参考图像引导修复过程,生成视觉一致的内容。这一技术在广告营销和电商领域有着巨大的应用潜力,例如让 AI 自动生成 “真人手持或穿戴商品” 的展示图。

2月7日,字节跳动AI视频生成模型Seedance2.0开启灰度测试,该模型支持文本、图片、视频、音频素材输入,可以完成自分镜和自运镜,镜头移动后人物特征能够保持一致。