AI意识「觉醒」!图灵得主Bengio重磅发声:AI正接近人类意识临界点

AI意识「觉醒」!图灵得主Bengio重磅发声:AI正接近人类意识临界点有意识的AI,距离我们有多近?近日,图灵奖得主Bengio等人发表在《Science》的一篇文章提到:不管是碳基,还是硅基,都可能出现意识。AI研究,可能推动越来越多的公众相信AI会产生意识,但也可能带来一系列风险与社会伦理争议。

搜索

搜索

有意识的AI,距离我们有多近?近日,图灵奖得主Bengio等人发表在《Science》的一篇文章提到:不管是碳基,还是硅基,都可能出现意识。AI研究,可能推动越来越多的公众相信AI会产生意识,但也可能带来一系列风险与社会伦理争议。

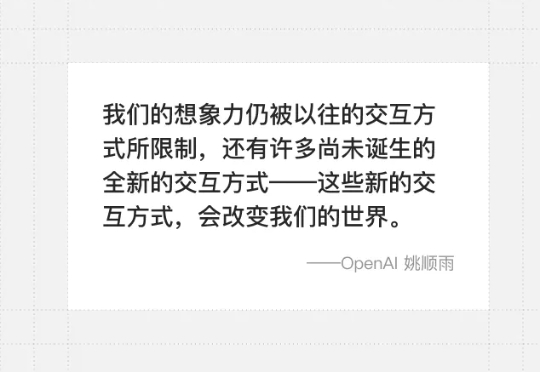

2025年4月,OpenAI研究员姚顺雨发布了一篇有名的博文《The Second Half》,宣告AI主线程的游戏已进入下半场。这之后,我们与他进行了一场播客对谈。姚顺雨毕业于清华和普林斯顿大学,博士期间意识到语言是人类发明的最重要的工具,也是最有可能构建通用系统的,于是转向Language Agent研究,至今已6年。

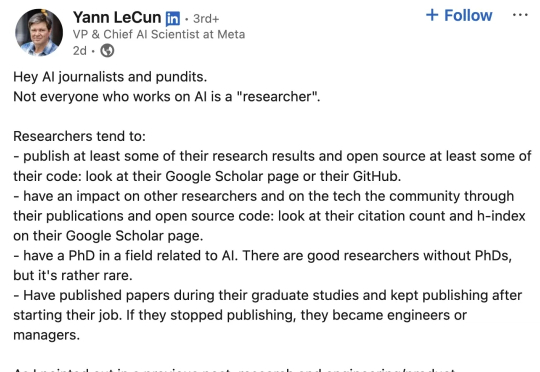

Meta内讧大戏再升级!首席AI官Alexandr Wang审核图灵奖大佬论文,LeCun亲自发帖疑似暗讽28岁新上司。没有PhD、没开源代码、没发表论文,都称不上AI研究员。

近日,「AI教父」Geoffrey Hinton在一次采访中再发预警:「杀手机器人」「无人机」等致命自主武器的兴起,正在让战争变得更易发动。Hinton认为OpenAI、Anthropic等许多AI公司在AI安全方面做得都不够。他还谈到了贪婪、自负等人性弱点,对AI研究可能带来的潜在风险。

苹果又失去了四名AI研究员,其中三人是华人。

Ilya「换头」全网炸锅,难道内部已实现「超级智能」?另一边,OpenAI研究员集体高潮,惊呼感受AGI,究竟在憋着什么大招?

AI已经能够自主思考并证明新的数学规律了? OpenAI研究人员表示,自己喂给GPT-5 Pro一篇论文,结果模型读完之后得到了新的结论。

这真的是一种平衡艺术——要搞清楚模型应该具备哪些特性,以及我们希望它给人的“感觉”是什么。GPT-5发布时,我们觉得正好是一次重置和重新思考的机会。尤其是,现在要让一个模型变得很“有互动感”其实很容易,但有时候这种互动可能是不健康的,所以我们想让它成为一个健康、有帮助的助手。

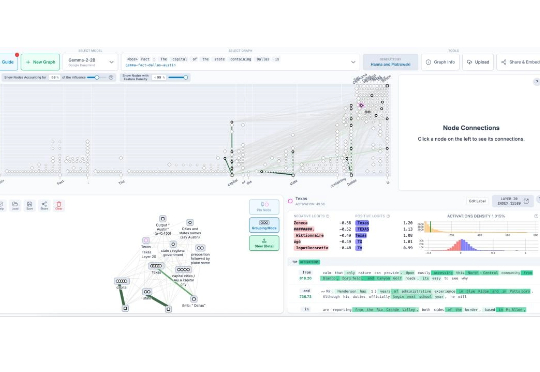

智东西8月20日报道,8月16日,Anthropic最新一期官方油管视频上线,三位AI研究员抽丝剥茧,深入探讨AI研究不应避开的一个关键“谜团”——大模型究竟是怎么思考的?

研究人员分析了20万条AI对话、整合了近3万项职业任务数据,通过计算覆盖率、成功率和影响范围三个维度,为每个职业算出了AI适用性分数。