首个AI神作!一人分饰全角,万人围观外星人嘲讽人类灭绝

首个AI神作!一人分饰全角,万人围观外星人嘲讽人类灭绝在AI时代,一个洛杉矶电影人用AI工具打造出「电影宇宙」——外星格隆人研究人类文明的搞笑伪纪录片,从健身到橄榄球,全是滑稽误解!

在AI时代,一个洛杉矶电影人用AI工具打造出「电影宇宙」——外星格隆人研究人类文明的搞笑伪纪录片,从健身到橄榄球,全是滑稽误解!

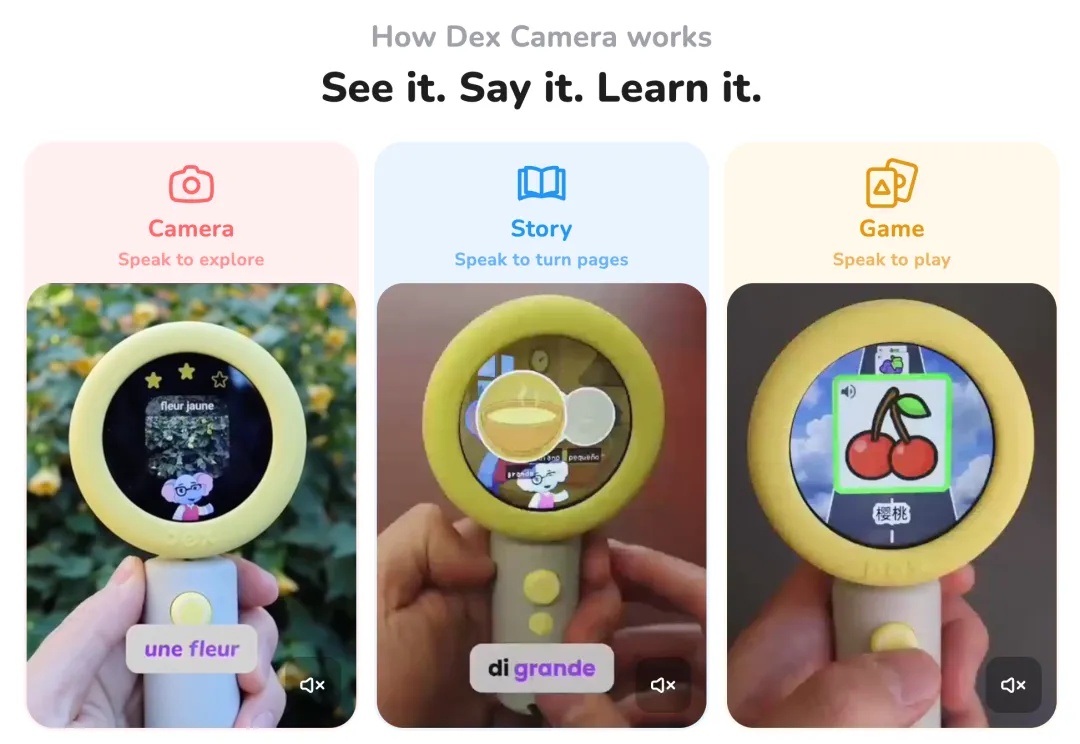

最近看了不少早期硬件创业项目,逐渐发现 AI 的能力确实是一批新兴硬件公司和硬件品类的「惊蛰」时刻。

AI创作正在成为B站上新的流量密码。而且诸多信号显示着这种密码的有效性。

憨豆先生坐在《猫和老鼠》的客厅里,汤姆在一旁跌进油漆桶,杰瑞躲在沙发后偷笑。这一幕,不是梦,也不是恶搞,而是AI真实生成的画面。在最新一篇论文中,研究者让从未共存的角色相遇,并解决了「风格错乱」的世纪难题。也许,我们正在迎接一个虚构与真实彻底混合的时代。

一篇入围顶会NeurIPS’25 Oral的论文,狠狠反击了一把DiT(Diffusion Transformer)。这篇来自字节跳动商业化技术团队的论文,则是提出了一个名叫InfinityStar的方法,一举兼得了视频生成的质量和效率,为视频生成方法探索更多可能的路径。

在这个AI生成视频泛滥的时代,我们习惯看到“AI一键出片”“模版复刻”,却少有真正能触碰商业大片质感的作品。

最近,各种脑洞大开的「人类失踪」视频开始在网上爆火,播放量动辄几十万甚至上百万。不过,这些事情根本没发生过,全是由AI批量炮制的!大波网友边看边喊上头,在留言区真情实感起来。这些AI脑洞真假难辨,直接骗过了不少人,攻击力堪比「兔子蹦迪」。

可乐可乐是真头铁, 24年用AI做广告挨骂,25年继续用继续挨骂,主要是创意很偷懒,两年了还给我看同一条广告。

最近,在B站上出现了一个长达近7分钟的“纯AI综艺”,讲全世界6位厨师如何把灭绝了6500万年的远古沧龙做成6道菜,收获了700多万点击。有人压根没看出来这是AI做的,还以为是美国烹饪竞技真人秀《地狱厨房》出了续集。

11 月 3 日,据 Deadline 报道,AI 原生影视工作室 Utopai Studios 与全球创新投资平台 Stock Farm Road(SFR)宣布成立资本规模达数十亿美元的合资公司 Utopai East,以加速韩国影视的国际化进程。SFR 背后,一面是 LG 集团继承人 Brian Koo,另一面是阿联酋主权基金推动者 Amin Badr-El-Din。