MetaMind元认知多智能体,让LLM理解对话背后的深层意图,首次达到人类水平 | 最新

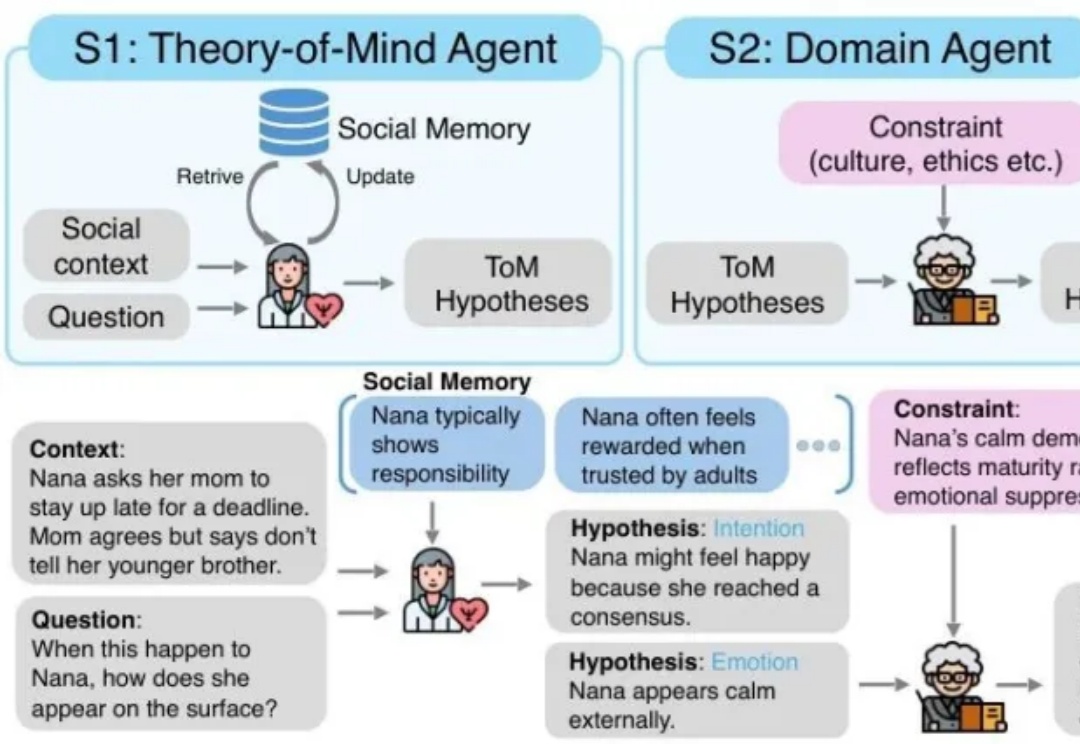

MetaMind元认知多智能体,让LLM理解对话背后的深层意图,首次达到人类水平 | 最新MetaMind是一个多智能体框架,专门解决大语言模型在社交认知方面的根本缺陷。传统的 LLM 常常难以应对现实世界中人际沟通中固有的模糊性和间接性,无法理解未说出口的意图、隐含的情绪或文化敏感线索。MetaMind首次使LLMs在关键心理理论(ToM)任务上达到人类水平表现。

搜索

搜索

MetaMind是一个多智能体框架,专门解决大语言模型在社交认知方面的根本缺陷。传统的 LLM 常常难以应对现实世界中人际沟通中固有的模糊性和间接性,无法理解未说出口的意图、隐含的情绪或文化敏感线索。MetaMind首次使LLMs在关键心理理论(ToM)任务上达到人类水平表现。

在沙特阿拉伯哈撒地区,一间看似普通的诊所正悄然掀起一场医疗革命:患者缓缓步入诊室,迎接他们的并非传统印象里身着白大褂、神情专注的医生,而是一位 “AI 医生”。

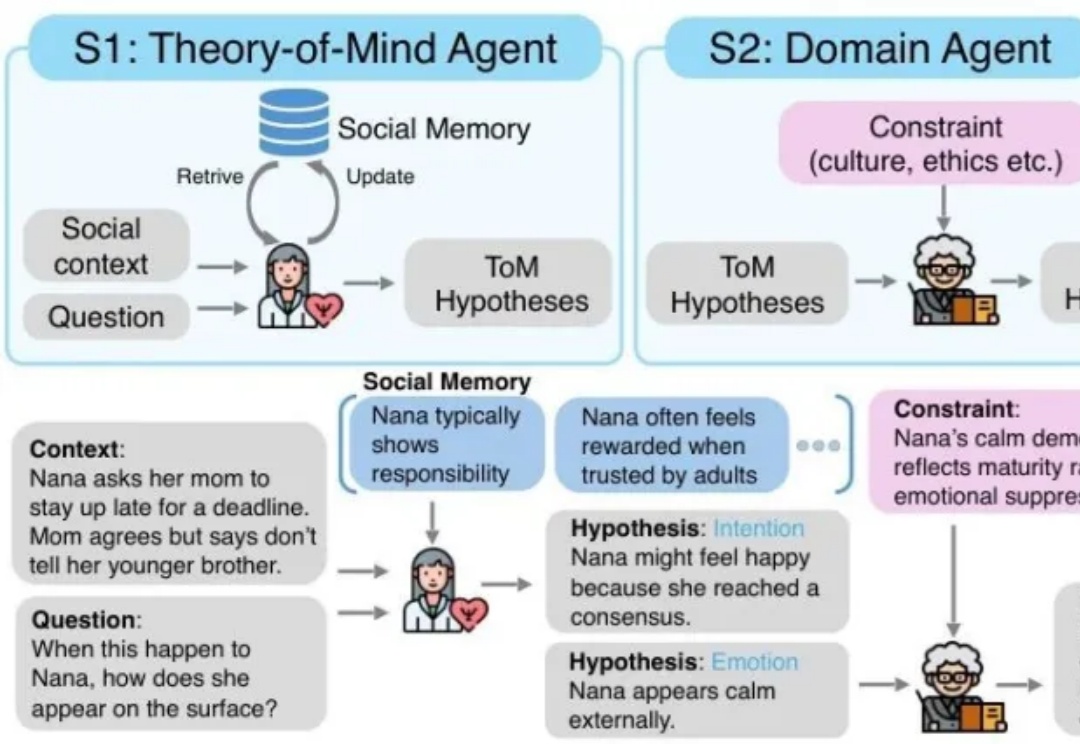

多模态大模型(MLLMs)在视觉理解与推理等领域取得了显著成就。然而,随着解码(decoding)阶段不断生成新的 token,推理过程的计算复杂度和 GPU 显存占用逐渐增加,这导致了多模态大模型推理效率的降低。

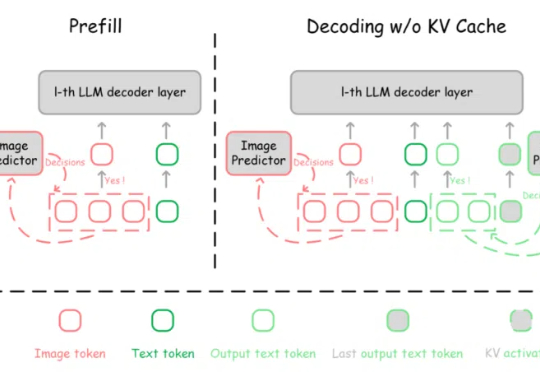

消费级AI机器人公司「X-ORIGIN-AI」(玄源科技)宣布完成近亿元Pre-A轮融资,本轮由东方富海领投,金鼎资本与联想之星跟投,仁辰资本担任财务顾问。本轮融资距离X-ORIGIN-AI的天使轮融资仅有不到一季度时间,此前的数千万元天使轮由阿尔法公社领投,多名产业投资人跟投。

近日,北京字跳网络技术有限公司登记“即梦AI/Dreamina AI”作品著作权,作品类别为美术。即梦AI作为一款面向创意爱好者的AI表达平台,功能丰富。然而,在我国现行法律框架下,AI生成内容的著作权归属尚无明确界定,引发广泛讨论。

这个号称世界上第一个AI天使投资人的No Cap,由Jeff wilson、Alexander Nevedovsky 和 Slava Solonitsyn打造,并在最近拿到了YC的投资。No Cap号称是通过一个“No Cap Mafia”社区训练出来的。在这个社区里,No Cap会接受很多公司创始人的指导,目前已经有超过60位创始人(他们都是YC的校友)参与其中。

天啦噜!现在玩游戏都能进化到这种程度了??

一直以来,AI 领域的研究者都喜欢让模型去挑战那些人类热衷的经典游戏,以此来检验 AI 的「智能程度」。

过去一年,3D 生成技术迎来爆发式增长。在大场景生成领域,涌现出一批 “静态大场景生成” 工作,如 SemCity [1]、PDD [2]、XCube [3] 等。这些研究推动了 AI 利用扩散模型的强大学习能力来解构和创造物理世界的趋势。

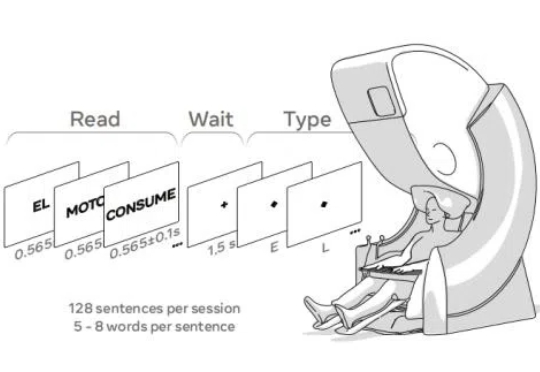

今天,Meta 公布了两项重磅研究,他们联合认知科学和神经科学顶尖研究机构巴斯克认知、大脑和语言中心(BCBL),采用非侵入式方法利用 AI 解码大脑语言、并进一步理解人类大脑如何形成语言。这两项突破性的研究成果也使得高级机器智能(Advanced Machine Intelligence, AMI)更加接近实现。