英伟达GPU,将沦为白菜价

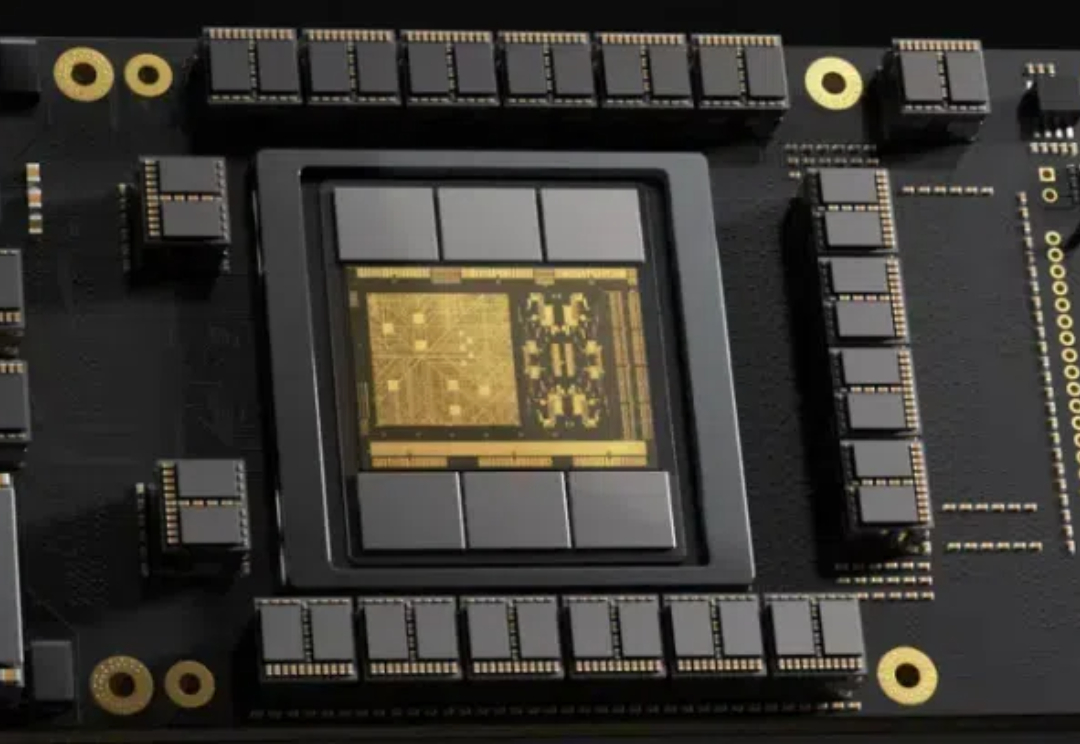

英伟达GPU,将沦为白菜价刚刚,彼得·蒂尔一句话捅破天花板:AI芯片最终不会稀缺,将沦为白菜价。当AMD、ASIC、TPU、Trainium联手围剿,英伟达的暴利时代正在倒计时。

搜索

搜索

刚刚,彼得·蒂尔一句话捅破天花板:AI芯片最终不会稀缺,将沦为白菜价。当AMD、ASIC、TPU、Trainium联手围剿,英伟达的暴利时代正在倒计时。

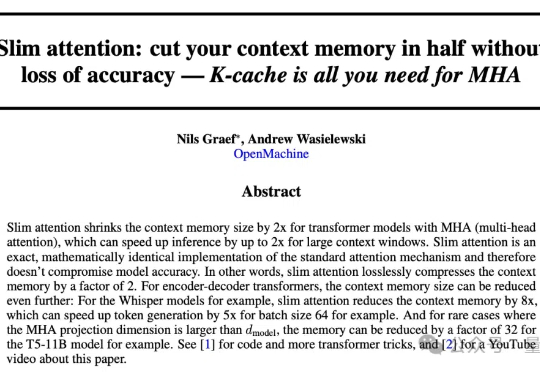

大模型同样的上下文窗口,只需一半内存就能实现,而且精度无损? 前苹果ASIC架构师Nils Graef,和一名UC伯克利在读本科生一起提出了新的注意力机制Slim Attention。

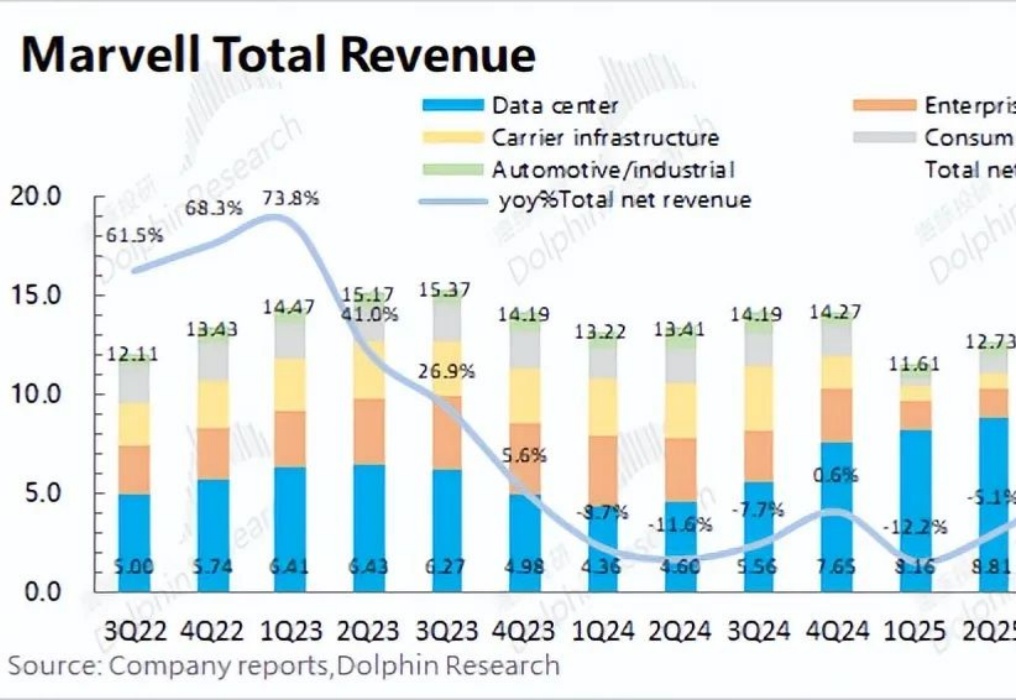

诚如我们在《Deepseek的意义、价值与影响》中所阐述的那样,开源模型Deepseek的率先冲线,标志着 “机器智能寒武纪时刻”的启动,产业即将因此进入应用创新大爆发周期。

2022年,我们打赌说transformer会统治世界。 我们花了两年时间打造Sohu,这是世界上第一个用于transformer(ChatGPT中的“T”)的专用芯片。

AI算力变革的持续推动功不可没。

与英伟达的震荡走势形成对比的是,美股AI产业链新一批“明星股”正在崛起。这些公司覆盖了AEC、DCI、存储、ASIC、光纤等业务,多家透露订单强劲,从中或许不难窥见AI基建投资的最新风向。

NVIDIA DGX GB200 超级计算集群数据中心部署指南解读,NVIDIA AI 工厂部署与 Broadcom AI 计算 ASIC 光学连接技术

大语言模型(LLM)的发展同时往往伴随着硬件加速技术的进化,本文对使用 FPGA、ASIC 等芯片的模型性能、能效表现来了一次全面概览。

AI芯片的创新从未停止。

在商业需求更明确的未来,FPGA或ASIC将成为更优的底层计算设备。