专访 | 核心团队来自浙大和阿里,这个团队构建「物理AI的原生本体」,要做真正的AI native硬件公司

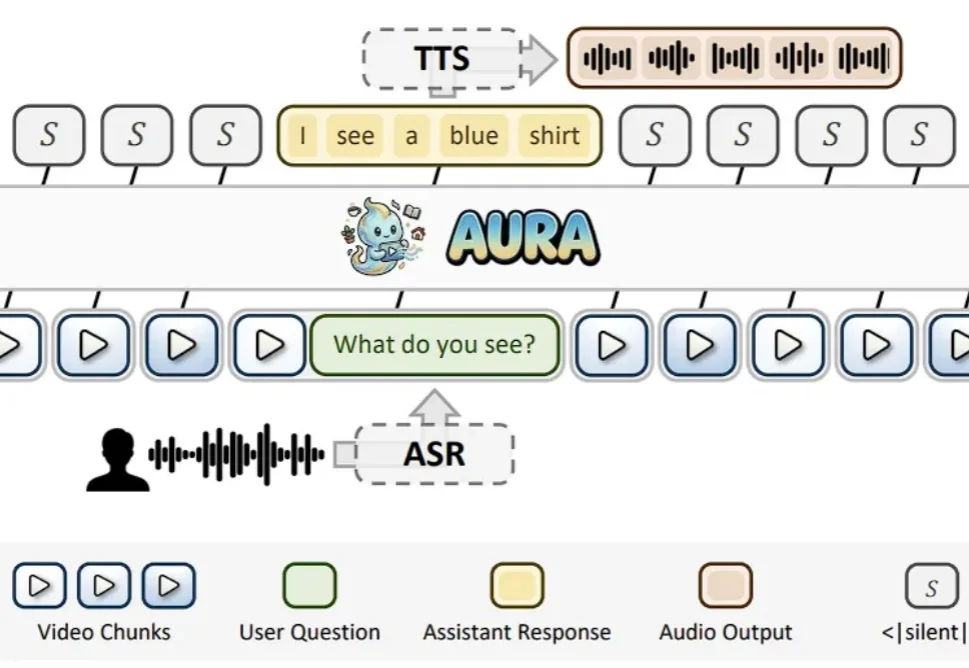

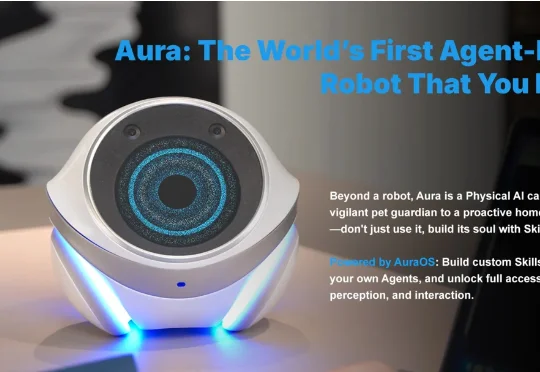

专访 | 核心团队来自浙大和阿里,这个团队构建「物理AI的原生本体」,要做真正的AI native硬件公司三年后,这个判断变成了一家叫FrontierX的公司,和它的产品Aura——一个球形的、能在室内自由移动、端侧部署感知和模型的「开放定义的机器人」。FrontierX诞生于杭州,是一家以感知智能为核心的AI原生硬件公司,由来自浙江大学和阿里巴巴的团队创立。团队背景多元,涵盖硬件工程师、算法工程师、产品经理和工业设计师。

来自主题: AI资讯

8051 点击 2026-05-13 10:28