Adam的稳+Muon的快?华为诺亚开源ROOT破解大模型训练「既要又要」的两难困境

Adam的稳+Muon的快?华为诺亚开源ROOT破解大模型训练「既要又要」的两难困境在 LLM 优化领域,有两个响亮的名字:Adam(及其变体 AdamW)和 Muon。

来自主题: AI技术研报

10468 点击 2025-11-27 14:37

搜索

搜索

在 LLM 优化领域,有两个响亮的名字:Adam(及其变体 AdamW)和 Muon。

自2014 年提出以来,Adam 及其改进版 AdamW 长期占据开放权重语言模型预训练的主导地位,帮助模型在海量数据下保持稳定并实现较快收敛。

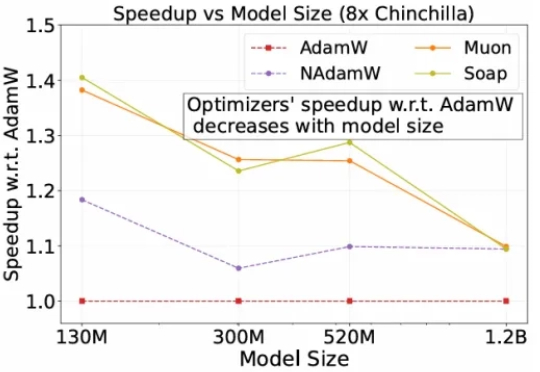

为了降低大模型预训练成本,最近两年,出现了很多新的优化器,声称能相比较AdamW,将预训练加速1.4×到2×。但斯坦福的一项研究,指出不仅新优化器的加速低于宣称值,而且会随模型规模的增大而减弱,该研究证实了严格基准评测的必要性。

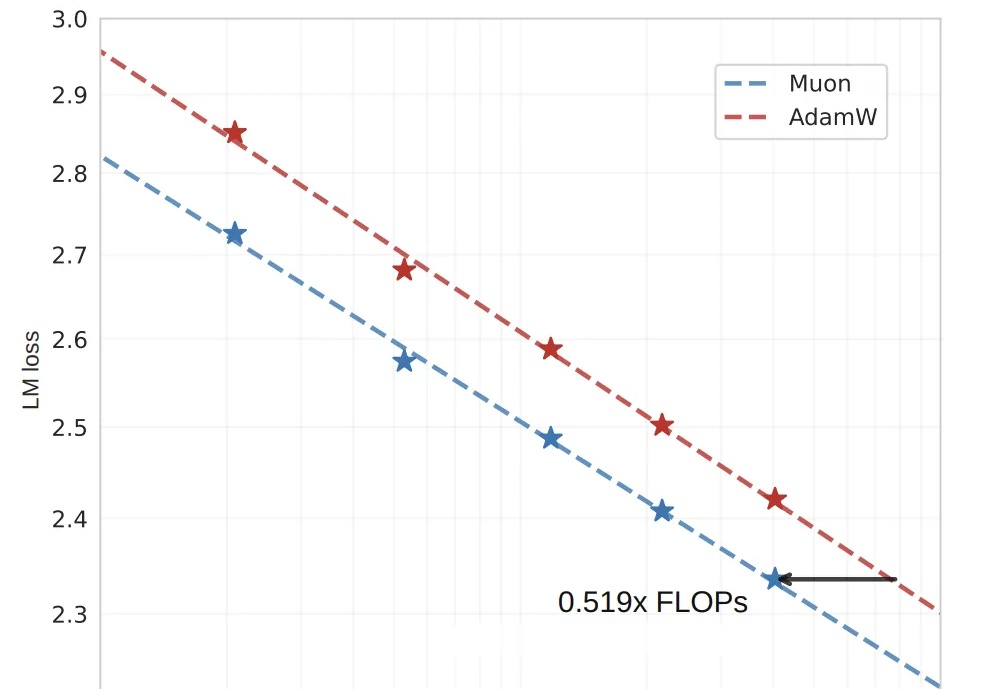

算力需求比AdamW直降48%,OpenAI技术人员提出的训练优化算法Muon,被月之暗面团队又推进了一步!