还好我没学剪映,这个 skill 做的视频真不错

还好我没学剪映,这个 skill 做的视频真不错身边做短视频的朋友,几乎人手一个剪映。

搜索

搜索

身边做短视频的朋友,几乎人手一个剪映。

现象级AI视频技术、字节Seedance 2.0在arXiv发论文了。晒了26页的Benchmark,和贡献者名单。170位团队成员全公开,署名和尊重都拉满了,不过嘛这就不怕……嘛?

Vidu Q3带着「全家桶」重磅回归,视觉、听觉、场景能力全面进化。AI视频的生产级交付时代,真的来了。

1977 年,乔治·卢卡斯为了拍《星球大战》,专门成立了一家公司,叫工业光魔。

“你好,老板,你这个视频我们用即梦Seedance 2.0 生成,这一条视频报价1235.25元人民币,我们分分钟就可以用这1609.45元做出来这条视频,这可是仅仅2235.32元人民币就能换来的视频爆款,都不知道有多划算,我们产出一条视频仅需要一天,白天开工,到了晚上您只需要支付3245.98元就可以了,现在签合同吗?”

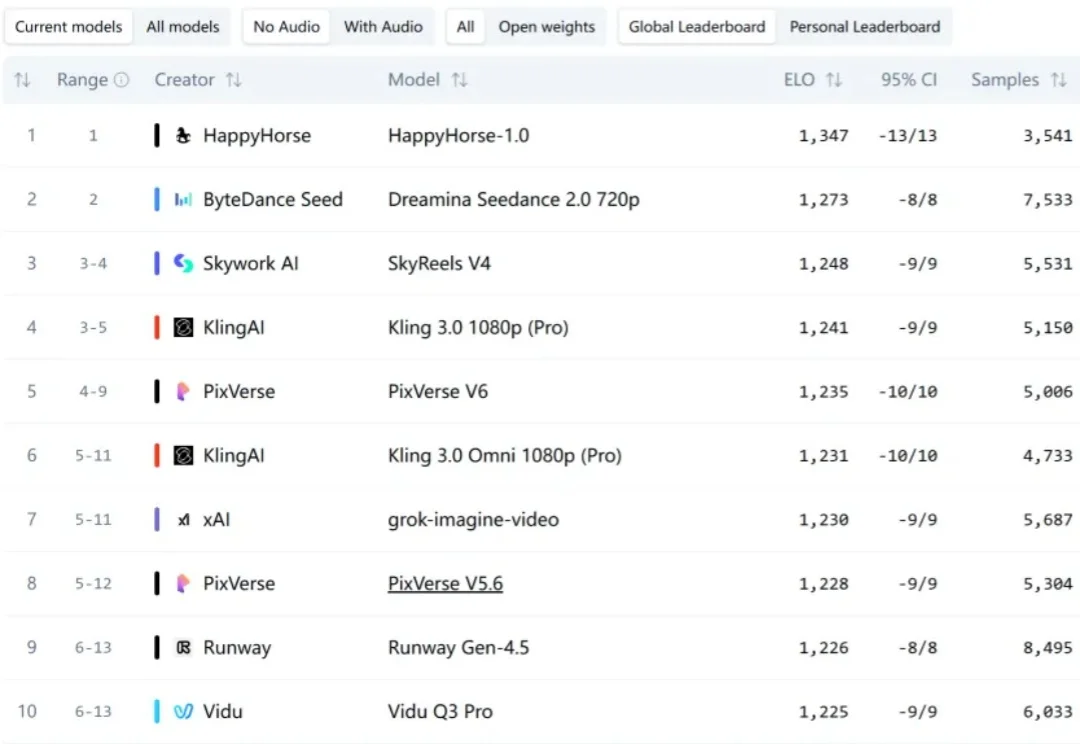

刚刚,这只爆火的「欢乐马」被认领了!是来自阿里巴巴 ATH 旗下郑波团队的模型,ATH 也就是不久前阿里刚成立的 AI 核心事业群 Alibaba Token Hub。阿里巴巴 ATH 表示:HappyHorse 是阿里 ATH 旗下创新事业部研发的模型,目前正处于内测中,也会于近期开放 API。

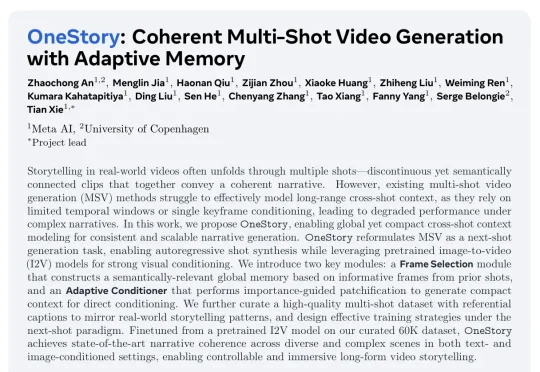

最近,来自Meta与University of Copenhagen的研究者提出了OneStory: Coherent Multi-Shot Video Generation with Adaptive Memory(收录于CVPR 2026)。这项工作聚焦于一个核心问题:如何在生成多镜头视频时,有效保留长程跨镜头上下文,从而实现更强的叙事一致性。

HappyHorse身份曝光,或将明天上线?

就在 OpenAI 都停了 Sora,所有人以为 Seedance 2.0 要一统天下的时候,没想到不知哪里冒出来一匹马。

《读佳》独家获悉,腾讯在开发一款名为“探梦DreamNow”的AI产品,这是一个AIGC内容创作内容展示互动平台,用户可以看到其他人创作的AI视频和图片,最特别的一点是包含互动影游的创作和展示,不过,目前该产品功能并不完善,可能还处于打磨研发阶段,具体以官方为主。