不用排长龙!JiuwenClaw助你一键养龙虾!

不用排长龙!JiuwenClaw助你一键养龙虾!一个月前我们发布了基于华为 openJiuwen 开源社区构建的 DeepAgent 和 DeepSearch 两款智能体双双霸榜 [DeepAgent与DeepSearch双双霸榜!答案指向openJiuwen这一新兴开源项目]

搜索

搜索

一个月前我们发布了基于华为 openJiuwen 开源社区构建的 DeepAgent 和 DeepSearch 两款智能体双双霸榜 [DeepAgent与DeepSearch双双霸榜!答案指向openJiuwen这一新兴开源项目]

“时光流转,谁还用日记本。往事有底片为证。”—— 许嵩《摄影艺术》

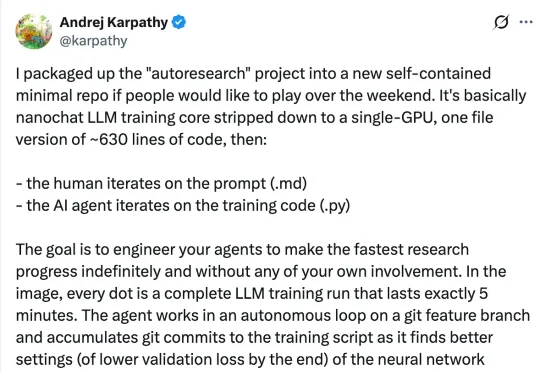

大神Karpathy又开源了新项目——一个能够自主进化的AI科研循环系统。这个项目名叫autoresearch,主打让智能体完全自主地搞科研,只要在Markdown文档里写好指令,剩下的流程全都由AI自动完成。

「2018 到 2023 年间在 EMNLP 会议上发表的那篇论文中,第一作者本科就读于达特茅斯学院、第四作者本科就读于宾夕法尼亚大学的那篇科学论文,题目是什么?」

就在刚刚,Google Research团队用Gemini Deep Think + 树搜索框架,独立攻克了一个理论物理领域的未解积分难题——宇宙弦引力辐射功率谱的精确解析解。AI探索了600条候选路径,找出6种解法,最优雅的那条,让人类物理学家都拍案叫绝。

如果科研中的文献阅读、代码演进、实验验证都可以由智能体自主完成,科学发现的方式会被重新定义吗?自主科研智能体(Autonomous Research Agent)的兴起,正在把这一设想带入现实:科学家有望回归科学品味和探索源头,智能体承担科研全链路的繁琐工作,两者在人机协同的闭环中共探新的重大科研突破。

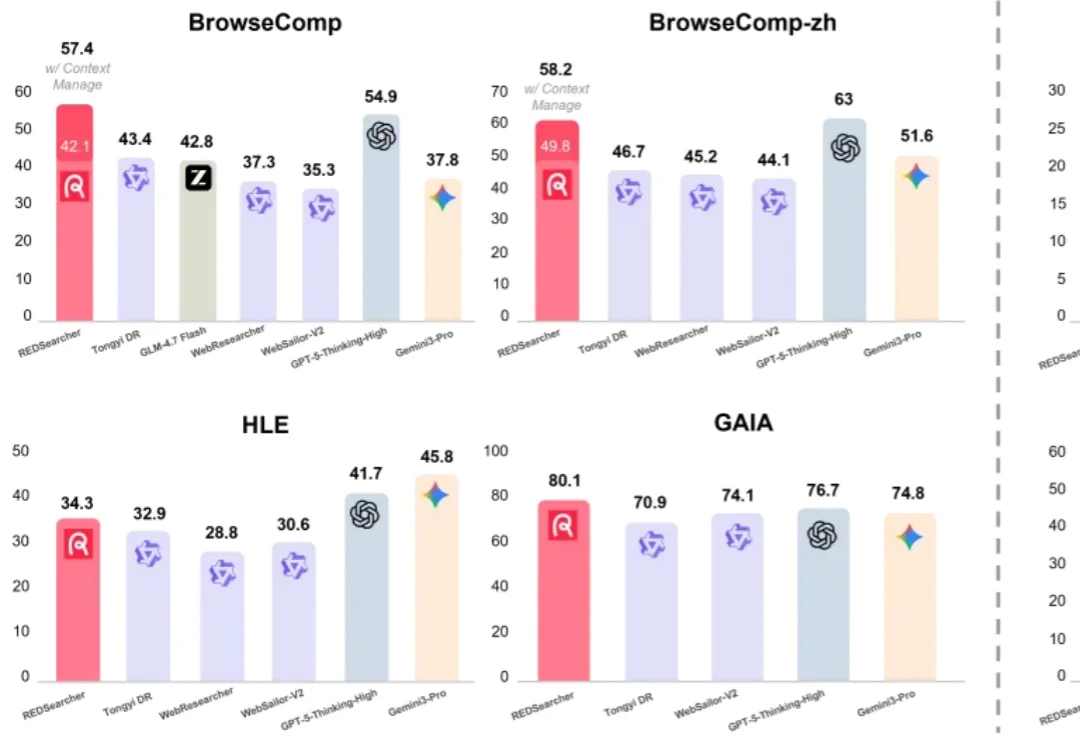

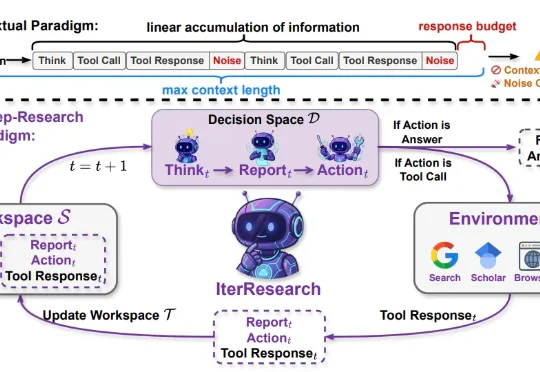

来自中国人民大学与阿里巴巴通义实验室的研究团队提出了 IterResearch,一种全新的迭代式深度研究范式。通过马尔可夫式的工作空间重构,IterResearch 让 Agent 在仅 40K 上下文长度下完成了 2048 次工具交互且性能不衰减,在 BrowseComp 上从 3.5% 一路攀升至 42.5%。

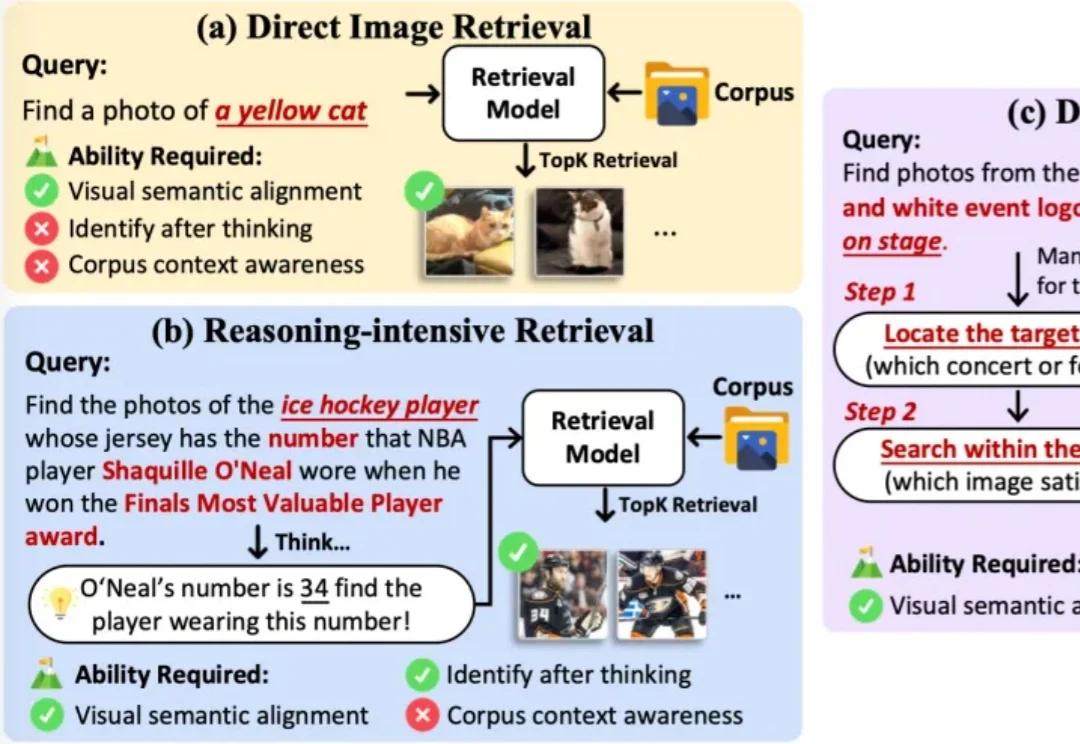

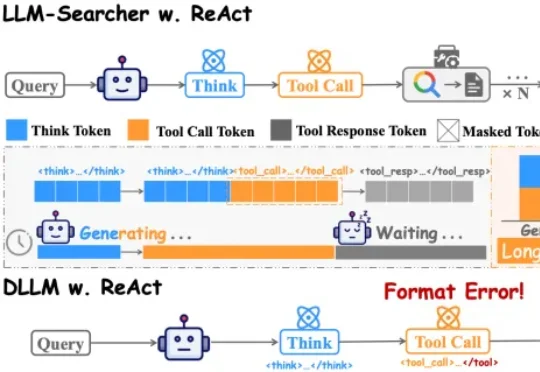

中国人民大学团队在论文DLLM-Searcher中,第一次让扩散大语言模型(dLLM)学会了这种“一心二用”的本事。目前主流的搜索Agent,不管是Search-R1还是R1Searcher,用的都是ReAct框架。这个框架的执行流程是严格串行的:

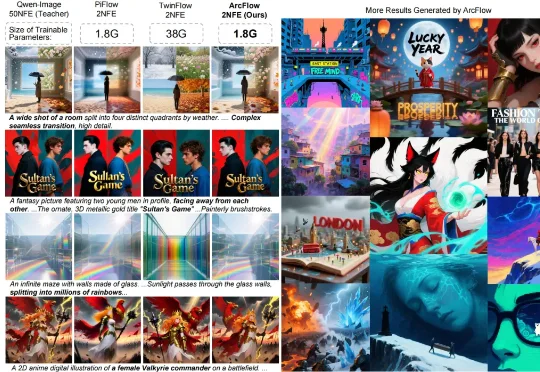

复旦大学与微软亚洲研究院带来的 ArcFlow 给出了答案:如果路是弯的,那就学会 “漂移”,而不是把路修直。在扩散模型中,教师模型(Pre-trained Teacher)的生成过程本质上是在高维空间中求解微分方程并进行多步积分。由于图像流形的复杂性,教师模型原本的采样轨迹通常是一条蜿蜒的曲线,其切线方向(即速度场)随时间步不断变化。

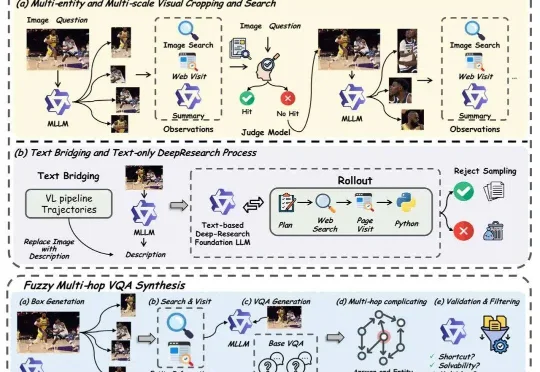

DeepResearch 的价值在于把「查资料」变成「做研究」:不是搜到一条就回答,而是会连续多轮地提出问题、去不同地方找证据、互相对照核实、再把信息整理成结构清晰的结论。这样做能显著降低「凭感觉瞎编