谷歌最新AI芯片打平英伟达B200,专为推理模型打造,最高配每秒42500000000000000000次浮点运算

谷歌最新AI芯片打平英伟达B200,专为推理模型打造,最高配每秒42500000000000000000次浮点运算谷歌首款AI推理特化版TPU芯片来了,专为深度思考模型打造。

谷歌首款AI推理特化版TPU芯片来了,专为深度思考模型打造。

谷歌重磅发布第七代TPU Ironwood,专为推理设计,性能较从初代飙升3600倍,可与英伟达B200一较高下。不仅如此,谷歌还带来了Veo 2等多款模型全新升级,就连「谷歌版」MCP协议也公布了。

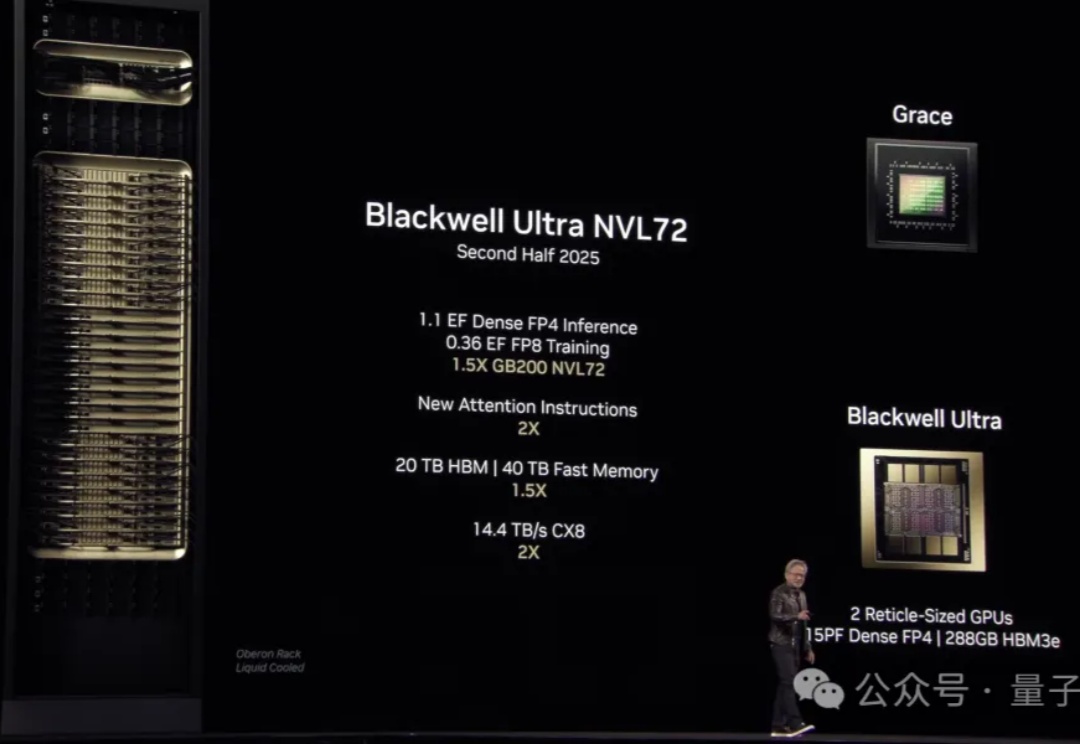

皮衣老黄,带着最强AI芯片GB300闪亮登场“AI超级碗”GTC,燃爆全场!

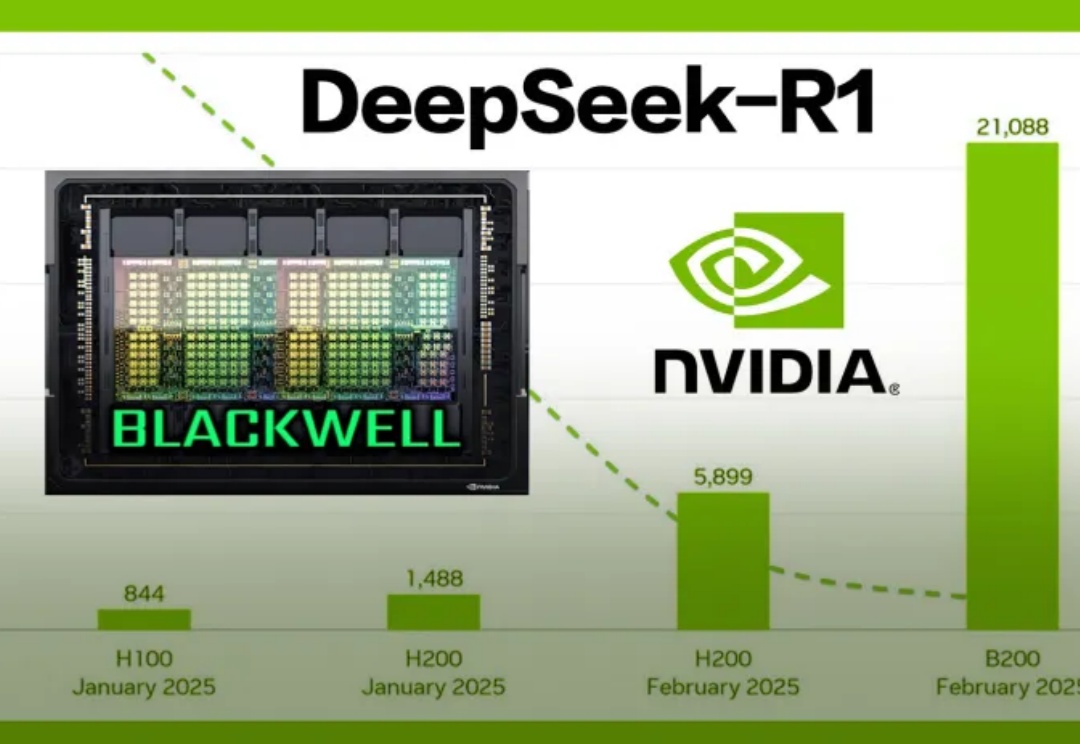

最近,英伟达开源了首个在Blackwell架构上优化的DeepSeek-R1,实现了推理速度提升25倍,和每token成本降低20倍的惊人成果。同时,DeepSeek连续开源多个英伟达GPU优化项目,共同探索模型性能极限。

GPU新核弹B300,以及附带CPU的超级芯片GB300。 高算力,在产品层面上相比B200在FLOPS上提高50% 大显存,从192GB提升到288GB,也是提高了50%。

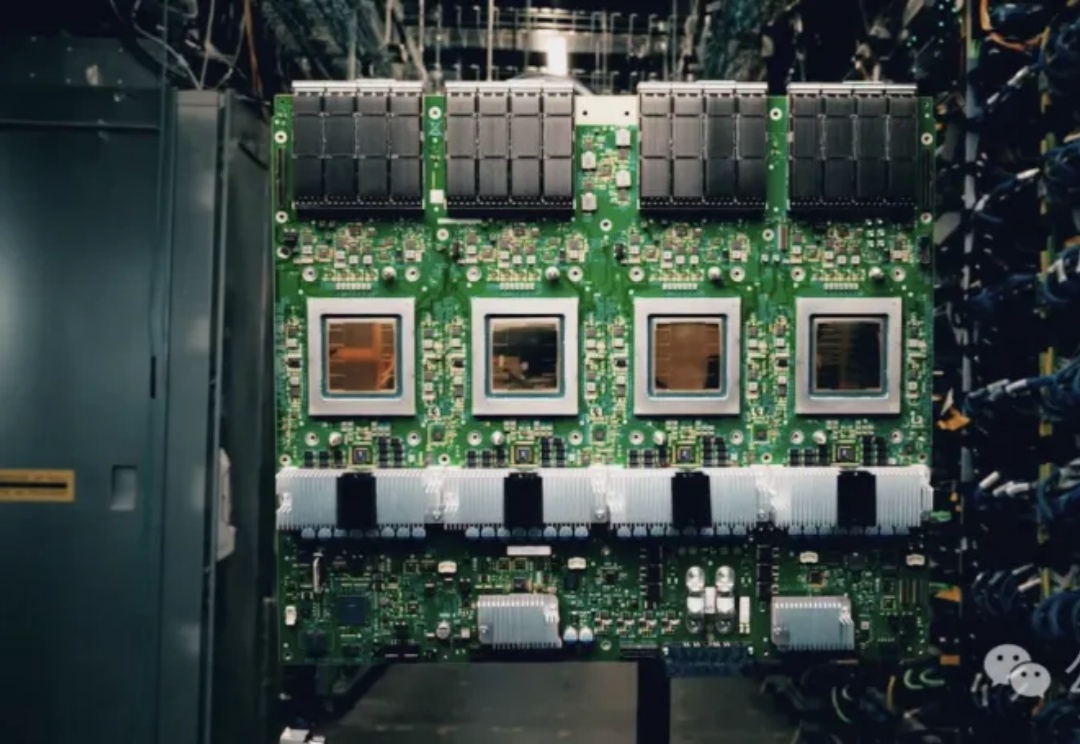

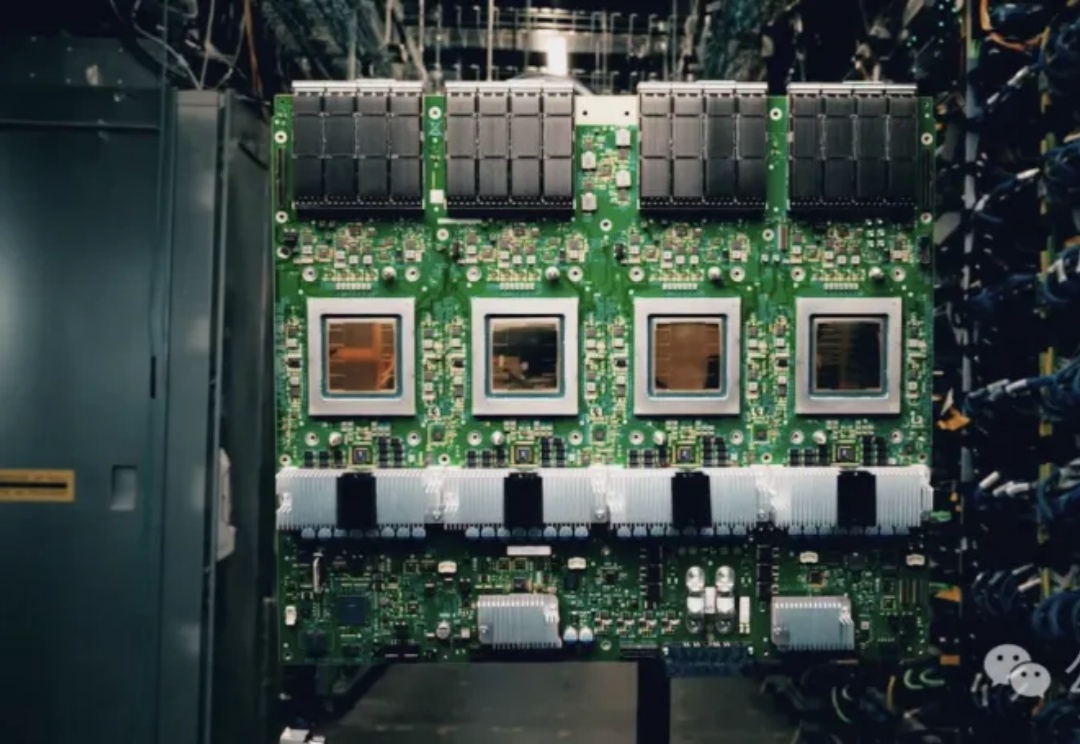

2024年英伟达GPU全球最大买家,竟是微软?购买总量将近50万块,超所有竞争对手近两倍。xAI已开心晒出首批发货的GB200 NVL72,喜滋滋的像是提前过年了。囤的GPU越多,模型就会越好吗?来不及解释了,赶紧上车,车门焊死!

抢疯了!马斯克找老黄加价插队拿显卡——为了加速xAI产品研发。

NVIDIA DGX GB200 超级计算集群数据中心部署指南解读,NVIDIA AI 工厂部署与 Broadcom AI 计算 ASIC 光学连接技术

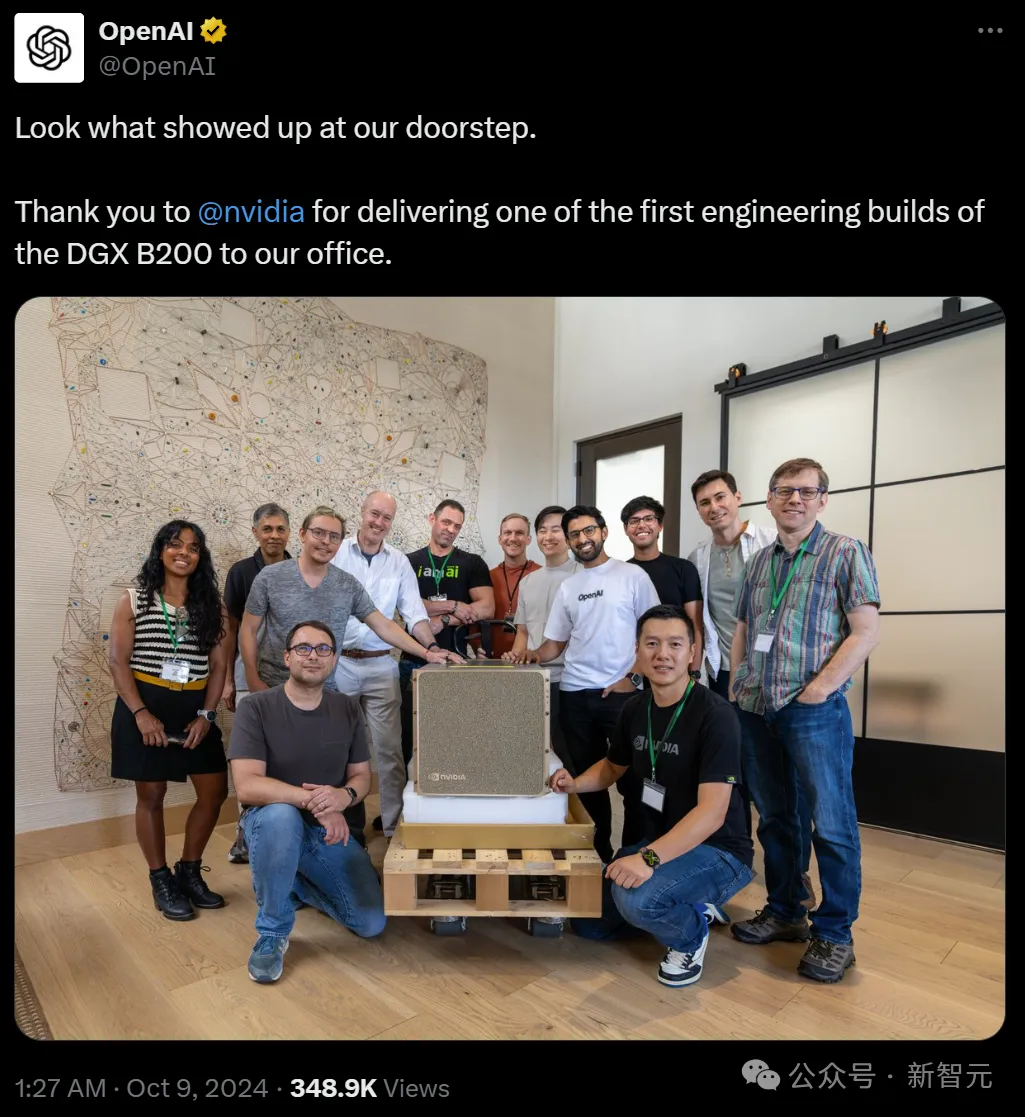

继首台DGX H200之后,OpenAI再次收到了英伟达的首批工程版DGX B200。外媒爆料称,由于微软提供算力不足,OpenAI正与甲骨文开始谈判了。

32GB GDDR7内存,CUDA核心数21760个——