深度拆解:AI 智能体 Harness 的构造【译】

深度拆解:AI 智能体 Harness 的构造【译】本文将深入探讨 Anthropic、OpenAI、Perplexity 和 LangChain 究竟在开发什么。我们将聊聊编排循环、工具、记忆、上下文管理,以及那些将“无状态”的大语言模型(LLM)转变为全能智能体(Agent)的底层机制。

搜索

搜索

本文将深入探讨 Anthropic、OpenAI、Perplexity 和 LangChain 究竟在开发什么。我们将聊聊编排循环、工具、记忆、上下文管理,以及那些将“无状态”的大语言模型(LLM)转变为全能智能体(Agent)的底层机制。

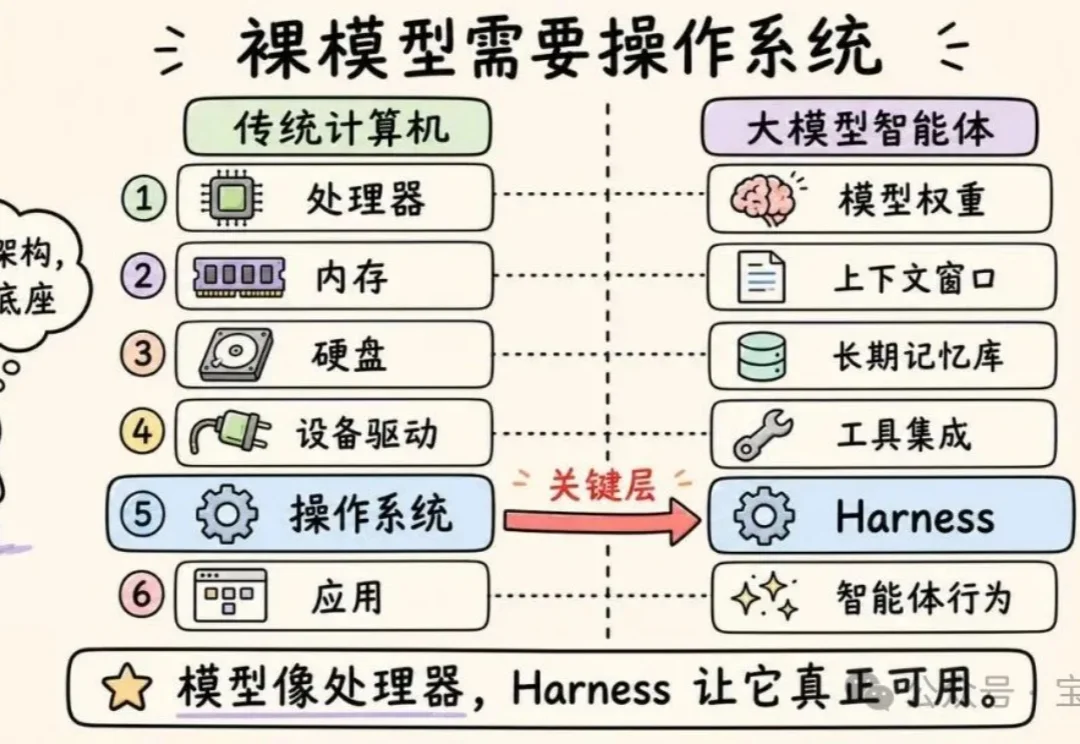

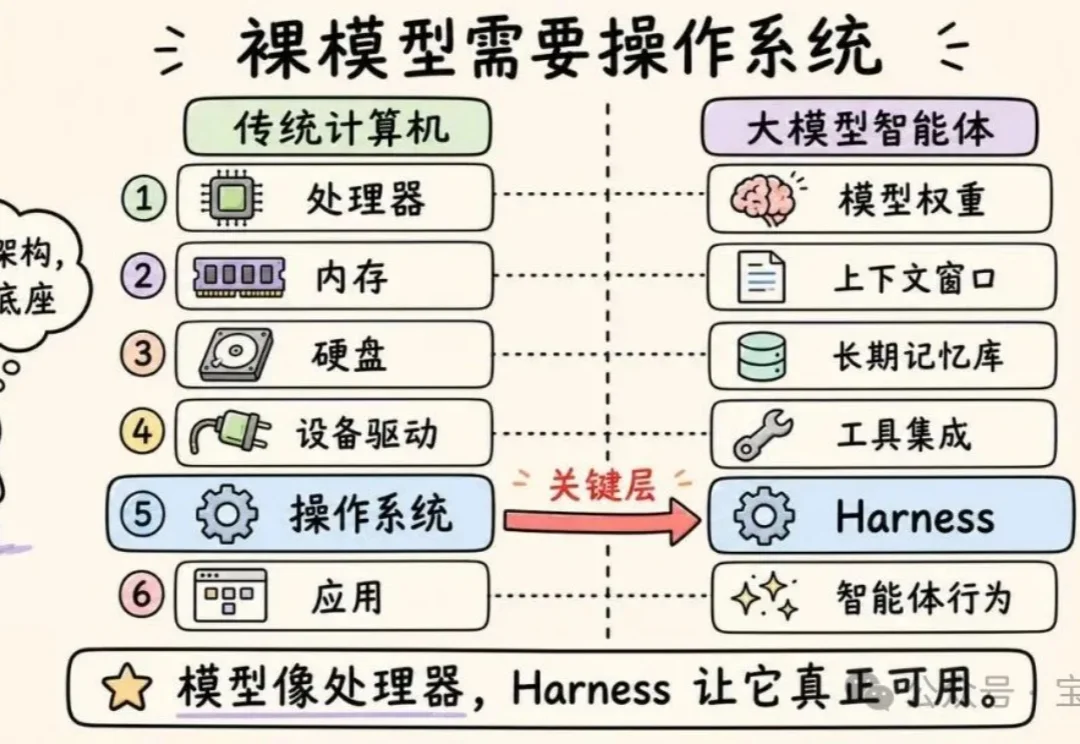

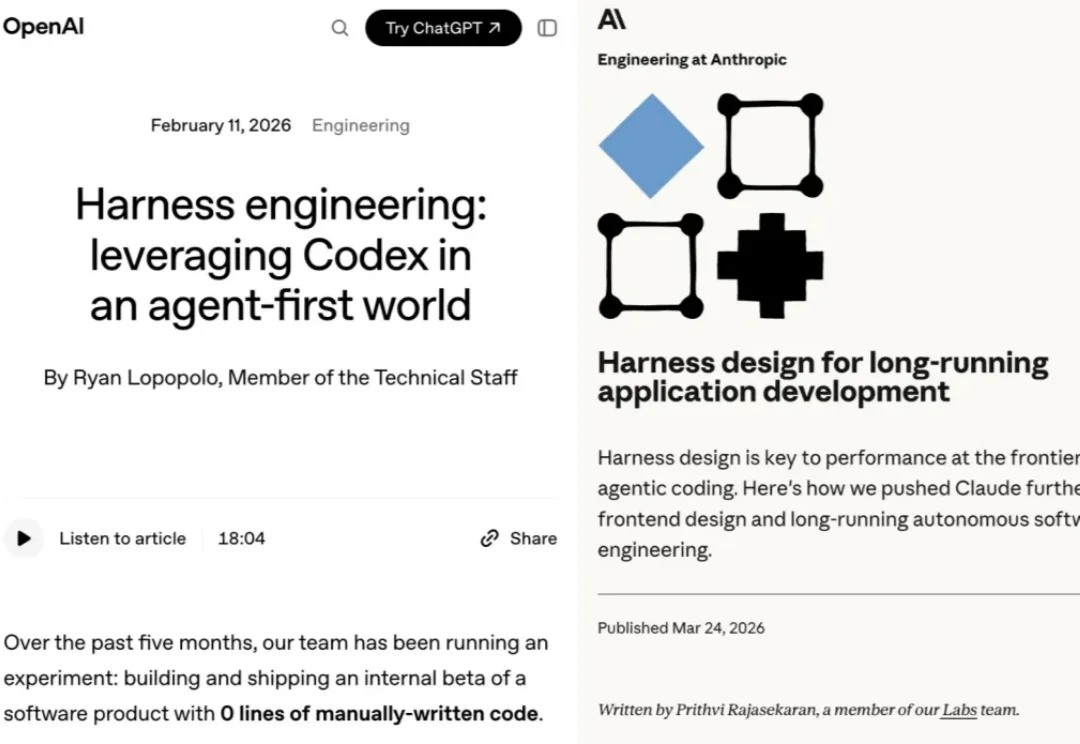

026 年初,OpenAI 和 Anthropic 几乎同时发布了关于 Harness 的技术实践文章,LangChain 工程师 Viv 给出了一个简洁的公式来概括这个理念:Agent = Model + Harness。模型提供智能,Harness 让这个智能能真正投入生产。

LangChain 联合创始人 Harrison Chase 上周发文,说透了 AI Agent 领域一个还没有多少人讲清楚的问题:外壳和记忆是同一件事,你没法分开。

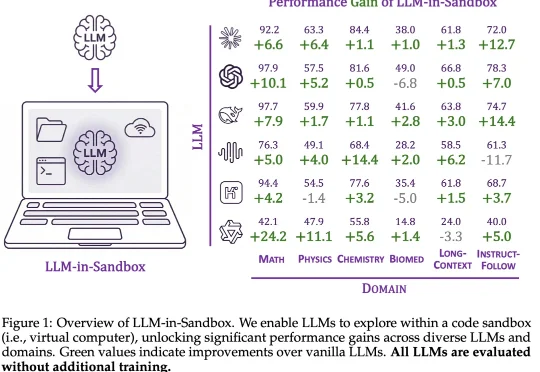

LangChain 只换了模型外面的基础设施——同一个模型、同一套权重——就从 TerminalBench 2.0 排行榜 30 名开外直接跳到了第 5 名。另一个独立研究项目让大模型自己优化这层基础设施,达到了 76.4% 的通过率,超过了所有人工设计的方案。

LangChain 只换了模型外面的基础设施——同一个模型、同一套权重——就从 TerminalBench 2.0 排行榜 30 名开外直接跳到了第 5 名。另一个独立研究项目让大模型自己优化这层基础设施,达到了 76.4% 的通过率,超过了所有人工设计的方案。

在 AI 圈,模型至上论正在遭遇前所未有的挑战。当所有人都在屏息等待新模型再次刷新智力天花板时,AI 基础设施领军人物、LangChain 联合创始人 Harrison Chase 在最新对话中抛出了新预判:大模型正在沦为大宗商品,而决定 Agent 成败的,是那个包裹在模型外的 Harness 。

本文作者 José Maria Macedo 是加密行业老牌研究机构 Delphi Digital 的联合创始人,也是 Delphi Ventures 的创始合伙人。Delphi 的客户包括 Polychain、Pantera、Ark Invest 等顶级基金,最近还专门开设了 AI 研究线 Delphi Intelligence。

在印度人工智能影响力峰会上,出现 AI 圈最尴尬的一次合影。印度总理莫迪举起 Sam Altman 和 Sundar Pichai 的手,其他大佬也纷纷效仿牵手,唯独 Altman 和 Anthropic CEO Dario Amodei 并肩站立。

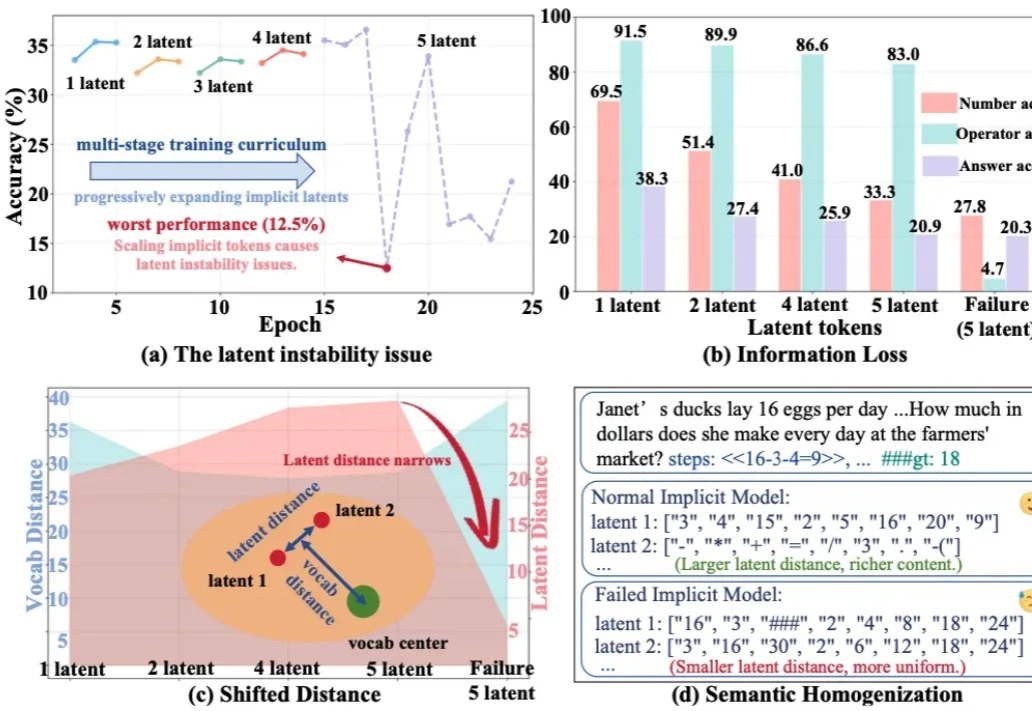

今天推荐一个 Implicit Chain-of-Thought(隐式推理) 的最新进展 —— SIM-CoT(Supervised Implicit Chain-of-Thought)。它直击隐式 CoT 一直「扶不起来」的核心痛点:隐式 token 一旦 scale 上去,训练就容易塌缩到同质化的 latent 状态,推理语义直接丢失。

大模型的能力正在被不同的范式逐步解锁:In-Context Learning 展示了模型无需微调即可泛化到新任务;Chain-of-Thought 通过引导模型分步推理来提升复杂问题的求解能力;近期,智能体框架则赋予模型调用工具、多轮交互的能力。