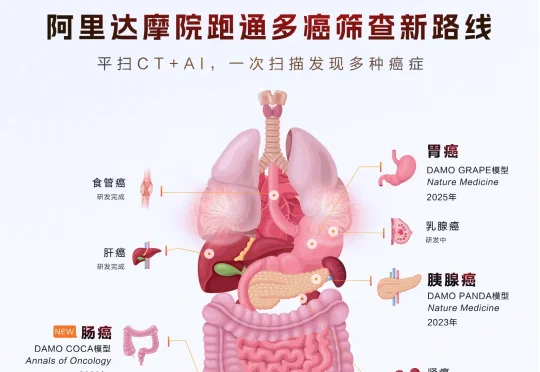

三年连下三癌,阿里AI模型DAMO COCA跑通了多癌筛查

三年连下三癌,阿里AI模型DAMO COCA跑通了多癌筛查医生说平扫CT上看不见癌——AI找到了。 2021年5月,一位患者因突发腹痛被推进急诊,拍了一张平扫CT。 影像报告出来了——没有提及肠道有问题。 两年后,这位患者做了肠镜。确诊肠癌。肿瘤已经明显增大

搜索

搜索

医生说平扫CT上看不见癌——AI找到了。 2021年5月,一位患者因突发腹痛被推进急诊,拍了一张平扫CT。 影像报告出来了——没有提及肠道有问题。 两年后,这位患者做了肠镜。确诊肠癌。肿瘤已经明显增大

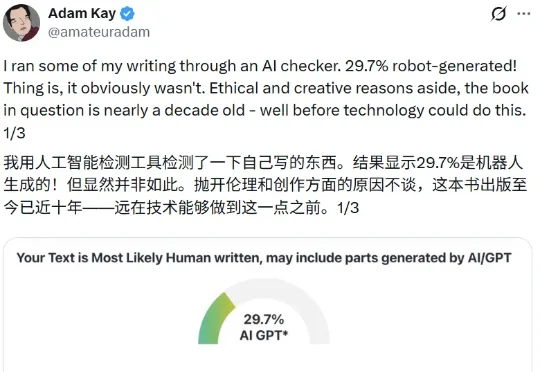

前两天,知名畅销书作家 Adam Kay 在社交媒体 X 分享了自己的经历:他心血来潮,把自己的作品丢进一款 AI 检测器里查重,结果系统信誓旦旦地判定其中有 29.7% 的内容由机器生成。

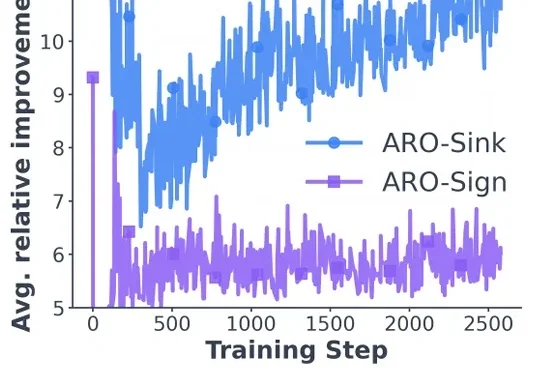

如果你在过去一年关注过大模型训练的技术,大概率听过 Muon 这个名字 —— 这个在月之暗面 K2 模型的相关讨论中走红的优化器,被视为是可能挑战 Adam 的新秀。它的思路很直接:对动量矩阵进行正交化,让各个奇异方向上的更新速率一致,提升训练效率。

这个看似科幻的想法,正在被一家名为Simile的公司变成现实。他们刚刚完成了1亿美元的A轮融资,由Index Ventures领投,Hanabi、A星、Bain Capital Ventures参与投资,连人工智能领域的传奇人物Andrej Karpathy、Fei-Fei Li、Adam D'Angelo等都加入了投资行列。

大规模表格模型(LTM)而非大规模语言模型(LLM)的 Fundamental 公司 Nexus 模型,在多个重要方面突破了当代人工智能实践。该模型具有确定性——即每次被询问相同问题时都会给出相同答案——且不依赖定义当代大多数人工智能实验室模型的 Transformer 架构 。

Aishwarya Naresh Reganti 和 Kiriti Badam 曾在 OpenAI、Google、Amazon、Databricks 等公司参与构建并成功推出了 50 多个企业级 AI 产品。最近,他们在播客节目中,与主持人 Lenny 细致分享了当前 AI 产品开发中的常见陷阱与成功路径。基于该播客视频,InfoQ 进行了部分删改。

多语言大模型(MLLM)在面对多语言任务时,往往面临一个选择难题:是用原来的语言直接回答,还是翻译成高资源语言去推理?

在 LLM 优化领域,有两个响亮的名字:Adam(及其变体 AdamW)和 Muon。

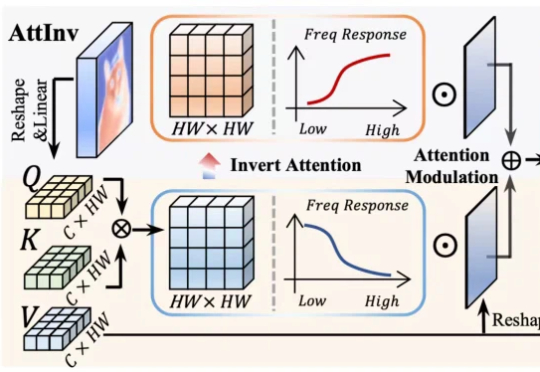

针对视觉 Transformer(ViT)因其固有 “低通滤波” 特性导致深度网络中细节信息丢失的问题,我们提出了一种即插即用、受电路理论启发的 频率动态注意力调制(FDAM)模块。它通过巧妙地 “反转” 注意力以生成高频补偿,并对特征频谱进行动态缩放,最终在几乎不增加计算成本的情况下,大幅提升了模型在分割、检测等密集预测任务上的性能,并取得了 SOTA 效果。

原文作者:David Adam 本篇《自然》长文共3702字,干货满满,预计阅读时间12分钟,时间不够建议可以先“浮窗”或者收藏哦。 研究表明,电子伙伴类应用有利有弊——但科学家们担心长期依赖性。 绘