AI助手现在认路了:谷歌地图直接「长」进大脑

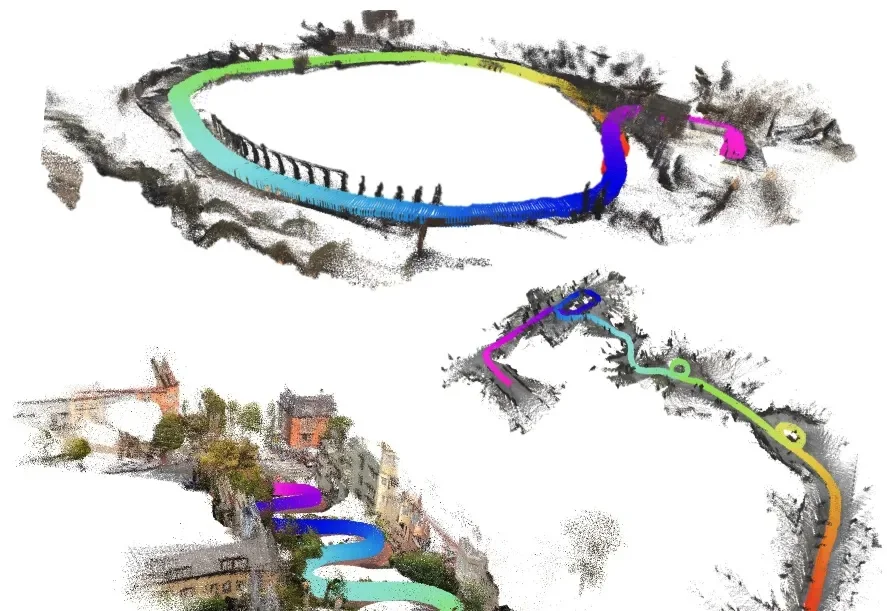

AI助手现在认路了:谷歌地图直接「长」进大脑谷歌DeepMind刚刚为Gemini API放了一个大招:内置工具和自定义函数终于可以在同一次调用里混着用了。再加上跨工具的「上下文环流」和Google Maps原生接入,Agent开发的编排噩梦正在终结。

谷歌DeepMind刚刚为Gemini API放了一个大招:内置工具和自定义函数终于可以在同一次调用里混着用了。再加上跨工具的「上下文环流」和Google Maps原生接入,Agent开发的编排噩梦正在终结。

AGI,究竟如何评判?刚刚,谷歌DeepMind发出重磅论文,直接从认知科学「借」了一套度量衡——把通用智能拆成10大认知能力,配一套三阶段评估协议,还联合Kaggle砸了20万美金,向全球研究者悬赏:谁能测出真正的AGI?

过去两天,全球爆火的 Agent 私人助手 OpenClaw,接连更新了两个版本,让人直呼「开发团队是不睡觉了吗?」

AI竞赛,已经踩下油门,开始全力冲刺!2026下半年,三巨头OpenAI、谷歌DeepMind、Anthropic将甩开所有人,递归自我改进的引擎已点火。接下来六个月,人类文明或将永久改写。

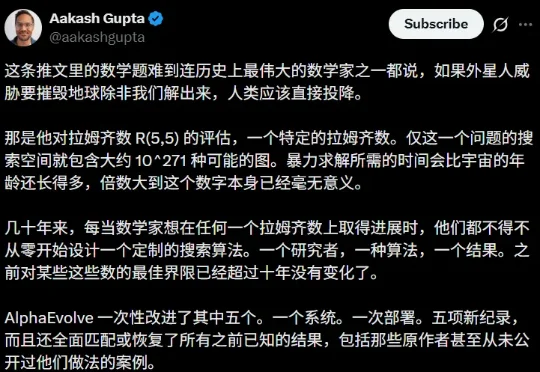

谷歌DeepMind又放大招了:AlphaEvolve自主写算法,一口气改写5个经典拉姆齐数下界,打破了尘封十年的数学纪录!诺奖得主Hassabis和图灵奖得主LeCun都纷纷点赞——AI,正在彻底改变数学突破的方式!

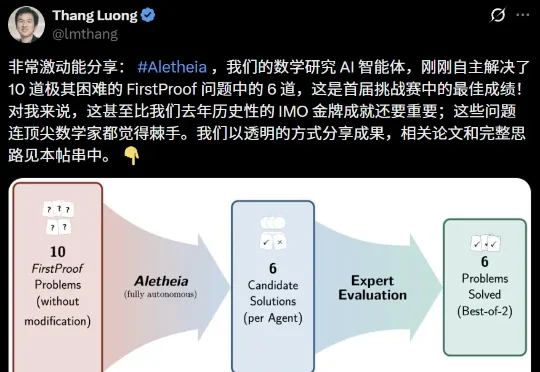

Google DeepMind最新AI智能体Aletheia在FirstProof挑战赛中,独立攻克了6道世界级数学难题,实现了从竞赛水平到PhD科研级的质变。人类数学研究的「手工时代」或许正步入倒计时。

创始人回炉敲代码、重整DeepMind军团、每周工作100小时……Google DeepMind掌舵人Demis Hassabis亲述过去一年谷歌与OpenAI的战事,他表示谷歌已找回状态,AGI或在2030年降临,人类将进入「后稀缺」时代。

今天早上,Google Labs发布了Pomelli最新功能Photoshoot,我们可以从一张产品图片出发,轻松制作高质量定制品牌照片,用于产品营销。Pomelli是Google Labs联合Google DeepMind于2025 年10月推出的AI营销工具实验项目,底层驱动模型为Nano Banana,专为中小企业设计。

作者 | 高允毅 很多人知道,Transformer 是谷歌发明的。但 ChatGPT,却不是谷歌做出来的。这件事,在过去几年,几乎成了硅谷最大的“遗憾注脚”。 但如果真正走进今天的 Google D

谷歌在 7.5 亿月活的 Gemini 中上线了 AI 音乐生成功能,输入一句话或一张照片,几秒就能得到一首带人声和歌词的完整歌曲。背后是 DeepMind 最新的 Lyria 3 模型,训练数据超 200 万首曲目。对 Suno 等 AI 音乐创业公司而言,竞争从此不再只是比模型,更是要比入口。