DeepMind发布代码修复AI智能体CodeMender,实现「被动响应」与「主动防御」一体化

DeepMind发布代码修复AI智能体CodeMender,实现「被动响应」与「主动防御」一体化近日,DeepMind 最新推出了一种全新的用于代码安全的 AI Agent—CodeMender,它使用 Gemini Deep Think 自动修补关键软件漏洞。它会检查补丁是否正确、是否能够修复根本原因,并且不会引起其他任何破坏。这确保只有高质量的解决方案才会被发送给人工审核。

近日,DeepMind 最新推出了一种全新的用于代码安全的 AI Agent—CodeMender,它使用 Gemini Deep Think 自动修补关键软件漏洞。它会检查补丁是否正确、是否能够修复根本原因,并且不会引起其他任何破坏。这确保只有高质量的解决方案才会被发送给人工审核。

OpenAI的后训练负责人和DeepMind的另一位AI4S大佬,双双离职并成立了一家AI4S公司Periodic Labs,专注于用AI Agent改造传统科研,助力攻克室温超导等世纪难题。目前该公司已获3亿美元融资。

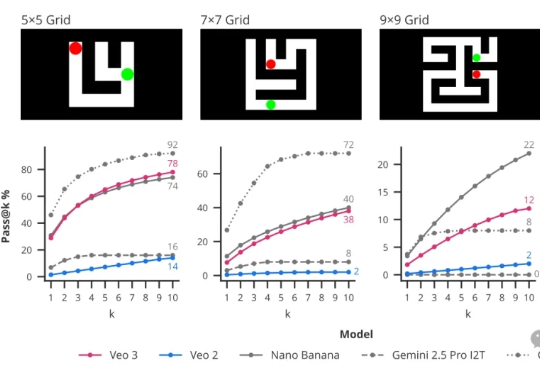

DeepMind公开了有关Veo 3视频模型最新论文!论文提出了「帧链」(Chain-of-Frames,CoF),认为视频模型也可能像通用大模型一样具备推理能力。零样本能力的涌现,表明视频模型的「GPT-3时刻」来了。

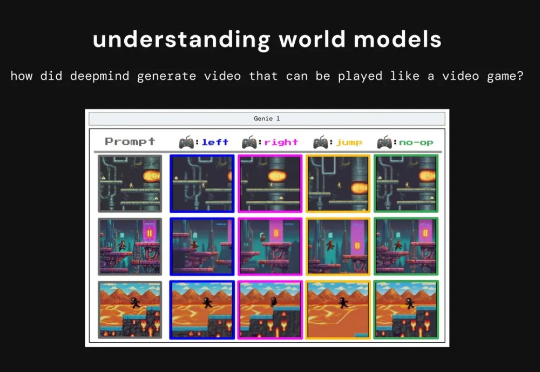

最近,X 博主 anandmaj 在一个月内复刻 Genie 3 的核心思想,开发出了 TinyWorlds,一个仅 300 万参数的世界模型,能够实时生成可玩的像素风格环境,包括 Pong、Sonic、Zelda 和 Doom。

CoT思维链的下一步是什么? DeepMind提出帧链CoF(chain-of-frames)。

超越DeepMind的Langfun、抱抱脸的Smolagent等,国产智能体位列全球智能体第一梯队!GitHub明星开源项目、行业首个100%开源的企业级智能体JoyAgent,迎来重要更新——

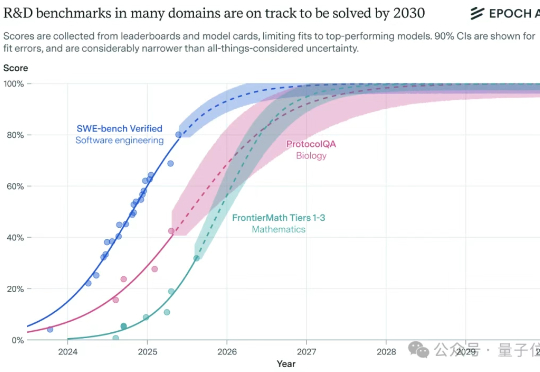

2030年的人工智能将会是什么样子?受谷歌DeepMind委托,Epoch发布新报告,从算力、数据、收入等方面进行了详细剖析。

百年流体力学难题,终被AI破解!谷歌DeepMind联手顶尖机构,首次用AI在三个不同方程中,成功发现全新的数学「奇点族」,开创研究全新范式。下一个诺奖,或被AI提前预定?

Epoch AI 最近受 Google DeepMind 委托编写了一份分析报告,探讨这种规模扩张(Scaling)在计算、投资、数据、硬件和能源方面将带来哪些影响。在报告中,进一步探讨了这种规模扩张将赋予的未来 AI 能力,尤其是在科研领域,而这正是领先 AI 开发者关注的重点。

就在最新的Nature新刊中,DeepSeek一举成为首家登上《Nature》封面的中国大模型公司,创始人梁文锋担任通讯作者。纵观全球,之前也只有极少数如DeepMind者,凭借AlphaGo、AlphaFold有过类似荣誉。