消耗1830亿token,Meta用AI把数学教材翻译成了一个超大Lean库

消耗1830亿token,Meta用AI把数学教材翻译成了一个超大Lean库编辑|Panda 数学正在迎来 AI 革命。 最近几个月尤为明显。比如,就在前几天,Google DeepMind 新论文宣布其最新系统 AlphaProof Nexus 在一次自主运行中,解决了 3

搜索

搜索

编辑|Panda 数学正在迎来 AI 革命。 最近几个月尤为明显。比如,就在前几天,Google DeepMind 新论文宣布其最新系统 AlphaProof Nexus 在一次自主运行中,解决了 3

7×24,AI也吃不消。

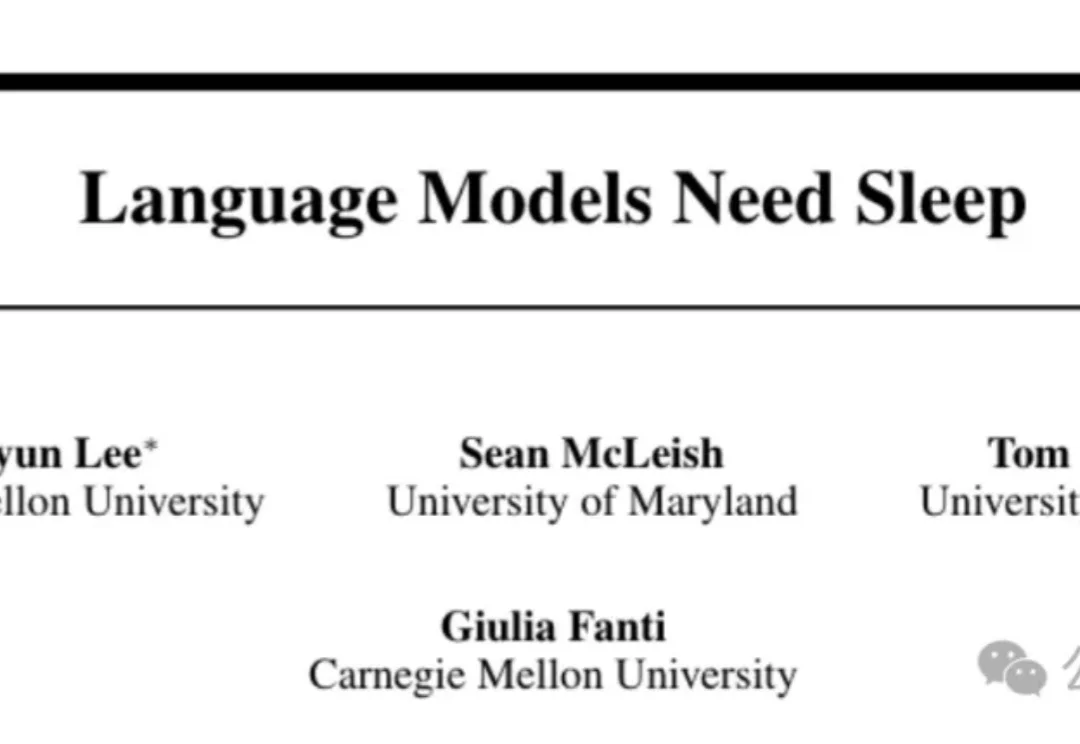

在具身智能快速发展的今天,机器人已经不再满足于「看见」刚体物体,而是开始真正走向复杂环境中的交互与操作。从机械臂开柜门,到服务机器人整理抽屉,再到工业场景中的工具操作,大量真实世界目标都属于关节物体(Articulated Objects)。

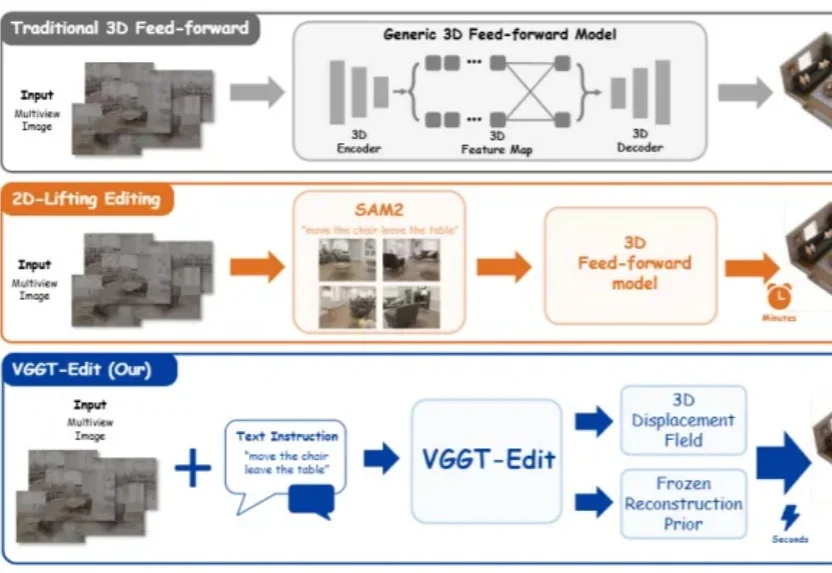

3D世界“会看”了,但还不会“改”。

据 FT 报道,字节跳动正在向旗下 Seed 部门员工开放新一轮豆包股认购权,每股 13 美元。Seed 目前约有 2000 名员工,包括核心研究员、基础设施工程师、数据标注团队和翻译人员。

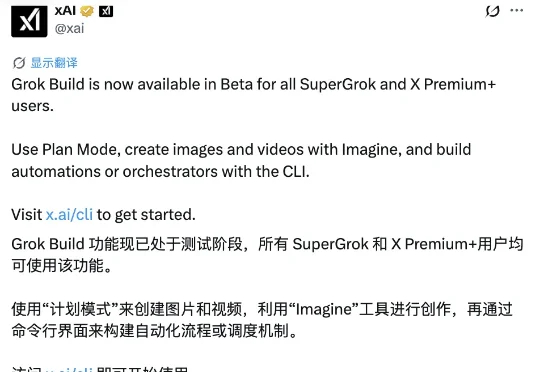

马斯克深夜官宣:1.5万亿参数Grok V9训练完成,现役三倍!更狠的是,训练数据直接灌入大量Cursor编程交互记录。几乎同一时间,更劲爆的细节浮出水面——训练过程中,xAI往模型里灌入了大量Cursor编程数据。

“我语言的局限,即意味着我世界的局限。”( Die Grenzen meiner Sprache bedeuten die Grenzen meiner Welt. )

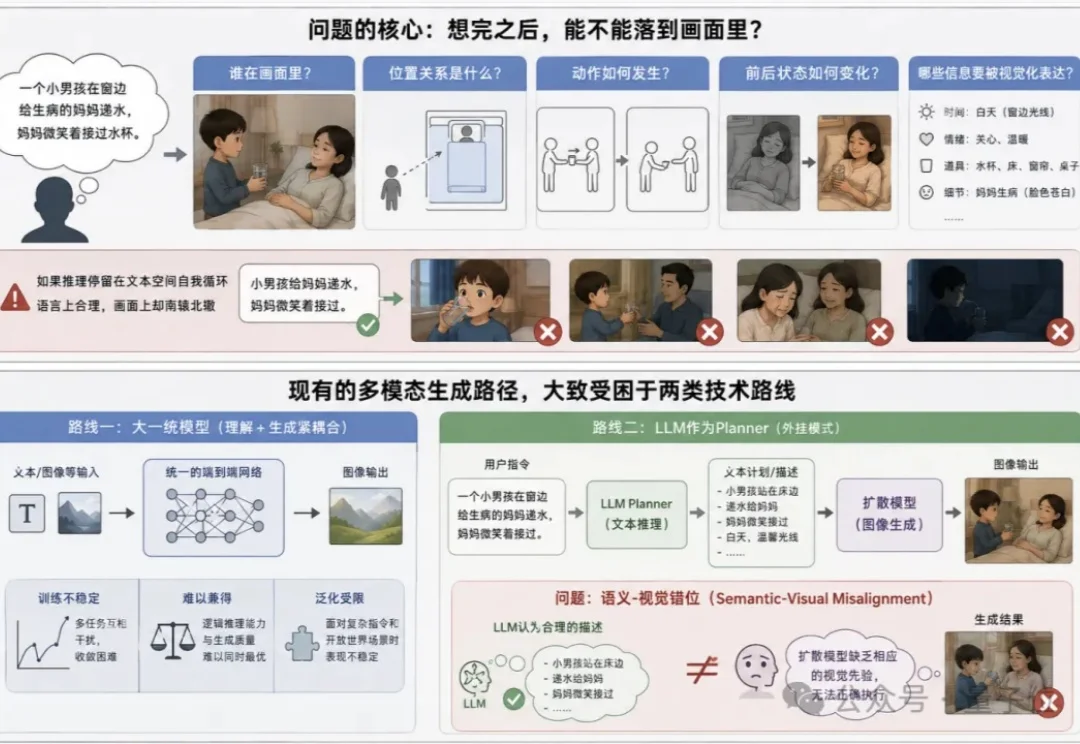

当下视觉生成正陷入一个能力错位困境—— 扩散模型的像素画质已接近完美,但一遇到需要逻辑推理的生成任务就频频翻车。

马斯克在X上发帖透露,xAI自家的Grok基础模型V9-Medium(1.5T)已经完成训练。预计再过2到3周,差不多就能正式对外发布啦:马斯克特意提到,V9-Medium的补充训练中加入了大量Cursor数据,后续还会继续添加。

FDE,全称 Forward Deployed Engineer[2]。它在两年前还是 Palantir 圈子里的一个工种黑话,今天已经悄悄变成猎头的开场白、招聘启事的高频岗位、以及社交媒体上“AI 时代最值钱岗位”的候选答案之一。